网络爬虫-url索引

网络爬虫-url索引

http://www.cnblogs.com/yuandong/archive/2008/08/28/Web_Spider_Url_Index.html

url索引的作用是判断一个url是否被抓取过,采用的算法主要是MD5数字签名。

假设一共要抓取的url不超过1亿条,用一个二进制的位表示一个url是否被抓取过,则至少需要1亿个位,我们管每一个位叫一个“槽”。考虑到MD5的算法是可能出现冲突(即不同的url算出来的MD5可能相同,这种概率很小),槽越少,冲突越明显,所以槽越多越好。但另一方面,还要考虑到占用内存的大小,因为在抓取的过程中,为了保证效率,所有的槽都需要载入内存。目前我使用的是2的28次方,即32M,相当于268435456(2.6亿)个槽。

当要判断一个url是否已经抓取过的时候,只要判断该url经过MD5签名后的值所对应的槽是否标记为1即可。例如给出的url是:http://www.ouc.edu.cn/,经过128位的MD5签名后,得出的1073542761,则需要判断的就是第1073542761个槽是0还是1。同样的道理,当完成一个url的抓取后,要将对应的槽标记为1。

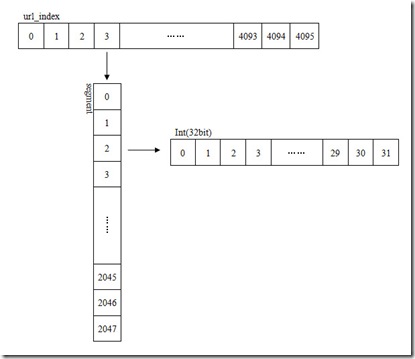

存储槽的32M空间在内存是不连续的,因为操作系统很难划分出32M的连续内存空间,所以将其分为4096个段Segment,每段2048个32位整数,32*2048*4096=268435456。相当于一个整型的二维数组。

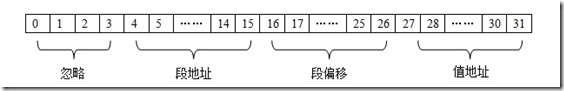

我们使用32位的MD5作为签名,表示为一个整数。这个整数分为三部分,分别是段地址、段偏移和值地址。第5-16位表示段地址,17-27位表示段偏移,28-32位(最后5位,取值范围为2的5次方,即0-31)表示在整形值中的位置、即值地址。

当给定一个url的MD5值时,通过以下函数计算出其段地址:

1: unsigned short get_segment_index(unsigned int md5) {

2:

3: //5-16位表示段地址

4:

5: unsigned short result;

6: bzero(&result, sizeof(unsigned short));

7: memcpy(&result, ((char*)&md5) + 2, sizeof(unsigned short));

8:

9: return result & 0x0FFF;

10: }

通过以下函数计算出其段偏移:

1: unsigned short get_segment_offset(unsigned int md5) {

2:

3: //17-27位表示段偏移

4:

5: unsigned short result;

6: bzero(&result, sizeof(unsigned short));

7: memcpy(&result, ((char*)&md5), sizeof(unsigned short));

8:

9: return result >> 5;

10: }

通过以下函数计算其值偏移:

1: unsigned int get_value(unsigned int md5) {

2:

3: //28-32(最后5位)为表示值

4:

5: unsigned int result = 1;

6: return result << (md5 & 0x0000001F);

7: }

再得到段地址、段偏移和值偏移后,就通过一下函数判定该Url是否已被抓取:

1: bool is_url_crawled(char* url) {

2:

3: //将给出的url进行md5运算,取得对应的Value,于储存的Value按位与

4:

5: unsigned int url_md5 = md5(url);

6: unsigned short segment_index = get_segment_index(url_md5);

7: unsigned short segment_offset = get_segment_offset(url_md5);

8: unsigned int value = get_value(url_md5);

9:

10: unsigned int result = (unsigned int)

(url_index[segment_index][segment_offset] & value);

11:

12: return result > 0 ? TRUE : FALSE;

13: }

如果未被抓取,在完成抓取后,通过以下函数标记为已抓取:

1: int mark_url_as_crawled(char* url) {

2:

3: //取得段地址、段偏移和url对应的值

4: unsigned int url_md5 = md5(url);

5: unsigned short segment_index = get_segment_index(url_md5);

6: unsigned short segment_offset = get_segment_offset(url_md5);

7: unsigned int value = get_value(url_md5);

8:

9: //通过按位或标记url对应的位为已抓取

10: url_index[segment_index][segment_offset] |= value;

11:

12: //同步写入索引文件

13: value = url_index[segment_index][segment_offset];

14: long offset = (((long)segment_index) * SEGMENT_LENGTH + segment_offset)

* sizeof(unsigned int);

15: if(fseek(index_file, offset, SEEK_SET) != 0)

16: return -1;

17:

18: if(fwrite(&value, sizeof(unsigned int), 1, index_file) != 1)

19: return -1;

20:

21: fflush(index_file);

22: return 0;

23: }

网络爬虫-url索引的更多相关文章

- 网络爬虫url跳转代码

from bs4 import BeautifulSoup from urllib.request import urlopen import re import random base_url = ...

- python网络爬虫(一):网络爬虫科普与URL含义

1. 科普 通用搜索引擎处理的对象是互联网的网页,目前网页的数量数以亿计,所以搜索引擎面临的第一个问题是如何设计出高效的下载系统,已将海量的网页下载到本地,在本地形成互联网网页的镜像.网络爬虫 ...

- Python 网络爬虫 008 (编程) 通过ID索引号遍历目标网页里链接的所有网页

通过 ID索引号 遍历目标网页里链接的所有网页 使用的系统:Windows 10 64位 Python 语言版本:Python 2.7.10 V 使用的编程 Python 的集成开发环境:PyChar ...

- 【Python网络爬虫一】爬虫原理和URL基本构成

1.爬虫定义 网络爬虫,即Web Spider,是一个很形象的名字.把互联网比喻成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛.网络蜘蛛是通过网页的链接地址来寻找网页的.从网站某一个页面(通常 ...

- [Python]网络爬虫(一):抓取网页的含义和URL基本构成

一.网络爬虫的定义 网络爬虫,即Web Spider,是一个很形象的名字. 把互联网比喻成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛.网络蜘蛛是通过网页的链接地址来寻找网页的. 从网站某一个 ...

- python 网络爬虫(二) BFS不断抓URL并放到文件中

上一篇的python 网络爬虫(一) 简单demo 还不能叫爬虫,只能说基础吧,因为它没有自动化抓链接的功能. 本篇追加如下功能: [1]广度优先搜索不断抓URL,直到队列为空 [2]把所有的URL写 ...

- [原创]手把手教你写网络爬虫(7):URL去重

手把手教你写网络爬虫(7) 作者:拓海 摘要:从零开始写爬虫,初学者的速成指南! 封面: 本期我们来聊聊URL去重那些事儿.以前我们曾使用Python的字典来保存抓取过的URL,目的是将重复抓取的UR ...

- Python 网络爬虫 009 (编程) 通过正则表达式来获取一个网页中的所有的URL链接,并下载这些URL链接的源代码

通过 正则表达式 来获取一个网页中的所有的 URL链接,并下载这些 URL链接 的源代码 使用的系统:Windows 10 64位 Python 语言版本:Python 2.7.10 V 使用的编程 ...

- 开源的49款Java 网络爬虫软件

参考地址 搜索引擎 Nutch Nutch 是一个开源Java 实现的搜索引擎.它提供了我们运行自己的搜索引擎所需的全部工具.包括全文搜索和Web爬虫. Nutch的创始人是Doug Cutting, ...

随机推荐

- 第二篇、为UITableViewCell 高度自适应加速 缓存cell的高度

通过NSCache缓存已经算好的行高 @interface ZHCellHeightCalculator : NSObject //系统计算高度后缓存进cache -(void)setHeight:( ...

- Cocos开发中性能优化工具介绍之Xcode中Instruments工具使用

Instruments是动态分析工具,它与Xcode集成在一起,可以在Xcode中通过菜单Product→Profile启动.启动如图所示,Instruments有很多跟踪模板可以动态分析和跟踪内存. ...

- C# SocketHelper 源码

玄机论坛Socket类库源码+Demo 本类库采用C# TcpLister,TcpClient高度封装,采用C# NetworkStream进行异步模式读取数据.采用C# Semaphore来进行并发 ...

- xml直接读取节点

<root> <books> <book id="one"></book> <book id="two"& ...

- Java执行命令行脚本

百度到的 Process p=Runtime.getRuntime().exec("C:\\test.cmd"); ProcessBuilder processBuilder=ne ...

- PHP中使用多线程

<?php while(1)//循环采用3个进程 { //declare(ticks=1); $bWaitFlag= FALSE; // 是否等待进程结束 //$bWaitFlag = TRUE ...

- google map api 学习笔记

(1)地图的缩放监听函数 google.maps.event.addlistener(map,"zoom_change",function(){ 缩放级别变化后的函数. }); ( ...

- Django文档——Model字段类型(Field Types)

大部分内容参考自http://wrongwaycn.github.io/django11/topics/db/models/index.html#topics-db-models ,内容是django ...

- NVIDIA显卡设置提升MineCraft流畅度

很喜欢MineCraft(我的世界)这款游戏.可09年Y450的配置现在看来有点弱,尽管将Y450的CPU升级至了2.8Ghz的T9600,内存升级至1066Mhz的4G双通道内存,硬盘更换为128G ...

- 使用bootstrap+asp.net mvc4+IBatis.Net实现的小程序

这个项目用到了三个技术点 1.bootstap 3.0 2.asp.net mvc4 3.IBatis.Net 这个三个技术点分别解决前端界面展示.中间mvc路由控制.实体框架映射数据访问 重点分页问 ...