SVM: 相对于logistic regression而言SVM的 cost function与hypothesis

很多学习算法的性能都差不多,关键不是使用哪种学习算法,而是你能得到多少数据量和应用这些学习算法的技巧(如选择什么特征向量,如何选择正则化参数等)

SVM在解决非线性问题上提供了强大的方法。

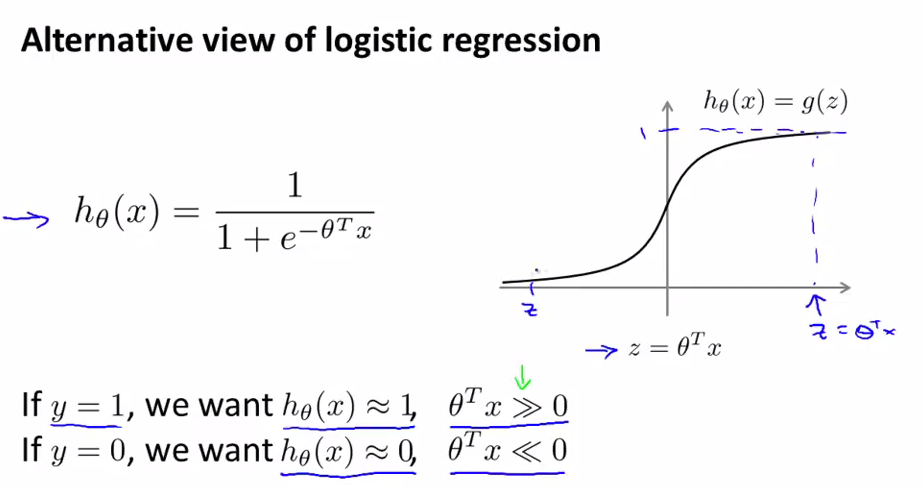

logistic regression的h(x)

如果y=1,则我们希望h(x)接近于1,即希望θTx要远远大于0

logistic regression的cost function

当y=1时的cost function如左图,用粉红色的两段直线近似的代替cost function,记为cost1(z)(y=1)

当y=0时的cost function如右图,用粉红色的两段直线近似的代替cost function,记为cost0(z)(y=0)

SVM的cost function

我们用cost1(z)(y=1)与cost0(z)(y=0)来代替logistic regression cost function(我们将外面的-移到了里面)中对应的项,然后将1/m去掉(因为cost function整体乘以一个常数求最小值对于取最小值的那个变量来说是不变的),这样我们用A+λB来表示cost function(A是前面的cost term,B是后面的正则化term),在SVM中,我们用CA+B来表示cost function(当C=1/λ时,取最小值的θ与logistic regression取最小值时的θ是一至的),这样我们就通过一个变量(C)来对两个term进行权衡(bias 与variance之间的权衡)。

最后,我们得出在SVM中的cost function如最下面的那个式子。

SVM的预测函数(hypothesis)

不同于logistic regression用来预测概率(0-1之间),在SVM中的hypothesis是直接对结果进行预测,如上图所示,当θTx>=0时,hypothesis = 1;

SVM: 相对于logistic regression而言SVM的 cost function与hypothesis的更多相关文章

- logistic regression与SVM

Logistic模型和SVM都是用于二分类,现在大概说一下两者的区别 ① 寻找最优超平面的方法不同 形象点说,Logistic模型找的那个超平面,是尽量让所有点都远离它,而SVM寻找的那个超平面,是只 ...

- Probabilistic SVM 与 Kernel Logistic Regression(KLR)

本篇讲的是SVM与logistic regression的关系. (一) SVM算法概论 首先我们从头梳理一下SVM(一般情况下,SVM指的是soft-margin SVM)这个算法. 这个算法要实现 ...

- Linear regression with one variable - Cost function

摘要: 本文是吴恩达 (Andrew Ng)老师<机器学习>课程,第二章<单变量线性回归>中第7课时<代价函数>的视频原文字幕.为本人在视频学习过程中逐字逐句记录下 ...

- Linear regression with one variable - Cost function intuition I

摘要: 本文是吴恩达 (Andrew Ng)老师<机器学习>课程,第二章<单变量线性回归>中第8课时<代价函数的直观认识 - 1>的视频原文字幕.为本人在视频学习过 ...

- [Scikit-learn] 1.1 Generalized Linear Models - Logistic regression & Softmax

二分类:Logistic regression 多分类:Softmax分类函数 对于损失函数,我们求其最小值, 对于似然函数,我们求其最大值. Logistic是loss function,即: 在逻 ...

- Machine Learning - 第3周(Logistic Regression、Regularization)

Logistic regression is a method for classifying data into discrete outcomes. For example, we might u ...

- CheeseZH: Stanford University: Machine Learning Ex3: Multiclass Logistic Regression and Neural Network Prediction

Handwritten digits recognition (0-9) Multi-class Logistic Regression 1. Vectorizing Logistic Regress ...

- logistic regression中的cost function选择

一般的线性回归使用的cost function为: 但由于logistic function: 本身非凸函数(convex function), 如果直接使用线性回归的cost function的话, ...

- Stanford机器学习---第三讲. 逻辑回归和过拟合问题的解决 logistic Regression & Regularization

原文:http://blog.csdn.net/abcjennifer/article/details/7716281 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

随机推荐

- zookeeper学习整理

概述 zookeeper是一个高可用的分布式数据管理与协调框架,基于ZAB算法实现,主要解决分布式一致性问题. https://www.cnblogs.com/felixzh/p/5869212.ht ...

- (转)JVM原理讲解和调优

背景:jvm实际调优在面试时候经常被问到,所以有必要认真总结一番. 转自:JVM原理讲解和调优 四.JVM内存调优 首先需要注意的是在对JVM内存调优的时候不能只看操作系统级别Java进程所占用的内存 ...

- POJ1166 The Clocks (爆搜 || 高斯消元)

总时间限制: 1000ms,内存限制: 65536kB 描述 |-------| |-------| |-------| | | | | | | | |---O | |---O | | O | | | ...

- LeetCode 13. 罗马数字转整数(Roman to Integer)

13. 罗马数字转整数 13. Roman to Integer 题目描述 罗马数字包含以下七种字符: I,V,X,L,C,D 和 M. 字符 数值 I 1 V ...

- nRF24L01P数据传输速率

项目要用nRF24L01P做语音的传输,数据量可想而知. 发送端按照8KHz/s采样率,每次采样双声道,16位深度(2Bytes). 数据量算一下就是8000x2x2=32000(Bytes) nRF ...

- 【LEETCODE】49、数组分类,简单级别,题目:566,1089

package y2019.Algorithm.array; /** * @ProjectName: cutter-point * @Package: y2019.Algorithm.array * ...

- redis HyperLogLog的使用

一.概念1.redis在2.8.9版本添加了HyperLogLog结构.2.redis HyperLogLog是用来做基数统计的算法,HyperLogLog的优点是:在输入元素的数量或者体积非常非常大 ...

- ITIL《信息技术基础架构库》

一 概述 1. ITIL 自上世纪70年代开始,个人计算机以及计算机网络开始在欧美发达国家普及.随着时间的推移,信息系统的规模越来越大,人们对信息系统的依赖也越来越强.特别是到了80年代,互联网开始普 ...

- mabatis缓存

一级缓存 public static SqlSession getSqlSession() { String resource = "mybatis-config.xml"; In ...

- 转 让NET C# 程序独立运行(脱离 .NET Framework运行,绿色运行) 未验证

但是.net版本众多.而且.NET Framework框架很大.拖着一个大大的.net Framework总是让人很郁闷. 在网上找呀找呀.找到另一个.NET Framework 替代方案.Mono. ...