长短时记忆网络LSTM和条件随机场crf

LSTM 原理

CRF 原理

给定一组输入随机变量条件下另一组输出随机变量的条件概率分布模型。假设输出随机变量构成马尔科夫随机场(概率无向图模型)

在标注问题应用中,简化成线性链条件随机场,对数线性判别模型,学习方法通常是最大似然估计或正则化的最大似然估计。

概率无向图模型:

无向图表示的联合概率分布。

1. 定义:

成对马尔科夫性,局部马尔科夫性,全局马尔科夫性,

上述三个性质定义等价,主要阐述,三个集合,A, B, C,其中集合A和B表示在无向图G中被结点集合C分开的任意结点集合

给定随机变量组Yc的条件下,随机变量组Ya和Yb是条件独立的。

满足三条性质就是的联合概率分布P(Y)就是联合概率无向图模型,如何求这个联合概率的分布,写成若干子联合概率乘积的形式。还好概率无向图模型能因子分解

2. 因子分解

团:任意两个节点均有边连接的结点子集。

最大团:不能再加进任何一个新的结点使其成为更大的团。

因子分解:表示将概率无向图上的联合概率分布表示为其最大团上的随机变量的函数的乘积形式

P(Y)可以写成图中所有最大团C上的函数Ψc(Yc)的乘积形式,Z是规范化因子

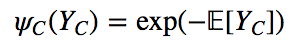

势函数要求是严格正的,通常是指数函数

3. 条件随机场的定义:输入序列来预测输出序列的判别式模型

P(Y|X) X是需要标注的观测序列,Y是标记序列。利用训练集通过极大似然估计得到条件概率模型。在测试过程,对于给定的观测序列,模型需要求出条件概率最大的输出序列。

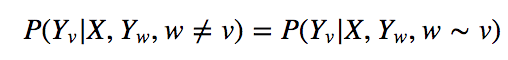

对任意结点v都成立,则P(Y|X)为条件随机场,就是做了一个假设简化了计算,只考虑相连,忽略外围其他边。

中 w≠v表示 w 是除 v 以外的所有节点,w∼v表示 w 是与 v 相连接的所有节点。

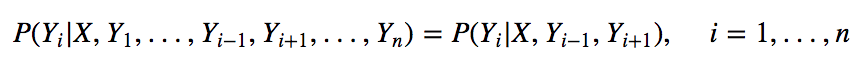

线性链条件随机场的定义:

其中当 i 取 1 或 n 时只考虑单边。

4. 线性链条件随机场的数学表达式

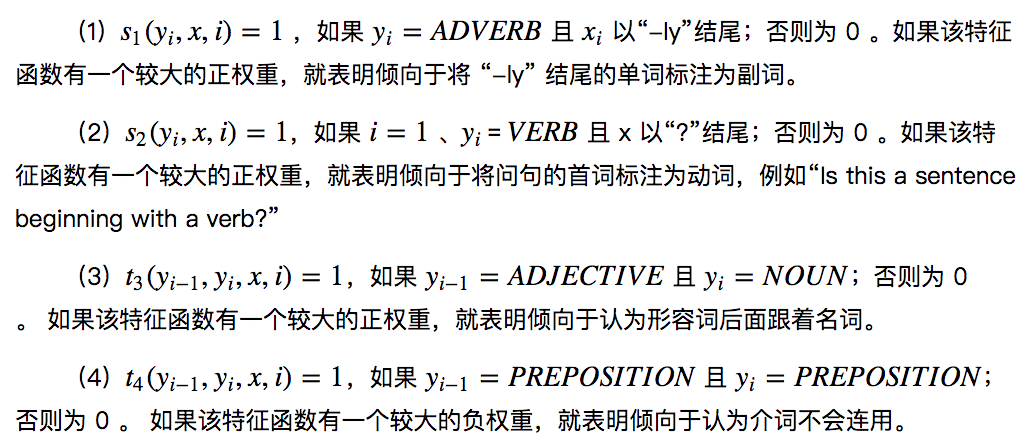

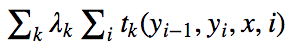

线性链条件随机场的参数化形式:特征函数及例子

Z(x) 作为规范化因子,是对 y 的所有可能取值求和。

tk特征函数定义在边上,称为转移特征,依赖当前和前一位置,sl特征函数定义在结点上,称为状态特征,依赖当前位置。两者取值0或1,当特征条件满足为1,不满足为0,条件随机场完全有特征函数tk,sl和对应权重确定。

tk和sl相当于给定的特征模板,给定y可以计算出该标记序列的条件概率。

以序列标注为例:

序列标注 vs 分类

序列标注不是简单的分类,这两类问题存在非常大的区别

lstm处理特征fc到类别数后直接softmax效果没有crf好,因为为每一个待标注的位置都当作一个样本然后进行分类,这样单点的分类,将会有很大的信息损失,因为一个序列的不同位置之间存在联系,应该对这个相关性建模。

条件随机场的简化形式:

这种双重求和就表明了对于同一个特征(k),在各个位置(i)上都有定义。将某一特征模板在所有位置上求和的做法相当于在将局部特征转化为全局特征函数,从而可以写成内积形式。

这种双重求和就表明了对于同一个特征(k),在各个位置(i)上都有定义。将某一特征模板在所有位置上求和的做法相当于在将局部特征转化为全局特征函数,从而可以写成内积形式。

矩阵形式:

这种形式依托于线性链条件随机场对应的图模型仅在两个相邻节点之间存在边。在状态序列的两侧添加两个新的状态 y0=start 、yn+1=stop。

未完待续

线性链条件随机场的解码问题

解码问题即预测问题,给定条件随机场 P(Y|X) 和观测序列 x ,求最有可能的状态序列 y* 。与 HMM 类似,使用维特比算法求解。

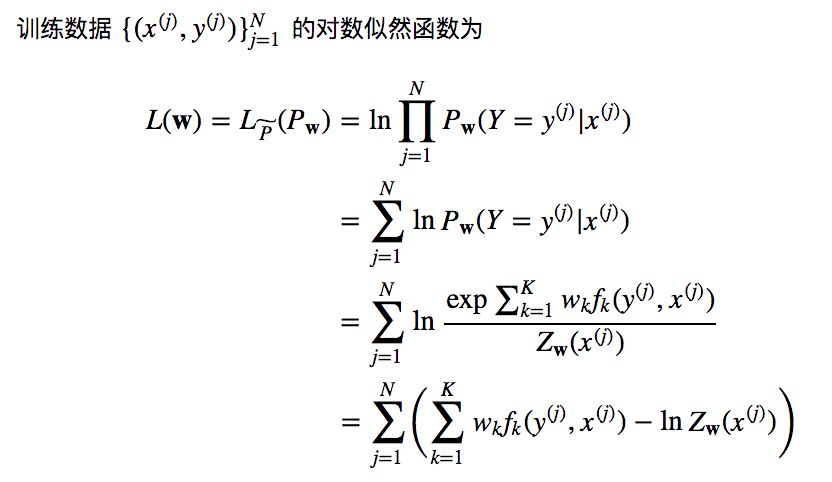

线性链条件随机场的学习问题

对权重w求导

长短时记忆网络LSTM和条件随机场crf的更多相关文章

- (转)零基础入门深度学习(6) - 长短时记忆网络(LSTM)

无论即将到来的是大数据时代还是人工智能时代,亦或是传统行业使用人工智能在云上处理大数据的时代,作为一个有理想有追求的程序员,不懂深度学习(Deep Learning)这个超热的技术,会不会感觉马上就o ...

- 长短时记忆网络(LSTM)

长短时记忆网络 循环神经网络很难训练的原因导致它的实际应用中很处理长距离的依赖.本文将介绍改进后的循环神经网络:长短时记忆网络(Long Short Term Memory Network, LSTM ...

- 零基础入门深度学习(6) - 长短时记忆网络(LSTM)

代码: def forward(self, x): ''' 根据式1-式6进行前向计算 ''' self.times += 1 # 遗忘门 fg = self.calc_gate(x, self.Wf ...

- 机器学习与Tensorflow(5)——循环神经网络、长短时记忆网络

1.循环神经网络的标准模型 前馈神经网络能够用来建立数据之间的映射关系,但是不能用来分析过去信号的时间依赖关系,而且要求输入样本的长度固定 循环神经网络是一种在前馈神经网络中增加了分亏链接的神经网络, ...

- LSTM——长短时记忆网络

LSTM(Long Short-term Memory),长短时记忆网络是1997年Hochreiter和Schmidhuber为了解决预测位置与相关信息之间的间隔增大或者复杂语言场景中,有用信息间隔 ...

- RNN学习笔记(一):长短时记忆网络(LSTM)

一.前言 在图像处理领域,卷积神经网络(Convolution Nerual Network,CNN)凭借其强大的性能取得了广泛的应用.作为一种前馈网络,CNN中各输入之间是相互独立的,每层神经元的信 ...

- 条件随机场(CRF) - 1 - 简介(转载)

转载自:http://www.68idc.cn/help/jiabenmake/qita/20160530618222.html 首先我们先弄懂什么是"条件随机场",然后再探索其详 ...

- 条件随机场(CRF) - 1 - 简介

声明: 1,本篇为个人对<2012.李航.统计学习方法.pdf>的学习总结,不得用作商用,欢迎转载,但请注明出处(即:本帖地址). 2,由于本人在学习初始时有很多数学知识都已忘记,所以为了 ...

- 条件随机场(CRF) - 2 - 定义和形式(转载)

转载自:http://www.68idc.cn/help/jiabenmake/qita/20160530618218.html 参考书本: <2012.李航.统计学习方法.pdf> 书上 ...

随机推荐

- CSDN沙龙记录

Panel python踩过的坑 曹正: 原因:语言的理解不精准. 语言特性坑:函数的参数不可变类型的定义类似list[],惰性处理简而言之延后执行, 胡阳: gevent的问题,django连接池的 ...

- python3+selenium框架设计10-发送邮件

使用python3的email模块和smtplib模块可以实现发送邮件的动能.email模块用来生成email,smtplib模块用来发送邮件,接下来看如何在生成测试报告之后,并将报告放在邮件附件中并 ...

- requests库入门05-参数类型

一个接口基本都需要传入参数,有的参数必填,有的不必填. params参数 使用params参数来传递接口所需要的参数.一般用在get请求中,url参数是通过?拼接,?前面是接口的地址,之后是请求的参数 ...

- 空串、null串和isEmpty方法

空串 空串""是长度为0的字符串.可以调用以下代码检查字符串是否为空: if(str.length() == 0) 或 if(str.equals("")) 空 ...

- Unity3D RTS游戏中帧同步实现

帧同步技术是早期RTS游戏常用的一种同步技术,本篇文章要给大家介绍的是RTX游戏中帧同步实现,帧同步是一种前后端数据同步的方式,一般应用于对实时性要求很高的网络游戏,想要了解更多帧同步的知识,继续往下 ...

- (转!)利用Keras实现图像分类与颜色分类

2018-07-19 全部谷歌渣翻加略微修改 大家将就的看哈 建议大佬们还是看看原文 点击收获原文 其中用到的示例文件 multi-output-classification 大家可以点击 下载 . ...

- MySQL配置说明

以下内容,来源于http://www.jb51.net/article/48082.htm [client] port = 3306 socket = /tmp/mysql.sock [mysqld] ...

- 【ORIGINATE】详解

originate 用法如下: originate <call url> <exten> |&<application_name>(<app_args ...

- ROM、PROM、EPROM、EEPROM、FLASH ROM简介

ROM指的是"只读存储器",即Read-Only Memory.这是一种线路最简单半导体电路,通过掩模工艺, 一次性制造,其中的代码与数据将永久保存(除非坏掉),不能进行修改.这玩 ...

- python学习第40天

# 多表查询 # 索引的基础理论 + 数据准备