torch& tensorflow

#torch

import torch

import torch.nn as nn

import torch.nn.functional as F class Net(nn.Module): def __init__(self):

super(Net, self).__init__()

# 1 input image channel, 6 output channels, 5x5 square convolution

# kernel

self.conv1 = nn.Conv2d(1, 6, 5)

self.conv2 = nn.Conv2d(6, 16, 5)

# an affine operation: y = Wx + b

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10) def forward(self, x):

# Max pooling over a (2, 2) window

x = F.max_pool2d(F.relu(self.conv1(x)), (2, 2))

# If the size is a square you can only specify a single number

x = F.max_pool2d(F.relu(self.conv2(x)), 2)

x = x.view(-1, self.num_flat_features(x))

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x def num_flat_features(self, x):

size = x.size()[1:] # all dimensions except the batch dimension

num_features = 1

for s in size:

num_features *= s

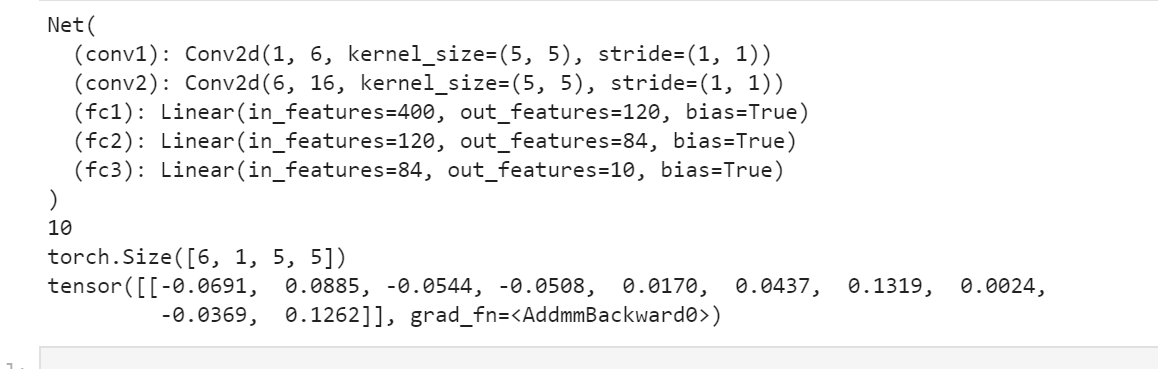

return num_features net = Net()

print(net) params = list(net.parameters())

print(len(params))

print(params[0].size()) # conv1's .weigh input = torch.randn(1, 1, 32, 32)

out = net(input)

print(out)

vgg

#从keras.model中导入model模块,为函数api搭建网络做准备

from tensorflow.keras import Model

from tensorflow.keras.layers import Flatten,Dense,Dropout,MaxPooling2D,Conv2D,BatchNormalization,Input,ZeroPadding2D,Concatenate

from tensorflow.keras import *

from tensorflow.keras import regularizers #正则化

from tensorflow.keras.optimizers import RMSprop #优化选择器

from tensorflow.keras.layers import AveragePooling2D

from tensorflow.keras.datasets import mnist

import matplotlib.pyplot as plt

import numpy as np

from tensorflow.python.keras.utils import np_utils #数据处理

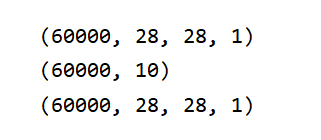

(X_train,Y_train),(X_test,Y_test)=mnist.load_data()

X_test1=X_test

Y_test1=Y_test

X_train=X_train.reshape(-1,28,28,1).astype("float32")/255.0

X_test=X_test.reshape(-1,28,28,1).astype("float32")/255.0

Y_train=np_utils.to_categorical(Y_train,10)

Y_test=np_utils.to_categorical(Y_test,10)

print(X_train.shape)

print(Y_train.shape)

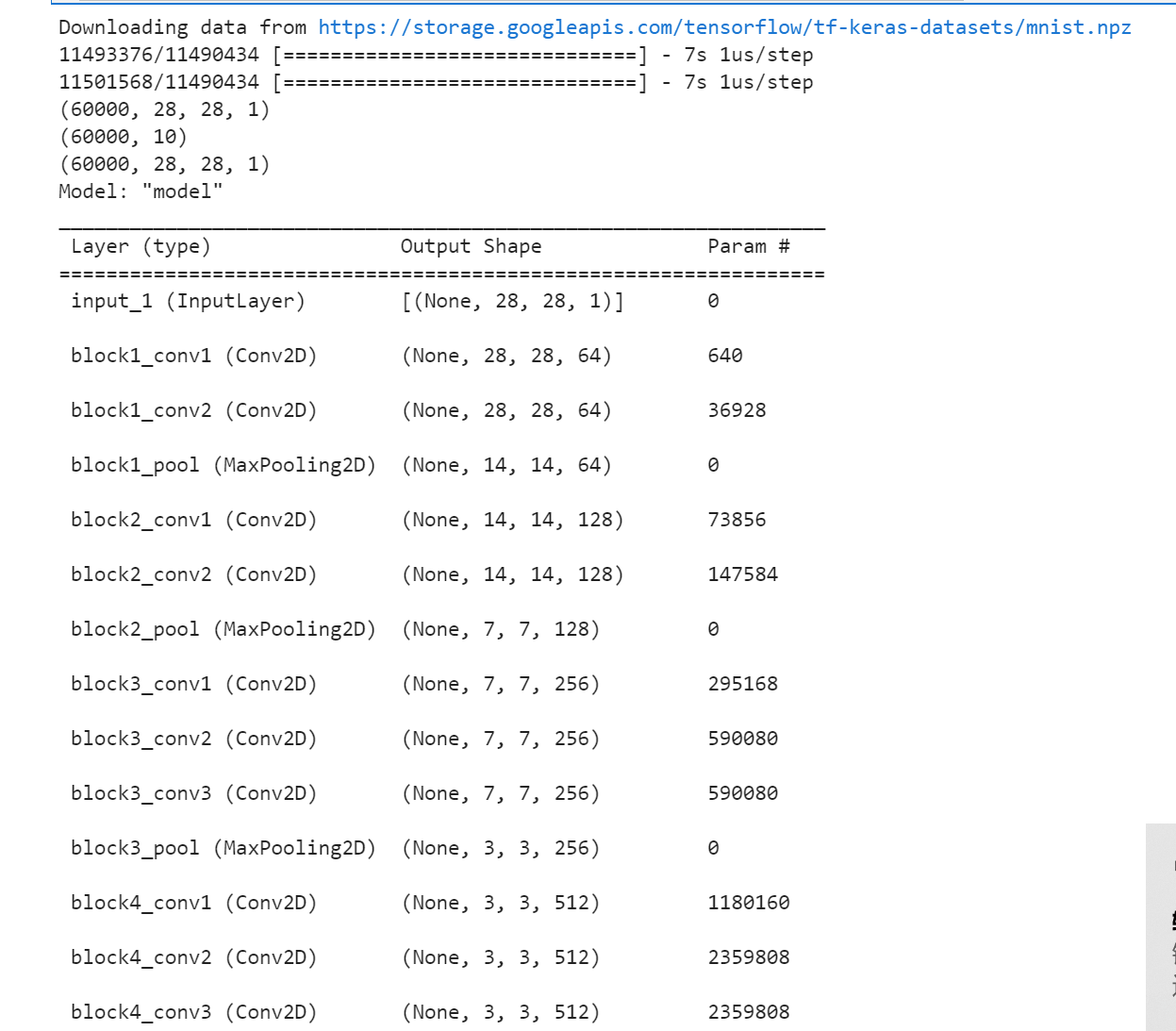

print(X_train.shape) def vgg16():

x_input = Input((28, 28, 1)) # 输入数据形状28*28*1

# Block 1

x = Conv2D(64, (3, 3), activation='relu', padding='same', name='block1_conv1')(x_input)

x = Conv2D(64, (3, 3), activation='relu', padding='same', name='block1_conv2')(x)

x = MaxPooling2D((2, 2), strides=(2, 2), name='block1_pool')(x) # Block 2

x = Conv2D(128, (3, 3), activation='relu', padding='same', name='block2_conv1')(x)

x = Conv2D(128, (3, 3), activation='relu', padding='same', name='block2_conv2')(x)

x = MaxPooling2D((2, 2), strides=(2, 2), name='block2_pool')(x) # Block 3

x = Conv2D(256, (3, 3), activation='relu', padding='same', name='block3_conv1')(x)

x = Conv2D(256, (3, 3), activation='relu', padding='same', name='block3_conv2')(x)

x = Conv2D(256, (3, 3), activation='relu', padding='same', name='block3_conv3')(x)

x = MaxPooling2D((2, 2), strides=(2, 2), name='block3_pool')(x) # Block 4

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block4_conv1')(x)

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block4_conv2')(x)

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block4_conv3')(x)

x = MaxPooling2D((2, 2), strides=(2, 2), name='block4_pool')(x) # Block 5

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block5_conv1')(x)

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block5_conv2')(x)

x = Conv2D(512, (3, 3), activation='relu', padding='same', name='block5_conv3')(x) #BLOCK 6

x=Flatten()(x)

x=Dense(256,activation="relu")(x)

x=Dropout(0.5)(x)

x = Dense(256, activation="relu")(x)

x = Dropout(0.5)(x)

#搭建最后一层,即输出层

x = Dense(10, activation="softmax")(x)

# 调用MDOEL函数,定义该网络模型的输入层为X_input,输出层为x.即全连接层

model = Model(inputs=x_input, outputs=x)

# 查看网络模型的摘要

model.summary()

return model model=vgg16()

optimizer=RMSprop(lr=1e-4)

model.compile(loss="binary_crossentropy",optimizer=optimizer,metrics=["accuracy"])

#训练加评估模型

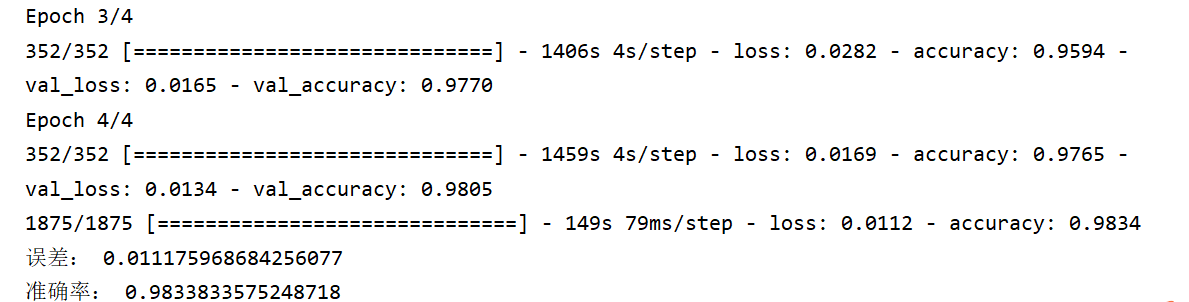

n_epoch=4

batch_size=128

def run_model(): #训练模型

training=model.fit(

X_train,

Y_train,

batch_size=batch_size,

epochs=n_epoch,

validation_split=0.25,

verbose=1

)

test=model.evaluate(X_train,Y_train,verbose=1)

return training,test

training,test=run_model()

print("误差:",test[0])

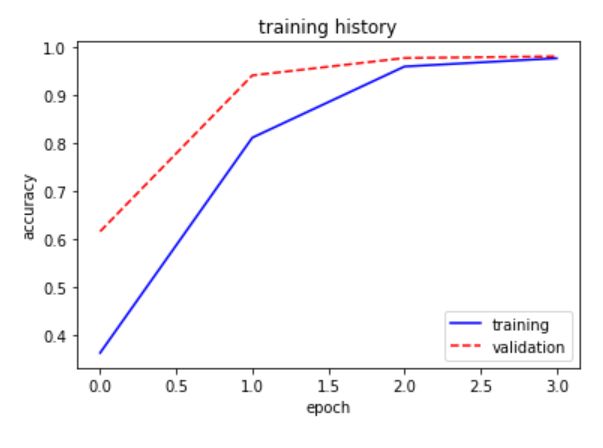

print("准确率:",test[1]) def show_train(training_history,train, validation):

plt.plot(training.history[train],linestyle="-",color="b")

plt.plot(training.history[validation] ,linestyle="--",color="r")

plt.title("training history")

plt.xlabel("epoch")

plt.ylabel("accuracy")

plt.legend(["training","validation"],loc="lower right")

plt.show()

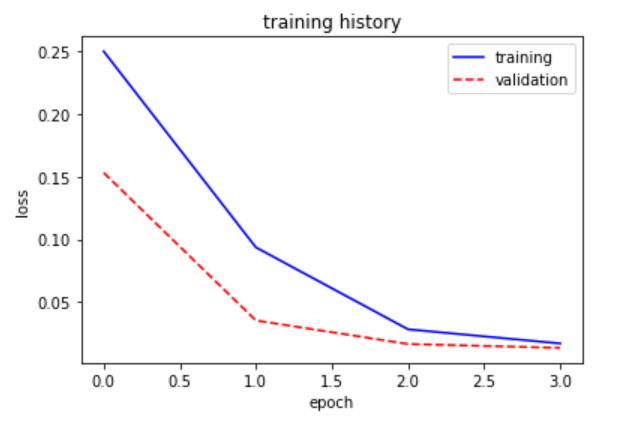

show_train(training,"accuracy","val_accuracy") def show_train1(training_history,train, validation):

plt.plot(training.history[train],linestyle="-",color="b")

plt.plot(training.history[validation] ,linestyle="--",color="r")

plt.title("training history")

plt.xlabel("epoch")

plt.ylabel("loss")

plt.legend(["training","validation"],loc="upper right")

plt.show()

show_train1(training,"loss","val_loss") prediction=model.predict(X_test)

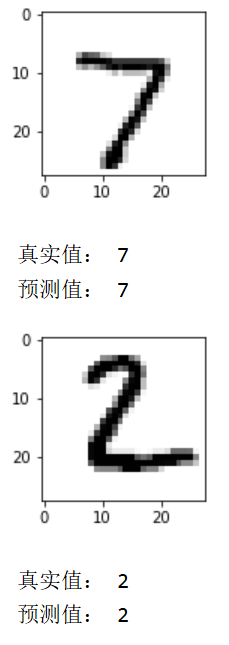

def image_show(image):

fig=plt.gcf() #获取当前图像

fig.set_size_inches(2,2) #改变图像大小

plt.imshow(image,cmap="binary") #显示图像

plt.show()

def result(i):

image_show(X_test1[i])

print("真实值:",Y_test1[i])

print("预测值:",np.argmax(prediction[i]))

result(0)

result(1)

torch& tensorflow的更多相关文章

- Tutorial: Implementation of Siamese Network on Caffe, Torch, Tensorflow

Tutorial: Implementation of Siamese Network with Caffe, Theano, PyTorch, Tensorflow Updated on 2018 ...

- torch 入门

torch 入门1.安装环境我的环境mac book pro 集成显卡 Intel Iris不能用 cunn 模块,因为显卡不支持 CUDA2.安装步骤: 官方文档 (1).git clone htt ...

- 学习Data Science/Deep Learning的一些材料

原文发布于我的微信公众号: GeekArtT. 从CFA到如今的Data Science/Deep Learning的学习已经有一年的时间了.期间经历了自我的兴趣.擅长事务的探索和试验,有放弃了的项目 ...

- pytorch使用不完全文档

1. 利用tensorboard看loss: tensorflow和pytorch环境是好的的话,链接中的logger.py拉到自己的工程里,train.py里添加相应代码,直接能用. 关于环境,小小 ...

- CS231n 2016 通关 第一章-内容介绍

第一节视频的主要内容: Fei-Fei Li 女神对Computer Vision的整体介绍.包括了发展历史中的重要事件,其中最为重要的是1959年测试猫视觉神经的实验. In 1959 Harvar ...

- 深度学习框架caffe/CNTK/Tensorflow/Theano/Torch的对比

在单GPU下,所有这些工具集都调用cuDNN,因此只要外层的计算或者内存分配差异不大其性能表现都差不多. Caffe: 1)主流工业级深度学习工具,具有出色的卷积神经网络实现.在计算机视觉领域Caff ...

- Torch,Tensorflow使用: Ubuntu14.04(x64)+ CUDA8.0 安装 Torch和Tensorflow

系统配置: Ubuntu14.04(x64) CUDA8.0 cudnn-8.0-linux-x64-v5.1.tgz(Tensorflow依赖) Anaconda 1. Torch安装 Torch是 ...

- 一图看懂深度学习框架对比----Caffe Torch Theano TensorFlow

Caffe Torch Theano TensorFlow Language C++, Python Lua Python Python Pretrained Yes ++ Yes ++ Yes ...

- tensorflow,torch tips

apply weightDecay,L2 REGULARIZATION_LOSSES weights = tf.get_collection(tf.GraphKeys.TRAINABLE_VARIAB ...

- 关于类型为numpy,TensorFlow.tensor,torch.tensor的shape变化以及相互转化

https://blog.csdn.net/zz2230633069/article/details/82669546 2018年09月12日 22:56:50 一只tobey 阅读数:727 1 ...

随机推荐

- Bulldog

Bulldog 目录 Bulldog 1 信息收集 1.1 端口扫描 1.2 后台目录扫描 1.2.1 目录分析 2 Web-Shell利用 2.1 尝试命令执行 2.2 尝试利用系统命令注入 2.3 ...

- [专题总结]Gridea快速免费搭建个人博客

介绍 或许你很想把你所知道的问题写出来,或许你文思泉涌,想给大家分享.我相信,你一定能写好博客,只要坚持,就可以了. 或许大家会不理解,为什么不用大平台的博客呢?或许你稍微了解就会知道,现在的博客平台 ...

- 如何用revit+bimfilm快速完成径向动画制作

推荐:将 NSDT场景编辑器 加入你的3D开发工具链. 在实际的施工中,我们会遇到诸如一些管道保温层包覆的施工内容,所以在制作它们的施工动画时,我们需要用径向剖切保温层来表达管道保温层包覆过程的施工状 ...

- PostGIS之空间索引

1. 概述 PostGIS 是PostgreSQL数据库一个空间数据库扩展,它添加了对地理对象的支持,允许在 SQL 中运行空间查询 PostGIS官网:About PostGIS | PostGIS ...

- nutGet操作数据库

在netcoe开发过程中,通过基建生成Razor页面增删改查,通过数据实例生成数据库时,不要手工修改数据库,而且通过程序包管理器控制台命令执行 1.没有数据库第一次新建的时候可以执行add-migra ...

- C++ 中的匿名函数(lambda表达式)

问题引入 使用std::sort函数对自定义类型排序时,我们需要传入一个比较函数作为参数.该比较函数只需要使用一次,但占有一个全局命名域中的名字,而且非常短,短到不需要名字就知道它的作用.这很浪费命名 ...

- 关于我在安装2.6.9版本bochs虚拟机时遇到的问题以及解决过程

更新于:2019.7.2 在阅读<一个64位操作系统的设计与实现>过程中,搭建实验环境遇到的诸多困难. 本人的实验环境:vmware15.0 下安装有kali-liunx虚拟机里进行的安装 ...

- Windos下 java后台软件服务化(举例)-WinSW

WinSW-软件服务化 1.1 举例:ApiWintool可执行jar ApiWintool.exe ApiWintool.jar ApiWintool.xml install.cmd uninsta ...

- windows下gitlab-ci.yml配置进入某一目录找不到,无权限

打开任务管理器查看gitlab-runner所使用的的用户 更改gitlab-runner服务权限, 找到gitlab-runner服务,右键-属性-登陆,选择[此账户]点击[浏览] 选择具有权限的账 ...

- vue2和vue3配置全局自定义参数及vue3动态绑定ref

在 Vue2.x 中我们可以通过 Vue.prototype 添加全局属性 property.但是在 Vue3.x 中需要将 Vue.prototype 替换为 config.globalProper ...