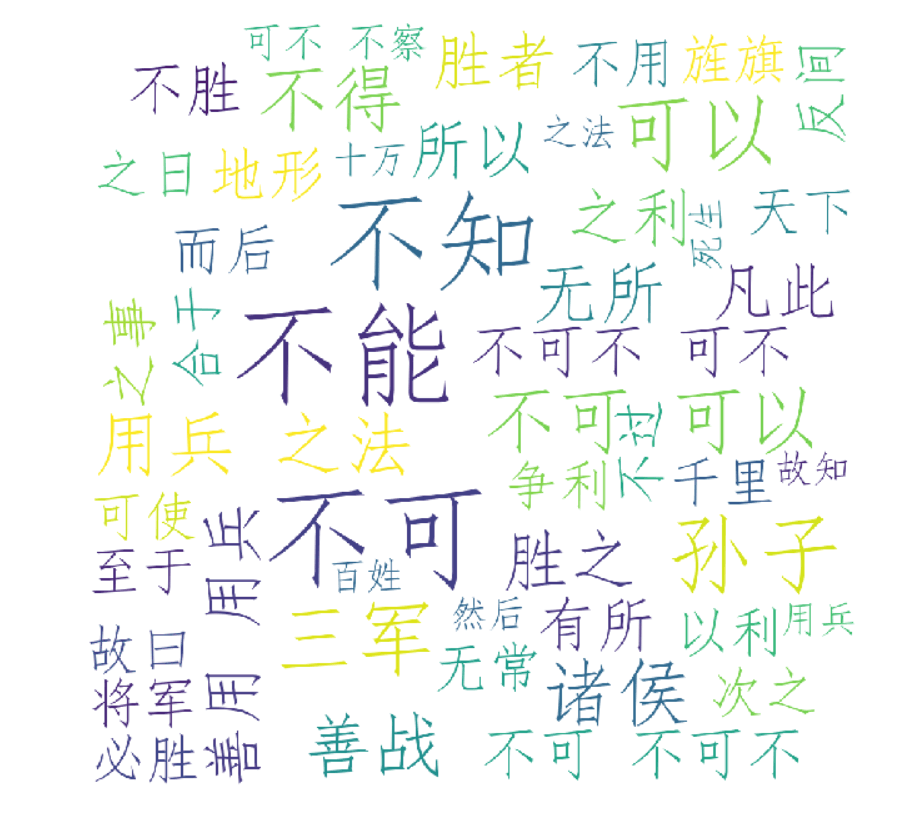

jieba库与词云的使用——以孙子兵法为例

1.打开cmd安装jieba库和 matplotlib。

2.打开python,输入代码。代码如下:

from wordcloud import WordCloud

import matplotlib.pyplot as plt

import jieba def create_word_cloud(filename): text = open("孙子兵法.txt","r",encoding='GBK').read() #打开自己想要的文本 wordlist = jieba.cut(text, cut_all=True) # 结巴分词 wl = " ".join(wordlist) wc = WordCloud( #设置词云 background_color="white", # 设置背景颜色 max_words=50, # 设置最大显示的词云数 font_path='C:/Windows/Fonts/simfang.ttf', # 索引在C盘上的字体库 height=1000, width=1000, max_font_size=150, # 设置字体最大值 random_state=150, # 设置有多少种随机生成状态,即有多少种配色方案 ) myword = wc.generate(wl) # 生成词云 plt.imshow(myword) # 展示词云图 plt.axis("off") plt.show() wc.to_file('img_book.png') # 把词云保存下 txt=open("孙子兵法.txt","r",encoding='GBK').read() #打开自己想要的文本

words=jieba.lcut(txt)

counts={}

for word in words:

if len(word)==1: #排除单个字符的分词结果

continue

else :

counts[word]=counts.get(word,0)+1

items=list(counts.items())

items.sort(key=lambda x:x[1],reverse=True)

for i in range(20):

word,count=items[i]

print ("{0:<20}{1:>5}".format(word,count))

if __name__ == '__main__':

create_word_cloud('孙子兵法') #运行编辑的函数,获得词云

3.结果与词云效果图

jieba库与词云的使用——以孙子兵法为例的更多相关文章

- 利用jieba库画词云

from wordcloud import WordCloud import matplotlib.pyplot as plt import jieba # 生成词云 def create_word_ ...

- jieba分词wordcloud词云

1.jieba库的基本介绍 (1).jieba是优秀的中文分词第三方库 中文文本需要通过分词获得单个的词语 jieba是优秀的中文分词第三方库,需要额外安装 jieba库提供三种分词模式,最简单只需掌 ...

- python 基于 wordcloud + jieba + matplotlib 生成词云

词云 词云是啥?词云突出一个数据可视化,酷炫.以前以为很复杂,不想python已经有成熟的工具来做词云.而我们要做的就是准备关键词数据,挑一款字体,挑一张模板图片,非常非常无脑.准备好了吗,快跟我一起 ...

- python使用matplotlib画图,jieba分词、词云、selenuium、图片、音频、视频、文字识别、人脸识别

一.使用matplotlib画图 关注公众号"轻松学编程"了解更多. 使用matplotlib画柱形图 import matplotlib from matplotlib impo ...

- Python基于jieba的中文词云

今日学习了python的词云技术 from os import path from wordcloud import WordCloud import matplotlib.pyplot as plt ...

- wordcloud + jieba 生成词云

利用jieba库和wordcloud生成中文词云. jieba库:中文分词第三方库 分词原理: 利用中文词库,确定汉字之间的关联概率,关联概率大的生成词组 三种分词模式: 1.精确模式:把文本精确的切 ...

- python抓取数据构建词云

1.词云图 词云图,也叫文字云,是对文本中出现频率较高的"关键词"予以视觉化的展现,词云图过滤掉大量的低频低质的文本信息,使得浏览者只要一眼扫过文本就可领略文本的主旨. 先看几个词 ...

- 如何运用jieba库分词

使用jieba库分词 一.什么是jieba库 1.jieba库概述 jieba是优秀的中文分词第三方库,中文文本需要通过分词获得单个词语. 2.jieba库的使用:(jieba库支持3种分词模式) 通 ...

- Python之利用jieba库做词频统计且制作词云图

一.环境以及注意事项 1.windows10家庭版 python 3.7.1 2.需要使用到的库 wordcloud(词云),jieba(中文分词库),安装过程不展示 3.注意事项:由于wordclo ...

随机推荐

- IP通信基础学习第四周(下)

选择子网掩码时,不总是使用整个八位作为屏蔽位. 在每个子网中,子网掩码是相同的. 在划分子网的情况下,判断两台主机是不是在同一子网中,需看它们的网络号与子网地址是不是相同的. 变长子网掩码VLSM,无 ...

- left join on +多条件与where区别

left join on +多条件与where区别 重点 先匹配,再筛选where条件. 本文将通过几个例子说明两者的差别. 1. 单个条件 select * from product a left ...

- 【题解】Luogu P5313 僕たちはひとつの光([Ynoi2012]D2T2)

原题传送门 lovelive好评 比赛时只拿到了60pts,还是自己太菜了 这题的思想实际有点像Luogu P3674 小清新人渣的本愿与Luogu P5071 [Ynoi2015]此时此刻的光辉 这 ...

- spring-data-jpa中save不触发数据库insert语句的问题

最近学习spring mvc,用到jpa简化DAO层代码,发现save死活不触发SQL语句,找了好久才解决这个问题,实在是坑.. <!-- 关键是这个bean,一定要设置正确才行 --> ...

- Price Channel Breakout 交易系统简价及源码

Price Channel Breakout 交易系统简价及源码 既然这个版有交易系统的模型报告,小弟先在这裡野人献曝一下,把目前正在用的系统拿来请大家批评指教一下. ================ ...

- Spring 学习——Spring AOP——AOP配置篇Advice(无参数传递)

声明通知Advice 配置方式(以前置通知为例子) 方式一 <aop:config> <aop:aspect id="ikAspectAop" ref=" ...

- windows服务加定时器实现

首先在项目中添加windows服务 然后双击“MainService.cs”,在上面点右键“打开代码” 以下是我的实例代码 partial class MainService : ServiceBas ...

- P4081 [USACO17DEC]Standing Out from the Herd

思路 对所有串建立广义SAM,之后记录SZ,统计本质不同子串时只统计SZ=1的即可 代码 #include <cstdio> #include <algorithm> #inc ...

- myeclipse编码问题

在中文操作系统中,Eclipse中的Java类型文件的编码的默认设置是GBK, 但是对Properties资源文件的编码的默认设置是ISO-8859-1. 所以编辑Java文件中的中文不会出现问题,但 ...

- oracle数据库查看和解除死锁

查看死锁: select sess.sid, sess.serial#, lo.oracle_username, lo.os_user_name, ao.object_name, lo.locked_ ...