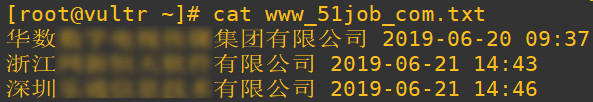

爬虫实现51job谁看过我的简历多条记录功能

默认情况下51job只能看到最近一条记录,查看更多记录需要付费。

本文利用爬虫定时抓取记录,并追加写入到文本的方式获取完整的记录信息。

import requests

from bs4 import BeautifulSoup class www_51job_com(object):

def __init__(self):

self.url = "https://i.51job.com/userset/resume_browsed.php?lang=c" self.headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.102 Safari/537.36"

} self.cookies = "替换你的cookie" def get_url(self,url):

cookies_dict = {}

for i in self.cookies.split("; "):

cookies_dict[i.split("=")[0]] = i.split("=")[1] response = requests.get(url=url,headers=self.headers,cookies=cookies_dict)

return response.content.decode('gbk') def soup(self,data):

soup_data = BeautifulSoup(data,'lxml')

company = soup_data.select("body > div.content > div.exrt > div.lmsg > div.e > div.txt > div.li.l1 > p > a")[0].get_text()

care_time = soup_data.select("body > div.content > div.exrt > div.lmsg > div.e > div.txt > div.li.l3 > div.f12 > span")[0].get_text()

return company +' '+ care_time def save_file(self,company_caretime):

with open('www_51job_com.txt','a+',encoding='utf-8') as f:

f.seek(0)

lines = f.readlines()

try:

if lines[-1] != company_caretime+'\n':

f.write(company_caretime + '\n')

except IndexError:

f.write(company_caretime+'\n') def run(self):

response = self.get_url(self.url)

result = self.soup(response)

self.save_file(result) if __name__ == '__main__':

personal_center = www_51job_com()

personal_center.run()

爬虫实现51job谁看过我的简历多条记录功能的更多相关文章

- 萝卜招聘网 http://www.it9s.com 可以发布免费下载简历求职 ,免费!免费!全部免费!找工作看过来 免费下载简历 !

萝卜招聘网 http://www.it9s.com 可以发布免费下载简历求职 ,免费!免费!全部免费!找工作看过来 免费下载简历 !萝卜招聘网 http://www.it9s.com 可以发布 ...

- 第三百六十九节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)用Django实现搜索功能

第三百六十九节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)用Django实现搜索功能 Django实现搜索功能 1.在Django配置搜索结果页的路由映 ...

- CSDN日报20170328——《你看那个人他像一条狗》

[程序人生]你看那个人他像一条狗 作者:清纯的微笑 今年三十了,到了传说中程序猿最应该迷茫的年龄了,那么我迷茫吗,没的说,依照华为34岁就要劝退的要求,我还有4年的程序生涯. [微信小程序]重磅!个人 ...

- 体验了把做HR的感觉,上午看了40份简历,说说感受

原文链接:http://huachichi.info/2013/06/26/experience-of-being-a-hr/ 这两天准备从IBM离职,不要问我为什么要在这么bug的时间离职,总之 ...

- python爬虫-《笔趣看》网小说《悟空看私聊》

小编是个爱看小说的人,哈哈 # -*- coding:UTF-8 -*- ''' 类说明:下载<笔趣看>网小说<悟空看私聊> ''' from bs4 import Beaut ...

- 【Python3爬虫】网络小说更好看?十四万条书籍信息告诉你

一.前言简述 因为最近微信读书出了网页版,加上自己也在闲暇的时候看了两本书,不禁好奇什么样的书更受欢迎,哪位作者又更受读者喜欢呢?话不多说,爬一下就能有个了解了. 二.页面分析 首先打开微信读书:ht ...

- 看完知乎上500条答案,我为大家整理了这21个B站学习类UP主

原文之前发在我的知乎,转载请注明出处. 虽然,今天算法文章还没更新┏(゜ロ゜;)┛,但还是溜过来跑个题~ 之前看到了博客上有小伙伴在分享自己的B站资源,才突然意识到自己其实也积攒了很多优秀UP的资 ...

- 清空网站浏览记录就行啦?看Python如何实时监控网站浏览记录

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 需求: (1) 获取你对象chrome前一天的浏览记录中的所有网址(url ...

- 打开黑盒:从 MySQL架构设计出发,看它是如何执行一条 SQL语句的

1.把MySQL当个黑盒子一样执行SQL语句 我们的系统采用数据库连接池的方式去并发访问数据库,然后数据库自己其实也会维护一个连接池,其中管理了各种系统跟这台数据库服务器建立的所有连接 当我们的系统只 ...

随机推荐

- php操作kafka

php操作kafka----可以参照网上的安装步骤,先安装ldkafka rdkafka,然乎启动zookeeper和kafka服务器 <?php //$conf = new Rdkafka\P ...

- npm 镜像地址配置

1.查询当前镜像地址 npm get registry 2.修改镜像地址 npm config set registry http://registry.npm.taobao.org/ 原始镜像地址( ...

- P5057 [CQOI2006]简单题 前缀异或差分/树状数组

好思路,好思路... 思路:前缀异或差分 提交:1次 题解:区间修改,单点查询,树状数组,如思路$qwq$ #include<cstdio> #include<iostream> ...

- python 绘制sinx

code import turtle import math turtle.speed() turtle.penup() turtle., * math.sin((-/) * * math.pi)) ...

- html页面之间相互传值

常见的在页面登录过后会获得一个token值然后页面跳转时传给下一个页面 sessionStorage.setItem("token",result.token);//传输token ...

- Mybatis源码学习之资源加载(六)

类加载器简介 Java虚拟机中的类加载器(ClassLoader)负责加载来自文件系统.网络或其他来源的类文件.Java虚拟机中的类加载器默认使用的是双亲委派模式,如图所示,其中有三种默认使用的类加载 ...

- Java基础_枚举类型

作用:让数据更简洁,更易读,增加代码可读性. 为了用1,2,3,4,5分别表示老师,学生,小组,班主任,后勤,可以直接设置一个变量,让roleType = 1,但这样写代码可读性差. 也可以定义一个成 ...

- Windows 10 共享需要网络凭据的问题

如果Windows在资源管理器的网络中双击其他的网络设备,提示要输入网络凭据的解决办法: 打开"网络共享中心" -> "更改高级共享设置"->&qu ...

- 7.RabbitMQ--消息确认机制(confirm)

RabbitMQ--消息确认机制(confirm) Confirm模式 RabbitMQ为了解决生成者不知道消息是否真正到达broker这个问题,采用通过AMQP协议层面为我们提供了事务机制方案,但是 ...

- IntelliJ IDEA-配置文件位置

关于配置文件的位置 一旦开始使用IDEA之后,就需要做很多的配置相关工作,使得IDEA越来越符合你的个人习惯,让你使用起来得心应手.而这些配置信息,都保存在C盘,比如我的就会默认保存在如图所示的位置 ...