吴裕雄 python 爬虫(2)

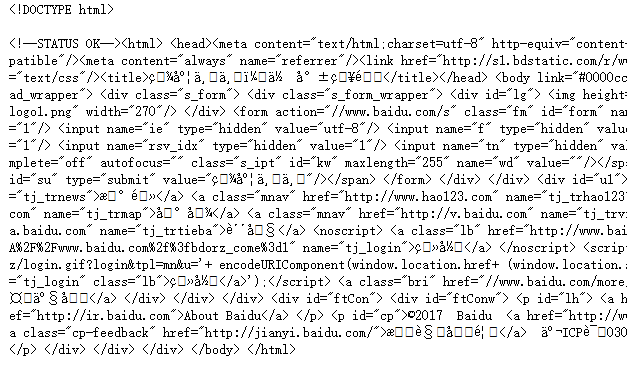

import requests from bs4 import BeautifulSoup url = 'http://www.baidu.com'

html = requests.get(url)

sp = BeautifulSoup(html.text, 'html.parser')

print(sp)

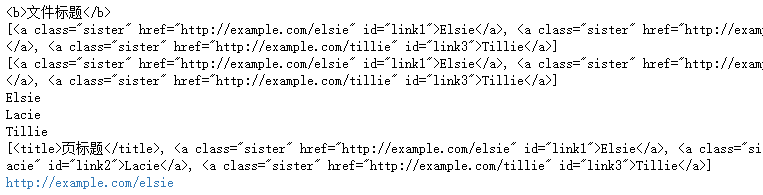

html_doc = """

<html><head><title>页标题</title></head> <p class="title"><b>文件标题</b></p> <p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p> <p class="story">...</p>

""" from bs4 import BeautifulSoup sp = BeautifulSoup(html_doc,'html.parser') print(sp.find('b')) # 返回值:<b>文件标题</b> print(sp.find_all('a')) #返回值: [<b>文件标题</b>] print(sp.find_all("a", {"class":"sister"})) data1=sp.find("a", {"href":"http://example.com/elsie"})

print(data1.text) # 返回值:Elsie data2=sp.find("a", {"id":"link2"})

print(data2.text) # 返回值:Lacie data3 = sp.select("#link3")

print(data3[0].text) # 返回值:Tillie print(sp.find_all(['title','a'])) data1=sp.find("a", {"id":"link1"})

print(data1.get("href")) #返回值: http://example.com/elsie

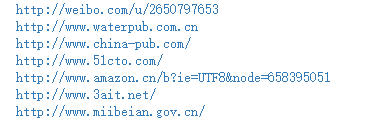

import requests from bs4 import BeautifulSoup url = 'http://www.wsbookshow.com/'

html = requests.get(url)

html.encoding="gbk" sp=BeautifulSoup(html.text,"html.parser")

links=sp.find_all(["a","img"]) # 同时读取 <a> 和 <img>

for link in links:

href=link.get("href") # 读取 href 属性的值

# 判断值是否为非 None,以及是不是以http://开头

if((href != None) and (href.startswith("http://"))):

print(href)

import requests from bs4 import BeautifulSoup url = 'http://www.taiwanlottery.com.tw/'

html = requests.get(url)

sp = BeautifulSoup(html.text, 'html.parser') data1 = sp.select("#rightdown")

print(data1)

data2 = data1[0].find('div', {'class':'contents_box02'})

print(data2)

print()

data3 = data2.find_all('div', {'class':'ball_tx'})

print(data3)

import requests

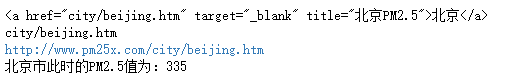

from bs4 import BeautifulSoup url1 = 'http://www.pm25x.com/' #获得主页面链接

html = requests.get(url1) #抓取主页面数据

sp1 = BeautifulSoup(html.text, 'html.parser') #把抓取的数据进行解析 city = sp1.find("a",{"title":"北京PM2.5"}) #从解析结果中找出title属性值为"北京PM2.5"的标签

print(city)

citylink=city.get("href") #从找到的标签中取href属性值

print(citylink)

url2=url1+citylink #生成二级页面完整的链接地址

print(url2) html2=requests.get(url2) #抓取二级页面数据

sp2=BeautifulSoup(html2.text,"html.parser") #二级页面数据解析

#print(sp2)

data1=sp2.select(".aqivalue") #通过类名aqivalue抓取包含北京市pm2.5数值的标签

pm25=data1[0].text #获取标签中的pm2.5数据

print("北京市此时的PM2.5值为:"+pm25) #显示pm2.5值

import requests,os

from bs4 import BeautifulSoup

from urllib.request import urlopen url = 'http://www.tooopen.com/img/87.aspx' html = requests.get(url)

html.encoding="utf-8" sp = BeautifulSoup(html.text, 'html.parser') # 建立images目录保存图片

images_dir="E:\\images\\"

if not os.path.exists(images_dir):

os.mkdir(images_dir) # 取得所有 <a> 和 <img> 标签

all_links=sp.find_all(['a','img'])

for link in all_links:

# 读取 src 和 href 属性内容

src=link.get('src')

href = link.get('href')

attrs=[src,src]

for attr in attrs:

# 读取 .jpg 和 .png 檔

if attr != None and ('.jpg' in attr or '.png' in attr):

# 设置图片文件完整路径

full_path = attr

filename = full_path.split('/')[-1] # 取得图片名

ext = filename.split('.')[-1] #取得扩展名

filename = filename.split('.')[-2] #取得主文件名

if 'jpg' in ext: filename = filename + '.jpg'

else: filename = filename + '.png'

print(attr)

# 保存图片

try:

image = urlopen(full_path)

f = open(os.path.join(images_dir,filename),'wb')

f.write(image.read())

f.close()

except:

print("{} 无法读取!".format(filename))

吴裕雄 python 爬虫(2)的更多相关文章

- 吴裕雄 python 爬虫(4)

import requests user_agent = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, li ...

- 吴裕雄 python 爬虫(3)

import hashlib md5 = hashlib.md5() md5.update(b'Test String') print(md5.hexdigest()) import hashlib ...

- 吴裕雄 python 爬虫(1)

from urllib.parse import urlparse url = 'http://www.pm25x.com/city/beijing.htm' o = urlparse(url) pr ...

- 吴裕雄--python学习笔记:爬虫基础

一.什么是爬虫 爬虫:一段自动抓取互联网信息的程序,从互联网上抓取对于我们有价值的信息. 二.Python爬虫架构 Python 爬虫架构主要由五个部分组成,分别是调度器.URL管理器.网页下载器.网 ...

- 吴裕雄--python学习笔记:爬虫包的更换

python 3.x报错:No module named 'cookielib'或No module named 'urllib2' 1. ModuleNotFoundError: No module ...

- 吴裕雄--python学习笔记:爬虫

import chardet import urllib.request page = urllib.request.urlopen('http://photo.sina.com.cn/') #打开网 ...

- 吴裕雄 python 神经网络——TensorFlow pb文件保存方法

import tensorflow as tf from tensorflow.python.framework import graph_util v1 = tf.Variable(tf.const ...

- 吴裕雄 python 神经网络——TensorFlow 花瓣分类与迁移学习(4)

# -*- coding: utf-8 -*- import glob import os.path import numpy as np import tensorflow as tf from t ...

- 吴裕雄 python 神经网络——TensorFlow 花瓣分类与迁移学习(3)

import glob import os.path import numpy as np import tensorflow as tf from tensorflow.python.platfor ...

随机推荐

- Java - 30 Java 网络编程

Java 网络编程 网络编程是指编写运行在多个设备(计算机)的程序,这些设备都通过网络连接起来. java.net包中J2SE的API包含有类和接口,它们提供低层次的通信细节.你可以直接使用这些类和接 ...

- Cache: a place for concealment and safekeeping.Cache: 一个隐藏并保存数据的场所

原文标题:Cache: a place for concealment and safekeeping 原文地址:http://duartes.org/gustavo/blog/ [注:本人水平有限, ...

- JVM总结-Java 虚拟机是怎么识别目标方法(下)

1. 虚方法调用 在上一篇中我曾经提到,Java 里所有非私有实例方法调用都会被编译成 invokevirtual 指令,而接口方法调用都会被编译成 invokeinterface 指令.这两种指令, ...

- JVM总结-虚拟机怎么执行字节码

1. JRE,JDK JRE : 包含运行 Java 程序的必需组件,Java 虚拟机+ Java 核心类库等. JDK : JRE + 一系列开发.诊断工具. 2. java字节码 编译器将 Ja ...

- [Unity算法]弧度和角度

参考链接: https://zhidao.baidu.com/question/576596182.html 1.弧度和角度的转换 2.sin函数 3.cos函数 4.tan函数 5.特殊的三角函数值 ...

- 500 OOPS: could not read chroot() list file:/etc/vsftpd/chroot_list

出错原因:用户没有变更根目录的权限. ftp用户默认的根目录是/home/ftp,如果要切换登陆目录,需要给予权限 解决方法: 第一步, 打开/etc/vsftpd/vsftpd.conf,做如下配置 ...

- spring mvc 异常处理

一般实现业务的时候避免不了会抛一些自定义异常 抛给controller进行最终处理.如果业务上比较复杂.频繁的在try catch操作. 时间一长,代码维护性,可读性自然而然就上来了. 然后,spri ...

- Ruby学习笔记2 : 一个简单的Ruby网站,搭建ruby环境

Ruby on Rails website 的基础是 请求-返回 循环. 首先是浏览器请求服务器, 第二步,Second, in our Rails application, the route ta ...

- JAVA 中文 unicode 相互转换 文件读取

package com.test; import org.junit.Test; public class JunitTest { @Test public void test(){ String p ...

- 使用uni-app开发微信小程序之登录模块

从微信小程序官方发布的公告中我们可获知:小程序体验版.开发版调用 wx.getUserInfo 接口,将无法弹出授权询问框,默认调用失败,需使用 <button open-type=" ...