做双网卡绑定_______物理机在双网卡的情况下做多IP绑定

公司的环境是这样的:

一台物理机需要做双网卡绑定,同时呢,在双网卡绑定的同时还要做多IP。

其实整个过程可以分为两个步骤:

第一个,物理机先做双网卡。

第二个,在bond上做多IP实例。

双网卡绑定的做法:

1 什么是bond

网卡bond是通过多张网卡绑定为一个逻辑网卡,实现本地网卡的冗余,带宽扩容和负载均衡,在生产场景中是一种常用的技术。Kernels 2.4.12及以后的版本均供bonding模块,以前的版本可以通过patch实现。可以通过以下命令确定内核是否支持 bonding:

|

1

2

3

|

[root@lixin network-scripts]#cat /boot/config-2.6.32-573.el6.x86_64 |grep -i bondingCONFIG_BONDING=m[root@lixin network-scripts]# |

2 bond的模式

bond的模式常用的有两种:

mode=0(balance-rr)

表示负载分担round-robin,并且是轮询的方式比如第一个包走eth0,第二个包走eth1,直到数据包发送完毕。

优点:流量提高一倍

缺点:需要接入交换机做端口聚合,否则可能无法使用

mode=1(active-backup)

表示主备模式,即同时只有1块网卡在工作。

优点:冗余性高

缺点:链路利用率低,两块网卡只有1块在工作

bond其他模式:

mode=2(balance-xor)(平衡策略)

表示XOR Hash负载分担,和交换机的聚合强制不协商方式配合。(需要xmit_hash_policy,需要交换机配置port channel)

特点:基于指定的传输HASH策略传输数据包。缺省的策略是:(源MAC地址 XOR 目标MAC地址) % slave数量。其他的传输策略可以通过xmit_hash_policy选项指定,此模式提供负载平衡和容错能力

mode=3(broadcast)(广播策略)

表示所有包从所有网络接口发出,这个不均衡,只有冗余机制,但过于浪费资源。此模式适用于金融行业,因为他们需要高可靠性的网络,不允许出现任何问题。需要和交换机的聚合强制不协商方式配合。

特点:在每个slave接口上传输每个数据包,此模式提供了容错能力

mode=4(802.3ad)(IEEE 802.3ad 动态链接聚合)

表示支持802.3ad协议,和交换机的聚合LACP方式配合(需要xmit_hash_policy).标准要求所有设备在聚合操作时,要在同样的速率和双工模式,而且,和除了balance-rr模式外的其它bonding负载均衡模式一样,任何连接都不能使用多于一个接口的带宽。

特点:创建一个聚合组,它们共享同样的速率和双工设定。根据802.3ad规范将多个slave工作在同一个激活的聚合体下。外出流量的slave选举是基于传输hash策略,该策略可以通过xmit_hash_policy选项从缺省的XOR策略改变到其他策略。需要注意的是,并不是所有的传输策略都是802.3ad适应的,尤其考虑到在802.3ad标准43.2.4章节提及的包乱序问题。不同的实现可能会有不同的适应性。

必要条件:

条件1:ethtool支持获取每个slave的速率和双工设定

条件2:switch(交换机)支持IEEE802.3ad Dynamic link aggregation

条件3:大多数switch(交换机)需要经过特定配置才能支持802.3ad模式

mode=5(balance-tlb)(适配器传输负载均衡)

是根据每个slave的负载情况选择slave进行发送,接收时使用当前轮到的slave。该模式要求slave接口的网络设备驱动有某种ethtool支持;而且ARP监控不可用。

特点:不需要任何特别的switch(交换机)支持的通道bonding。在每个slave上根据当前的负载(根据速度计算)分配外出流量。如果正在接受数据的slave出故障了,另一个slave接管失败的slave的MAC地址。

必要条件:

ethtool支持获取每个slave的速率

mode=6(balance-alb)(适配器适应性负载均衡)

在5的tlb基础上增加了rlb(接收负载均衡receiveload balance).不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的.

特点:该模式包含了balance-tlb模式,同时加上针对IPV4流量的接收负载均衡(receiveload balance, rlb),而且不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的。bonding驱动截获本机发送的ARP应答,并把源硬件地址改写为bond中某个slave的唯一硬件地址,从而使得不同的对端使用不同的硬件地址进行通信。来自服务器端的接收流量也会被均衡。当本机发送ARP请求时,bonding驱动把对端的IP信息从ARP包中复制并保存下来。当ARP应答从对端到达时,bonding驱动把它的硬件地址提取出来,并发起一个ARP应答给bond中的某个slave。使用ARP协商进行负载均衡的一个问题是:每次广播 ARP请求时都会使用bond的硬件地址,因此对端学习到这个硬件地址后,接收流量将会全部流向当前的slave。这个问题可以通过给所有的对端发送更新(ARP应答)来解决,应答中包含他们独一无二的硬件地址,从而导致流量重新分布。当新的slave加入到bond中时,或者某个未激活的slave重新激活时,接收流量也要重新分布。接收的负载被顺序地分布(round robin)在bond中最高速的slave上当某个链路被重新接上,或者一个新的slave加入到bond中,接收流量在所有当前激活的slave中全部重新分配,通过使用指定的MAC地址给每个 client发起ARP应答。下面介绍的updelay参数必须被设置为某个大于等于switch(交换机)转发延时的值,从而保证发往对端的ARP应答不会被switch(交换机)阻截。

bond模式小结:

mode5和mode6不需要交换机端的设置,网卡能自动聚合。mode4需要支持802.3ad。mode0,mode2和mode3理论上需要静态聚合方式。

3 配置bond

测试环境:

|

1

2

3

4

5

|

[root@lixin ~]# cat/etc/redhat-releaseCentOS release 6.7 (Final)[root@lixin ~]# uname -r2.6.32-573.el6.x86_64[root@lixin~]# |

1、配置物理网卡

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

[root@lixin network-scripts]#cat ifcfg-eth0 DEVICE=eth0TYPE=EthernetONBOOT=yesBOOTPROTO=noneMASTER=bond0SLAVE=yes //可以没有此字段,就需要开机执行ifenslave bond0 eth0 eth1命令了。[root@lixin network-scripts]#[root@lixin network-scripts]#cat ifcfg-eth1 DEVICE=eth1TYPE=EthernetONBOOT=yesBOOTPROTO=noneMASTER=bond0SLAVE=yes [root@lixin network-scripts]# |

2、配置逻辑网卡bond0

|

1

2

3

4

5

6

7

8

9

10

11

|

[root@lixin network-scripts]#cat ifcfg-bond0 //需要我们手工创建DEVICE=bond0TYPE=EthernetONBOOT=yesBOOTPROTO=staticIPADDR=10.0.0.10NETMASK=255.255.255.0DNS2=4.4.4.4GATEWAY=10.0.0.2DNS1=10.0.0.2[root@lixin network-scripts]# |

由于没有这个配置文件我们可以使用拷贝一个ifcfg-eth1来用:cp ifcfg-{eth0,bond1}

3、加载模块,让系统支持bonding

|

1

2

3

4

|

[root@lixin ~]# cat/etc/modprobe.conf //不存在的话,手动创建(也可以放在modprobe.d下面)alias bond0 bondingoptions bond0 miimon=100 mode=0[root@lixin ~]# |

配置bond0的链路检查时间为100ms,模式为0。

注意:

linux网卡bonging的备份模式实验在真实机器上做完全没问题(前提是linux内核支持),但是在vmware workstation虚拟中做就会出现如下图问题。

配置完成后出现如上图问题,但是bond0能够正常启动也能够正常使用,只不过没有起到备份模式的效果。当使用ifdown eth0后,网络出现不通现象。

内核文档中有说明:bond0获取mac地址有两种方式,一种是从第一个活跃网卡中获取mac地址,然后其余的SLAVE网卡的mac地址都使用该mac地址;另一种是使用fail_over_mac参数,是bond0使用当前活跃网卡的mac地址,mac地址或者活跃网卡的转换而变。

既然vmware workstation不支持第一种获取mac地址的方式,那么可以使用fail_over_mac=1参数,所以这里我们添加fail_over_mac=1参数

|

1

2

3

4

|

[root@lixin etc]# cat/etc/modprobe.d/modprobe.confalias bond0 bondingoptions bond0 miimon=100 mode=0fail_over_mac=1[root@lixin etc]# |

4、加载bond module

|

1

|

[root@lixin etc]# modprobe bonding |

5、查看绑定结果

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

[root@lixin etc]# cat/proc/net/bonding/bond0Ethernet Channel BondingDriver: v3.7.1 (April 27, 2011) Bonding Mode: load balancing(round-robin)MII Status: upMII Polling Interval (ms): 100Up Delay (ms): 0Down Delay (ms): 0 Slave Interface: eth0MII Status: upSpeed: 1000 MbpsDuplex: fullLink Failure Count: 0Permanent HW addr:00:50:56:28:7f:51Slave queue ID: 0 Slave Interface: eth1MII Status: upSpeed: 1000 MbpsDuplex: fullLink Failure Count: 0Permanent HW addr:00:50:56:29:9b:daSlave queue ID: 0[root@lixin etc]# |

4 测试bond

由于使用的是mode=0,负载均衡的方式,这时我们ping百度,然后断开一个网卡,此时ping不会中断。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

|

[root@lixin etc]# pingbaidu.comPING baidu.com (111.13.101.208)56(84) bytes of data.64 bytes from 111.13.101.208:icmp_seq=1 ttl=128 time=10.6 ms64 bytes from 111.13.101.208:icmp_seq=2 ttl=128 time=9.05 ms64 bytes from 111.13.101.208:icmp_seq=3 ttl=128 time=11.7 ms64 bytes from 111.13.101.208:icmp_seq=4 ttl=128 time=7.93 ms64 bytes from 111.13.101.208:icmp_seq=5 ttl=128 time=9.50 ms64 bytes from 111.13.101.208:icmp_seq=6 ttl=128 time=7.17 ms64 bytes from 111.13.101.208:icmp_seq=7 ttl=128 time=21.2 ms64 bytes from 111.13.101.208:icmp_seq=8 ttl=128 time=7.46 ms64 bytes from 111.13.101.208:icmp_seq=9 ttl=128 time=7.82 ms64 bytes from 111.13.101.208:icmp_seq=10 ttl=128 time=8.15 ms64 bytes from 111.13.101.208:icmp_seq=11 ttl=128 time=6.89 ms64 bytes from 111.13.101.208: icmp_seq=12ttl=128 time=8.33 ms64 bytes from 111.13.101.208:icmp_seq=13 ttl=128 time=8.65 ms64 bytes from 111.13.101.208:icmp_seq=14 ttl=128 time=7.16 ms64 bytes from 111.13.101.208:icmp_seq=15 ttl=128 time=9.31 ms64 bytes from 111.13.101.208:icmp_seq=16 ttl=128 time=10.5 ms64 bytes from 111.13.101.208:icmp_seq=17 ttl=128 time=7.61 ms64 bytes from 111.13.101.208:icmp_seq=18 ttl=128 time=10.2 ms^C--- baidu.com ping statistics---18 packets transmitted, 18received, 0% packet loss, time 17443msrtt min/avg/max/mdev = 6.899/9.417/21.254/3.170 ms//用另一个终端手动关闭eth0网卡,ping并没有中断[root@lixin etc]# !cacat /proc/net/bonding/bond0Ethernet Channel BondingDriver: v3.7.1 (April 27, 2011) Bonding Mode: load balancing(round-robin)MII Status: upMII Polling Interval (ms): 100Up Delay (ms): 0Down Delay (ms): 0 Slave Interface: eth0MII Status: downSpeed: UnknownDuplex: UnknownLink Failure Count: 1Permanent HW addr:00:50:56:28:7f:51Slave queue ID: 0 Slave Interface: eth1MII Status: upSpeed: 1000 MbpsDuplex: fullLink Failure Count: 0Permanent HW addr:00:50:56:29:9b:daSlave queue ID: 0[root@lixin etc]# |

//查看bond0状态,发现eth0,down了,但是bond正常

在bond上绑定多IP:

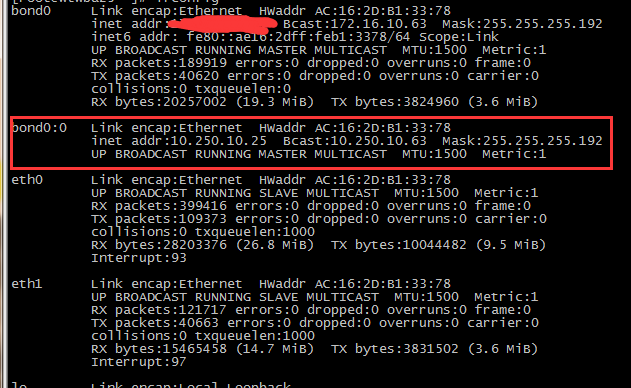

首先我们要确定bond是正常起来的,查看ifconfig:

比如说我绑定的是eth0和eth1,上面bond0正常显示IP。如果我需要开一个新的IP的话,我需要将bond0上开一个子网卡,叫做bond0:0。

配置文件放在/etc/sysconfig/network-scripts(这个文件需要自己新建,可以讲bond0的配置文件拷贝过来,改名)

如果你需要写路由的配置,在这个下面加上一个route-bond0:0的配置文件,路由配置正常书写即可生效。

做双网卡绑定_______物理机在双网卡的情况下做多IP绑定的更多相关文章

- 不使用jquery情况下循环添加绑定事件方法

<!DOCTYPE html> <html> <head> <meta charset="UTF-8"> <title> ...

- 如果让你来做HashMap扩容,如何实现在不影响读写的情况下扩容?

我觉得逼格高,不是体现在问题多刁钻,知识点多深,而是一个非常明确,无歧义的问题,能考察出面试者多方面的能力.这个问题背后:1.了解java中,HashMap的实现:如果一个面试者了解这一点,说明至少他 ...

- 如何配置 Oracle VirtualBox 中的客户机与物理机网络

当你在 Oracle VirtualBox 虚拟机软件 中安装了各种操作系统时,你可能需要实现物理机与虚拟机之间的相互访问. 在这篇文章中,我们将会以最简单明了的方式来说明如何配置客户机与 Linux ...

- 如何配置nginx负载均衡配置(轮询,权重,ip绑定)

集群是为了解决单节点无法服务高并发的情况,在集群中nginx是如何分配将来自客户端的请求 转发给服务器的 负载均衡可以提高网站的吞吐量(接受和响应),减轻单台服务器的压力 负载均衡提供了三种策略:轮询 ...

- linux中配置双网卡的目的?如何实现双网卡绑定,以实现负载均衡?

配置双网卡的目的:========================== 1.你想做路由器,网关 2.实现冗余 3.负载均衡 linux 主机安装双网卡,共享一个IP地址,对外提供访问,实际 同 ...

- 真实的物理机安装Centos7系统后网卡只有lo没有eno1的解决办法:实际上是物理机未安装网驱动卡

问题症状: 我真实的物理机安装Centos7系统后,在/etc/sysconfig/目录下查看,发现网卡只有lo没有eno1,出现该问题的实际原因是物理机未安装网驱动卡. 解决办法: 不多说了,让我们 ...

- 关于物理机没有VMnet1和VMnet8网卡的问题

当我们在用虚拟机做实验需要与物理机进行连接时,发现无法连接上,这时候可能是没有Vmnet1或者Vmnet8网卡,又或者是Vmnet1和Vmnet8网卡都没有. 之前试过很多方法,重装.重启虚拟网络编辑 ...

- virtualbox 在物理机是无线网卡的时候做桥接配置

在“计算机”图标上右键选择“管理”,在打开的“计算机管理”窗口中选择左侧的“设备管理器”,然后在右侧图示的地方右键选择“添加过时硬件”. 在打开的窗口中点击“下一步”. 选择“安装我手动从列表中选择的 ...

- vsphere的P2V工具做的物理机迁移到虚拟机报错out of memory

vsphere的P2V工具做的物理机迁移到虚拟机 迁移成功,但是启动报错 进入rescue模式后发现是sysctl.conf文件的参数设大了因为虚拟机的内存没有物理机内存大 kernel.shm ...

随机推荐

- HMAC

Hash-based Message Authentication Code HMAC是IP安全里必须实现的MAC方案,并且其他Internet协议中(如SSL)也使用了HMAC.HMAC已作为NIS ...

- How to Use Kdiff3 as a 3-way Merge Tool With Mercurial, Git, and Tower.app

How to Use Kdiff3 as a 3-way Merge Tool With Mercurial, Git, and Tower.app Jan 12th, 2012 ...

- 快速高分辨率图像的立体匹配方法Effective large scale stereo matching

<Effective large scale stereo matching> In this paper we propose a novel approach to binocular ...

- [GitHub]第一讲:浏览器中使用GitHub

文章转载自http://blog.csdn.net/loadsong/article/details/51591407 看到一篇关于GitHub的文章,感觉不错,因此转载来以备推敲学习. 不会用 Gi ...

- Intent的Data和Type和Flag属性-amdroid学习之旅(五十一)

Data属性介绍 使用Data和Action属性启动系统Activity 代码示例 public class MainActivity extends Activity{ @Override prot ...

- web多语言url的设计

因为项目要支持国际化,最近跟一个同事在讨论多语言版本下面url如何设计,假如我们需要支持en和cn的版本. 他倾向于支持如下的url格式,后续以格式1指代: /en/group/abc.html /c ...

- android studio签名

1.Build -> Generate Signed APK...,打开如下窗口 2.假设这里没有打过apk包,点击Create new,窗口如下 这里只要输入几个必要项 Key store p ...

- Linux下触摸屏驱动程序分析

[摘要: 本文以linux3.5--Exynos4412仄台,剖析触摸屏驱动焦点内容.Linux下触摸屏驱动(以ft5x06_ts为例)须要懂得以下学问: 1. I2C协定 2. Exynos4412 ...

- 控件的基本使用-iOS—UI笔记

学习目标 1.[掌握]第一个UI项目 2.[掌握]控件连线 3.[掌握]按钮的基本操作 4.[掌握]控件的常用属性 一.第一个UI项目 UI (User Interface)也是就用户界面,是App的 ...

- 关于iOS socket的讲解介绍

socket(套接字)是通信的基石,是支持TCP/IP协议的网络通信的基本操作单元,包含进行网络通信必须的五种信息:连接使用的协议,本地主机的IP地址,本地进程的协议端口,远地主机的IP地址,远地进程 ...