045 RDD与DataFrame互相转换

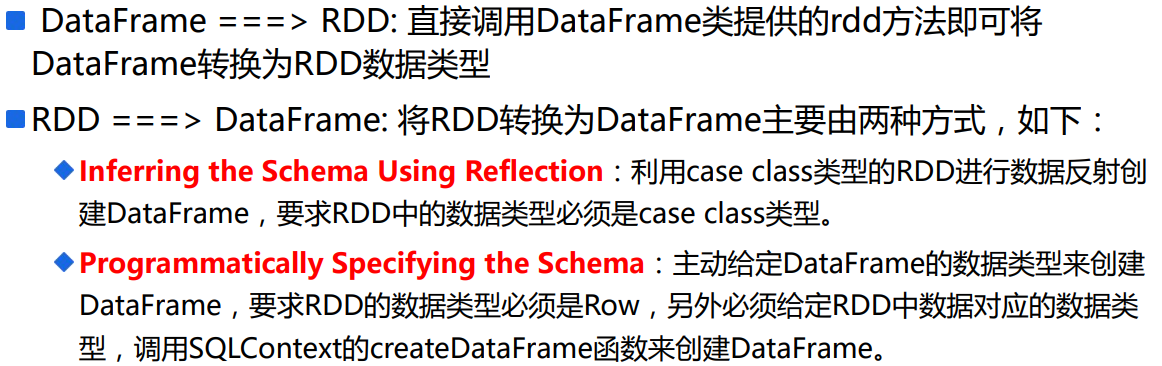

一:RDD与DataFrame互相转换

1.总纲

二:DataFrame转换为RDD

1.rdd

使用schema可以获取DataFrame的schema

使用rdd可以获取DataFrame的数据

三:RDD转换为DataFrame

1.第一种方式

使用反射,

RDD的数据类型必须是case class。

import sqlContext.implicits._ //如果不写,下面的转换不成功

//transform

val path="/spark/logs/input"

val rdd=sc.textFile(path)

val apacheAccessDataFrame=rdd

.filter(line=>ApacheAccessLog.isValidateLogLine(line))

.map(line => {

ApacheAccessLog.parseLogLine(line)

}).toDF() //rdd转换为DataFrame

其中,ApacheAccessLog.parseLogLine(line)是case class类型。

2:第二种方式

package com.scala.it

import org.apache.spark.rdd.RDD

import org.apache.spark.sql.types._

import org.apache.spark.sql.{Row, SQLContext}

import org.apache.spark.{SparkConf, SparkContext}

object CreateDataFrameDemo {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

.setMaster("local[*]")

.setAppName("hive-join-mysql")

// 使用kryo序列化机制

conf.registerKryoClasses(Array(classOf[Row], classOf[Tuple3[Int, String, Double]]))

val sc = SparkContext.getOrCreate(conf) val sqlContext = new SQLContext(sc) // ===================================

// RDD中Row中的各个列的类型必须是一致的(不能有歧义)

val rdd: RDD[Row] = sc.parallelize(Array(

(1, "Tom", 1234.1),

(2, "Lili", 12532.2),

(3, "Gerry", 123.0)

)).map {

case (id, name, salary) => {

Row(id, name, salary)

}

}

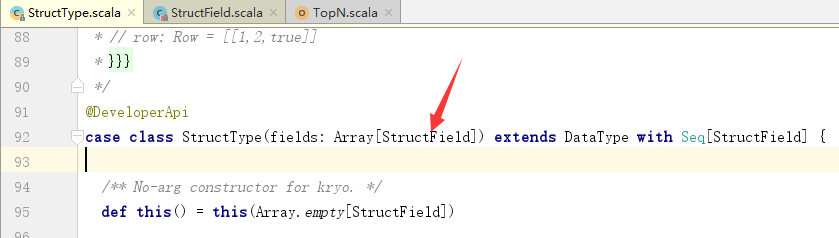

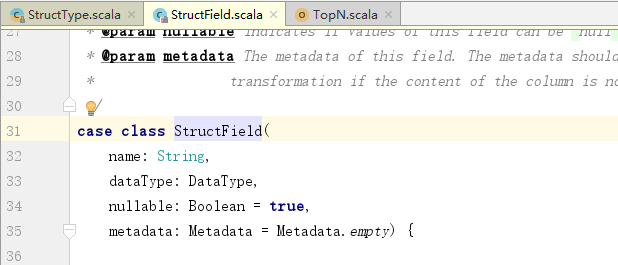

val schema: StructType = StructType(Array(

StructField("id", IntegerType),

StructField("name", StringType),

StructField("salary", DoubleType)

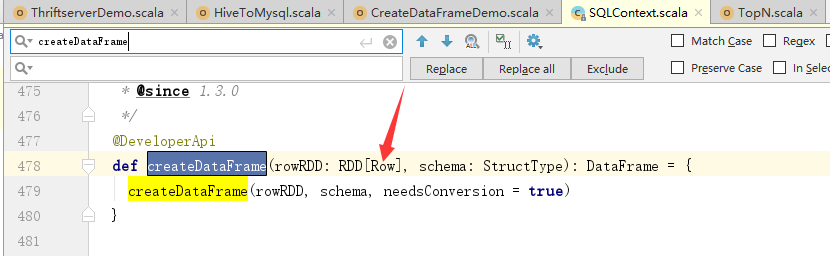

)) val df = sqlContext.createDataFrame(rdd, schema)

df.show()

}

}

3.解释上面的程序

产生RDD有两种方式,读取数据源,或者序列化

这里使用序列化产生RDD。

-----------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

关于rdd中为什么要使用Row:

------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

关于StructType:

-------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

关于StructField:

其中,后两个是默认参数,可以不给。

045 RDD与DataFrame互相转换的更多相关文章

- RDD与DataFrame的转换

RDD与DataFrame转换1. 通过反射的方式来推断RDD元素中的元数据.因为RDD本身一条数据本身是没有元数据的,例如Person,而Person有name,id等,而record是不知道这些的 ...

- 转】RDD与DataFrame的转换

原博文出自于: http://www.cnblogs.com/namhwik/p/5967910.html RDD与DataFrame转换1. 通过反射的方式来推断RDD元素中的元数据.因为RDD本身 ...

- RDD&Dataset&DataFrame

Dataset创建 object DatasetCreation { def main(args: Array[String]): Unit = { val spark = SparkSession ...

- 36、将RDD转换为DataFrame

一.概述 为什么要将RDD转换为DataFrame? 因为这样的话,我们就可以直接针对HDFS等任何可以构建为RDD的数据,使用Spark SQL进行SQL查询了.这个功能是无比强大的. 想象一下,针 ...

- spark-DataFrame之RDD和DataFrame之间的转换

package cn.spark.study.core.mycode_dataFrame; import java.io.Serializable;import java.util.List; imp ...

- RDD、DataFrame、Dataset三者三者之间转换

转化: RDD.DataFrame.Dataset三者有许多共性,有各自适用的场景常常需要在三者之间转换 DataFrame/Dataset转RDD: 这个转换很简单 val rdd1=testDF. ...

- RDD、DataFrame和DataSet的区别

原文链接:http://www.jianshu.com/p/c0181667daa0 RDD.DataFrame和DataSet是容易产生混淆的概念,必须对其相互之间对比,才可以知道其中异同. RDD ...

- 谈谈RDD、DataFrame、Dataset的区别和各自的优势

在spark中,RDD.DataFrame.Dataset是最常用的数据类型,本博文给出笔者在使用的过程中体会到的区别和各自的优势 共性: 1.RDD.DataFrame.Dataset全都是spar ...

- spark RDD,DataFrame,DataSet 介绍

弹性分布式数据集(Resilient Distributed Dataset,RDD) RDD是Spark一开始就提供的主要API,从根本上来说,一个RDD就是你的数据的一个不可变的分布式元素集合,在 ...

随机推荐

- 关于socket.io获取客户端真实IP地址

1 前言 由于使用了CDN加速,导致了socket.handshake.address拿到值都是服务器的,而没有使用CDN加速时,可以拿到客户端真实IP. 2 代码 if(socket.handsha ...

- 查看ubuntu版本信息

参考文章:https://blog.csdn.net/qq_27818541/article/details/75207986 版本信息lsb_release -a No LSB modules ar ...

- Confluence 6 配置站点主页面

主面板(dashboard)是你站点的默认主页,但是你也可以选择使用一个空间的主页为网站访问的首页面. 针对你的 Confluence 站点主要是为用户进行阅读而不是创建内容的话,这样的配置就显得非 ...

- 基于 Confluence 6 数据中心的 SAML 单点登录设置你的身份提供者

如果你希望 Confluence 提供 SSO,将需要将 Confluence 添加到你的 IdP 中.一些后续的步骤将会与你的 IdP 有关,但是你通常需要: 在你的 IdP 中定义一个 'appl ...

- vue阿里上传图片报400错误

首先我用vue上传阿里图片用的是分片上传,分片上传由于一片是以100kb为起始的,所以当图片大小小于100kb的时候不分片,可以正常上传,当大于100kb的时候,会报400错误如下 One or mo ...

- 用flask的扩展实现的简单的页面登录

from flask import Flask,render_template,request,redirect,session app = Flask(__name__,template_folde ...

- LeetCode(118):杨辉三角

Easy! 题目描述: 给定一个非负整数 numRows,生成杨辉三角的前 numRows 行. 在杨辉三角中,每个数是它左上方和右上方的数的和. 示例: 输入: 5 输出: [ [1], [1,1] ...

- bzoj 1076

发现自己已经把期望dp忘光了... 其实本质上非常简单,就是利用状压的思想跑期望 首先很容易设计出状态:记状态f[s][i]表示到了第i个点,之前已选过的点的状态为s时所能获得的最大期望得分 但是会发 ...

- Python中的xxx+=xxx和xxx=xxx+xxx一些区别及执行过程

预知小知识: Python中的变量与其他语言稍有差异,如a = 10并不是直接在内存中创建一个变量a其值为10,而是在内存中创建一个a这个a指向这个10,在Python中所有牵扯到等号的均不是值赋值, ...

- binlog2sql之MySQL数据闪回实践

DBA或开发人员,有时会误删或者误更新数据,如果是线上环境并且影响较大,就需要能快速回滚.传统恢复方法是利用备份重搭实例,再应用去除错误sql后的binlog来恢复数据.此法费时费力,甚至需要停机维护 ...