Lucene系列四:Lucene提供的分词器、IKAnalyze中文分词器集成、扩展 IKAnalyzer的停用词和新词

一、Lucene提供的分词器StandardAnalyzer和SmartChineseAnalyzer

1.新建一个测试Lucene提供的分词器的maven项目LuceneAnalyzer

2. 在pom.xml里面引入如下依赖

<!-- lucene 核心模块 -->

<dependency>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-core</artifactId>

<version>7.3.0</version>

</dependency> <!-- Lucene提供的中文分词器模块,lucene-analyzers-smartcn:Lucene 的中文分词器 SmartChineseAnalyzer -->

<dependency>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-analyzers-smartcn</artifactId>

<version>7.3.0</version>

</dependency>

3. 新建一个标准分词器StandardAnalyzer的测试类LuceneStandardAnalyzerTest

package com.luceneanalyzer.use.standardanalyzer; import java.io.IOException; import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.standard.StandardAnalyzer;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute; /**

* Lucene core模块中的 StandardAnalyzer英文分词器使用

* 英文分词效果好,中文分词效果不好

* @author THINKPAD

*

*/

public class LuceneStandardAnalyzerTest { private static void doToken(TokenStream ts) throws IOException {

ts.reset();

CharTermAttribute cta = ts.getAttribute(CharTermAttribute.class);

while (ts.incrementToken()) {

System.out.print(cta.toString() + "|");

}

System.out.println();

ts.end();

ts.close();

} public static void main(String[] args) throws IOException {

String etext = "Analysis is one of the main causes of slow indexing. Simply put, the more you analyze the slower analyze the indexing (in most cases).";

String chineseText = "张三说的确实在理。";

// Lucene core模块中的 StandardAnalyzer 英文分词器

try (Analyzer ana = new StandardAnalyzer();) {

TokenStream ts = ana.tokenStream("coent", etext);

System.out.println("标准分词器,英文分词效果:");

doToken(ts);

ts = ana.tokenStream("content", chineseText);

System.out.println("标准分词器,中文分词效果:");

doToken(ts);

} catch (IOException e) { } }

}

运行效果:

标准分词器,英文分词效果:

analysis|one|main|causes|slow|indexing|simply|put|more|you|analyze|slower|analyze|indexing|most|cases|

标准分词器,中文分词效果:

张|三|说|的|确|实|在|理|

4. 新建一个Lucene提供的中文分词器SmartChineseAnalyzer的测试类

package com.luceneanalyzer.use.smartchineseanalyzer; import java.io.IOException; import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.cn.smart.SmartChineseAnalyzer;

import org.apache.lucene.analysis.standard.StandardAnalyzer;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute; /**

* Lucene提供的中文分词器模块,lucene-analyzers-smartcn:Lucene 的中文分词器 SmartChineseAnalyzer

* 中英文分词效果都不好

*

* @author THINKPAD

*

*/

public class LuceneSmartChineseAnalyzerTest { private static void doToken(TokenStream ts) throws IOException {

ts.reset();

CharTermAttribute cta = ts.getAttribute(CharTermAttribute.class);

while (ts.incrementToken()) {

System.out.print(cta.toString() + "|");

}

System.out.println();

ts.end();

ts.close();

} public static void main(String[] args) throws IOException {

String etext = "Analysis is one of the main causes of slow indexing. Simply put, the more you analyze the slower analyze the indexing (in most cases).";

String chineseText = "张三说的确实在理。";

// Lucene 的中文分词器 SmartChineseAnalyzer

try (Analyzer smart = new SmartChineseAnalyzer()) {

TokenStream ts = smart.tokenStream("content", etext);

System.out.println("smart中文分词器,英文分词效果:");

doToken(ts);

ts = smart.tokenStream("content", chineseText);

System.out.println("smart中文分词器,中文分词效果:");

doToken(ts);

} }

}

运行效果:

smart中文分词器,英文分词效果:

analysi|is|on|of|the|main|caus|of|slow|index|simpli|put|the|more|you|analyz|the|slower|analyz|the|index|in|most|case|

smart中文分词器,中文分词效果:

张|三|说|的|确实|在|理|

二、IKAnalyze中文分词器集成

IKAnalyzer是开源、轻量级的中文分词器,应用比较多

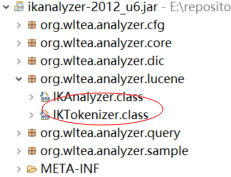

最先是作为lucene上使用而开发,后来发展为独立的分词组件。只提供到Lucene 4.0版本的支持。我们在4.0以后版本Lucene中使用就需要简单集成一下。

需要做集成,是因为Analyzer的createComponents方法API改变了

IKAnalyzer提供两种分词模式:细粒度分词和智能分词

集成步骤

1、找到 IkAnalyzer包体提供的Lucene支持类,比较IKAnalyzer的createComponets方法。

4.0及之前版本的createComponets方法:

@Override

protected TokenStreamComponents createComponents(String fieldName, final Reader in) {

Tokenizer _IKTokenizer = new IKTokenizer(in, this.useSmart());

return new TokenStreamComponents(_IKTokenizer);

}

最新的createComponets方法:

protected abstract TokenStreamComponents createComponents(String fieldName);

2、照这两个类,创建新版本的, 类里面的代码直接复制,修改参数即可。

下面开始集成:

1.新建一个maven项目IkanalyzerIntegrated

2. 在pom.xml里面引入如下依赖

<!-- lucene 核心模块 -->

<dependency>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-core</artifactId>

<version>7.3.0</version>

</dependency> <!-- ikanalyzer 中文分词器 -->

<dependency>

<groupId>com.janeluo</groupId>

<artifactId>ikanalyzer</artifactId>

<version>2012_u6</version>

<!--排除掉里面旧的lucene包,因为我们要重写里面的分析器和分词器 -->

<exclusions>

<exclusion>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-core</artifactId>

</exclusion>

<exclusion>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-queryparser</artifactId>

</exclusion>

<exclusion>

<groupId>org.apache.lucene</groupId>

<artifactId>lucene-analyzers-common</artifactId>

</exclusion>

</exclusions>

</dependency>

3. 重写分析器

package com.study.lucene.ikanalyzer.Integrated; import org.apache.lucene.analysis.Analyzer; /**

* 因为Analyzer的createComponents方法API改变了需要重新实现分析器

* @author THINKPAD

*

*/

public class IKAnalyzer4Lucene7 extends Analyzer { private boolean useSmart = false; public IKAnalyzer4Lucene7() {

this(false);

} public IKAnalyzer4Lucene7(boolean useSmart) {

super();

this.useSmart = useSmart;

} public boolean isUseSmart() {

return useSmart;

} public void setUseSmart(boolean useSmart) {

this.useSmart = useSmart;

} @Override

protected TokenStreamComponents createComponents(String fieldName) {

IKTokenizer4Lucene7 tk = new IKTokenizer4Lucene7(this.useSmart);

return new TokenStreamComponents(tk);

} }

4. 重写分词器

package com.study.lucene.ikanalyzer.Integrated; import java.io.IOException; import org.apache.lucene.analysis.Tokenizer;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute;

import org.apache.lucene.analysis.tokenattributes.OffsetAttribute;

import org.apache.lucene.analysis.tokenattributes.TypeAttribute;

import org.wltea.analyzer.core.IKSegmenter;

import org.wltea.analyzer.core.Lexeme; /**

* 因为Analyzer的createComponents方法API改变了需要重新实现分词器

* @author THINKPAD

*

*/

public class IKTokenizer4Lucene7 extends Tokenizer { // IK分词器实现

private IKSegmenter _IKImplement; // 词元文本属性

private final CharTermAttribute termAtt;

// 词元位移属性

private final OffsetAttribute offsetAtt;

// 词元分类属性(该属性分类参考org.wltea.analyzer.core.Lexeme中的分类常量)

private final TypeAttribute typeAtt;

// 记录最后一个词元的结束位置

private int endPosition; /**

* @param in

* @param useSmart

*/

public IKTokenizer4Lucene7(boolean useSmart) {

super();

offsetAtt = addAttribute(OffsetAttribute.class);

termAtt = addAttribute(CharTermAttribute.class);

typeAtt = addAttribute(TypeAttribute.class);

_IKImplement = new IKSegmenter(input, useSmart);

} /*

* (non-Javadoc)

*

* @see org.apache.lucene.analysis.TokenStream#incrementToken()

*/

@Override

public boolean incrementToken() throws IOException {

// 清除所有的词元属性

clearAttributes();

Lexeme nextLexeme = _IKImplement.next();

if (nextLexeme != null) {

// 将Lexeme转成Attributes

// 设置词元文本

termAtt.append(nextLexeme.getLexemeText());

// 设置词元长度

termAtt.setLength(nextLexeme.getLength());

// 设置词元位移

offsetAtt.setOffset(nextLexeme.getBeginPosition(),

nextLexeme.getEndPosition());

// 记录分词的最后位置

endPosition = nextLexeme.getEndPosition();

// 记录词元分类

typeAtt.setType(nextLexeme.getLexemeTypeString());

// 返会true告知还有下个词元

return true;

}

// 返会false告知词元输出完毕

return false;

} /*

* (non-Javadoc)

*

* @see org.apache.lucene.analysis.Tokenizer#reset(java.io.Reader)

*/

@Override

public void reset() throws IOException {

super.reset();

_IKImplement.reset(input);

} @Override

public final void end() {

// set final offset

int finalOffset = correctOffset(this.endPosition);

offsetAtt.setOffset(finalOffset, finalOffset);

}

}

5. 新建一个IKAnalyzer的测试类IKAnalyzerTest

package com.study.lucene.ikanalyzer.Integrated; import java.io.IOException; import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute; /**

* IKAnalyzer分词器集成测试:

* 细粒度切分:把词分到最细

* 智能切分:根据词库进行拆分符合我们的语言习惯

*

* @author THINKPAD

*

*/

public class IKAnalyzerTest {

private static void doToken(TokenStream ts) throws IOException {

ts.reset();

CharTermAttribute cta = ts.getAttribute(CharTermAttribute.class);

while (ts.incrementToken()) {

System.out.print(cta.toString() + "|");

}

System.out.println();

ts.end();

ts.close();

} public static void main(String[] args) throws IOException { String etext = "Analysis is one of the main causes of slow indexing. Simply put, the more you analyze the slower analyze the indexing (in most cases).";

String chineseText = "张三说的确实在理。";

/**

* ikanalyzer 中文分词器 因为Analyzer的createComponents方法API改变了 需要我们自己实现

* 分析器IKAnalyzer4Lucene7和分词器IKTokenizer4Lucene7

*/

// IKAnalyzer 细粒度切分

try (Analyzer ik = new IKAnalyzer4Lucene7();) {

TokenStream ts = ik.tokenStream("content", etext);

System.out.println("IKAnalyzer中文分词器 细粒度切分,英文分词效果:");

doToken(ts);

ts = ik.tokenStream("content", chineseText);

System.out.println("IKAnalyzer中文分词器 细粒度切分,中文分词效果:");

doToken(ts);

} // IKAnalyzer 智能切分

try (Analyzer ik = new IKAnalyzer4Lucene7(true);) {

TokenStream ts = ik.tokenStream("content", etext);

System.out.println("IKAnalyzer中文分词器 智能切分,英文分词效果:");

doToken(ts);

ts = ik.tokenStream("content", chineseText);

System.out.println("IKAnalyzer中文分词器 智能切分,中文分词效果:");

doToken(ts);

}

}

}

运行结果:

IKAnalyzer中文分词器 细粒度切分,英文分词效果:

analysis|is|one|of|the|main|causes|of|slow|indexing.|indexing|simply|put|the|more|you|analyze|the|slower|analyze|the|indexing|in|most|cases|

IKAnalyzer中文分词器 细粒度切分,中文分词效果:

张三|三|说的|的确|的|确实|实在|在理|

IKAnalyzer中文分词器 智能切分,英文分词效果:

analysis|is|one|of|the|main|causes|of|slow|indexing.|simply|put|the|more|you|analyze|the|slower|analyze|the|indexing|in|most|cases|

IKAnalyzer中文分词器 智能切分,中文分词效果:

张三|说的|确实|在理|

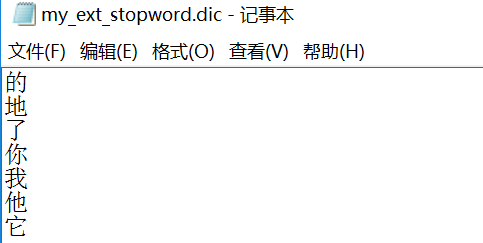

三、扩展 IKAnalyzer的停用词和新词

扩展 IKAnalyzer的停用词

1、在类目录下创建IK的配置文件:IKAnalyzer.cfg.xml

2、在配置文件中增加配置扩展停用词文件的节点: <entry key=“ext_stopwords”>my_ext_stopword.dic</entry> 如有多个,以“;”间隔

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment> <!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords">my_ext_stopword.dic</entry>

</properties>

3、在类目录下创建我们的扩展停用词文件 my_ext_stopword.dic,编辑该文件加入停用词,一行一个

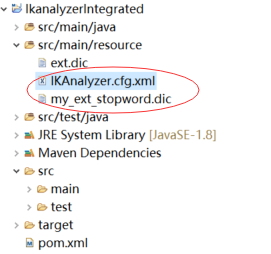

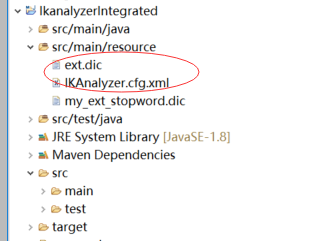

4、目录结构如下:

5.新建测试类ExtendedIKAnalyzerDicTest.java

package com.study.lucene.ikanalyzer.Integrated.ext; import java.io.IOException; import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute; import com.study.lucene.ikanalyzer.Integrated.IKAnalyzer4Lucene7; /**

* 扩展 IKAnalyzer的词典测试

*

*

*/

public class ExtendedIKAnalyzerDicTest { private static void doToken(TokenStream ts) throws IOException {

ts.reset();

CharTermAttribute cta = ts.getAttribute(CharTermAttribute.class);

while (ts.incrementToken()) {

System.out.print(cta.toString() + "|");

}

System.out.println();

ts.end();

ts.close();

} public static void main(String[] args) throws IOException {

String chineseText = "厉害了我的国一经播出,受到各方好评,强烈激发了国人的爱国之情、自豪感!";

// IKAnalyzer 细粒度切分

try (Analyzer ik = new IKAnalyzer4Lucene7();) {

TokenStream ts = ik.tokenStream("content", chineseText);

System.out.println("IKAnalyzer中文分词器 细粒度切分,中文分词效果:");

doToken(ts);

} // IKAnalyzer 智能切分

try (Analyzer ik = new IKAnalyzer4Lucene7(true);) {

TokenStream ts = ik.tokenStream("content", chineseText);

System.out.println("IKAnalyzer中文分词器 智能切分,中文分词效果:");

doToken(ts);

}

}

}

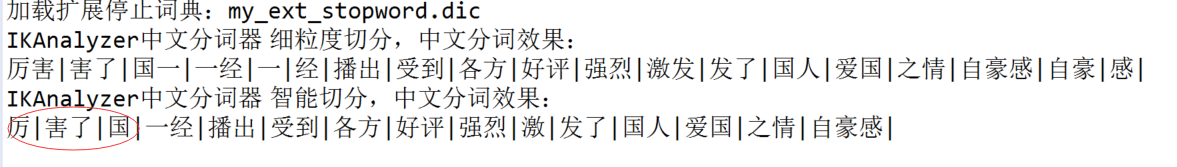

运行结果:

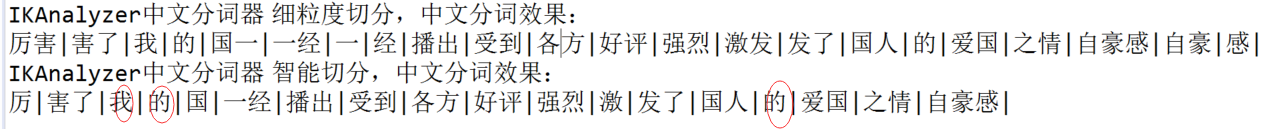

未加停用词之前:

加停用词之后:

扩展 IKAnalyzer的新词:

1、在类目录下IK的配置文件:IKAnalyzer.cfg.xml 中增加配置扩展词文件的节点: <entry key="ext_dict">ext.dic</entry> 如有多个,以“;”间隔

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 -->

<entry key="ext_dict">ext.dic</entry> <!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords">my_ext_stopword.dic</entry>

</properties>

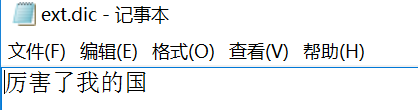

2、在类目录下创建扩展词文件 ext.dic,编辑该文件加入新词,一行一个

3、目录结构如下:

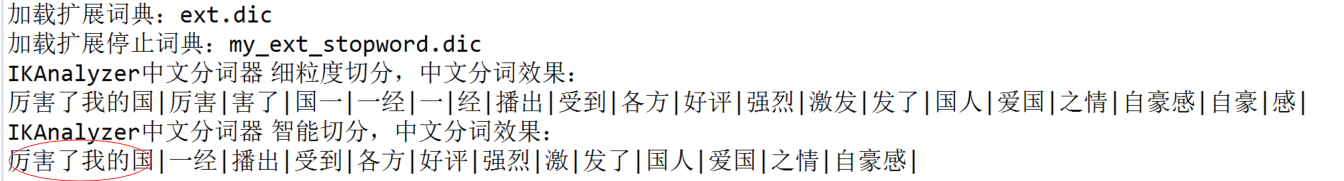

4.运行前面的测试类测试类ExtendedIKAnalyzerDicTest.java查看运行效果

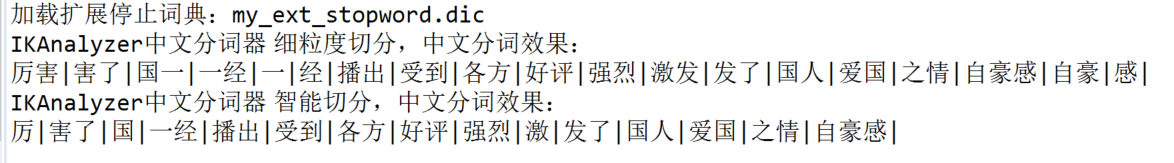

运行结果:

未加新词之前:

加新词之后:

源码获取地址:

https://github.com/leeSmall/SearchEngineDemo

Lucene系列四:Lucene提供的分词器、IKAnalyze中文分词器集成、扩展 IKAnalyzer的停用词和新词的更多相关文章

- Elasticsearch(10) --- 内置分词器、中文分词器

Elasticsearch(10) --- 内置分词器.中文分词器 这篇博客主要讲:分词器概念.ES内置分词器.ES中文分词器. 一.分词器概念 1.Analysis 和 Analyzer Analy ...

- IKAnalyzer使用停用词词典进行分词

@Test // 測试分词的效果,以及停用词典是否起作用 public void test() throws IOException { String text = "老爹我们都爱您.&qu ...

- 中文分词接口api,采用结巴分词PHP版中文分词接口

中文分词,分词就是将连续的字序列按照一定的规范重新组合成词序列的过程.我们知道,在英文的行文中,单词之间是以空格作为自然分界符的,而中文只是字.句和段能通过明显的分界符来简单划界,唯独词没有一个形式上 ...

- 分词 | 双向匹配中文分词算法python实现

本次实验内容是基于词典的双向匹配算法的中文分词算法的实现.使用正向和反向最大匹配算法对给定句子进行分词,对得到的结果进行比较,从而决定正确的分词方法. 算法描述正向最大匹配算法先设定扫描的窗口大小ma ...

- 关于yaha中文分词(将中文分词后,结合TfidfVectorizer变成向量)

https://github.com/jannson/yaha # -*- coding: utf-8 -*- """ Created on Wed Aug 10 08: ...

- Lucene.net(4.8.0) 学习问题记录五: JIEba分词和Lucene的结合,以及对分词器的思考

前言:目前自己在做使用Lucene.net和PanGu分词实现全文检索的工作,不过自己是把别人做好的项目进行迁移.因为项目整体要迁移到ASP.NET Core 2.0版本,而Lucene使用的版本是3 ...

- Lucene索引库维护、搜索、中文分词器

删除索引(文档) 需求 某些图书不再出版销售了,我们需要从索引库中移除该图书. 1 @Test 2 public void deleteIndex() throws Exception { 3 // ...

- Lucene的中文分词器IKAnalyzer

分词器对英文的支持是非常好的. 一般分词经过的流程: 1)切分关键词 2)去除停用词 3)把英文单词转为小写 但是老外写的分词器对中文分词一般都是单字分词,分词的效果不好. 国人林良益写的IK Ana ...

- Lucene系列一:搜索引擎核心理论

一.为什么需要搜索引擎 问题1:数据库索引的原理是怎样的? 索引原理:对列值创建排序存储,数据结构={列值.行地址}.在有序数据列表中就可以利用二分查找快速找到要查找的行的地址,再根据地址直接取行数据 ...

随机推荐

- Java 的 I/O 类库的基本架构

Java 的 I/O 类库的基本架构 I/O 问题是任何编程语言都无法回避的问题,可以说 I/O 问题是整个人机交互的核心问题,因为 I/O 是机器获取和交换信息的主要渠道.在当今这个数据大爆炸时代, ...

- .NET微信扫码支付模式二API接口开发测试

主要实现微信扫码支付,官网的SDKdemo 就不要使用 一直不能调试通过的,还是自己按照API接口文档一步一步来实现,吐槽下微信一点责任感都木有,能不能demo搞个正常的吗,不要坑惨了一大群码农们有点 ...

- angular指令中使用ngModelController

在这篇文章中 angular学习笔记(三十)-指令(10)-require和controller 说到了通过require属性和controller参数来让指令与指令之间互相交互. 本篇主要介绍的是指 ...

- 开源中国(oschina.net)能给我一个交代吗?

一年前准备把goolge上面diocp项目移动到开源中国上面,当时觉得开源中国的的速度还不错,都叫开源中国了,觉得应该稳定. 后来把今年开源mybean项目也放在上面了,还有一些小的项目都放在上面,就 ...

- 使用Python实现Map Reduce程序

使用Python实现Map Reduce程序 起因 想处理一些较大的文件,单机运行效率太低,多线程也达不到要求,最终采用了集群的处理方式. 详细的讨论可以在v2ex上看一下. 步骤 MapReduce ...

- SAP NetWeaver BW 7.3介绍

(摘自SAP 官方 EIM300 SAP NetWeaver BW 7.3 特色功能.前景展望与路线图)

- 使用 libvirt创建和管理KVM虚拟机

1. libvirt介绍 Libvirt是一个软件集合,便于使用者管理虚拟机和其他虚拟化功能,比如存储和网络接口管理等等.Libvirt概括起来包括一个API库.一个 daemon(libv ...

- SQL中的DML、DDL以及DCL是什么?

DML(data manipulation language)是数据操纵语言:它们是SELECT.UPDATE.INSERT.DELETE,就象它的名字一样,这4条命令是用来对数据库里的数据进行操作的 ...

- ubuntu 14.04 gitlab 的搭建

经过两天的尝试,gitlab 终于在 ubuntu14.04 上面搭建起来. 一.安装相关软件. // 执行如下命令: sudo apt-get install vim git curl openss ...

- [命令]在uboot下查看文件系统的目录结构

在uboot下敲help可以查看该版本的uboot支持哪些命令 ls mmc 1:1 ls mmc 1:2 可以查看mmc设备上对应的文件目录,支持多种文件系统格式,如fat32/ext