Python 分析电影《南方车站的聚会》

《南方车站的聚会》由刁亦男执导,主要演员包括:胡歌、桂纶镁、廖凡、万茜等,该片于 2019 年 5 月 18 在戛纳电影节首映,2019 年 12 月 6 日在中国正式上映。故事灵感来自真实新闻事件,主要讲述盗窃团伙头目周泽农(胡歌饰),在重金悬赏下走上逃亡之路,艰难寻求自我救赎的故事。

影片上映了一周多,票房接近 2 亿,作为一部文艺片,这个表现应该算是属于中上水平了。下面打开豆瓣看一下评分情况,如下图所示:

从图中我们可以看到目前有 13 万多人评分,达到了 7.5 分,打 4 星和 3 星的居多,并非网上一些人所说的口碑两极分化(如果两级分化,应该是打 5 星 和 1 星的居多吧?!)。

页面向下拉到影评位置,如下图所示:

我们可以看到有 5 万多条影评,目前豆瓣对查看影评数据的限制是:未登录最多可以查看 200 条数据,登录用户最多可以查看 500 条数据,我们要做的是通过 Python 爬取豆瓣 500 条影评数据,然后进行数据分析。

首先获取影片列表 URL,具体操作为:点击上图中 全部 52846 条,进入影评列表首页,如下图所示:

但我们发现一个问题,该 URL 参数中并没有行号等信息(实现翻页需要),这个问题我们只需点击后页按钮即可看到,结果如图所示:

现在我们可以从 URL 中看到这些信息了,因 start 参数为变量,我们将上面 URL 修改为:https://movie.douban.com/subject/27668250/comments?start=%d&limit=20&sort=new_score&status=P 作为爬取开始 URL。

接着我们看一下如何实现登陆,首先打开登录页,如下图所示:

我们先在手机号/邮箱和密码输入框处随意输入(不要输入正确的用户名和密码),再按 F12 键打开开发者工具,最后点击登录豆瓣按钮,结果如图所示:

我们点击上面图中所示 basic 项,点击后结果如图所示:

此时可以看到 Request URL(登录所需 URL) 和 Form Data 项,这两项是我们登录时需要的,当然我们还需 User-Agent,点击上面图中所示的 Request Headers 项即可看到,如图所示:

所需要的东西都找好了,接下来就是具体实现了,豆瓣登录和影评数据爬取的具体实现如下所示:

import requests

import time

import random

from lxml import etree

import csv

# 新建 csv 文件

csvfile = open('南方车站的聚会.csv','w',encoding='utf-8',newline='')

writer = csv.writer(csvfile)

# 表头

writer.writerow(['时间','星级','评论内容'])

def spider():

url = 'https://accounts.douban.com/j/mobile/login/basic'

headers = {"User-Agent": 'Mozilla/4.0 (compatible; MSIE 8.0; Windows NT 6.0; Trident/4.0)'}

comment_url = 'https://movie.douban.com/subject/27668250/comments?start=%d&limit=20&sort=new_score&status=P'

data = {

'ck': '',

'name': '自己的用户名',

'password': '自己的密码',

'remember': 'false',

'ticket': ''

}

session = requests.session()

session.post(url=url, headers=headers, data=data)

# 总共 500 条,每页 20 条

for i in range(0, 500, 20):

# 获取 HTML

data = session.get(comment_url % i, headers=headers)

print('第', i, '页', '状态码:', data.status_code)

# 暂停 0-1 秒

time.sleep(random.random())

# 解析 HTML

selector = etree.HTML(data.text)

# 获取当前页所有评论

comments = selector.xpath('//div[@class="comment"]')

# 遍历所有评论

for comment in comments:

# 获取星级

star = comment.xpath('.//h3/span[2]/span[2]/@class')[0][7]

# 获取时间

t = comment.xpath('.//h3/span[2]/span[3]/text()')

# 获取评论内容

content = comment.xpath('.//p/span/text()')[0].strip()

# 排除时间为空的项

if len(t) != 0:

t = t[0].strip()

writer.writerow([t, star, content])

接下来我们通过词云直观的来展示下整体评论情况,具体实现如下所示:

import csv

import jieba

from wordcloud import WordCloud

import numpy as np

from PIL import Image

# jieba 分词处理

def jieba_():

csv_list = csv.reader(open('南方车站的聚会.csv', 'r', encoding='utf-8'))

print('csv_list',csv_list)

comments = ''

for i,line in enumerate(csv_list):

if i != 0:

comment = line[2]

comments += comment

print("comment-->",comments)

# jieba 分词

words = jieba.cut(comments)

new_words = []

# 要排除的词

remove_words = ['以及', '在于', '一些', '一场', '只有',

'不过', '东西', '场景', '所有', '这么',

'但是', '全片', '之前', '一部', '一个',

'作为', '虽然', '一切', '怎么', '表现',

'人物', '没有', '不是', '一种', '个人'

'如果', '之后', '出来', '开始', '就是',

'电影', '还是', '不是', '武汉', '镜头']

for word in words:

if word not in remove_words:

new_words.append(word)

global word_cloud

# 用逗号分隔词语

word_cloud = ','.join(new_words)

# 生成词云

def world_cloud():

# 背景图

cloud_mask = np.array(Image.open('bg.jpg'))

wc = WordCloud(

# 背景图分割颜色

background_color='white',

# 背景图样

mask=cloud_mask,

# 显示最大词数

max_words=600,

# 显示中文

font_path='./fonts/simhei.ttf',

# 字的尺寸限制

min_font_size=20,

max_font_size=100,

margin=5

)

global word_cloud

x = wc.generate(word_cloud)

# 生成词云图片

image = x.to_image()

# 展示词云图片

image.show()

# 保存词云图片

wc.to_file('wc.png')

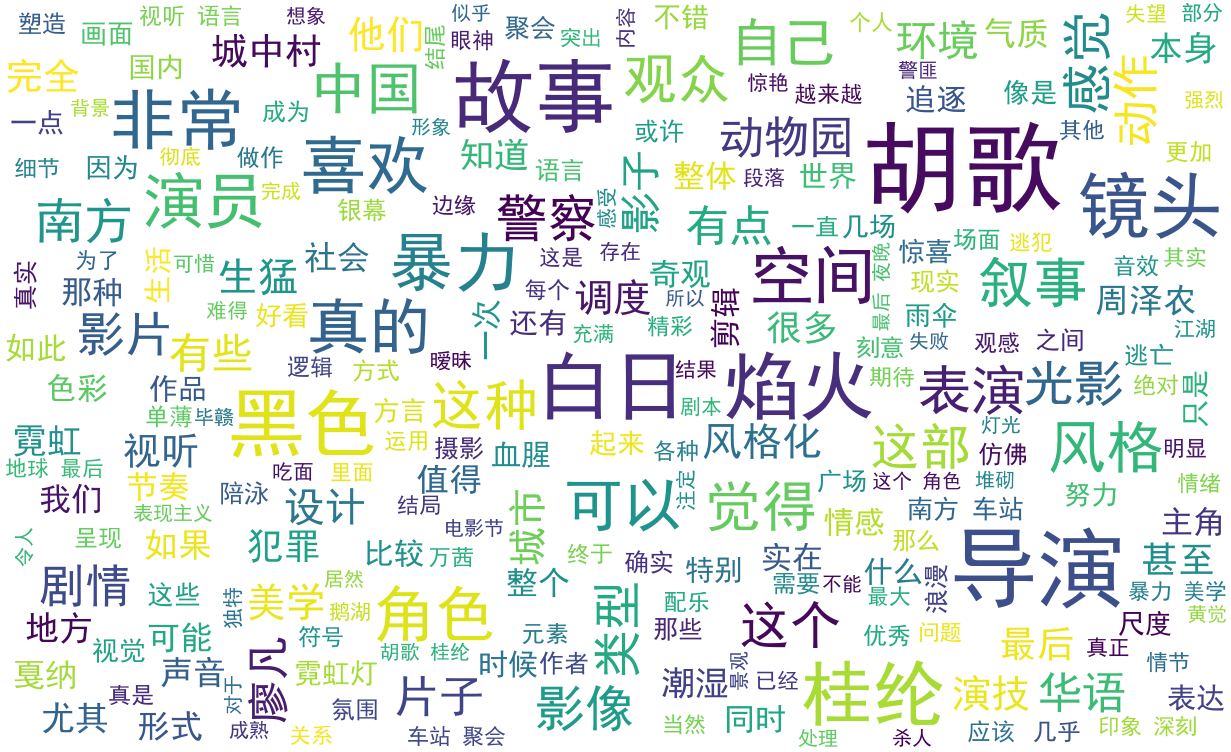

整体评论词云图

因为有人说了影片口碑两级分化,接下来我们看一下打 1 星和 5 星的词云效果如何,主要实现如下所示:

for i,line in enumerate(csv_list):

if i != 0:

star = line[1]

comment = line[2]

# 一星评论用 1,五星评论用 5

if star == '1':

comments += comment

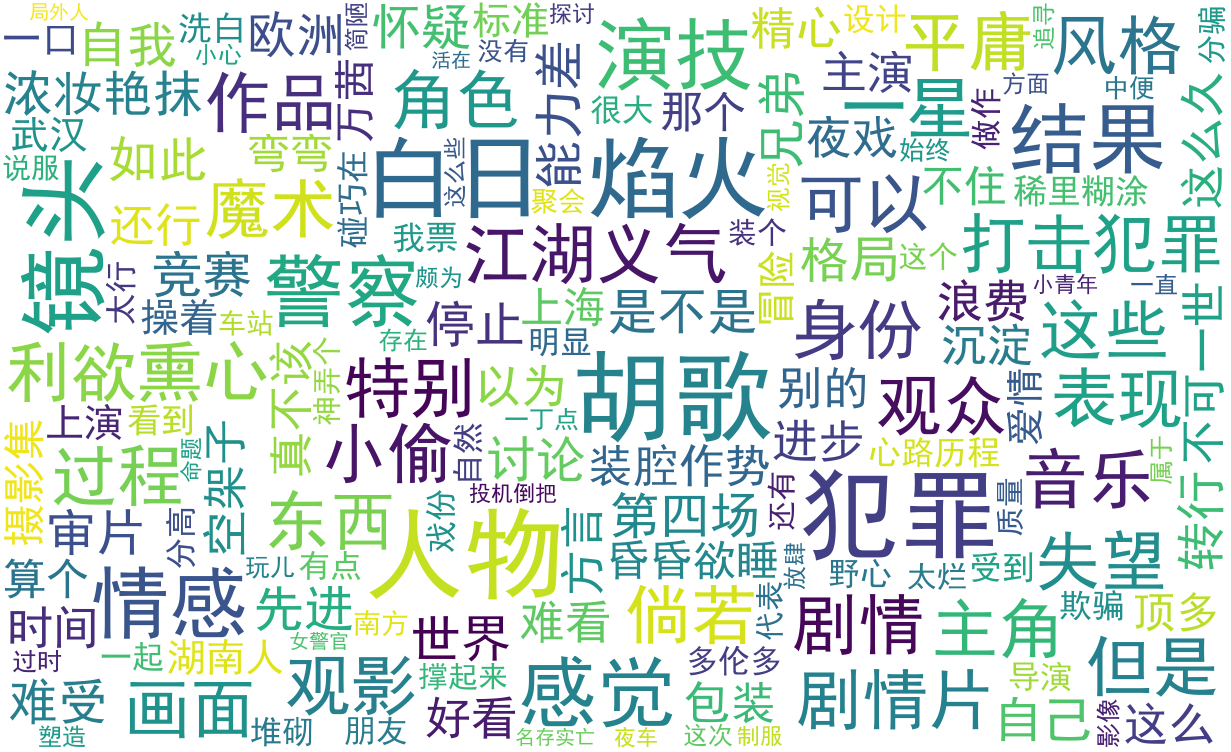

一星评论词云图

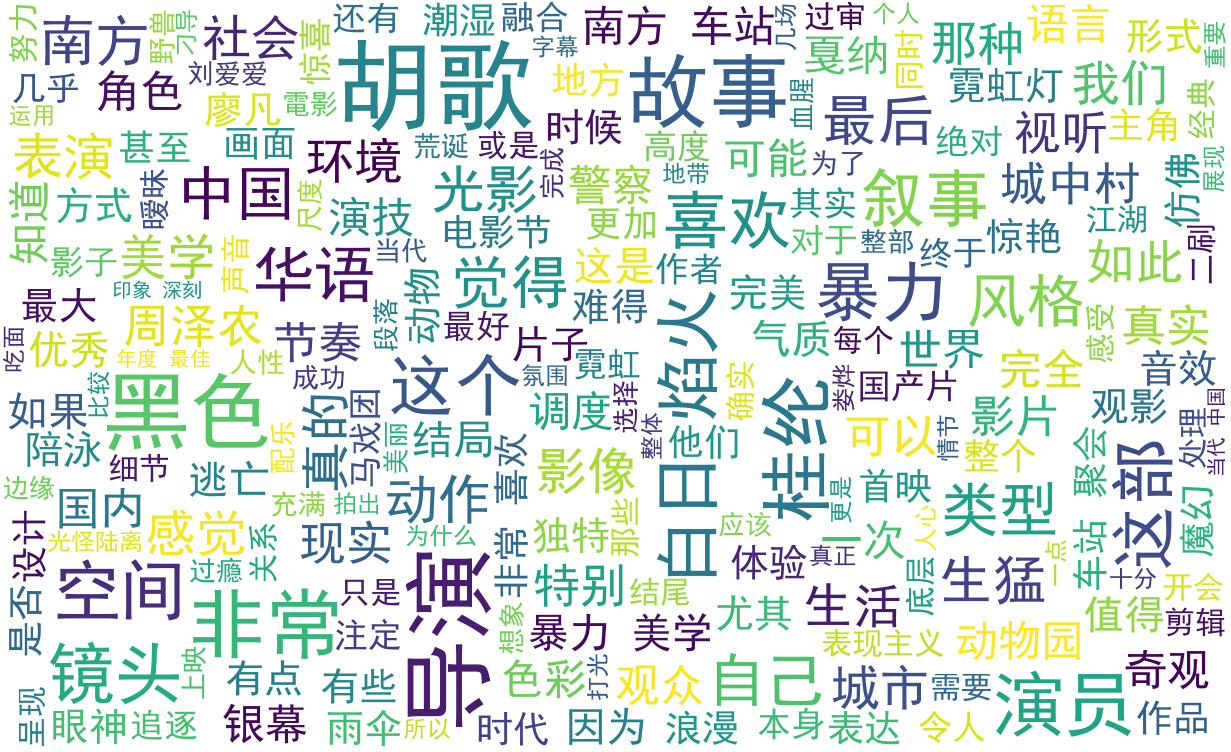

五星评论词云图

上面我们只使用了评论内容信息,还有时间和星级信息没有使用,最后我们可以用这两项数据分析下随着时间的变化影片星级的波动情况,以月为单位统计影片从首映(2019 年 5 月)到当前时间(2019 年 12月)的星级波动情况,具体实现如下所示:

import csv

from pyecharts.charts import Line

import pyecharts.options as opts

import numpy as np

from datetime import datetime

def score():

csv_list = csv.reader(open('南方车站的聚会.csv', 'r', encoding='utf-8'))

print('csv_list', csv_list)

comments = ''

ts = []

ss = set()

for i, line in enumerate(csv_list):

if i != 0:

t = line[0][0:7]

s = line[1]

ts.append(t+':'+s)

ss.add(t)

new_times = []

new_starts = []

new_ss = []

for i in ss:

new_ss.append(i)

arr = np.array(new_ss)

new_ss = arr[np.argsort([datetime.strptime(i, '%Y-%m') for i in np.array(new_ss)])].tolist()

print('new_ss',new_ss)

for i in new_ss:

x = 0

y = 0

z = 0

for j in ts:

t = j.split(':')[0]

s = int(j.split(':')[1])

if i == t:

x += s

z += 1

new_times.append(i)

new_starts.append(round(x / z, 1))

c = (

Line()

.add_xaxis(new_times)

.add_yaxis('南方车站的聚会',new_starts)

.set_global_opts(title_opts=opts.TitleOpts(title='豆瓣星级波动图'))

).render()

影片星级波动效果如下图所示:

根据影片星级的波动情况我们也能大致预测到影片评分的波动情况。

Python 分析电影《南方车站的聚会》的更多相关文章

- 利用python实现电影推荐

"协同过滤"是推荐系统中的常用技术,按照分析维度的不同可实现"基于用户"和"基于产品"的推荐. 以下是利用python实现电影推荐的具体方法 ...

- 转利用python实现电影推荐

“协同过滤”是推荐系统中的常用技术,按照分析维度的不同可实现“基于用户”和“基于产品”的推荐. 以下是利用python实现电影推荐的具体方法,其中数据集源于<集体编程智慧>一书,后续的编程 ...

- python一键电影搜索与下载

代码地址如下:http://www.demodashi.com/demo/14313.html python一键电影搜索与下载 概述 使用python搜索并爬取豆瓣电影信息,包括评分,主演,导演,类型 ...

- Python分析离散心率信号(下)

Python分析离散心率信号(下) 如何使用动态阈值,信号过滤和离群值检测来改善峰值检测. 一些理论和背景 到目前为止,一直在研究如何分析心率信号并从中提取最广泛使用的时域和频域度量.但是,使用的信号 ...

- 用Python分析国庆旅游景点,告诉你哪些地方好玩、便宜、人又少

注:本人参考“裸睡的猪”公众号同名文章,学习使用. 一.目标 使用Python分析出国庆哪些旅游景点:好玩.便宜.人还少的地方,不然拍照都要抢着拍! 二.获取数据 爬取出行网站的旅游景点售票数据,反映 ...

- python 分析慢查询日志生成报告

python分析Mysql慢查询.通过Python调用开源分析工具pt-query-digest生成json结果,Python脚本解析json生成html报告. #!/usr/bin/env pyth ...

- Python分析盘点2019全球流行音乐:是哪些歌曲榜单占领了我们?

写在前面:圣诞刚过,弥留者节日气息的大家是否还在继续学习呐~在匆忙之际也不忘给自己找几首好听的歌曲放松一下,缠绕着音乐一起来看看关于2019年流行音乐趋势是如何用Python分析的吧! 昨天下午没事儿 ...

- Python分析数据难吗?某科技大学教授说,很难但有方法就简单

用python分析数据难吗?某科技大学的教授这样说,很难,但要讲方法,主要是因为并不是掌握了基础,就能用python来做数据分析的. 所谓python的基础,也就是刚入门的python学习者,学习的基 ...

- 五月天的线上演唱会你看了吗?用Python分析网友对这场线上演唱会的看法

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者:CDA数据分析师 豆瓣9.4分!这场线上演唱会到底多好看? 首先让我 ...

随机推荐

- C++程序的耦合性设计

声明:本文部分采用和参考<代码里的世界观-通往架构师之路>中内容,可以说是该书中耦合性一章的读后感,感谢该书的作者余叶老师的无私分享. 1.什么是耦合? 耦合其实就是程序之间的相关性. 程 ...

- Jrebel 激活的方法

jrebel 激活的方法: 试了很多都不好用,下面这个方法比较简单快捷.(不知道可以坚持多久) myjrebel 7月分官方正式停用,致使广大朋友无法使用jrebel/XRebel,可按如下地址进行 ...

- RAM、ROM和fFLASH相关概念整理

一:ROM ROM:Read Only Memory.只读存储器 是一种半导体内存,又叫做非挥发性内存.其特性是一旦数据被存储就无法再将之改变或删除.存储的数据不会因为电源关闭而消失. 二: ...

- 个人收藏--未整理—C# http/https 上传下载文件

c# HTTP/HTTPS 文件上传. 分类: .net 2015-02-03 08:36 541人阅读 评论(0) 收藏 举报 方法主体 [csharp] view plaincopy public ...

- 对照谈-官方spring-boot-starter和自定义starter异同分析

在前面我讲用spring-boot-starter-mail发邮件的时候,我侧重看的是spring boot发邮件的便利性,今天,我们聊下另外一个方面,spring-boot-starter自身的结构 ...

- IT网址 插件 系统 软件 网址收集!

http://www.css88.com http://www.runoob.com/jquery/jquery-plugin-validate.html http://www.iteye.com/n ...

- 用生动的案例一步步带你学会python多线程模块

鱼和熊掌不可兼得 鱼,我所欲也,熊掌,亦我所欲也,二者不可得兼,舍鱼而取熊掌者也. 从6月开始写公众号,连着四个月一直尽量保证一周五更,结果整天熬夜搞的身体素质骤降.十一休假决定暂时将公众号放放,好好 ...

- 华为担纲建设基础软硬件国家新一代AI开放创新平台

[摘要] 全栈全场景AI能力爆发! [上海,2019年8月29日] 凭借领先的全栈全场景AI能力华为入选国家新一代人工智能开放创新平台 8月29日,科技部在2019世界人工智能大会宣布,将依托华为建设 ...

- 索引很难么?带你从头到尾捋一遍MySQL索引结构,不信你学不会!

前言 Hello我又来了,快年底了,作为一个有抱负的码农,我想给自己攒一个年终总结.自上上篇写了手动搭建Redis集群和MySQL主从同步(非Docker)和上篇写了动手实现MySQL读写分离and故 ...

- Python之HTTP静态服务器-面向对象版开发

利用面向对象的思想完成HTTP静态Web服务器的开发. 主要思路如下: 1.抽象出一个服务器类 1.1 编写类的对象属性 1.2 编写类的方法 注意: 在进行请求资源路径判断时,需要确认请求路径中是否 ...