从零开始学习MXnet(一)

最近工作要开始用到MXnet,然而MXnet的文档写的实在是.....所以在这记录点东西,方便自己,也方便大家。

我觉得搞清楚一个框架怎么使用,第一步就是用它来训练自己的数据,这是个很关键的一步。

一、MXnet数据预处理

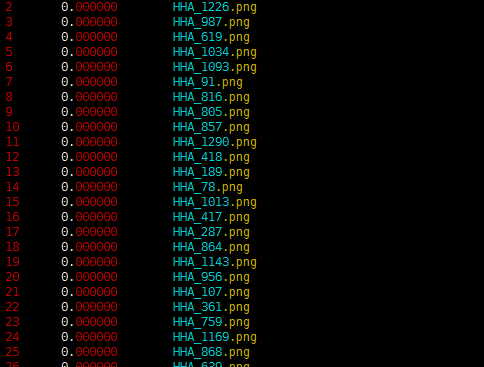

整个数据预处理的代码都集成在了toosl/im2rec.py中了,这个首先要造出一个list文件,lst文件有三列,分别是index label 图片路径。如下图所示:

我这个label是瞎填的,所以都是0。另外最新的MXnet上面的im2rec是有问题的,它生成的list所有的index都是0,不过据说这个index没什么用.....但我还是改了一下。把yield生成器换成直接append即可。

执行的命令如下:

sudo python im2rec.py --list=True /home/erya/dhc/result/try /home/erya/dhc/result/ --recursive=True --shuffle=true --train-ratio=0.8

每个参数的意义在代码内部都可以查到,简单说一下这里用到的:--list=True说明这次的目的是make list,后面紧跟的是生成的list的名字的前缀,我这里是加了路径,然后是图片所在文件夹的路径,recursive是是否迭代的进入文件夹读取图片,--train-ratio则表示train和val在数据集中的比例。

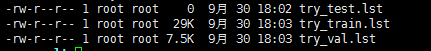

执行上面的命令后,会得到三个文件:

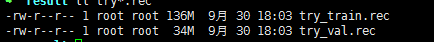

然后再执行下面的命令生成最后的rec文件:

sudo python im2rec.py /home/erya/dhc/result/try_val.lst /home/erya/dhc/result --quality=100

以及,sudo python im2rec.py /home/erya/dhc/result/try_train.lst /home/erya/dhc/result --quality=100

来生成相应的lst文件的rec文件,参数意义太简单就不说了..看着就明白,result是我存放图片的目录。

这样最终就完成了数据的预处理,简单的说,就是先生成lst文件,这个其实完全可以自己做,而且后期我做segmentation的时候,label就是图片了..

二、非常简单的小demo

先上代码:

import mxnet as mx

import logging

import numpy as np logger = logging.getLogger()

logger.setLevel(logging.DEBUG)#暂时不需要管的log

def ConvFactory(data, num_filter, kernel, stride=(1,1), pad=(0, 0), act_type="relu"):

conv = mx.symbol.Convolution(data=data, workspace=256,

num_filter=num_filter, kernel=kernel, stride=stride, pad=pad)

return conv #我把这个删除到只有一个卷积的操作

def DownsampleFactory(data, ch_3x3):

# conv 3x3

conv = ConvFactory(data=data, kernel=(3, 3), stride=(2, 2), num_filter=ch_3x3, pad=(1, 1))

# pool

pool = mx.symbol.Pooling(data=data, kernel=(3, 3), stride=(2, 2), pool_type='max')

# concat

concat = mx.symbol.Concat(*[conv, pool])

return concat

def SimpleFactory(data, ch_1x1, ch_3x3):

# 1x1

conv1x1 = ConvFactory(data=data, kernel=(1, 1), pad=(0, 0), num_filter=ch_1x1)

# 3x3

conv3x3 = ConvFactory(data=data, kernel=(3, 3), pad=(1, 1), num_filter=ch_3x3)

#concat

concat = mx.symbol.Concat(*[conv1x1, conv3x3])

return concat

if __name__ == "__main__":

batch_size = 1

train_dataiter = mx.io.ImageRecordIter(

shuffle=True,

path_imgrec="/home/erya/dhc/result/try_train.rec",

rand_crop=True,

rand_mirror=True,

data_shape=(3,28,28),

batch_size=batch_size,

preprocess_threads=1)#这里是使用我们之前的创造的数据,简单的说就是要自己写一个iter,然后把相应的参数填进去。

test_dataiter = mx.io.ImageRecordIter(

path_imgrec="/home/erya/dhc/result/try_val.rec",

rand_crop=False,

rand_mirror=False,

data_shape=(3,28,28),

batch_size=batch_size,

round_batch=False,

preprocess_threads=1)#同理

data = mx.symbol.Variable(name="data")

conv1 = ConvFactory(data=data, kernel=(3,3), pad=(1,1), num_filter=96, act_type="relu")

in3a = SimpleFactory(conv1, 32, 32)

fc = mx.symbol.FullyConnected(data=in3a, num_hidden=10)

softmax = mx.symbol.SoftmaxOutput(name='softmax',data=fc)#上面就是定义了一个巨巨巨简单的结构

# For demo purpose, this model only train 1 epoch

# We will use the first GPU to do training

num_epoch = 1

model = mx.model.FeedForward(ctx=mx.gpu(), symbol=softmax, num_epoch=num_epoch,

learning_rate=0.05, momentum=0.9, wd=0.00001) #将整个model训练的架构定下来了,类似于caffe里面solver所做的事情。 # we can add learning rate scheduler to the model

# model = mx.model.FeedForward(ctx=mx.gpu(), symbol=softmax, num_epoch=num_epoch,

# learning_rate=0.05, momentum=0.9, wd=0.00001,

# lr_scheduler=mx.misc.FactorScheduler(2))

model.fit(X=train_dataiter,

eval_data=test_dataiter,

eval_metric="accuracy",

batch_end_callback=mx.callback.Speedometer(batch_size))#开跑数据。

从零开始学习MXnet(一)的更多相关文章

- 从零开始学习MXnet(四)计算图和粗细粒度以及自动求导

这篇其实跟使用MXnet的关系不大,但对于我们理解深度学习的框架设计还是很有帮助的. 首先还是对promgramming models的一个简单介绍,这个东西实际上是在编译里面经常出现的东西,我们在编 ...

- 从零开始学习MXnet(五)MXnet的黑科技之显存节省大法

写完发现名字有点拗口..- -# 大家在做deep learning的时候,应该都遇到过显存不够用,然后不得不去痛苦的减去batchszie,或者砍自己的网络结构呢? 最后跑出来的效果不尽如人意,总觉 ...

- 从零开始学习MXnet(三)之Model和Module

在我们在MXnet中定义好symbol.写好dataiter并且准备好data之后,就可以开开心的去训练了.一般训练一个网络有两种常用的策略,基于model的和基于module的.今天,我想谈一谈他们 ...

- 从零开始学习MXnet(二)之dataiter

MXnet的设计结构是C++做后端运算,python.R等做前端来使用,这样既兼顾了效率,又让使用者方便了很多,完整的使用MXnet训练自己的数据集需要了解几个方面.今天我们先谈一谈Data iter ...

- ASP.NET从零开始学习EF的增删改查

ASP.NET从零开始学习EF的增删改查 最近辞职了,但是离真正的离职还有一段时间,趁着这段空档期,总想着写些东西,想来想去,也不是很明确到底想写个啥,但是闲着也是够 ...

- 从零开始学习jQuery (五) 事件与事件对象

本系列文章导航 从零开始学习jQuery (五) 事件与事件对象 一.摘要 事件是脚本编程的灵魂. 所以本章内容也是jQuery学习的重点. 本文将对jQuery中的事件处理以及事件对象进行详细的讲解 ...

- 从零开始学习jQuery (四) 使用jQuery操作元素的属性与样式

本系列文章导航 从零开始学习jQuery (四) 使用jQuery操作元素的属性与样式 一.摘要 本篇文章讲解如何使用jQuery获取和操作元素的属性和CSS样式. 其中DOM属性和元素属性的区分值得 ...

- 从零开始学习jQuery (三) 管理jQuery包装集

本系列文章导航 从零开始学习jQuery (三) 管理jQuery包装集 一.摘要 在使用jQuery选择器获取到jQuery包装集后, 我们需要对其进行操作. 本章首先讲解如何动态的创建元素, 接着 ...

- 从零开始学习jQuery (二) 万能的选择器

本系列文章导航 从零开始学习jQuery (二) 万能的选择器 一.摘要 本章讲解jQuery最重要的选择器部分的知识. 有了jQuery的选择器我们几乎可以获取页面上任意的一个或一组对象, 可以明显 ...

随机推荐

- vi-vim常用命令

vi-vim常用命令 1 简介 在UNIX系统中,创建和修改配置文件.shell脚本.初始化文件.编写程序都离不开VI. 1 vi[1]属于两个主要的UNIX规范:POSIX和单一UNIX规 ...

- python函数(2017-8-2)

1. def 函数名(形式参数) 函数体 return "123" 函数执行了return之后就不再执行下面的代码 2. 默认形参实参的位置一一对应 如果要调整位置,指定形参名字 ...

- java入门---windows和Linux,UNIX,Solaris,FreeBSD下开发环境配置

首先来看Windows下的操作.我们需要下载java开发工具包JDK.下载地址:http://www.oracle.com/technetwork/java/javase/downloads/ ...

- MAVEN的项目升级

今天我们来介绍一下版本依赖的问题 1.如果是admin的话,他要依赖于service的版本,则service的版本依赖于core的版本, 如果是本地编译,这我直接更新admin的就可以了,然后直接跑就 ...

- Vue 去脚手架插件,自动加载vue文件,style怎么办

书接上上会,因为当时也没想好怎么办,所以装聋作哑的忽略了Vue文件中的Style,Vue的做法我看着晕乎乎的,细想的话,无非就是自动填写到dom中,所担心的无非是命名冲突. 在一个项目中(像我这种自娱 ...

- struts2官方 中文教程 系列七:消息资源文件

介绍 在本教程中,我们将探索使用Struts 2消息资源功能(也称为 resource bundles 资源绑定).消息资源提供了一种简单的方法,可以将文本放在一个视图页面中,通过应用程序,创建表单字 ...

- guacamole实现剪切复制

主要功能是实现把堡垒机的内容复制到浏览器端,把浏览器端的文本复制到堡垒机上. 借助一个中间的文本框,现将堡垒机内容复制到一个文本框,然后把文本框内容复制出来.或者将需要传递到堡垒机的内容先复制到文本框 ...

- 手把手教你玩转CSS3 3D技术

手把手教你玩转 CSS3 3D 技术 要玩转css3的3d,就必须了解几个词汇,便是透视(perspective).旋转(rotate)和移动(translate).透视即是以现实的视角来看屏幕上 ...

- 初识Continuation

本文来自网易云社区 作者:陆艺 上学时看了SICP之后就对scheme这个看上去比较古怪的语言产生了兴趣. 虽然书里并没有涉及scheme太多语法以及语言上特性的一些东西, 作为一个喜欢折腾的人, 手 ...

- 【数据结构】 List 简单实现

public class XList<T> : IEnumerable, IEnumerator { #region List 简单实现 /// <summary> /// 存 ...