pyspark SparkSession及dataframe基本操作

from pyspark import SparkContext, SparkConf

import os

from pyspark.sql.session import SparkSession

from pyspark.sql import Row def CreateSparkContex():

sparkconf = SparkConf().setAppName("MYPRO").set("spark.ui.showConsoleProgress", "false")

sc = SparkContext(conf=sparkconf)

print("master:" + sc.master)

sc.setLogLevel("WARN")

Setpath(sc)

spark = SparkSession.builder.config(conf=sparkconf).getOrCreate()

return sc, spark def Setpath(sc):

global Path

if sc.master[:5] == "local":

Path = "file:/C:/spark/sparkworkspace"

else:

Path = "hdfs://test" if __name__ == "__main__":

print("Here we go!\n")

sc, spark = CreateSparkContex()

readcsvpath = os.path.join(Path, 'iris.csv')

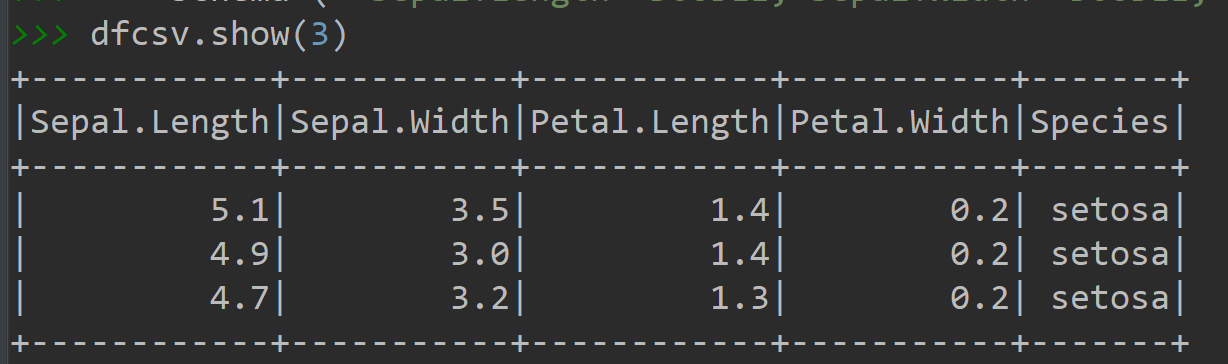

dfcsv = spark.read.csv(readcsvpath, header=True,

schema=("`Sepal.Length` DOUBLE,`Sepal.Width` DOUBLE,`Petal.Length` DOUBLE,`Petal.Width` DOUBLE,`Species` string"))

#指定数据类型读取 dfcsv.show(3) dfcsv.registerTempTable('Iris')#创建并登陆临时表

spark.sql("select * from Iris limit 3").show()#使用sql语句查询

spark.sql("select Species,count(1) from Iris group by Species").show() df = dfcsv.alias('Iris1')#创建一个别名

df.select('Species', '`Sepal.Width`').show(4)#因表头有特殊字符需用反引号``转义

df.select(df.Species,df['`Sepal.Width`']).show(4)

dfcsv.select(df.Species).show(4)#原始名、别名的组合

df[df.Species, df['`Sepal.Width`']].show(4)

df[['Species']]#与pandas相同

df['Species']#注意这是一个字段名 #########增加字段

df[df['`Sepal.Length`'], df['`Sepal.Width`'], df['`Sepal.Length`'] - df['`Sepal.Width`']].show(4)

df[df['`Sepal.Length`'], df['`Sepal.Width`'],

(df['`Sepal.Length`'] - df['`Sepal.Width`']).alias('rua')].show(4)#重命名 #########筛选数据

df[df.Species == 'virginica'].show(4)#与pandas筛选一样

df[(df.Species == 'virginica') & (df['`Sepal.Width`']>1)].show(4)#多条件筛选

df.filter(df.Species == 'virginica').show(4)#也可以用fileter方法筛选

spark.sql("select * from Iris where Species='virginica'").show(4)#sql筛选 ##########多字段排序

spark.sql("select * from Iris order by `Sepal.Length` asc ").show(4)#升序

spark.sql("select * from Iris order by `Sepal.Length` desc ").show(4)#降序

spark.sql("select * from Iris order by `Sepal.Length` asc,`Sepal.Width` desc ").show(4)#升降序 df.select('`Sepal.Length`', '`Sepal.Width`').orderBy('`Sepal.Width`',ascending=0).show(4)#按降序

df.select('`Sepal.Length`', '`Sepal.Width`').orderBy('`Sepal.Width`').show(4) # 升序

df.select('`Sepal.Length`', '`Sepal.Width`').orderBy('`Sepal.Width`', ascending=1).show(4) # 按升序,默认的

df.select('`Sepal.Length`', '`Sepal.Width`').orderBy(df['`Sepal.Width`'].desc()).show(4) # 按降序 df.select('`Sepal.Length`', '`Sepal.Width`').orderBy(

['`Sepal.Length`','`Sepal.Width`'], ascending=[0,1]).show(4)#两个字段按先降序再升序

df.orderBy(df['`Sepal.Length`'].desc(),df['`Sepal.Width`']).show(4) ##########去重

spark.sql("select distinct Species from Iris").show()

spark.sql("select distinct Species,`Sepal.Width` from Iris").show() df.select('Species').distinct().show()

df.select('Species','`Sepal.Width`').distinct().show()

df.select('Species').drop_duplicates().show()#同上,与pandas用法相同

df.select('Species').dropDuplicates().show()#同上 ##########分组统计

spark.sql("select Species,count(1) from Iris group by Species").show()

df[['Species']].groupby('Species').count().show()

df.groupby(['Species']).agg({'`Sepal.Width`': 'sum'}).show()

df.groupby(['Species']).agg({'`Sepal.Width`': 'sum', '`Sepal.Length`': 'mean'}).show() #########联结数据

dic=[['virginica','A1'],['versicolor','A2'],['setosa','A3']]

rrd=sc.parallelize(dic)

df2=rrd.map(lambda p: Row(lei=p[0],al=p[1]))

df2frame=spark.createDataFrame(df2)

df2frame.show()

df2frame.registerTempTable('dictable')

spark.sql("select * from Iris u left join dictable z on u.Species=z.lei").show()

df.join(df2frame, df.Species == df2frame.lei, 'left_outer').show() sc.stop()

spark.stop()

pyspark SparkSession及dataframe基本操作的更多相关文章

- DataFrame基本操作

这些操作在网上都可以百度得到,为了便于记忆自己再根据理解总结在一起.---------励志做一个优雅的网上搬运工 1.建立dataframe (1)Dict to Dataframe df = pd. ...

- 将 数据从数据库 直接通过 pyspark 读入到dataframe

from pyspark.sql import SparkSession spark = SparkSession \ .builder \ .appName("Python Spark S ...

- [Spark SQL] SparkSession、DataFrame 和 DataSet 练习

本課主題 DataSet 实战 DataSet 实战 SparkSession 是 SparkSQL 的入口,然后可以基于 sparkSession 来获取或者是读取源数据来生存 DataFrameR ...

- python做数据分析pandas库介绍之DataFrame基本操作

怎样删除list中空字符? 最简单的方法:new_list = [ x for x in li if x != '' ] 这一部分主要学习pandas中基于前面两种数据结构的基本操作. 设有DataF ...

- 用python做数据分析pandas库介绍之DataFrame基本操作

怎样删除list中空字符? 最简单的方法:new_list = [ x for x in li if x != '' ] 这一部分主要学习pandas中基于前面两种数据结构的基本操作. 设有DataF ...

- pandas库介绍之DataFrame基本操作

怎样删除list中空字符? 最简单的方法:new_list = [ x for x in li if x != '' ] 今天是5.1号. 这一部分主要学习pandas中基于前面两种数据结构的基本操作 ...

- 用python做数据分析4|pandas库介绍之DataFrame基本操作

原文地址 怎样删除list中空字符? 最简单的方法:new_list = [ x for x in li if x != '' ] 今天是5.1号. 这一部分主要学习pandas中基于前面两种数据结构 ...

- 机器学习三剑客之Pandas中DataFrame基本操作

Pandas 是基于Numpy 的一种工具,是为了解决数据分析任务而创建的.Pandas 纳入了大量库和一些标准的数据模型,提供了高效地操作大型数据集所需的工具.Pandas提供了大量能使我们快速便捷 ...

- sparksession创建DataFrame方式

spark创建dataFrame方式有很多种,官方API也比较多 公司业务上的个别场景使用了下面两种方式 1.通过List创建dataFrame /** * Applies a schema to a ...

随机推荐

- (转)那天有个小孩教我WCF[一][1/3]

原文地址:http://www.cnblogs.com/AaronYang/p/2950931.html 既然是小孩系列,当然要有一点基础才能快速掌握,归纳,总结的一个系列,哈哈 前言: 第一篇嘛,不 ...

- spring是如何由请求地址找到对应的control的

spring先将所有的action bean放进内存中,然后根据@RequestMapping(value = "/", method = RequestMethod.GET)这种 ...

- PLSQL_Developer 连接win7_64位oracle11g

window7系统 安装的64位 oracle11g,连接32位PLSQL_Developer 1 . 下载 PLSQL_Developer 9.0以上版本(绿色含汉化) 官方的 instantc ...

- web api 设置允许跨域,并设置预检请求时间

<httpProtocol> <customHeaders> <!--响应类型 (值为逗号分隔的一个字符串,表明服务器支持的所有跨域请求的方法)--> <ad ...

- FTP文件上传以及获取ftp配置帮助类

帮助类: using QSProjectBase; using Reform.CommonLib; using System; using System.Collections.Generic; us ...

- sqlServer组合主键

sqlServer 组合主键 创建表时: create table Person ( Name1 ) not null ,Name2 ) not null primary key(Name1,Na ...

- 「POJ 1741」Tree

题面: Tree Give a tree with n vertices,each edge has a length(positive integer less than 1001). Define ...

- C# LINQ(2)

前一章的代码LINQ都是以select结尾. 之前也说过可以group结尾. 那么怎么使用呢? 还是一样的条件,查询小于5大于0的元素 代码: ,,,,,,,,, }; var list = from ...

- linux系统安全及应用——系统引导和登录控制

一.开关机安全控制 1)调整BIOS将第一引导设备设为当前系统所在硬盘 2)调整BIOS禁止从其他设备(光盘.U盘.网络)引导系统 3)调整BIOS将安全级别设为setup,并设置管理员密码 4)禁用 ...

- get与post中文乱码问题

Jsp默认的字符编码格式是iso-8859-1 因为post方法与get方法传递参数的方式不一样,所以有不同的解决方法. 一.post乱码解决方法: 1.设置请求和响应的编码方式 //设置请求的编码格 ...