18个awk的经典实战案例

介绍

这些案例是我收集起来的,大多都是我自己遇到过的,有些比较经典,有些比较具有代表性。

这些awk案例我也录了相关视频的讲解awk 18个经典实战案例精讲,欢迎大家去瞅瞅。

插入几个新字段

在"a b c d"的b后面插入3个字段e f g。

echo a b c d|awk '{$3="e f g "$3}1'

格式化空白

移除每行的前缀、后缀空白,并将各部分左对齐。

aaaa bbb cccbbb aaa cccddd fff eee gg hh ii jj

awk 'BEGIN{OFS="\t"}{$1=$1;print}' a.txt

执行结果:

aaaa bbb cccbbb aaa cccddd fff eee gg hh ii jj

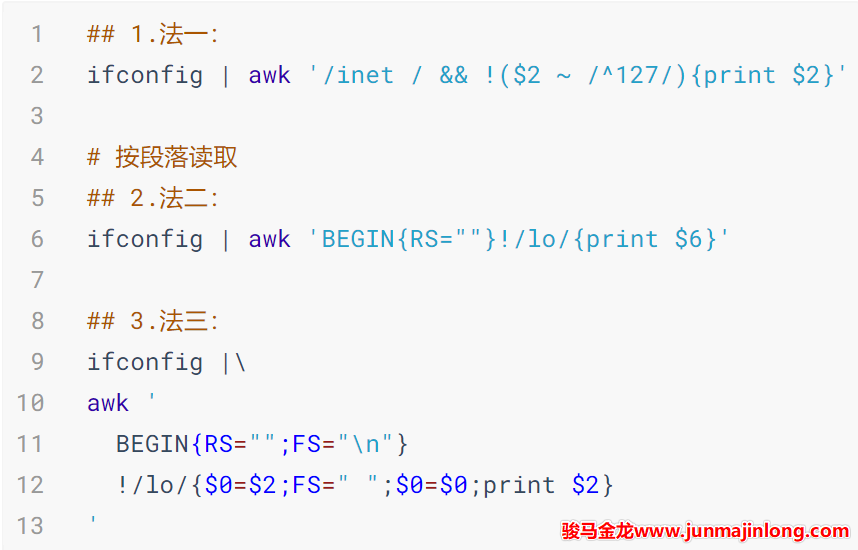

筛选IPv4地址

从ifconfig命令的结果中筛选出除了lo网卡外的所有IPv4地址。

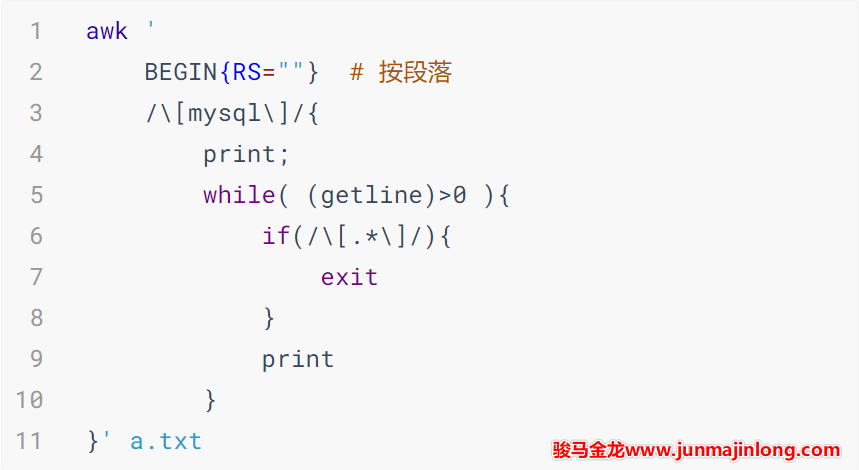

读取.ini配置文件中的某段

[base]name=os_repobaseurl=https://xxx/centos/$releasever/os/$basearchgpgcheck=0enable=1[mysql]name=mysql_repobaseurl=https://xxx/mysql-repo/yum/mysql-5.7-community/el/$releasever/$basearchgpgcheck=0enable=1[epel]name=epel_repobaseurl=https://xxx/epel/$releasever/$basearchgpgcheck=0enable=1[percona]name=percona_repobaseurl = https://xxx/percona/release/$releasever/RPMS/$basearchenabled = 1gpgcheck = 0

根据某字段去重

去掉uid=xxx重复的行。

2019-01-13_12:00_index?uid=1232019-01-13_13:00_index?uid=1232019-01-13_14:00_index?uid=3332019-01-13_15:00_index?uid=97102019-01-14_12:00_index?uid=1232019-01-14_13:00_index?uid=1232019-01-15_14:00_index?uid=3332019-01-16_15:00_index?uid=9710

awk -F"?" '!arr[$2]++{print}' a.txt

结果:

2019-01-13_12:00_index?uid=1232019-01-13_14:00_index?uid=3332019-01-13_15:00_index?uid=9710

次数统计

portmapperportmapperportmapperportmapperportmapperportmapperstatusstatusmountdmountdmountdmountdmountdmountdnfsnfsnfs_aclnfsnfsnfs_aclnlockmgrnlockmgrnlockmgrnlockmgrnlockmgr

awk '{arr[$1]++}END{OFS="\t";for(idx in arr){printf arr[idx],idx}}' a.txt

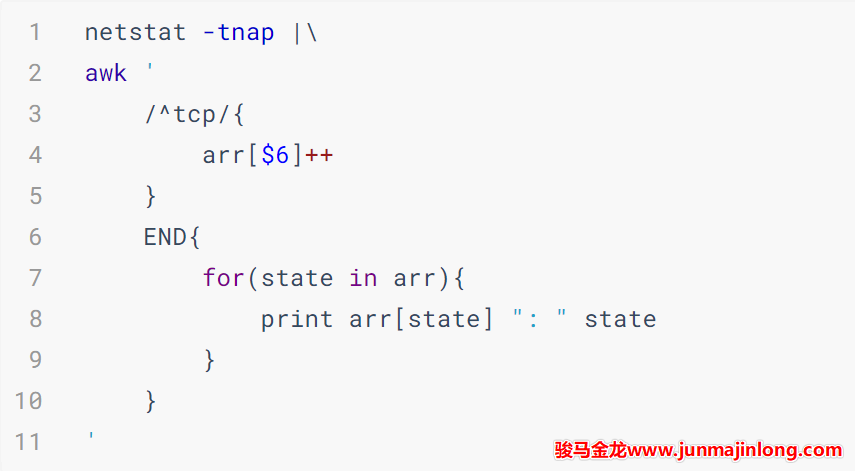

统计TCP连接状态数量

$ netstat -tnapProto Recv-Q Send-Q Local Address Foreign Address State PID/Program nametcp 0 0 0.0.0.0:22 0.0.0.0:* LISTEN 1139/sshdtcp 0 0 127.0.0.1:25 0.0.0.0:* LISTEN 2285/mastertcp 0 96 192.168.2.17:22 192.168.2.1:2468 ESTABLISHED 87463/sshd: root@pttcp 0 0 192.168.2017:22 192.168.201:5821 ESTABLISHED 89359/sshd: root@notcp6 0 0 :::3306 :::* LISTEN 2289/mysqldtcp6 0 0 :::22 :::* LISTEN 1139/sshdtcp6 0 0 ::1:25 :::* LISTEN 2285/master

统计得到的结果:

5: LISTEN2: ESTABLISHED

一行式:

netstat -tna | awk '/^tcp/{arr[$6]++}END{for(state in arr){print arr[state] ": " state}}'netstat -tna | /usr/bin/grep 'tcp' | awk '{print $6}' | sort | uniq -c

统计日志中各IP访问非200状态码的次数

日志示例数据:

111.202.100.141 - - [2019-11-07T03:11:02+08:00] "GET /robots.txt HTTP/1.1" 301 169

统计非200状态码的IP,并取次数最多的前10个IP。

# 法一awk '$8!=200{arr[$1]++}END{for(i in arr){print arr[i],i}}' access.log | sort -k1nr | head -n 10# 法二:awk '$8!=200{arr[$1]++}END{PROCINFO["sorted_in"]="@val_num_desc";for(i in arr){if(cnt++==10){exit}print arr[i],i}}' access.log

统计独立IP

url 访问IP 访问时间 访问人

a.com.cn|202.109.134.23|2015-11-20 20:34:43|guestb.com.cn|202.109.134.23|2015-11-20 20:34:48|guestc.com.cn|202.109.134.24|2015-11-20 20:34:48|guesta.com.cn|202.109.134.23|2015-11-20 20:34:43|guesta.com.cn|202.109.134.24|2015-11-20 20:34:43|guestb.com.cn|202.109.134.25|2015-11-20 20:34:48|guest

需求:统计每个URL的独立访问IP有多少个(去重),并且要为每个URL保存一个对应的文件,得到的结果类似:

a.com.cn 2b.com.cn 2c.com.cn 1

并且有三个对应的文件:

a.com.cn.txtb.com.cn.txtc.com.cn.txt

代码:

处理字段缺失的数据

ID name gender age email phone1 Bob male 28 abc@qq.com 180233940122 Alice female 24 def@gmail.com 180849252033 Tony male 21 170487925034 Kevin male 21 bbb@189.com 170239290335 Alex male 18 ccc@xyz.com 181859042306 Andy female ddd@139.com 189239023527 Jerry female 25 exdsa@189.com 187852349068 Peter male 20 bax@qq.com 177293487589 Steven 23 bc@sohu.com 1594789321210 Bruce female 27 bcbd@139.com 13942943905

当字段缺失时,直接使用FS划分字段来处理会非常棘手。gawk为了解决这种特殊需求,提供了FIELDWIDTHS变量。

FIELDWIDTH可以按照字符数量划分字段。

awk '{print $4}' FIELDWIDTHS="2 2:6 2:6 2:3 2:13 2:11" a.txt

处理字段中包含了字段分隔符的数据

下面是CSV文件中的一行,该CSV文件以逗号分隔各个字段。

Robbins,Arnold,"1234 A Pretty Street, NE",MyTown,MyState,12345-6789,USA

需求:取得第三个字段"1234 A Pretty Street, NE"。

当字段中包含了字段分隔符时,直接使用FS划分字段来处理会非常棘手。gawk为了解决这种特殊需求,提供了FPAT变量。

FPAT可以收集正则匹配的结果,并将它们保存在各个字段中。(就像grep匹配成功的部分会加颜色显示,而使用FPAT划分字段,则是将匹配成功的部分保存在字段$1 $2 $3...中)。

echo 'Robbins,Arnold,"1234 A Pretty Street, NE",MyTown,MyState,12345-6789,USA' |\awk 'BEGIN{FPAT="[^,]+|\".*\""}{print $1,$3}'

取字段中指定字符数量

16 001agdcdafasd16 002agdcxxxxxx23 001adfadfahoh23 001fsdadggggg

得到:

16 00116 00223 00123 002

awk '{print $1,substr($2,1,3)}'awk 'BEGIN{FIELDWIDTH="2 2:3"}{print $1,$2}' a.txt

行列转换

name agealice 21ryan 30

转换得到:

name alice ryanage 21 30

awk '{for(i=1;i<=NF;i++){if(!(i in arr)){arr[i]=$i} else {arr[i]=arr[i]" "$i}}}END{for(i=1;i<=NF;i++){print arr[i]}}' a.txt

行列转换2

文件内容:

74683 100174683 100274683 101174684 100074684 100174684 100274685 100174685 101174686 1000....100085 1000100085 1001

文件就两列,希望处理成

74683 1001 1002 101174684 1000 1001 1002...

就是只要第一列数字相同, 就把他们的第二列放一行上,中间空格分开

{if($1 in arr){arr[$1] = arr[$1]" "$2} else {arr[$1] = $2}}END{for(i in arr){printf "%s %s\n",i,arr[i]}}

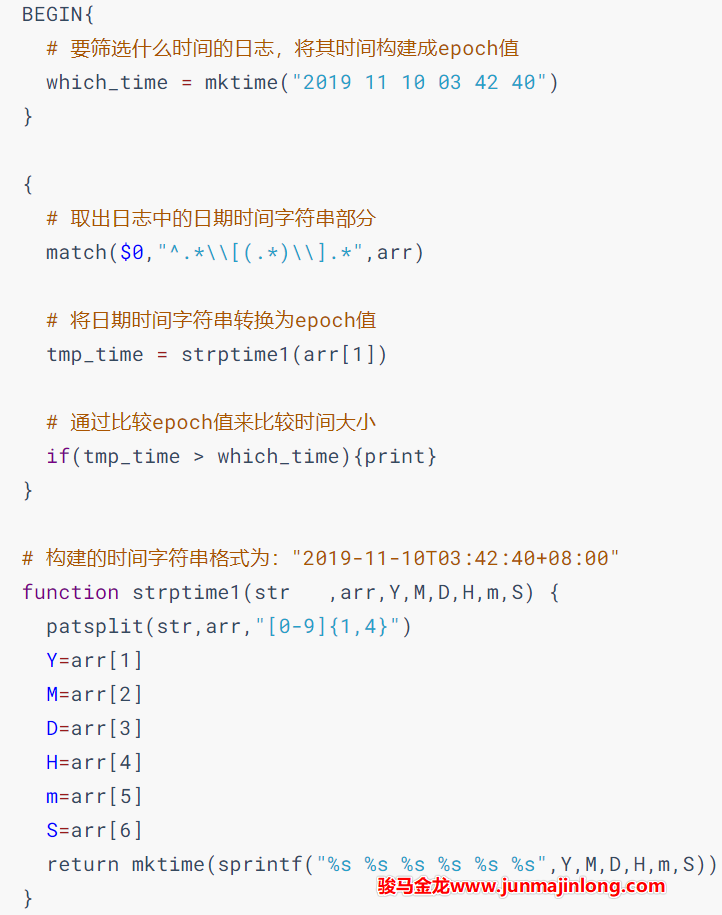

筛选给定时间范围内的日志

grep/sed/awk用正则去筛选日志时,如果要精确到小时、分钟、秒,则非常难以实现。

但是awk提供了mktime()函数,它可以将时间转换成epoch时间值。

# 2019-11-10 03:42:40转换成epoch$ awk 'BEGIN{print mktime("2019 11 10 03 42 40")}'1573328560

借此,可以取得日志中的时间字符串部分,再将它们的年、月、日、时、分、秒都取出来,然后放入mktime()构建成对应的epoch值。因为epoch值是数值,所以可以比较大小,从而决定时间的大小。

下面strptime1()实现的是将2019-11-10T03:42:40+08:00格式的字符串转换成epoch值,然后和which_time比较大小即可筛选出精确到秒的日志。

下面strptime2()实现的是将10/Nov/2019:23:53:44+08:00格式的字符串转换成epoch值,然后和which_time比较大小即可筛选出精确到秒的日志。

BEGIN{# 要筛选什么时间的日志,将其时间构建成epoch值which_time = mktime("2019 11 10 03 42 40")}{# 取出日志中的日期时间字符串部分match($0,"^.*\\[(.*)\\].*",arr)# 将日期时间字符串转换为epoch值tmp_time = strptime2(arr[1])# 通过比较epoch值来比较时间大小if(tmp_time > which_time){}}# 构建的时间字符串格式为:"10/Nov/2019:23:53:44+08:00"function strptime2(str ,dt_str,arr,Y,M,D,H,m,S) {dt_str = gensub("[/:+]"," ","g",str)# dt_sr = "10 Nov 2019 23 53 44 08 00"split(dt_str,arr," ")Y=arr[3]M=mon_map(arr[2])D=arr[1]H=arr[4]m=arr[5]S=arr[6]return mktime(sprintf("%s %s %s %s %s %s",Y,M,D,H,m,S))}function mon_map(str ,mons){mons["Jan"]=1mons["Feb"]=2mons["Mar"]=3mons["Apr"]=4mons["May"]=5mons["Jun"]=6mons["Jul"]=7mons["Aug"]=8mons["Sep"]=9mons["Oct"]=10mons["Nov"]=11mons["Dec"]=12return mons[str]}

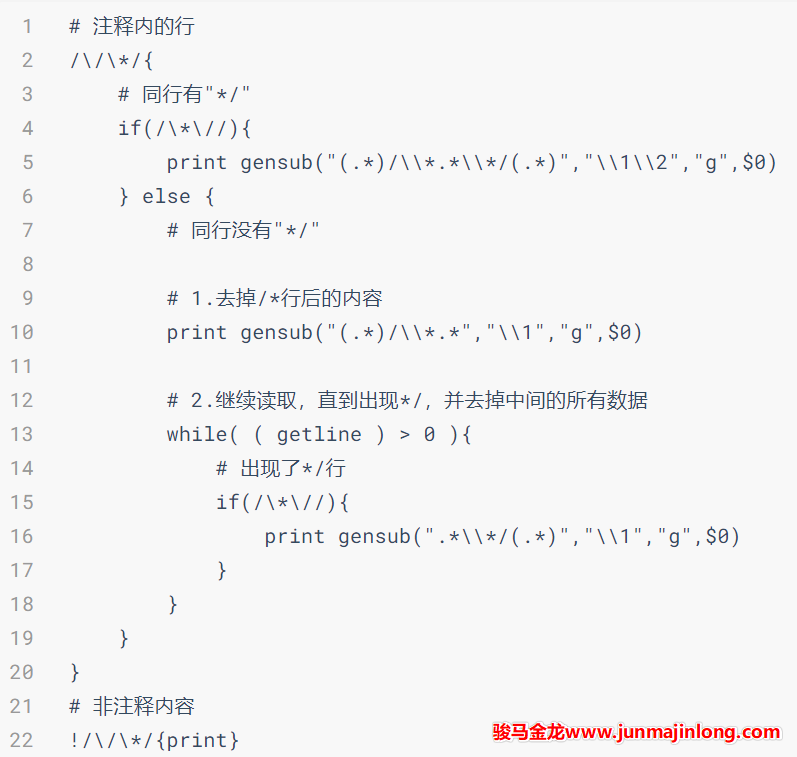

去掉/**/中间的注释

示例数据:

/*AAAAAAAAAA*/1111222/*aaaaaaaaa*/323231234123412134 /*bbbbbbbbbb*/ 13241214534122/*cccccccccc*/xxxxxx /*dddddddddddcccccccccceeeeeee*/ yyyyyyyy5642341

前后段落关系判断

从如下类型的文件中,找出false段的前一段为i-order的段,同时输出这两段。

2019-09-12 07:16:27 [-]['data' => ['http://192.168.100.20:2800/api/payment/i-order',],]2019-09-12 07:16:27 [-]['data' => [false,],]2019-09-21 07:16:27 [-]['data' => ['http://192.168.100.20:2800/api/payment/i-order',],]2019-09-21 07:16:27 [-]['data' => ['http://192.168.100.20:2800/api/payment/i-user',],]2019-09-17 18:34:37 [-]['data' => [false,],]

BEGIN{RS="]\n"ORS=RS}{if(/false/ && prev ~ /i-order/){print tmp}tmp=$0}

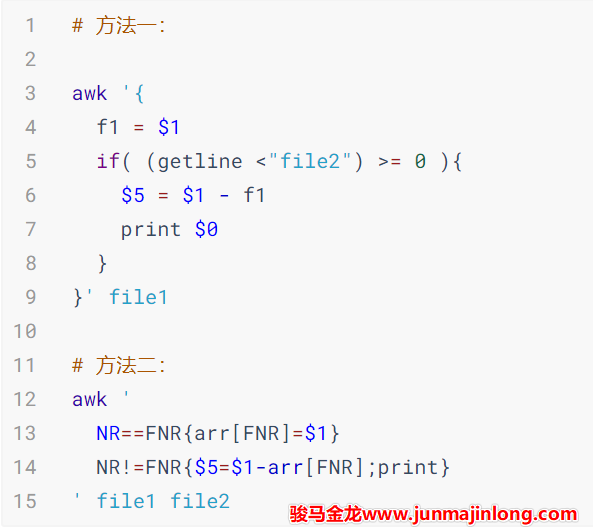

两个文件的处理

有两个文件file1和file2,这两个文件格式都是一样的。

需求:先把文件2的第五列删除,然后用文件2的第一列减去文件一的第一列,把所得结果对应的贴到原来第五列的位置,请问这个脚本该怎么编写?

file1:50.481 64.634 40.573 1.00 0.0051.877 65.004 40.226 1.00 0.0052.258 64.681 39.113 1.00 0.0052.418 65.846 40.925 1.00 0.0049.515 65.641 40.554 1.00 0.0049.802 66.666 40.358 1.00 0.0048.176 65.344 40.766 1.00 0.0047.428 66.127 40.732 1.00 0.0051.087 62.165 40.940 1.00 0.0052.289 62.334 40.897 1.00 0.00file2:48.420 62.001 41.252 1.00 0.0045.555 61.598 41.361 1.00 0.0045.815 61.402 40.325 1.00 0.0044.873 60.641 42.111 1.00 0.0044.617 59.688 41.648 1.00 0.0044.500 60.911 43.433 1.00 0.0043.691 59.887 44.228 1.00 0.0043.980 58.629 43.859 1.00 0.0042.372 60.069 44.032 1.00 0.0043.914 59.977 45.551 1.00 0.00

18个awk的经典实战案例的更多相关文章

- 3.awk数组详解及企业实战案例

awk数组详解及企业实战案例 3.打印数组: [root@nfs-server test]# awk 'BEGIN{array[1]="zhurui";array[2]=" ...

- (转)awk数组详解及企业实战案例

awk数组详解及企业实战案例 原文:http://www.cnblogs.com/hackerer/p/5365967.html#_label03.打印数组:1. [root@nfs-server t ...

- 企业Shell面试题及企业运维实战案例(三)

1.企业Shell面试题1:批量生成随机字符文件名案例 使用for循环在/oldboy目录下批量创建10个html文件,其中每个文件需要包含10个随机小写字母加固定字符串oldboy,名称示例如下: ...

- 使用MapReduce实现一些经典的案例

在工作中,很多时候都是用hive或pig来自动化执行mr统计,但是我们不能忘记原始的mr.本文记录了一些通过mr来完成的经典的案例,有倒排索引.数据去重等,需要掌握. 一.使用mapreduce实现倒 ...

- 如何从40亿整数中找到不存在的一个 webservice Asp.Net Core 轻松学-10分钟使用EFCore连接MSSQL数据库 WPF实战案例-打印 RabbitMQ与.net core(五) topic类型 与 headers类型 的Exchange

如何从40亿整数中找到不存在的一个 前言 给定一个最多包含40亿个随机排列的32位的顺序整数的顺序文件,找出一个不在文件中的32位整数.(在文件中至少确实一个这样的数-为什么?).在具有足够内存的情况 ...

- 基于SpringCloud的Microservices架构实战案例-架构拆解

自第一篇< 基于SpringCloud的Microservices架构实战案例-序篇>发表出来后,差不多有半年时间了,一直也没有接着拆分完,有如读本书一样,也是需要契机的,还是要把未完成的 ...

- Flume实战案例运维篇

Flume实战案例运维篇 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.Flume概述 1>.什么是Flume Flume是一个分布式.可靠.高可用的海量日志聚合系统,支 ...

- shell脚本编程——生产实战案例

生产实战案例 在日常的生产环境中,可能会遇到需要批量检查内网目前在线的主机IP地址有哪些,还可能需要检查这些在线的主机哪些端口是开放状态,因此依靠手工来检查是可以实现,但比较费时费力,所以需要 ...

- Jenkins 搭建企业实战案例 (发布与回滚)

让我们的代码部署变得easy,不再难,Jenkins是一个可扩展的持续集成引擎,是一个开源软件项目,旨在提供一个开放易用的软件平台,使软件的持续集成变成可能.Jenkins非常易于安装和配置,简单易用 ...

随机推荐

- Type of the default value for 'songs' prop must be a function

eslint常会出现这样的错误提示,控制台打印:Type of the default value for 'songs' prop must be a function 解决办法有两种如下: 1:写 ...

- 当node版本升级到8.0以上带来的问题

1.新增package-lock.json 2.相关babel更新 重新安装 $ npm install babel-preset-env --save-dev .babelrc文件修改 { + &q ...

- 一起来刷《剑指Offer》——不修改数组找出重复的数字(思路及Python实现)

数组中重复的数字 在上一篇博客中<剑指Offer>-- 题目一:找出数组中重复的数字(Python多种方法实现)中,其实能发现这类题目的关键就是一边遍历数组一边查满足条件的元素. 然后我们 ...

- 快速学习ggplot2

R语言里面一个比较重要的绘图包——ggplot2,是由Hadley Wickham于2005年创建,于2012年四月进行了重大更新,作者目前的工作是重写代码,简化语法,方便用户开发和使用.ggplot ...

- 自定义segue的方向

花了挺久时间,终于通过google在stake overflow上找到了解决方式. 总结一下:重写一个custom的segue,在storyboard的右边设置segue为custom,并设置其对应的 ...

- Unity3D图像后处理特效——Depth of Field 3.4

Depth of Field 3.4 is a common postprocessing effect that simulates the properties of a camera lens. ...

- Method Not Allowed (GET): /boxuegos/index/ 错误

1,Method Not Allowed (GET) 请求方法不被允许, 错误原因:我调用的是index这个方法,但是我上面定义了一个空的子路由,所以页面加载不了,控制台出现Method Not Al ...

- 数据文件包解析工具类 RandomAccessFile

public class ReadTextFile { public static void main(String[] args) { pic2txt(); parseFrmFile(); //ur ...

- 创建WebApi

一.创建 Web 项目 使用vs创建项目,选择“ASP.NET Core Web 应用程序”模板,将项目命名为 TodoApi,然后单击“确定”. 在“新建 ASP.NET Core Web 应用程序 ...

- QHDYZ模拟赛20191027 提前透题

你们想的美 我给你们透一下题目名称 别刷博客了快去做题