《Python》线程池、携程

一、线程池(concurrent.futures模块)

#1 介绍

concurrent.futures模块提供了高度封装的异步调用接口

ThreadPoolExecutor:线程池,提供异步调用

ProcessPoolExecutor: 进程池,提供异步调用

Both implement the same interface, which is defined by the abstract Executor class. #2 基本方法

#submit(fn, *args, **kwargs)

异步提交任务 #map(func, *iterables, timeout=None, chunksize=1)

取代for循环submit的操作 #shutdown(wait=True)

相当于进程池的pool.close()+pool.join()操作

wait=True,等待池内所有任务执行完毕回收完资源后才继续

wait=False,立即返回,并不会等待池内的任务执行完毕

但不管wait参数为何值,整个程序都会等到所有任务执行完毕

submit和map必须在shutdown之前 #result(timeout=None)

取得结果 #add_done_callback(fn)

回调函数

import time

from concurrent.futures import ThreadPoolExecutor, ProcessPoolExecutor def func(i):

print('thread', i)

time.sleep(1)

print('thread %s end' % i) # 线程池,提供异步调用

tp = ThreadPoolExecutor(5)

tp.submit(func, 1)

tp.shutdown()

print('主线程') # 进程池,提供异步调用

if __name__ == '__main__':

tp = ProcessPoolExecutor(5)

tp.submit(func, 1)

tp.shutdown()

print('主线程')

import time

from concurrent.futures import ThreadPoolExecutor

from threading import current_thread def func(i):

print('thread', i, current_thread().ident)

time.sleep(1)

print('thread %s end' % i) tp = ThreadPoolExecutor(5)

for i in range(20):

tp.submit(func, i)

tp.shutdown()

print('主线程') # 获取返回值

import time

from concurrent.futures import ThreadPoolExecutor

from threading import current_thread def func(i):

print('thread', i, current_thread().ident)

time.sleep(1)

print('thread %s end' % i)

return i * '*' tp = ThreadPoolExecutor(5)

ret_l = []

for i in range(20):

ret = tp.submit(func, i)

ret_l.append(ret)

for ret in ret_l:

print(ret.result())

print('主线程')

# map的用法

import time

from concurrent.futures import ThreadPoolExecutor def func(i):

print('thread', i)

time.sleep(1)

print('thread %s end' % i)

return i * '*' tp = ThreadPoolExecutor(5)

res = tp.map(func, range(20))

for i in res:

print(i)

# 回调函数

import time

import os

from concurrent.futures import ThreadPoolExecutor, ProcessPoolExecutor

from threading import current_thread def func(i):

print('thread', i, current_thread().ident, os.getpid())

time.sleep(1)

print('thread %s end' % i)

return i * '*' def call_back(arg):

print('call back : ', current_thread().ident, os.getpid())

print('ret : ', arg.result())

# 线程池的回调函数是由子线程完成的

tp = ThreadPoolExecutor(5)

ret_l = []

for i in range(20):

tp.submit(func, i).add_done_callback(call_back)

print('主线程', current_thread().ident, os.getpid())

# 进程池的回调函数是由主进程完成的

if __name__ == '__main__':

tp = ProcessPoolExecutor(5)

ret_l = []

for i in range(20):

tp.submit(func, i).add_done_callback(call_back)

print('主线程', current_thread().ident, os.getpid())

二、协程

之前我们学习了线程、进程的概念,了解了在操作系统中进程是资源分配的最小单位,线程是CPU调度的最小单位。按道理来说我们已经算是把cpu的利用率提高很多了。但是我们知道无论是创建多进程还是创建多线程来解决问题,都要消耗一定的时间来创建进程、创建线程、以及管理他们之间的切换。

随着我们对于效率的追求不断提高,基于单线程来实现并发又成为一个新的课题,即只用一个主线程(很明显可利用的cpu只有一个)情况下实现并发。这样就可以节省创建线进程所消耗的时间。

为此我们需要先回顾下并发的本质:切换+保存状态

cpu正在运行一个任务,会在两种情况下切走去执行其他的任务(切换由操作系统强制控制),一种情况是该任务发生了阻塞,另外一种情况是该任务计算的时间过长

ps:在介绍进程理论时,提及进程的三种执行状态,而线程才是执行单位,所以也可以将上图理解为线程的三种状态

一:其中第二种情况并不能提升效率,只是为了让cpu能够雨露均沾,实现看起来所有任务都被“同时”执行的效果,如果多个任务都是纯计算的,这种切换反而会降低效率。

为此我们可以基于yield来验证。yield本身就是一种在单线程下可以保存任务运行状态的方法,我们来简单复习一下:

# 1. yiled可以保存状态,yield的状态保存与操作系统的保存线程状态很像,但是yield是代码级别控制的,更轻量级

# 2. send可以把一个函数的结果传给另外一个函数,以此实现单线程内程序之间的切换

# 串行执行

import time

def consumer(res):

'''任务1:接收数据,处理数据'''

pass def producer():

'''任务2:生产数据'''

res=[]

for i in range(10000000):

res.append(i)

return res start=time.time()

# 串行执行

res=producer()

consumer(res) # 写成consumer(producer())会降低执行效率

stop=time.time()

print(stop-start) # 1.5536692142486572 #基于yield并发执行

import time

def consumer():

'''任务1:接收数据,处理数据'''

while True:

x=yield def producer():

'''任务2:生产数据'''

g=consumer()

next(g)

for i in range(10000000):

g.send(i) start=time.time()

# 基于yield保存状态,实现两个任务直接来回切换,即并发的效果

# PS:如果每个任务中都加上打印,那么明显地看到两个任务的打印是你一次我一次,即并发执行的.

producer() stop=time.time()

print(stop-start) #2.0272178649902344

单纯地切换反而会降低运行效率

二:第一种情况的切换。在任务一遇到io情况下,切到任务二去执行,这样就可以利用任务一阻塞的时间完成任务二的计算,效率的提升就在于此。

import time

def consumer():

'''任务1:接收数据,处理数据'''

while True:

x=yield def producer():

'''任务2:生产数据'''

g=consumer()

next(g)

for i in range(10000000):

g.send(i)

time.sleep(2) start=time.time()

producer() # 并发执行,但是任务producer遇到io就会阻塞住,并不会切到该线程内的其他任务去执行 stop=time.time()

print(stop-start)

yield无法做到遇到io阻塞

对于单线程下,我们不可避免程序中出现io操作,但如果我们能在自己的程序中(即用户程序级别,而非操作系统级别)控制单线程下的多个任务能在一个任务遇到io阻塞时就切换到另外一个任务去计算,这样就保证了该线程能够最大限度地处于就绪态,即随时都可以被cpu执行的状态,相当于我们在用户程序级别将自己的io操作最大限度地隐藏起来,从而可以迷惑操作系统,让其看到:该线程好像是一直在计算,io比较少,从而更多的将cpu的执行权限分配给我们的线程。

协程的本质就是在单线程下,由用户自己控制一个任务遇到io阻塞了就切换另外一个任务去执行,以此来提升效率。为了实现它,我们需要找寻一种可以同时满足以下条件的解决方案:

# 1. 可以控制多个任务之间的切换,切换之前将任务的状态保存下来,以便重新运行时,可以基于暂停的位置继续执行。

# 2. 作为1的补充:可以检测io操作,在遇到io操作的情况下才发生切换

协程介绍:

协程:是单线程下的并发,又称微线程,纤程。英文名Coroutine。一句话说明什么是线程:协程是一种用户态的轻量级线程,即协程是由用户程序自己控制调度的。

需要强调的是:

#1. python的线程属于内核级别的,即由操作系统控制调度(如单线程遇到io或执行时间过长就会被迫交出cpu执行权限,切换其他线程运行)

#2. 单线程内开启协程,一旦遇到io,就会从应用程序级别(而非操作系统)控制切换,以此来提升效率(!!!非io操作的切换与效率无关)

对比操作系统控制线程的切换,用户在单线程内控制协程的切换

优点如下:

#1. 协程的切换开销更小,属于程序级别的切换,操作系统完全感知不到,因而更加轻量级

#2. 单线程内就可以实现并发的效果,最大限度地利用cpu

缺点如下:

#1. 协程的本质是单线程下,无法利用多核,可以是一个程序开启多个进程,每个进程内开启多个线程,每个线程内开启协程

#2. 协程指的是单个线程,因而一旦协程出现阻塞,将会阻塞整个线程

总结协程特点:

- 必须在只有一个单线程里实现并发

- 修改共享数据不需加锁

- 用户程序里自己保存多个控制流的上下文栈

- 附加:一个协程遇到IO操作自动切换到其它协程(如何实现检测IO,yield、greenlet都无法实现,就用到了gevent模块(select机制))

Greenlet 模块

安装 :pip3 install greenlet

# greenlet实现状态切换 import time

from greenlet import greenlet def eat():

print('eating 1')

g2.switch()

time.sleep(1)

print('eating 2') def play():

print('playing 1')

time.sleep(1)

print('playing 2')

g1.switch() g1 = greenlet(eat)

g2 = greenlet(play)

g1.switch()

单纯的切换(在没有io的情况下或者没有重复开辟内存空间的操作),反而会降低程序的执行速度

# 顺序执行

import time

def f1():

res=1

for i in range(100000000):

res+=i def f2():

res=1

for i in range(100000000):

res*=i start=time.time()

f1()

f2()

stop=time.time()

print('run time is %s' %(stop-start)) #10.985628366470337 # 切换

from greenlet import greenlet

import time

def f1():

res=1

for i in range(100000000):

res+=i

g2.switch() def f2():

res=1

for i in range(100000000):

res*=i

g1.switch() start=time.time()

g1=greenlet(f1)

g2=greenlet(f2)

g1.switch()

stop=time.time()

print('run time is %s' %(stop-start)) # 52.763017892837524

效率对比

greenlet只是提供了一种比generator更加便捷的切换方式,当切到一个任务执行时如果遇到io,那就原地阻塞,仍然是没有解决遇到IO自动切换来提升效率的问题。

单线程里的这20个任务的代码通常会既有计算操作又有阻塞操作,我们完全可以在执行任务1时遇到阻塞,就利用阻塞的时间去执行任务2。。。。如此,才能提高效率,这就用到了Gevent模块。

Gevent 模块

安装:pip3 install gevent

Gevent 是一个第三方库,可以轻松通过gevent实现并发同步或异步编程,在gevent中用到的主要模式是Greenlet, 它是以C扩展模块形式接入Python的轻量级协程。 Greenlet全部运行在主程序操作系统进程的内部,但它们被协作式地调度。

g1=gevent.spawn(func,1,,2,3,x=4,y=5) # 创建一个协程对象g1,spawn括号内第一个参数是函数名,如eat,后面可以有多个参数,可以是位置实参或关键字实参,都是传给函数eat的 g2=gevent.spawn(func2) g1.join() # 等待g1结束 g2.join() # 等待g2结束 # 或者上述两步合作一步:gevent.joinall([g1,g2]) g1.value # 拿到func1的返回值

import time

import gevent def eat():

print('eating 1')

# time.sleep(1)

gevent.sleep(1) # 改成这样就能认识了

print('eating 2') def play():

print('playing 1')

# time.sleep(1)

gevent.sleep(1) # 改成这样就能认识了

print('playing 2') g1 = gevent.spawn(eat) # 自动的检测事件,遇见阻塞了就会进行切换,有些阻塞它不认识

g2 = gevent.spawn(play)

g1.join() # 阻塞直到g1结束

g2.join() # 阻塞直到g2结束

# gevent.joinall([g1, g2]) # 这样也可以

上例gevent.sleep(1)模拟的是gevent可以识别的io阻塞,而time.sleep(1)或其他的阻塞,gevent是不能直接识别的需要用下面一行代码,打补丁,就可以识别了

from gevent import monkey;monkey.patch_all() 必须放到被打补丁者的前面,如time,socket模块之前

或者我们干脆记忆成:要用gevent,需要将from gevent import monkey;monkey.patch_all() 放到文件的开头

from gevent import monkey;monkey.patch_all() # 要放在最上面

import time

import gevent def eat():

print('eating 1')

time.sleep(1)

print('eating 2') def play():

print('playing 1')

time.sleep(1)

print('playing 2') g1 = gevent.spawn(eat) # 自动的检测阻塞事件,遇见阻塞了就会进行切换

g2 = gevent.spawn(play)

g1.join() # 阻塞直到g1结束

g2.join() # 阻塞直到g2结束

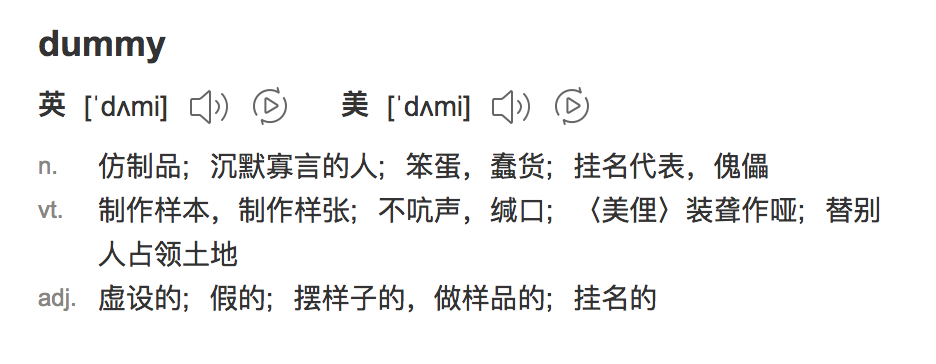

我们可以用threading.current_thread().getName()来查看每个g1和g2,查看的结果为DummyThread-n,即假线程

from gevent import monkey;monkey.patch_all()

import threading

import gevent

import time def eat():

print(threading.current_thread().getName())

print('eat food 1')

time.sleep(2)

print('eat food 2') def play():

print(threading.current_thread().getName())

print('play 1')

time.sleep(1)

print('play 2') g1=gevent.spawn(eat)

g2=gevent.spawn(play)

gevent.joinall([g1,g2])

print('主')

查看threading.current_thread().getName()

# Gevent 之同步与异步 from gevent import spawn,joinall,monkey;monkey.patch_all() import time

def task(pid):

"""

Some non-deterministic task

"""

time.sleep(0.5)

print('Task %s done' % pid) def synchronous(): # 同步

for i in range(10):

task(i) def asynchronous(): # 异步

g_l=[spawn(task,i) for i in range(10)]

joinall(g_l)

print('DONE') if __name__ == '__main__':

print('Synchronous:')

synchronous()

print('Asynchronous:')

asynchronous()

# 上面程序的重要部分是将task函数封装到Greenlet内部线程的gevent.spawn。

# 初始化的greenlet列表存放在数组threads中,此数组被传给gevent.joinall 函数,

# 后者阻塞当前流程,并执行所有给定的greenlet任务。执行流程只会在 所有greenlet执行完后才会继续向下走。

from gevent import monkey;monkey.patch_all()

import time

import gevent

import requests url_lst = [

'http://www.baidu.com',

'http://www.4399.com',

'http://www.7k7k.com',

'http://www.sogou.com',

'http://www.sohu.com',

'http://www.sina.com',

'http://www.jd.com',

'http://www.luffycity.com/home',

'http://www.douban.com',

'http://cnblogs.com/Eva-J/articles/8324673.html'

] def get_url(url):

response = requests.get(url)

if response.status_code == 200:

print(url, len(response.text)) # 普通方法

start = time.time()

for url in url_lst:

get_url(url)

print(time.time() - start) # 通过协程实现

start = time.time()

g_lst = []

for url in url_lst:

g = gevent.spawn(get_url, url)

g_lst.append(g)

gevent.joinall(g_lst)

print(time.time() - start)

协程应用:爬虫

通过gevent实现单线程下的socket并发

注意 :from gevent import monkey;monkey.patch_all()一定要放到导入socket模块之前,否则gevent无法识别socket的阻塞

from gevent import monkey;monkey.patch_all()

from socket import *

import gevent #如果不想用money.patch_all()打补丁,可以用gevent自带的socket

# from gevent import socket

# s=socket.socket() def server(server_ip,port):

s=socket(AF_INET,SOCK_STREAM)

s.setsockopt(SOL_SOCKET,SO_REUSEADDR,1)

s.bind((server_ip,port))

s.listen(5)

while True:

conn,addr=s.accept()

gevent.spawn(talk,conn,addr) def talk(conn,addr):

try:

while True:

res=conn.recv(1024)

print('client %s:%s msg: %s' %(addr[0],addr[1],res))

conn.send(res.upper())

except Exception as e:

print(e)

finally:

conn.close() if __name__ == '__main__':

server('127.0.0.1',8080)

server

from socket import * client=socket(AF_INET,SOCK_STREAM)

client.connect(('127.0.0.1',8080)) while True:

msg=input('>>: ').strip()

if not msg:continue client.send(msg.encode('utf-8'))

msg=client.recv(1024)

print(msg.decode('utf-8'))

client

from threading import Thread

from socket import *

import threading def client(server_ip,port):

c=socket(AF_INET,SOCK_STREAM) #套接字对象一定要加到函数内,即局部名称空间内,放在函数外则被所有线程共享,则大家公用一个套接字对象,那么客户端端口永远一样了

c.connect((server_ip,port)) count=0

while True:

c.send(('%s say hello %s' %(threading.current_thread().getName(),count)).encode('utf-8'))

msg=c.recv(1024)

print(msg.decode('utf-8'))

count+=1

if __name__ == '__main__':

for i in range(500):

t=Thread(target=client,args=('127.0.0.1',8080))

t.start()

多线程并发多个客户端

《Python》线程池、携程的更多相关文章

- 进程、线程和携程的通俗解释【刘新宇Python】

通过下面这张图你就能看清楚了,进程.线程和携程的关系 进程: 多个进程是可以运行在多个CPU当中的,比如你的电脑是4核,可以同时并行运行四个进程,这是真正物理上的并行运行. 线程: 每个进程又可以 ...

- Python线程池与进程池

Python线程池与进程池 前言 前面我们已经将线程并发编程与进程并行编程全部摸了个透,其实我第一次学习他们的时候感觉非常困难甚至是吃力.因为概念实在是太多了,各种锁,数据共享同步,各种方法等等让人十 ...

- 自定义高级版python线程池

基于简单版创建类对象过多,现自定义高级版python线程池,代码如下 #高级线程池 import queue import threading import time StopEvent = obje ...

- 对Python线程池

本文对Python线程池进行详细说明介绍,IDE选择及编码的解决方案进行了一番详细的描述,实为Python初学者必读的Python学习经验心得. AD: 干货来了,不要等!WOT2015 北京站演讲P ...

- Python 线程池(小节)

Python 线程池(小节) from concurrent.futures import ThreadPoolExecutor,ProcessPoolExecutor import os,time, ...

- python线程池ThreadPoolExecutor(上)(38)

在前面的文章中我们已经介绍了很多关于python线程相关的知识点,比如 线程互斥锁Lock / 线程事件Event / 线程条件变量Condition 等等,而今天给大家讲解的是 线程池ThreadP ...

- python线程池及其原理和使用

python线程池及其原理和使用 2019-05-29 17:05:20 whatday 阅读数 576 系统启动一个新线程的成本是比较高的,因为它涉及与操作系统的交互.在这种情形下,使用线程池可以很 ...

- python线程池示例

使用with方式创建线程池,任务执行完毕之后,会自动关闭资源 , 否则就需要手动关闭线程池资源 import threading, time from concurrent.futures impo ...

- Python 线程池,进程池,协程,和其他

本节内容 线程池 进程池 协程 try异常处理 IO多路复用 线程的继承调用 1.线程池 线程池帮助你来管理线程,不再需要每个任务都创建一个线程进行处理任务. 任务需要执行时,会从线程池申请线程,有则 ...

- python全栈开发 * 线程队列 线程池 协程 * 180731

一.线程队列 队列:1.Queue 先进先出 自带锁 数据安全 from queue import Queue from multiprocessing import Queue (IPC队列)2.L ...

随机推荐

- tcpdump使用方法总结

举例: 1.针对指定网卡eth0抓包 tcpdump -i eth0 2.过滤主机 tcpdump -i eth0 host 192.168.1.1 tcpdump -i eth0 src host ...

- 雇佣K个工人的最小费用 Minimum Cost to Hire K Workers

2018-10-06 20:17:30 问题描述: 问题求解: 问题规模是10000,已经基本说明是O(nlogn)复杂度的算法,这个复杂度最常见的就是排序算法了,本题确实是使用排序算法来进行进行求解 ...

- PHP如何安装redis扩展(Windows下)

PHP如何安装redis扩展(Windows下) 一.总结 一句话总结:下载扩展的dll,放入指定文件夹(php对应的扩展的目录php/ext),在配置文件php.ini中注册dll 尽量不要选择最新 ...

- MySQL命令行的备份与还原

备份的语法; mysqldump -uroot -p shop> 数据库路径 还原的语法: mysql -uroot -p 具体数据库(shop0609)< 数据库路径

- nginx ----> nginx配置/反向代理/负载均衡

nginx [engine x]是一个HTTP和反向代理服务器,一个邮件代理服务器和一个通用的TCP/UDP代理服务器,最初由Igor Sysoev编写. 环境: Ubuntu16.04 安装ngin ...

- WPF——UI布局

1.规划整体布局(规划界面结构)——>这样就可以划分出若干区域(区域的控件通常是一些容器控件) 2.针对 上面的 “若干区域” ,制作每个区域的一级用户控件(然后,将该用户控件放入对应的区域中) ...

- OnSen UI结合AngularJs打造”美团"APP"订单”页面 --Hybrid App

1.页面效果图: 演示链接地址:http://www.nxl123.cn/bokeyuan/meiTuanDemo_order/ 2.核心代码 order.html: <ons-page id= ...

- OPSF - 2,状态机

1,报文更新地址 点到点:所有报文发送224.0.0.5 虚链路:单播地址 广播网络上:DR OTHER至DR/BDR 224.0.0.6,DR/BDR至DR OTEHER 2 ...

- Lab 1-1

LABS The purpose of the labs is to give you an opportunity to practice the skills taught in the chap ...

- 『Yaml』配置文件读写包

YAML 在Python中的配置应用 YAML 是专门用来写配置文件的语言,和JSON相近,都是对字典做规范化文件输出的 一.简介 YAML 语言(发音 /ˈjæməl/ )的设计目标,就是方便人类读 ...