CUDA[2] Hello,World

Section 0:Hello,World

这次我们亲自尝试一下如何用粗(CU)大(DA)写程序

CUDA最新版本是7.5,然而即使是最新版本也不兼容VS2015 。。。推荐使用VS2012

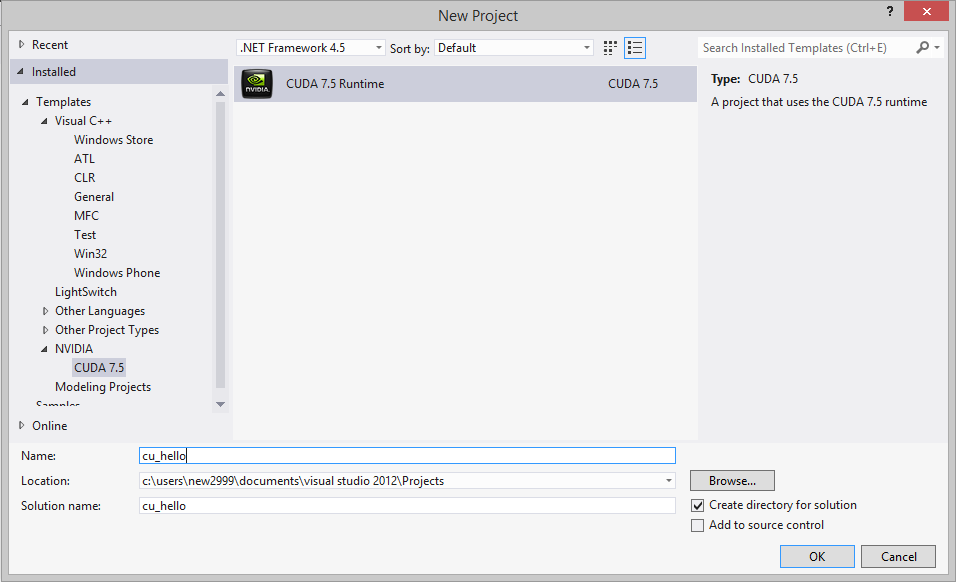

进入VS2012,新建工程,选择NVIDIA--CUDA Runtime

我们来写一个简单的向量加法程序:[Reference]

#include <stdio.h> __global__ void saxpy(int n, float a, float *x, float *y)

//__global__关键字,表示是将要在GPU里并行运行的核函数

{

int i = blockIdx.x*blockDim.x + threadIdx.x;

if (i < n)

y[i] = a*x[i] + y[i];

} int main()

{

int N = ;

float *x, *y, *d_x, *d_y; //都是指针,指向数组所在的内存/显存空间

x = (float*)malloc(N*sizeof(float)); //在内存中为x,y分配空间

y = (float*)malloc(N*sizeof(float)); cudaMalloc(&d_x, N*sizeof(float)); //在显存中为d_x,d_y分配空间

cudaMalloc(&d_y, N*sizeof(float)); for (int i = ; i < N; i++)

{

x[i] = (float)i;

y[i] = 2.0f;

} cudaMemcpy(d_x, x, N*sizeof(float), cudaMemcpyHostToDevice);

cudaMemcpy(d_y, y, N*sizeof(float), cudaMemcpyHostToDevice);

//将内存中x,y指向的数组空间拷贝到显存中d_x,d_y指向的数组空间 saxpy<<<,N>>>(N, 10.0f, d_x, d_y);

//1个block,每个block里N个thread cudaMemcpy(y, d_y, N*sizeof(float), cudaMemcpyDeviceToHost);

//将显存中计算好的d_y指向的数组空间拷贝到内存中y指向的数组空间 for (int i = ; i < N; i++)

printf("%d %.3f\n",i,y[i]); getchar();

}

运行后就会出结果啦~

Section 1:一个好一点的代码风格

虽然刚才的程序已经能运行了,但是讲道理的话把所有的代码都写到cu文件里是很屎的风格。。。

下面再来写一个向量加法的程序:[Ref]

/* kernel.cu */

//cuda系函数必须放在cu文件里

#include "cuda_runtime.h"

#include "device_launch_parameters.h" #include <stdio.h> __global__ void addKernel(int *c, const int *a, const int *b)

{

int i = threadIdx.x;

c[i] = a[i] + b[i];

} //cpp中不能直接调用核函数,所以在cu文件中还得写一个接口,负责分配内存等

void addWithCuda(int *c, const int *a, const int *b, unsigned int size)

{

int *dev_a = ;

int *dev_b = ;

int *dev_c = ; // Choose which GPU to run on, change this on a multi-GPU system.

cudaSetDevice(); // Allocate GPU buffers for three vectors (two input, one output) .

cudaMalloc((void**)&dev_c, size * sizeof(int));

cudaMalloc((void**)&dev_a, size * sizeof(int));

cudaMalloc((void**)&dev_b, size * sizeof(int)); // Copy input vectors from host memory to GPU buffers.

cudaMemcpy(dev_a, a, size * sizeof(int), cudaMemcpyHostToDevice);

cudaMemcpy(dev_b, b, size * sizeof(int), cudaMemcpyHostToDevice); // Launch a kernel on the GPU with one thread for each element.

addKernel<<<, size>>>(dev_c, dev_a, dev_b); // Copy output vector from GPU buffer to host memory.

cudaMemcpy(c, dev_c, size * sizeof(int), cudaMemcpyDeviceToHost); cudaFree(dev_c);

cudaFree(dev_a);

cudaFree(dev_b);

cudaDeviceReset();

} //-------------------------------------------------------------------------------

/* Source.cpp */

#include"cstdio"

#include"cstring" extern void addWithCuda(int *c, const int *a, const int *b, unsigned int size);

//.cpp是由C编译器来编译的。C编译器里不允许#include一个cu文件(不资词)

//若要引用cu里的函数,在main.cpp里外部extern声明一下,让VS转为NVCC编译器处理。 int main()

{

const int arraySize = ;

const int a[arraySize] = { , , , , };

const int b[arraySize] = { , , , , };

int c[arraySize] = { }; addWithCuda(c, a, b, arraySize); printf("{1,2,3,4,5} + {10,20,30,40,50} = {%d,%d,%d,%d,%d}\n",

c[], c[], c[], c[], c[]); getchar(); return ;

}

补充:对于一些计算量较大(GPU计算时间较长)的程序,有可能运行很短时间之后就崩溃掉,并出现“显卡驱动已停止”的提示。

这是因为驱动程序默认认为GPU只负责图形计算任务,如果有任务长时间占用GPU就会自动terminate掉。

解决方法如下:[Ref]

进入注册表->HKEY_LOCAL_MACHINE->System->CurrentControlSet->Control->GraphicsDrivers

新建DWORD键TdrLevel,键值为0。保存重启即可。

Section 2:还是要学习一个

下面系统介绍一下粗大里的关键字和规则:

[Ref]

__global__:kernel函数。在device(GPU)里运行。可以在host(CPU处的主程序)调用

__device__:只允许在device运行,在device调用

__constant__:constant memory,表示常量

__shared__:shared memory,block内共享的变量

CUDA[2] Hello,World的更多相关文章

- CUDA[1] Introductory

Section 0 :Induction of CUDA CUDA是啥?CUDA®: A General-Purpose Parallel Computing Platform and Program ...

- Couldn't open CUDA library cublas64_80.dll etc. tensorflow-gpu on windows

I c:\tf_jenkins\home\workspace\release-win\device\gpu\os\windows\tensorflow\stream_executor\dso_load ...

- ubuntu 16.04 + N驱动安装 +CUDA+Qt5 + opencv

Nvidia driver installation(after download XX.run installation file) 1. ctrl+Alt+F1 //go to virtual ...

- 手把手教你搭建深度学习平台——避坑安装theano+CUDA

python有多混乱我就不多说了.这个混论不仅是指整个python市场混乱,更混乱的还有python的各种附加依赖包.为了一劳永逸解决python的各种依赖包对深度学习造成的影响,本文中采用pytho ...

- [CUDA] CUDA to DL

又是一枚祖国的骚年,阅览做做笔记:http://www.cnblogs.com/neopenx/p/4643705.html 这里只是一些基础知识.帮助理解DL tool的实现. “这也是深度学习带来 ...

- 基于Ubuntu14.04系统的nvidia tesla K40驱动和cuda 7.5安装笔记

基于Ubuntu14.04系统的nvidia tesla K40驱动和cuda 7.5安装笔记 飞翔的蜘蛛人 注1:本人新手,文章中不准确的地方,欢迎批评指正 注2:知识储备应达到Linux入门级水平 ...

- CUDA程序设计(一)

为什么需要GPU 几年前我启动并主导了一个项目,当时还在谷歌,这个项目叫谷歌大脑.该项目利用谷歌的计算基础设施来构建神经网络. 规模大概比之前的神经网络扩大了一百倍,我们的方法是用约一千台电脑.这确实 ...

- 使用 CUDA范例精解通用GPU编程 配套程序的方法

用vs新建一个cuda的项目,然后将系统自动生成的那个.cu里头的内容,除了头文件引用外,全部替代成先有代码的内容. 然后程序就能跑了. 因为新建的是cuda的项目,所以所有的头文件和库的引用系统都会 ...

- CUDA代码移植

如果CUDA的代码移植,一个是要 include文件夹对不对,这个是.h文件能否找到的关键,另一个就是lib,这个是.lib文件能否找到的关键.具体检查地方,见下头. include: lib:

随机推荐

- jQuery+css3侧边栏导航菜单

效果体验:http://hovertree.com/texiao/jquery/37/ 代码如下: <!doctype html> <html lang="zh" ...

- 【shadow dom入UI】web components思想如何应用于实际项目

回顾 经过昨天的优化处理([前端优化之拆分CSS]前端三剑客的分分合合),我们在UI一块做了几个关键动作: ① CSS入UI ② CSS作为组件的一个节点而存在,并且会被“格式化”,即选择器带id前缀 ...

- Lucene的分析资料【转】

Lucene 源码剖析 1 目录 2 Lucene是什么 2.1.1 强大特性 2.1.2 API组成- 2.1.3 Hello World! 2.1.4 Lucene roadmap 3 索引文件结 ...

- 用NSAttributedString实现简单的图文混排

iOS7以后,因为TextKit的强大,可以用NSAttributedString很方便的实现图文混排(主要是利用了NSTextAttachment). 关于Textkit的牛逼之处,可以参考objc ...

- Andriod 自定义控件之创建可以复用的组合控件

前面已学习了一种自定义控件的实现,是Andriod 自定义控件之音频条,还没学习的同学可以学习下,学习了的同学也要去温习下,一定要自己完全的掌握了,再继续学习,贪多嚼不烂可不是好的学习方法,我们争取学 ...

- 如何用Github版本控制非Github库

Git的图形化客户端有很多,不同的人可能习惯用不同的客户端.本人更习惯于Github的客户端,因为上Github比较多,同步代码到Github用官方的客户端是最方便的,所以也就更习惯于使用Github ...

- iOS系列 基础篇 05 视图鼻祖 - UIView

iOS系列 基础篇 05 视图鼻祖 - UIView 目录: UIView“家族” 应用界面的构建层次 视图分类 最后 在Cocoa和Cocoa Touch框架中,“根”类时NSObject类.同样, ...

- Hibernate 系列 07 - Hibernate中Java对象的三种状态

引导目录: Hibernate 系列教程 目录 1. Java对象的三种状态 当应用通过调用Hibernate API与框架发生交互时,需要从持久化的角度关注应用对象的生命周期. 持久化声明周期是Hi ...

- shell 中的与、或表达式

今天总结一下linux shell中逻辑关机表达方式.逻辑与的表达: 1).if [ $xxx=a -a $xx=b ] 注:-a表示and的意思 2).if [ $xxx=a ] && ...

- archlinux 加载loop模块,且设定loop设备个数

如果loop模块没有编译进内核就要先加载loop模块 modprobe loop 然后更改/etc/modprobe.d/modprobe.conf(有些文章写是在/etc/modprobe.conf ...