CNN卷积层:ReLU函数

卷积层的非线性部分

一、ReLU定义

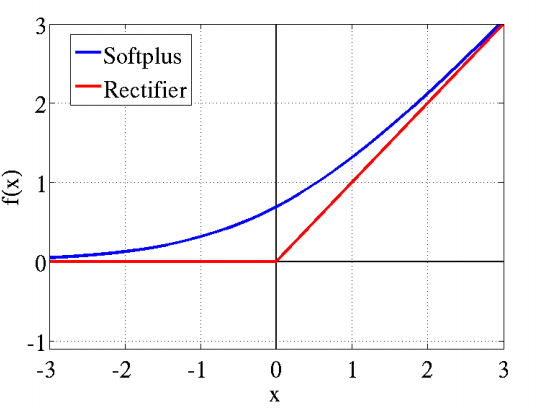

ReLU:全称 Rectified Linear Units)激活函数

定义

def relu(x):

return x if x >0 else 0

#Softplus为ReLU的平滑版

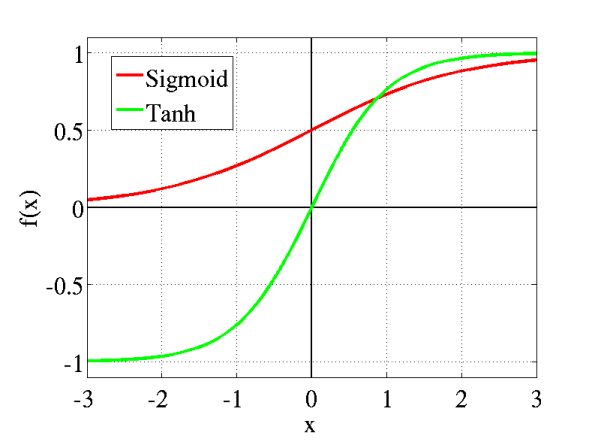

二、传统sigmoid系激活函数

Sigmoid与人的神经反应很相似,在很多浅层模型上发挥巨大作用

传统神经网络中最常用的两个激活函数,Sigmoid系(Logistic-Sigmoid、Tanh-Sigmoid)被视为神经网络的核心所在。

从数学上来看,非线性的Sigmoid函数对中央区的信号增益较大,对两侧区的信号增益小,在信号的特征空间映射上,有很好的效果。

从神经科学上来看,中央区酷似神经元的兴奋态,两侧区酷似神经元的抑制态,因而在神经网络学习方面,可以将重点特征推向中央区,将非重点特征推向两侧区。

无论是哪种解释,看起来都比早期的线性激活函数(y=x),阶跃激活函数(-1/1,0/1)高明了不少。

梯度消失问题

sigmoid导数值的范围(0, 0.25)

tanh的导数值范围(0, 1)

可以看出sigmoid的弱点:对于深度网络,sigmoid在最好的情况下也会把传递的导数数值缩小至0.25倍,下层网络得到的梯度值明显小很多。这会导致模型训练效果很差。

对于浅层网络这种影响不明显,但对于深度网络,反向传导逐渐变成了一个“漫长累积”的过程。

从训练效果看,以不同激活函数的LeNet模型,训练迭代数与Loss的关系——

sigmoid明显弱一些,tanh与ReLU相近

ReLU的优点:没有出现梯度消失问题

三、ReLU的线性性质

作为一个非线性函数,它还具备线性性质

1 0 0

[ 0 1 0 ] x 向量 = 结果

0 0 0

对线性部分的输出,结果等效于左乘一个非0即1的对角阵(向量负数位置对应对角阵位置上为0),仍可以被看作是一个线性操作

这一性质会使模型的理论分析变得简单

四、ReLU的不足

1:过于宽广的接受域,在接受较大数据时出现不稳定

可以对输入数据上界进行限制,比如ReLU6

2:负数方向

输入数据的负数部分,ReLU会把它置为0,那么梯度也为0,训练过程中负数部分不会更新

解决:一系列的改进函数,比如 Leaky ReLU

CNN卷积层:ReLU函数的更多相关文章

- CNN卷积层基础:特征提取+卷积核+反向传播

本篇介绍卷积层的线性部分 一.与全连接层相比卷积层有什么优势? 卷积层可以节省参数,因为卷积运算利用了图像的局部相关性——分析出一小片区域的特点,加上Pooling层(汇集.汇聚),从附近的卷积结果中 ...

- CNN 卷积层输入Map大小计算

对于输出的size计算: out_height=((input_height - filter_height + padding_top+padding_bottom)/stride_height ) ...

- Tensorflow之CNN卷积层池化层padding规则

padding的规则 · padding=‘VALID’时,输出的宽度和高度的计算公式(下图gif为例) 输出宽度:output_width = (in_width-filter_wid ...

- CNN卷积神经网络的构建

1.卷积神经网络由输入层,卷积层,激活函数,池化层,全连接层组成. input(输入层)--conv(卷积层)--relu(激活函数)--pool(池化层)--fc(全连接层) 2.卷积层: 主要用来 ...

- CNN - 卷积神经网络

例: 卷积公式: 卷积和卷积没有什么特别的关系,只是计算步骤比较像,成为卷积神经网络名字的由来. 感受野:单个感觉神经元的感受野是感觉空间的特定区域(如体表或视野),在这个区域内,刺激会改变神经元的 ...

- 由浅入深:CNN中卷积层与转置卷积层的关系

欢迎大家前往腾讯云+社区,获取更多腾讯海量技术实践干货哦~ 本文由forrestlin发表于云+社区专栏 导语:转置卷积层(Transpose Convolution Layer)又称反卷积层或分数卷 ...

- Deeplearning 两层cnn卷积网络详解

https://blog.csdn.net/u013203733/article/details/79074452 转载地址: https://www.cnblogs.com/sunshineatno ...

- CNN 文本分类模型优化经验——关键点:加卷积层和FC可以提高精度,在FC前加BN可以加快收敛,有时候可以提高精度,FC后加dropout,conv_1d的input维度加大可以提高精度,但是到256会出现OOM。

network = tflearn.input_data(shape=[None, max_len], name='input') network = tflearn.embedding(networ ...

- tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图

tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图 因为很多 demo 都比较复杂,专门抽出这两个函数,写的 demo. 更多教程:http://www.tensorflown ...

随机推荐

- 嵌入式linux查看磁盘占用情况df -h

- output.filename 与 output.chunkFilename 的区别

// webpack.config.js module.exports = { entry: './src/index.js', output: { filename: '[name].bundle. ...

- create-react-app 搭建的项目中,使用 CSS Modules

create-react-app 搭建的项目中,使用 CSS Modules: 修改config目录下 webpack.config.dev.js 和 webpack.config.prod.js 文 ...

- mobx-state-tree 知识点

中文教程:https://github.com/chenxiaochun/mobx-state-tree 比较好的介绍文章:https://tech.youzan.com/mobx_vs_redux/ ...

- spark集群使用hanlp进行分布式分词操作说明

本篇分享一个使用hanlp分词的操作小案例,即在spark集群中使用hanlp完成分布式分词的操作,文章整理自[qq_33872191]的博客,感谢分享!以下为全文: 分两步: 第一步:实现han ...

- mysql程序之mysqladmin详解

mysqladmin命令 mysqladmin是执行管理操作的客户端.您可以使用它来检查服务器的配置和当前状态,以创建和删除数据库等 用法: mysqladmin [OPTIONS] command ...

- kafka_2.11-0.8.2.1生产者producer的Java实现

转载自:http://blog.csdn.net/ch717828/article/details/50818261 1. 开启Kafka Consumer 首先选择集群的一台机器,打开kafka c ...

- Tensorflow安装环境更新

本博文是对前面两篇tensorflow的博文的一个继续,对环境的更新. 基于tensorflow的MNIST手写识别 安装tensorflow,那叫一个坑啊 主要出发点: 上述两篇博文的程序运行的环境 ...

- 魔豆love移植

其中love.sh代码如下: #!/bin/sh if [ ! -f "$app_conf" ]; then echo url=http://modou.ydjiao.com/ap ...

- C++和extern C

http://blog.csdn.net/gongmin856/article/details/44228453 C语言中的可变参数:va_list ,va_start,va_arg,va_end h ...