Scrapy爬取美女图片第三集 代理ip(上) (原创)

首先说一声,让大家久等了。本来打算那天进行更新的,可是一细想,也只有我这样的单身狗还在做科研,大家可能没心思看更新的文章,所以就拖到了今天。不过忙了521,522这一天半,我把数据库也添加进来了,修复了一些bug(现在肯定有人会说果然是单身狗)。(我的新书《Python爬虫开发与项目实战》出版了,大家可以看一下样章)

好了,废话不多说,咱们进入今天的主题。上两篇 Scrapy爬取美女图片 的文章,咱们讲解了scrapy的用法。可是就在最近,有热心的朋友对我说之前的程序无法爬取到图片,我猜应该是煎蛋网加入了反爬虫机制。所以今天讲解的就是突破反爬虫机制的上篇 代理ip。

现在很多的网站对反爬虫的一个做法(当然还有其他检测)是:检测一个ip的重复性操作,从而判断是爬虫还是人工。所以使用代理ip就可以突破这个封锁。作为一个学生党,没钱专门去买vpn和ip池,所以咱们使用的代理ip来自于网络上免费的,基本上够个人使用了。接下来咱们讲的是爬取免费ip,并且验证代理ip的可用性。

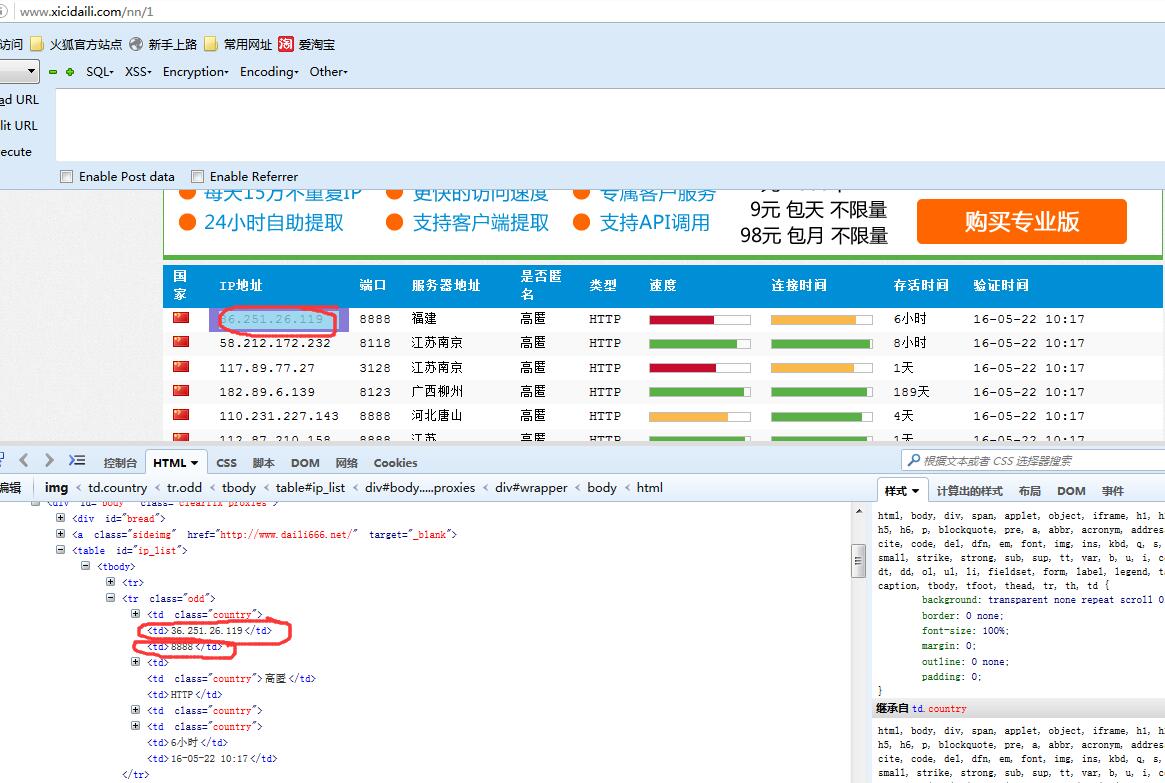

网上有很多代理ip的网站,这次我选择的是http://www.xicidaili.com/nn/,大家学完可以试试其他的网站,咱们努力做个大的代理ip池。

大家是否注意到高匿两个字,高匿的意思是:对方服务器不知道你使用了代理,更不知道你的真实IP,因此隐蔽性很高。

当真。

按照咱们之前的学习爬虫的做法,使用firebug审查元素,查看如何解析html。

其实就是一个table,解析里面的每一行,这个很简单,咱们使用BeautifulSoup很容易就解析出来了。

同时大家还应该注意到,它每一页上的ip表的页数和url中的参数是对应的。例如第一页就是http://www.xicidaili.com/nn/1。这样就省去了咱们翻页的麻烦。

以下是程序的结构:

db包中db_helper:实现的是mongodb的增删改查。

detect包中 detect_proxy:验证代理ip的可用性

entity包中 proxy_info:对代理信息进行了对象化

spider包:

spiderman 实现爬虫的逻辑

html_downloader 实现爬虫的html下载器

html_parser 实现爬虫的html解析器

test包: 对样例的测试,不涉及程序运行

main.py:实现命令行参数定义

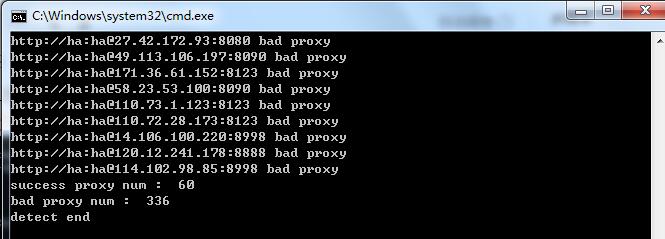

还要说一下检测:我是用 http://ip.chinaz.com/getip.aspx作为检测网址,只要使用代理访问不超时,而且响应码为200,咱们就认为是成功的代理。

接下来运行程序看看效果:

在windows下切换到工程目录,运行python main.py -h,会看到我定义的使用说明和参数设置。

接着运行python main.py -c 1 4 (意思是爬取1-4页的ip地址):

这时候如果想验证ip的正确性:运行python main.py -t db

看来好用的ip还是比较少,不过对于个人算是够用了。

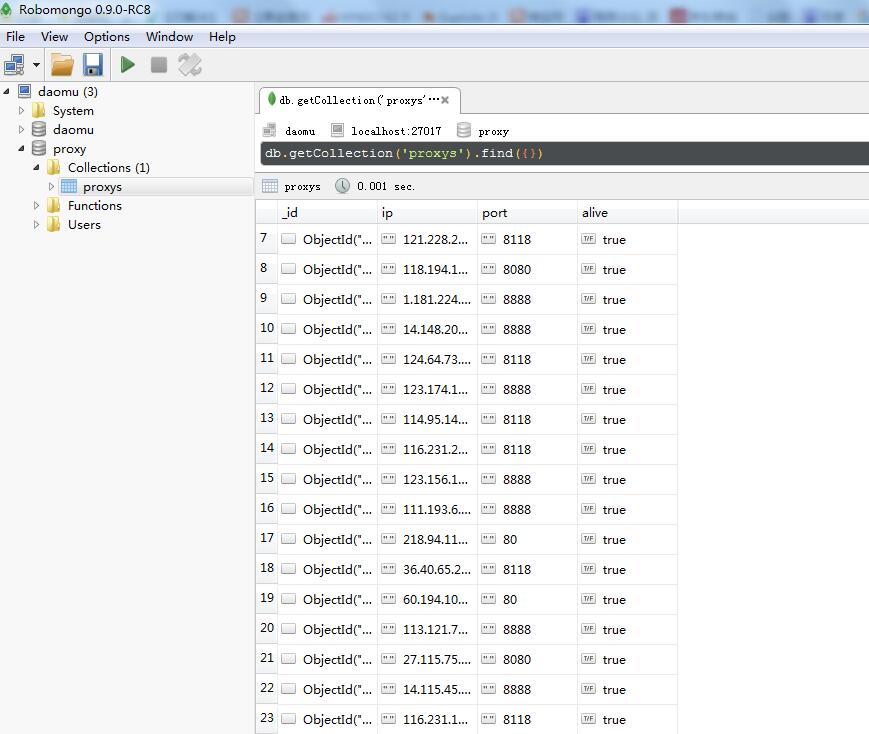

看一下mongodb数据库:

当咱们下次爬取图片的时候就可以使用这些ip了。

下面把解析和验证的代码贴一下:

def parser(self,html_cont):

'''

:param html_cont:

:return:

'''

if html_cont is None:

return # 使用BeautifulSoup模块对html进行解析

soup = BeautifulSoup(html_cont,'html.parser',from_encoding='utf-8')

tr_nodes = soup.find_all('tr',class_ = True) for tr_node in tr_nodes:

proxy = proxy_infor()

i = 0

for th in tr_node.children:

if th.string != None and len(th.string.strip()) > 0:

proxy.proxy[proxy.proxyName[i]] = th.string.strip()

print 'proxy',th.string.strip()

i += 1

if(i>1):

break

self.db_helper.insert({proxy.proxyName[0]:proxy.proxy[proxy.proxyName[0]],proxy.proxyName[1]:proxy.proxy[proxy.proxyName[1]]},proxy.proxy)

验证部分核心代码:

def detect(self):

'''

http://ip.chinaz.com/getip.aspx 作为检测目标

:return:

'''

proxys = self.db_helper.proxys.find()

badNum = 0

goodNum = 0

for proxy in proxys:

ip = proxy['ip']

port = proxy['port']

try:

proxy_host ="http://"+ip+':'+port #

response = urllib.urlopen(self.url,proxies={"http":proxy_host})

if response.getcode()!=200:

self.db_helper.delete({'ip':ip,'port':port})

badNum += 1

print proxy_host,'bad proxy'

else:

goodNum += 1

print proxy_host,'success proxy' except Exception,e:

print proxy_host,'bad proxy'

self.db_helper.delete({'ip':ip,'port':port})

badNum += 1

continue print 'success proxy num : ',goodNum

print 'bad proxy num : ',badNum

今天的分享就到这里,如果大家觉得还可以呀,记得支持我。代码上传到github上:https://github.com/qiyeboy/proxySpider_normal

欢迎大家支持我公众号:

本文章属于原创作品,欢迎大家转载分享。尊重原创,转载请注明来自:七夜的故事 http://www.cnblogs.com/qiyeboy/

Scrapy爬取美女图片第三集 代理ip(上) (原创)的更多相关文章

- Scrapy爬取美女图片第三集 代理ip(下)

这是我的公众号获取原创保护的首篇文章,原创的肯定将支持我继续前行.现在写这篇文章的时间是晚上11:30,写完就回寝室休息了,希望更多的朋友与我一起同行(当然需要一个善良的妹子的救济).(我的新书< ...

- Scrapy爬取美女图片第四集 突破反爬虫(上)

本周又和大家见面了,首先说一下我最近正在做和将要做的一些事情.(我的新书<Python爬虫开发与项目实战>出版了,大家可以看一下样章) 技术方面的事情:本次端午假期没有休息,正在使用fl ...

- Scrapy爬取美女图片 (原创)

有半个月没有更新了,最近确实有点忙.先是华为的比赛,接着实验室又有项目,然后又学习了一些新的知识,所以没有更新文章.为了表达我的歉意,我给大家来一波福利... 今天咱们说的是爬虫框架.之前我使用pyt ...

- Scrapy爬取美女图片续集 (原创)

上一篇咱们讲解了Scrapy的工作机制和如何使用Scrapy爬取美女图片,而今天接着讲解Scrapy爬取美女图片,不过采取了不同的方式和代码实现,对Scrapy的功能进行更深入的运用.(我的新书< ...

- scrapy爬取美女图片

使用scrapy爬取整个网站的图片数据.并且使用 CrawlerProcess 启动. 1 # -*- coding: utf-8 -* 2 import scrapy 3 import reques ...

- android高仿抖音、点餐界面、天气项目、自定义view指示、爬取美女图片等源码

Android精选源码 一个爬取美女图片的app Android高仿抖音 android一个可以上拉下滑的Ui效果 android用shape方式实现样式源码 一款Android上的新浪微博第三方轻量 ...

- Python 爬取美女图片,分目录多级存储

最近有个需求:下载https://mm.meiji2.com/网站的图片. 所以简单研究了一下爬虫. 在此整理一下结果,一为自己记录,二给后人一些方向. 爬取结果如图: 整体研究周期 2-3 天, ...

- 福利贴——爬取美女图片的Java爬虫小程序代码

自己做的一个Java爬虫小程序 废话不多说.先上图. 目录命名是用标签缩写,假设大家看得不顺眼能够等完成下载后手动改一下,比方像有强迫症的我一样... 这是挂了一个晚上下载的总大小,只是还有非常多由于 ...

- 1、使用Python3爬取美女图片-网站中的每日更新一栏

此代码是根据网络上其他人的代码优化而成的, 环境准备: pip install lxml pip install bs4 pip install urllib #!/usr/bin/env pytho ...

随机推荐

- SpringMVC知识(1)

1.SpringMVC的工作流程 流程 : 1.用户发送请求至前端控制器DispatcherServlet 2.DispatcherServlet收到请求调用HandlerMapping处理器映射器. ...

- Linux iptables 备忘

iptables主要通过存储在linux内核中的一个个表来控制IP包的.可以想象成excel表格.你可以自定义所需的iptables表.不过已经内置了三张队列表. filter 这是默认的表,包含了内 ...

- SQL Server:查看数据库用户权限(SQL 2005)

1. 查看 SQL 2005 用户所属数据库角色 use yourdb go select DbRole = g.name, MemberName = u.name, MemberSID = u.si ...

- Pandas数据规整

Pandas数据规整 数据分析和建模方面的大量编程工作都是用在数据准备上的,有时候存放在文件或数据库中的数据并不能满足数据处理应用的要求 Pandas提供了一组高级的.灵活的.高效的核心函数和算法,它 ...

- Fiddler命令行和HTTP断点调试

fiddler设置断点: fiddler->rules->automatic Breakpoints->选择断点方式,这种方式下设定的断点会对之后的所有HTTP请求有效. 有两个断点 ...

- appcan更新

升级用到了config.xml文件中配置的‘更新地址‘所填写的url,此url开发者可任意配置自己的服务器地址* 当app执行uexWidget.checkUpdate()时,AppCan会请求上述u ...

- MySql ERROR 1045 (28000): Access denied 错误

[MySql ERROR 1045 (28000): Access denied 错误] 即登陆错误,使用MySql登陆时,需使正确的username/passwd.通过 -u -p 参数即可. My ...

- Birthday(费用流)

Birthday https://www.nowcoder.com/acm/contest/206/A 题目描述 恬恬的生日临近了.宇扬给她准备了一个蛋糕. 正如往常一样,宇扬在蛋糕上插了n支蜡烛,并 ...

- [leetcode]278. First Bad Version首个坏版本

You are a product manager and currently leading a team to develop a new product. Unfortunately, the ...

- 动态加载JS,并执行回调函数

有些时候我们需要动态的加载一些JS,并在JS加载完成后执行一些回调函数. var loadscript = { $$: function (id) { return document.getEleme ...