逻辑回归(logic regression)的分类梯度下降

首先明白一个概念,什么是逻辑回归;所谓回归就是拟合,说明x是连续的;逻辑呢?就是True和False,也就是二分类;逻辑回归即使就是指对于二分类数据的拟合(划分)。

那么什么是模型呢?模型其实就是函数。函数是由三部分组成:自变量,因变量以及参数。

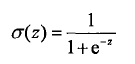

此次采用模型是sigmoid函数:

sigmoid函数的精妙之处就在于在x=0点出是一个分水岭,x>0y值去1,x<0 y值取0。所以sigmoid函数很像是跃阶函数。

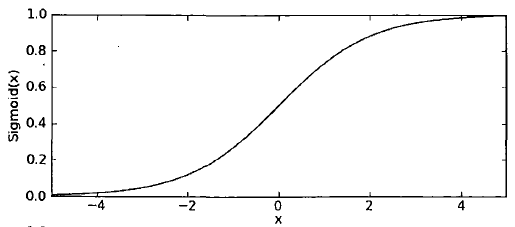

z代表什么?则代表分类的数学表达式,是函数的右侧;

那么怎么使用sigmoid阶函数?sigmoid函数目标情况是当传入z,返回值是1或者0;但是实际情况因为参数(w0,w1..wn)都是估计状态,基本都是不为0,1;通过样本分类(0,或者1)和sigmoid值相减,获取一个差量,下面就是调整参数(weight),让数据不断合理;

from numpy import mat

from numpy import shape

from numpy import ones def gradientAsendent(dataset, labels, time):

dataMat=mat(dataset)

labelMat=mat(labels).transpose()

m,n=shape(dataMat)

weights=ones((n,1)) #这个写法(两层括号)是创建一个矩阵

alpha=0.001 #学习率rate

maxtimes=time

for i in range(maxtimes):

#sigmod函数解决的分类问题,dataMat*weights返回的是一个矩阵,行数=datamat,列数=weights

h=sigmod(dataMat*weights)

# 合心意应该error=0,h应该是0,1的数组;但是sigmod返回的分类一定不是正好0,1,而是有差距的

# 目标就是通过调整系数(weights)来减少减少error的和0的差距,也是让h里面的数据不断的接近0,1

# 这里注意h是永远绝对值小于等于1的,从sigmond函数图可以看到,值域的取值范围是[0,1]

error=(labelMat - h)

# 如果有偏差了,就添加/减小参数值

weights=weights+alpha*dataMat.transpose()*error

return weights

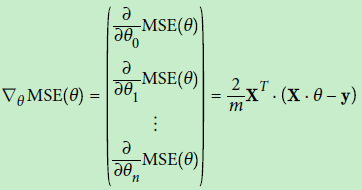

首先要明确,梯度下降算法的目的是求解出系数w1,w2...wn,也就是代码中的weights变量,是一个数组,注意,这里和我们之前的数学里面不是很痒,我们之前是研究系数已知,求解自变量(系数是固定的,自变量是有多个值, 不固定的),但是在机器学习里面,我们是自变量已知,因变量已知,他们就是提供的样本,训练模型的模型的目的求解出系数,所以这个理解思路要调整一下。那么怎么求呢?梯度下降过程是一个试错过程,看一下上述的代码中,初始化的时候所有的参数是1,然后逐渐的调整系数值,每次调整一次系数值就是训练一个新的模型,然后再把样本带进去看看错误率怎么样,基于本次的错误率进行调整系数。

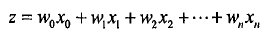

注意,敲黑板了,在我们计算错误率的时候,其实就是在使用损失函数,所谓损失函数就是新模型。损失函数一种表达方式是求偏导数(https://www.cnblogs.com/xiashiwendao/p/9470684.html)),另外一种简单的方式本文中提到的直接采用sigmod函数和分类结果做比值;如果是求偏导数的公式如下:

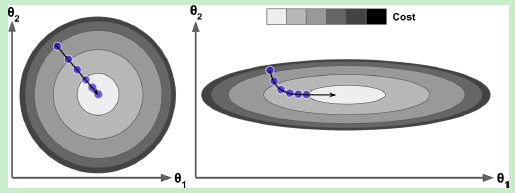

在几何图形上,我们可以将求偏导的过程理解为求解切线上面的法线向量(有方向,有大小,大小为步长);这里就有一个问题,如果是系数取值范围差别比较大,就会导致梯度的下降变慢,为什么呢?因为如下图右图所示,边缘的某点为基础进行梯度下降,最初是的切线是几乎水平,之后,越往里面切线越偏向右边,法线将会逐渐倾向原点,最后到达原点;但是过程相比于左图过程就要漫长的多,如果步长一样的话,那么右图(椭圆)下降速度远小于左图;这个示例说明的两个系数的场景,如果是多个系数,互相影响,将会是在空间上的曲折,对于梯度下降影响将会更大。那么是不是需要做缩放呢?怎么做缩放?这就牵涉到了特征伸缩问题。

逻辑回归(logic regression)的分类梯度下降的更多相关文章

- ML 逻辑回归 Logistic Regression

逻辑回归 Logistic Regression 1 分类 Classification 首先我们来看看使用线性回归来解决分类会出现的问题.下图中,我们加入了一个训练集,产生的新的假设函数使得我们进行 ...

- 机器学习 (三) 逻辑回归 Logistic Regression

文章内容均来自斯坦福大学的Andrew Ng教授讲解的Machine Learning课程,本文是针对该课程的个人学习笔记,如有疏漏,请以原课程所讲述内容为准.感谢博主Rachel Zhang 的个人 ...

- 机器学习方法(五):逻辑回归Logistic Regression,Softmax Regression

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 技术交流QQ群:433250724,欢迎对算法.技术.应用感兴趣的同学加入. 前面介绍过线性回归的基本知识, ...

- 机器学习总结之逻辑回归Logistic Regression

机器学习总结之逻辑回归Logistic Regression 逻辑回归logistic regression,虽然名字是回归,但是实际上它是处理分类问题的算法.简单的说回归问题和分类问题如下: 回归问 ...

- Coursera公开课笔记: 斯坦福大学机器学习第六课“逻辑回归(Logistic Regression)” 清晰讲解logistic-good!!!!!!

原文:http://52opencourse.com/125/coursera%E5%85%AC%E5%BC%80%E8%AF%BE%E7%AC%94%E8%AE%B0-%E6%96%AF%E5%9D ...

- 逻辑回归(Logistic Regression)详解,公式推导及代码实现

逻辑回归(Logistic Regression) 什么是逻辑回归: 逻辑回归(Logistic Regression)是一种基于概率的模式识别算法,虽然名字中带"回归",但实际上 ...

- 机器学习(四)--------逻辑回归(Logistic Regression)

逻辑回归(Logistic Regression) 线性回归用来预测,逻辑回归用来分类. 线性回归是拟合函数,逻辑回归是预测函数 逻辑回归就是分类. 分类问题用线性方程是不行的 线性方程拟合的是连 ...

- 机器学习入门11 - 逻辑回归 (Logistic Regression)

原文链接:https://developers.google.com/machine-learning/crash-course/logistic-regression/ 逻辑回归会生成一个介于 0 ...

- 大白话5分钟带你走进人工智能-第二十节逻辑回归和Softmax多分类问题(5)

大白话5分钟带你走进人工智能-第二十节逻辑回归和Softmax多分类问题(5) 上一节中,我们讲 ...

- 逻辑回归和sigmoid函数分类

逻辑回归和sigmoid函数分类:容易欠拟合,分类精度不高,计算代价小,易于理解和实现 sigmoid函数与阶跃函数的区别在于:阶跃函数从0到1的跳跃在sigmoid函数中是一个逐渐的变化,而不是突变 ...

随机推荐

- mysql常见查询练习题

#建学生信息表student create table student ( sno varchar(20) not null primary key, sname varchar(20) not nu ...

- 神州数码RIP路由协议

实验要求:熟练掌握RIP配置方法 拓扑如下 R1 enable 进入特权模式 config 进入全局模式 hostname R1 修改名称 interface s0/1 进入端口 physical-l ...

- 基于CART的回归和分类任务

CART 是 classification and regression tree 的缩写,即分类与回归树. 博主之前学习的时候有用过决策树来做预测的小例子:机器学习之决策树预测--泰坦尼克号乘客数据 ...

- Android: protecting the kernel

Linux内置安全机制 Address space separation/process isolation unix permissions DAC capabilities SELinux sec ...

- http协议与websocket协议(转)

一.WebSocket是HTML5中的协议,支持持久连接:而Http协议不支持持久连接. 首先HTMl5指的是一系列新的API,或者说新规范,新技术.WebSocket是HTML5中新协议.新API. ...

- WEBBASE篇: 第二篇, HTML知识2

HTML知识2 <!doctype html> <html lang="en"> <head> <meta charset="U ...

- Python之路,第三篇:Python入门与基础3

1, 布尔运算符 运算符; not and or not 运算符: 作用:逻辑取反 语法: not 表达式 例: not True # False not Fa ...

- C++ 中时钟函数的使用

头文件: #incllude <time.h> 定义: clock_t var1, var2; 获取时间: var1 = clock(); 每过千分之一秒(1毫秒),调用clock()函数 ...

- SEO:网站优化内容

一.内部优化 (1)meta标签优化:例如:TDK等的优化: 首页:网站名称 或者 网站名称_提供服务介绍or产品介绍 . 频道页:频道名称_网站名称. 文章 ...

- JS滚轮mousewheel事件和DOMMouseScroll事件

滚轮事件的兼容性差异有些不拘一格,不是以往的IE8-派和其他派,而是FireFox派和其他派. 包括IE6在内的浏览器是使用onmousewheel,而FireFox浏览器一个人使用DOMMouseS ...