Hadoop第一课:Hadoop集群环境搭建

一、 检查列表

1.1、网络访问

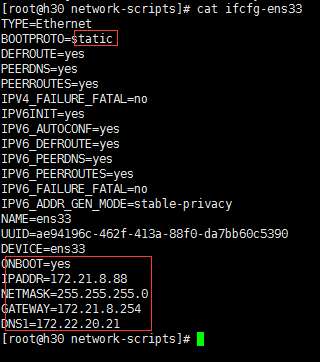

设置电脑IP以及可以访问网络设置:进入etc/sysconfig/network-scripts/,使用命令“ls -all” 查看文件。会看到ifcfg-lo文件然后使用命令修改IP和DNS.

1.2、防火墙

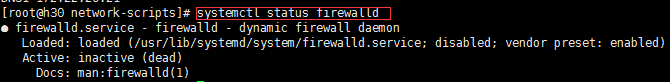

关闭防火墙,我是用的系统是CentOS7,命令如何下:

查看防火墙状态的命令:systemctl status firewalld

关闭防火墙的命令:systemctl stop firewalld

关闭防火墙开机启动:systemctl disable firewalld

1.3、Hosts

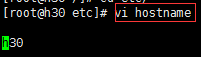

1.3.1 修改hostname,进入etc,然后使用修改命令进行修改

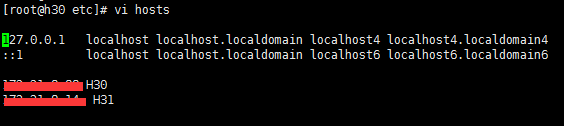

1.3.1 修改host

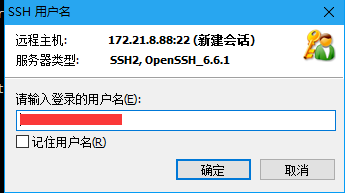

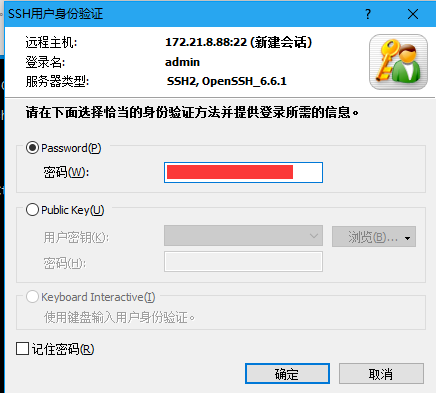

二、搭建远程连接

下载xshell和xftp 软件(下载地址:http://www.netsarang.com/download/main.html)

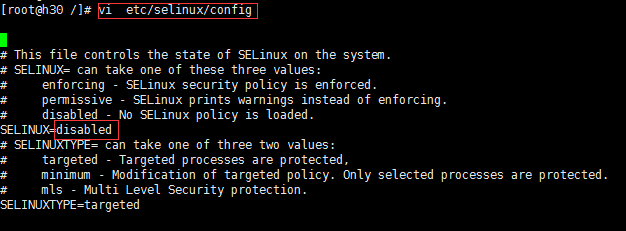

三、修改SELinux

四、安装JDK

4.1 检查java安装情况

检查包命令: rpm -qa|grep java

4.2 新建文件夹

cd /var

mkdir -p www/html

4.3 使用Xftp 4将下载好的jdk上传到H30,也可以点Xshell的xftp链接(http://www.oracle.com/technetwork/java/javase/downloads/index.html)

4.4 安装

cd /var/www/html

rpm -ivh jdk-7u67-linux-x64.rpm

4.5查看版本

java -version

五、SSH 设置

5.1 创建SSH文件夹

进入H30,查看ssh是否安装,如果有,继续,没有安装下。

rpm -qa|grep ssh

创建.ssh目录。查看文件中,第一个字母d表示是目录,后面跟着的是权限,比如创建者,一般的人,大家有兴趣查下Linux的文件权限。

#进入root目录

cd /root

#创建.ssh目录

mkdir .ssh

#设置权限

chmod .ssh

#检查

ls -al

5.2 创建SSH

后面3个回车

ssh-keygen -t rsa

5.3 复制id_rsa.pub 到authorized_keys

cd .ssh

cat id_rsa.pub >> authorized_keys

5.4 修改H31(集群其他服务器一样)配置

cd .ssh ls -al #设置权限

chmod authorized_keys ls -al

5.5 复制authorized_keys到H31

#copy

scp /root/.ssh/authorized_keys root@H31:/root/.ssh/

#login

ssh root@H31

Hadoop第一课:Hadoop集群环境搭建的更多相关文章

- Hadoop+HBase+ZooKeeper分布式集群环境搭建

一.环境说明 集群环境至少需要3个节点(也就是3台服务器设备):1个Master,2个Slave,节点之间局域网连接,可以相互ping通,下面举例说明,配置节点IP分配如下: Hostname IP ...

- 大数据hadoop入门学习之集群环境搭建集合

目录: 1.基本工作准备 1.虚拟机准备 2.java 虚拟机-jdk环境配置 3.ssh无密码登录 2.hadoop的安装与配置 3.hbase安装与配置(集成安装zookeeper) 4.zook ...

- hadoop集群环境搭建准备工作

一定要注意hadoop和linux系统的位数一定要相同,就是说如果hadoop是32位的,linux系统也一定要安装32位的. 准备工作: 1 首先在VMware中建立6台虚拟机(配置默认即可).这是 ...

- Hadoop完全分布式集群环境搭建

1. 在Apache官网下载Hadoop 下载地址:http://hadoop.apache.org/releases.html 选择对应版本的二进制文件进行下载 2.解压配置 以hadoop-2.6 ...

- 大数据 -- Hadoop集群环境搭建

首先我们来认识一下HDFS, HDFS(Hadoop Distributed File System )Hadoop分布式文件系统.它其实是将一个大文件分成若干块保存在不同服务器的多个节点中.通过联网 ...

- Hadoop+Spark:集群环境搭建

环境准备: 在虚拟机下,大家三台Linux ubuntu 14.04 server x64 系统(下载地址:http://releases.ubuntu.com/14.04.2/ubuntu-14.0 ...

- hadoop集群环境搭建之zookeeper集群的安装部署

关于hadoop集群搭建有一些准备工作要做,具体请参照hadoop集群环境搭建准备工作 (我成功的按照这个步骤部署成功了,经实际验证,该方法可行) 一.安装zookeeper 1 将zookeeper ...

- hadoop集群环境搭建之安装配置hadoop集群

在安装hadoop集群之前,需要先进行zookeeper的安装,请参照hadoop集群环境搭建之zookeeper集群的安装部署 1 将hadoop安装包解压到 /itcast/ (如果没有这个目录 ...

- Hadoop集群环境搭建步骤说明

Hadoop集群环境搭建是很多学习hadoop学习者或者是使用者都必然要面对的一个问题,网上关于hadoop集群环境搭建的博文教程也蛮多的.对于玩hadoop的高手来说肯定没有什么问题,甚至可以说事“ ...

- Spark集群环境搭建——Hadoop集群环境搭建

Spark其实是Hadoop生态圈的一部分,需要用到Hadoop的HDFS.YARN等组件. 为了方便我们的使用,Spark官方已经为我们将Hadoop与scala组件集成到spark里的安装包,解压 ...

随机推荐

- Notes 20180306 : 变量与常量

1.1 变量与常量 我们在开发中会经常听到常量和变量,那么常量和变量指的又是什么呢?顾名思义,在程序执行过程中,其值不能被改变的量称为常量,其值能被改变的量称为变量.变量与常量的命名都必须使用合法的标 ...

- python统计文档中词频

python统计文档中词频的小程序 python版本2.7 效果如下: 程序如下,测试文件与完整程序在我的github中 #统计空格数与单词数 本函数只返回了空格数 需要的可以自己返回多个值 def ...

- Oracle条件判断列数量非where

sum(case when typename='测试' then 1 else 0 end)

- 【Spark】源码分析之spark-submit

在客户端执行脚本sbin/spark-submit的时候,通过cat命令查看源码可以看出,实际上在源码中将会执行bin/spark-class org.apache.spark.deploy.Spar ...

- phpcms v9 完美更换整合Ueditor 1.3

phpcms这套系统相信大家不陌生,它做的很不错,但是也有好多地方不满足我们的需求,比如在线编辑器. 它自带的是CKEditor编辑器,功能较少,比如代码加亮功能就没有. 所以我来说一下怎么替换php ...

- Django之图书管理系统

出版社的增删改查 展示出版社列表: 1. 创建一个表结构: 2. 再配合那俩条命令即可创建一个press表 创建出版社函数,并在url中进行配置 创建HTML页面,展示出版社的表 for循环 {% ...

- 利用cross-entropy cost代替quadratic cost来获得更好的收敛

1.从方差代价函数说起(Quadratic cost) 代价函数经常用方差代价函数(即采用均方误差MSE),比如对于一个神经元(单输入单输出,sigmoid函数),定义其代价函数为: 其中y是我们期望 ...

- 北京Uber优步司机奖励政策(9月14日~9月20日)

滴快车单单2.5倍,注册地址:http://www.udache.com/ 如何注册Uber司机(全国版最新最详细注册流程)/月入2万/不用抢单:http://www.cnblogs.com/mfry ...

- iOS 库 开发小结

1.基本用法 定义类,导出头文件,注意头文件,库文件的search path 2.加载资源 - 使用主工程的文件,耦合性太强 - 封装到NSBundle中 NSBundle可以封装xib storyb ...

- VINS(六)边缘化

通常的边缘化是将联合概率分布分解为边缘概率分布和条件概率分布的过程,这样可以将Sliding Window中较旧的状态边缘化出Sliding Window,同时保留其信息.并且保证了对应H海塞矩阵的稀 ...