Python爬虫--- 1.1请求库的安装与使用

来说先说爬虫的原理:爬虫本质上是模拟人浏览信息的过程,只不过他通过计算机来达到快速抓取筛选信息的目的所以我们想要写一个爬虫,最基本的就是要将我们需要抓取信息的网页原原本本的抓取下来。这个时候就要用到请求库了。

- requests库的安装

requests库本质上就是模拟了我们用浏览器打开一个网页,发起请求是的动作。它能够迅速的把请求的html源文件保存到本地

安装的方式非常简单:

我们用PIP工具在命令行里进行安装

$ pip install requests

接着我们看一下是否成功安装了BS4库:

$ pip list

看一下安装结果:

- equests库的基本使用:

#首先我们先导入requests这个包

import requests

#我们来吧百度的index页面的源码抓取到本地,并用r变量保存

#注意这里,网页前面的 http://一定要写出来,

#它并不能像真正的浏览器一样帮我们补全http协议

r = requests.get("http://www.baidu.com")

# 将下载到的内容打印一下:

print(r.text)

可以看到,百度的首页源码文件我们已经把他抓取到本地了。

上面的抓取过程中,我们用到了requests库的get方法,

这个方法是requests库中最常用的方法之一。

他接受一个参数(url)并返回一个HTTP response对象。

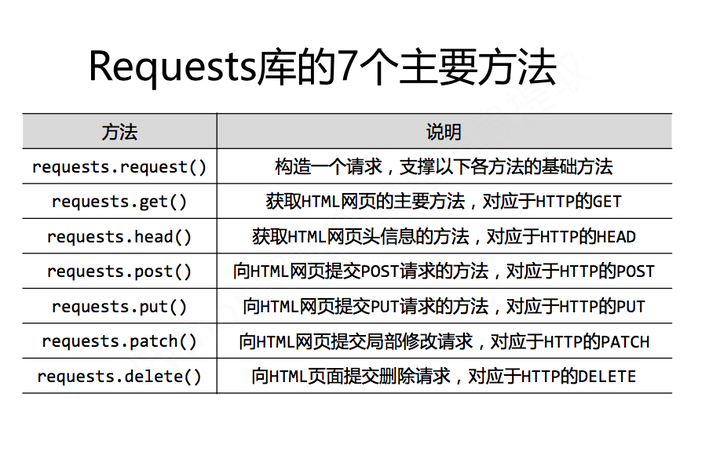

与get方法相同的,requests库还有许多其他常用方法:

- 下面我们来详细了解一下requests.get这个方法:

#这个方法可以接收三个参数,其中第二个默认为None 第三个可选

def get(url, params=None, **kwargs)

#作用是模拟发起GET请求

Sends a GET request.

#模拟获取页面的url链接

:param url: URL for the new :class:Request object.

#额外参数 字典或字节流格式,可选

:param params: (optional) Dictionary or bytes to be sent in the query string for the :class:Request.

# 十二个控制访问参数,比如可以自定义header

:param **kwargs: Optional arguments that request takes.

# 返回一个Response对象

:return: :class:Response <Response> object

:type: requests.Response

- 我们来着重讲一下“ kwargs ”这个参数:

kwargs: 控制访问的参数,均为可选项

params : 字典或字节序列,作为参数增加到url中

data : 字典、字节序列或文件对象,作为Request的内容 json : JSON格式的数据,作为Request的内容

headers : 字典,HTTP定制头

cookies : 字典或CookieJar,Request中的cookie

auth : 元组,支持HTTP认证功能

files : 字典类型,传输文件

timeout : 设定超时时间,秒为单位

proxies : 字典类型,设定访问代理服务器,可以增加登录认证

allow_redirects : True/False,默认为True,重定向开关

stream : True/False,默认为True,获取内容立即下载开关

verify : True/False,默认为True,认证SSL证书开关

cert : 本地SSL证书路径

url: 拟更新页面的url链接

data: 字典、字节序列或文件,Request的内容

json: JSON格式的数据,Request的内容

常用的两个控制访问参数:

1.假设我们需要在GET请求里自定义一个header头文件:

hd = {'User-agent':'123'}

r = requests.get('http://www.baidu.com', headers=hd)

print(r.request.headers)

'''

OUT:

{'User-agent': '123', 'Accept-Encoding': 'gzip, deflate',

'Accept': '*/*', 'Connection': 'keep-alive'}

'''

2.假设我们要自定义一个代理池:

pxs = { 'http': 'http://user:pass@10.10.10.1:1234',

'https': 'https://10.10.10.1:4321' }

r = requests.get('http://www.baidu.com', proxies=pxs)

- 详细了解Response对象:

'''

Response(self)

The :class:Response <Response> object, which contains a server's response to an HTTP request.

'''

#HTTP请求的返回状态,比如,200表示成功,404表示失败

print (r.status_code)

#HTTP请求中的headers

print (r.headers)

#从header中猜测的响应的内容编码方式

print (r.encoding)

#从内容中分析的编码方式(慢)

print (r.apparent_encoding)

#响应内容的二进制形式#print (r.content)

'''

status_code:200

headers:

{'Server': 'bfe/1.0.8.18', 'Date': 'Tue, 02 May 2017 12:01:47 GMT', 'Content-Type': 'text/html', 'La

st-Modified': 'Mon, 23 Jan 2017 13:28:27 GMT', 'Transfer-Encoding': 'chunked', 'Connection': 'Keep-A

live', 'Cache-Control': 'private, no-cache, no-store, proxy-revalidate, no-transform', 'Pragma': 'no

-cache', 'Set-Cookie': 'BDORZ=27315; max-age=86400; domain=.baidu.com; path=/', 'Content-Encoding':

'gzip'}

encoding: ISO-8859-1

apparent_encoding:utf-8

'''

- requests抓取网页的通用框架

import requests

def getHtmlText(url):

try:

r = requests.get(url, timeout=30)

# 如果状态码不是200 则应发HTTOError异常

r.raise_for_status()

# 设置正确的编码方式

r.encoding = r.apparent_encoding()

return r.text

except:

return "Something Wrong!"

好了关于requests库我们今天就写到这,

这是一个非常强大的库,

更多的功能大家可以去看一下官方的文档

http://docs.python-requests.org/zh_CN/latest/user/quickstart.html

此文章同时同步到我的个人博客緣來來來 » Python爬虫--- 1.1请求库的安装与使用

Python爬虫--- 1.1请求库的安装与使用的更多相关文章

- python爬虫知识点总结(一)库的安装

环境要求: 1.编程语言版本python3: 2.系统:win10; 3.浏览器:Chrome68.0.3440.75:(如果不是最新版有可能影响到程序执行) 4.chromedriver2.41 注 ...

- Python3 网络爬虫(请求库的安装)

Python3 网络爬虫(请求库的安装) 爬虫可以简单分为几步:抓取页面,分析页面和存储数据 在页面爬取的过程中我们需要模拟浏览器向服务器发送请求,所以需要用到一些python库来实现HTTP的请求操 ...

- 关于python请求库Selenium安装所遇到的问题

今天,初次接触python,在网上买了一本关于爬虫的书,因为之前电脑上存在python,所以就对着书直接进行的请求库的安装,安装的时候,主要遇到了下边一个问题,在安装Selenium的时候,出现以下提 ...

- Python 关于 pip 部分相关库的安装

下文中“:”后面安装的安装语句需要打开 cmd (命令提示符),在 cmd 中输入. 示例: 在搜索框输入 cmd,单机命令提示符: 然后输入安装语句,按回车键: 因为我之前已经装过了,所以这里显示的 ...

- Python爬虫进阶三之Scrapy框架安装配置

初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此整理如下. Windows 平台: 我的系统是 ...

- python爬虫之re正则表达式库

python爬虫之re正则表达式库 正则表达式是用来简洁表达一组字符串的表达式. 编译:将符合正则表达式语法的字符串转换成正则表达式特征 操作符 说明 实例 . 表示任何单个字符 [ ] 字符集,对单 ...

- python应用之爬虫实战2 请求库与解析库

知识内容: 1.requests库 2.selenium库 3.BeautifulSoup4库 4.re正则解析库 5.lxml库 参考: http://www.cnblogs.com/wupeiqi ...

- Python爬虫的开始——requests库建立请求

接下来我将会用一段时间来更新python爬虫 网络爬虫大体可以分为三个步骤. 首先建立请求,爬取所需元素: 其次解析爬取信息,剔除无效数据: 最后将爬取信息进行保存: 今天就先来讲讲第一步,请求库re ...

- Python3爬虫相关软件,库的安装

Anaconda 百度搜Anaconda清华,根据环境选择版本下载 安装时记得勾选添加到环境变量,不要还要手动添加 Anaconda Navigator可视化界面,可以方便地调用Jupyter等工具. ...

随机推荐

- C#集合之不变的集合

如果对象可以改变其状态,就很难在多个同时运行的任务中使用.这些集合必须同步.如果对象不能改变器状态,就很容易在多个线程中使用. Microsoft提供了一个新的集合库:Microsoft Immuta ...

- Little Sub and Piggybank (杭师大第十二届校赛G题) DP

题目传送门 题意:每天能往存钱罐加任意实数的钱,每天不能多于起那一天放的钱数.如果某一天的钱数恰好等于那天的特价商品,则可以买,求最后的最大快乐值. 思路:先来一段来自出题人的题解: 显然的贪心:如果 ...

- Android Studio Gradle下载的包在哪里?

C:\Users\Administrator\.gradle\caches\modules-2\files-2.1

- 1095. Maximum Swap —— Weekly Challenge

题目限定输入是[0, 10^8],因而不用考虑负数或者越界情况,算是减小了难度. public class Solution { /** * @param num: a non-negative in ...

- 第八次 Scrum Meeting

第八次 Scrum Meeting 写在前面 会议时间 会议时长 会议地点 2019/4/12 22:00 20min 大运村1号楼6F 附Github仓库:WEDO 例会照片 工作情况总结(4.12 ...

- Delphi导出word

//导出Wordprocedure TFrm_Computing.ExportWord;varwordApp, WordDoc, WrdSelection, wrdtable, wrdtable1, ...

- Jmeter基础元件

测试计划 1.Test Plan (测试计划) 用来描述一个性能测试,包含与本次性能测试所有相关的功能.也就说JMeter创建性能测试的所有内容是于基于一个计划的. 下面看看一个计划下面都有哪些功能模 ...

- c++ 网络编程(九)LINUX/windows-IOCP模型 多线程超详细教程及多线程实现服务端

原文作者:aircraft 原文链接:https://www.cnblogs.com/DOMLX/p/9661012.html 先讲Linux下(windows下在后面可以直接跳到后面看): 一.线程 ...

- 已有插件支持requirejs

define(["jquery"], // Require jquery function($){ //把你原来的插件代码放这里吧,这样就行了 //注意文件命名 }) ...

- Python生成pyc文件

Python生成pyc文件 pyc文件是py文件编译后生成的字节码文件(byte code).pyc文件经过python解释器最终会生成机器码运行.所以pyc文件是可以跨平台部署的,类似Java的.c ...