Spark 实践——用 Scala 和 Spark 进行数据分析

本文基于《Spark 高级数据分析》第2章 用Scala和Spark进行数据分析。

完整代码见 https://github.com/libaoquan95/aasPractice/tree/master/c2/Into

1.获取数据集

数据集来自加州大学欧文分校机器学习资料库(UC Irvine Machine Learning Repository),这个资料库为研究和教学提供了大量非常好的数据源, 这些数据源非常有意义,并且是免费的。 我们要分析的数据集来源于一项记录关联研究,这项研究是德国一家医院在 2010 年完成的。这个数据集包含数百万对病人记录,每对记录都根据不同标准来匹配,比如病人姓名(名字和姓氏)、地址、生日。每个匹配字段都被赋予一个数值评分,范围为 0.0 到 1.0, 分值根据字符串相似度得出。然后这些数据交由人工处理,标记出哪些代表同一个人哪些代表不同的人。 为了保护病人隐私,创建数据集的每个字段原始值被删除了。病人的 ID、 字段匹配分数、匹配对标示(包括匹配的和不匹配的)等信息是公开的,可用于记录关联研究

下载地址:

- http://bit.ly/1Aoywaq (需翻墙)

- https://github.com/libaoquan95/aasPractice/tree/master/c2/linkage(已解压,block_1.csv 到 block_10.csv)

2.设置Spark运行环境,读取数据

val sc = SparkSession.builder().appName("Into").master("local").getOrCreate()

import sc.implicits._

读取数据集

// 数据地址

val dataDir = "inkage/block_*.csv"

// 读取有头部标题的CSV文件,并设置空值

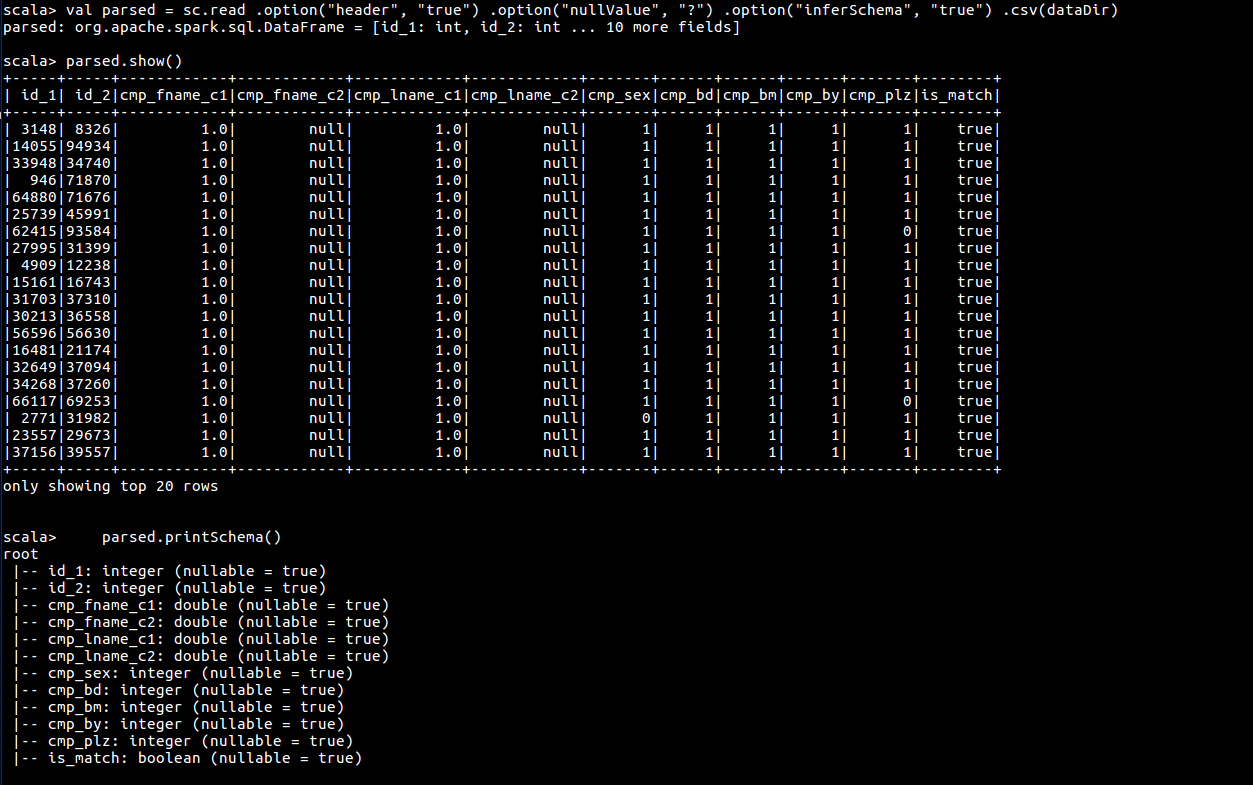

val parsed = sc.read .option("header", "true") .option("nullValue", "?") .option("inferSchema", "true") .csv(dataDir)

// 查看表

parsed.show()

// 查看表结构

parsed.printSchema()

parsed.cache()

3.处理数据

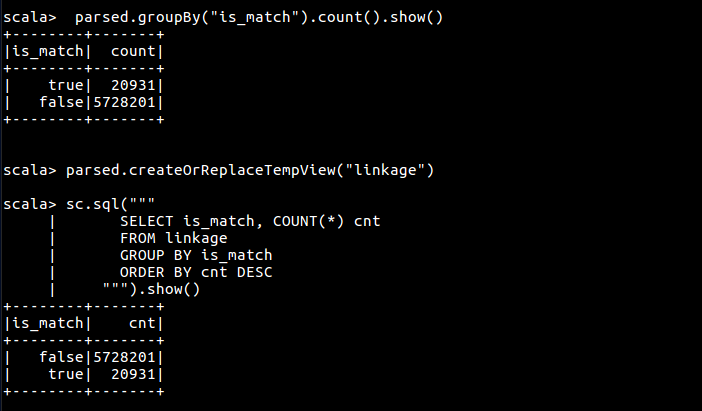

首先按 is_match 字段聚合数据,有两种方式可以进行数据聚合,一是使用 groupby 函数,二是使用 Spark Sql

// 聚合

parsed.groupBy("is_match").count().orderBy($"count".desc).show()

// 先注册为临时表

parsed.createOrReplaceTempView("linkage")

// 使用sql查询,效果同上

sc.sql("""

SELECT is_match, COUNT(*) cnt

FROM linkage

GROUP BY is_match

ORDER BY cnt DESC

""").show()

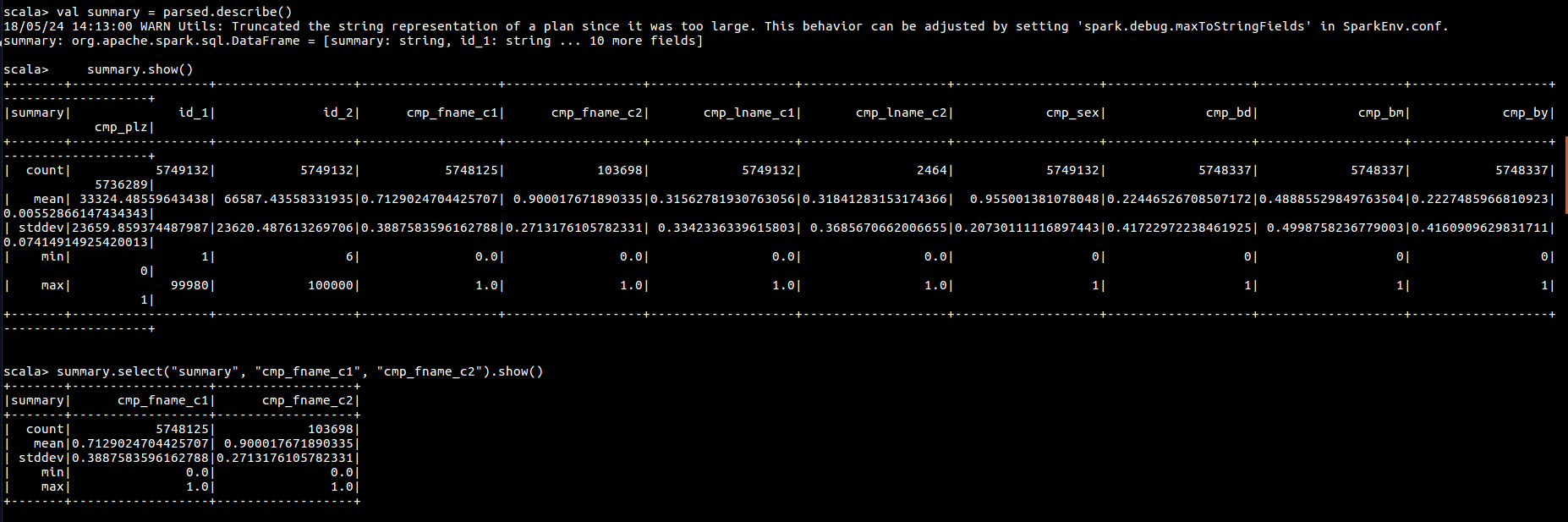

之后使用 describe 函数获取每个字段的最值,均值等信息

// 获取每一列的最值,平均值信息

val summary = parsed.describe()

summary.show()

summary.select("summary", "cmp_fname_c1", "cmp_fname_c2").show()

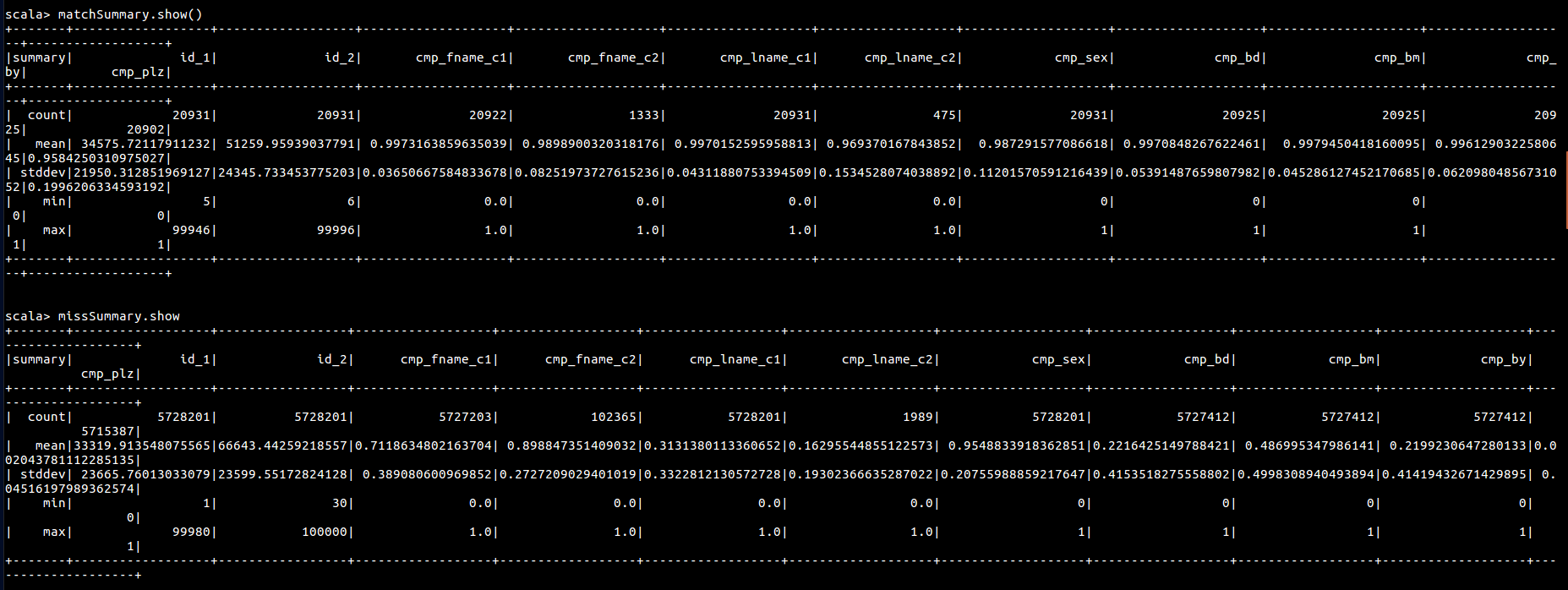

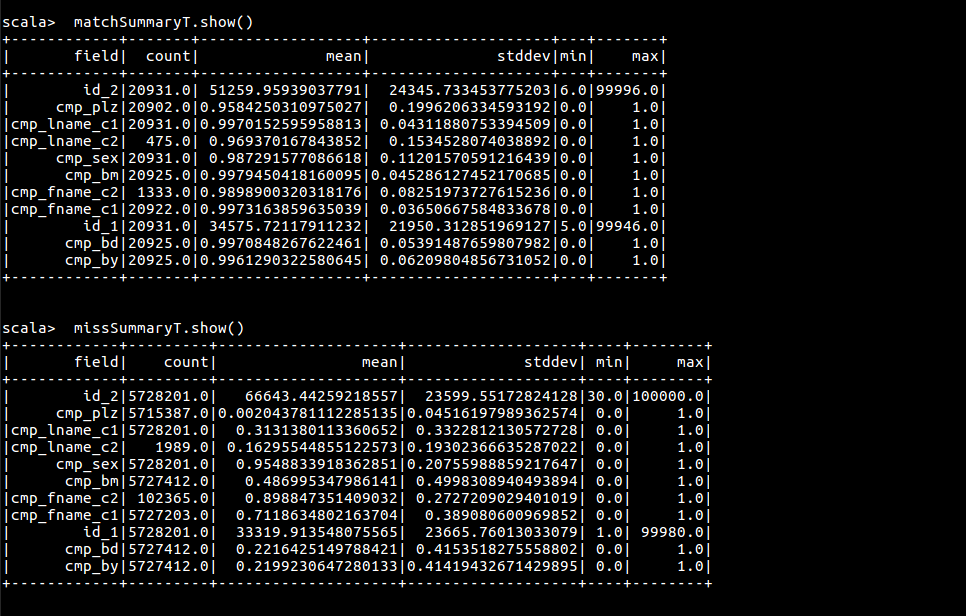

按此方式获取匹配记录和不匹配记录的 describe

// 获取匹配和不匹配的信息

val matches = parsed.where("is_match = true")

val misses = parsed.filter($"is_match" === false)

val matchSummary = matches.describe()

val missSummary = misses.describe()

matchSummary .show()

missSummary .show()

可以看到这个数据不方便进行操作,可以考虑将其转置,方便使用sql对数据进行分析

def longForm(desc: DataFrame): DataFrame = {

import desc.sparkSession.implicits._ // For toDF RDD -> DataFrame conversion

val schema = desc.schema

desc.flatMap(row => {

val metric = row.getString(0)

(1 until row.size).map(i => (metric, schema(i).name, row.getString(i).toDouble))

})

.toDF("metric", "field", "value")

}

def pivotSummary(desc: DataFrame): DataFrame = {

val lf = longForm(desc)

lf.groupBy("field").

pivot("metric", Seq("count", "mean", "stddev", "min", "max")).

agg(first("value"))

}

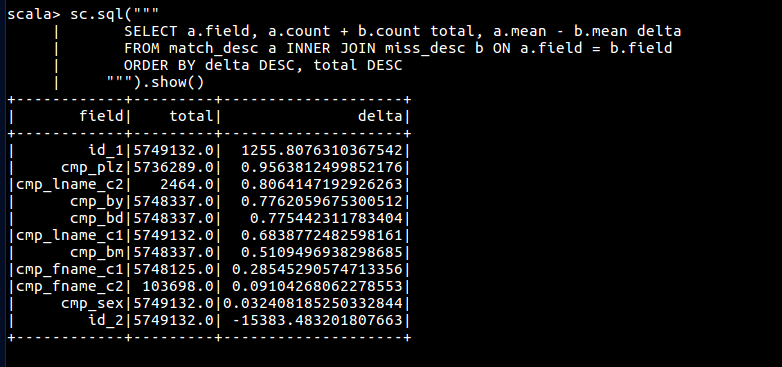

// 转置,重塑数据

val matchSummaryT = pivotSummary(matchSummary)

val missSummaryT = pivotSummary(missSummary)

matchSummaryT.createOrReplaceTempView("match_desc")

missSummaryT.createOrReplaceTempView("miss_desc")

sc.sql("""

SELECT a.field, a.count + b.count total, a.mean - b.mean delta

FROM match_desc a INNER JOIN miss_desc b ON a.field = b.field

ORDER BY delta DESC, total DESC

""").show()

Spark 实践——用 Scala 和 Spark 进行数据分析的更多相关文章

- 大数据项目实践:基于hadoop+spark+mongodb+mysql+c#开发医院临床知识库系统

一.前言 从20世纪90年代数字化医院概念提出到至今的20多年时间,数字化医院(Digital Hospital)在国内各大医院飞速的普及推广发展,并取得骄人成绩.不但有数字化医院管理信息系统(HIS ...

- Spark实践的阶段性总结

写这篇小总结是因为前段时间是自己业余时间对Spark相关进行了些探索,接下来可能有别的同事一起加入,且会去借用一些别的服务器资源,希望可以借此理下思路. 实践Spark的原因 在之前Spark简介及安 ...

- Spark 实践——基于 Spark Streaming 的实时日志分析系统

本文基于<Spark 最佳实践>第6章 Spark 流式计算. 我们知道网站用户访问流量是不间断的,基于网站的访问日志,即 Web log 分析是典型的流式实时计算应用场景.比如百度统计, ...

- Spark简单介绍,Windows下安装Scala+Hadoop+Spark运行环境,集成到IDEA中

一.前言 近几年大数据是异常的火爆,今天小编以java开发的身份来会会大数据,提高一下自己的层面! 大数据技术也是有很多: Hadoop Spark Flink 小编也只知道这些了,由于Hadoop, ...

- Spark&Hive:如何使用scala开发spark访问hive作业,如何使用yarn resourcemanager。

背景: 接到任务,需要在一个一天数据量在460亿条记录的hive表中,筛选出某些host为特定的值时才解析该条记录的http_content中的经纬度: 解析规则譬如: 需要解析host: api.m ...

- 使用scala开发spark入门总结

使用scala开发spark入门总结 一.spark简单介绍 关于spark的介绍网上有很多,可以自行百度和google,这里只做简单介绍.推荐简单介绍连接:http://blog.jobbole.c ...

- idea中使用scala运行spark出现Exception in thread "main" java.lang.NoClassDefFoundError: scala/collection/GenTraversableOnce$class

idea中使用scala运行spark出现: Exception in thread "main" java.lang.NoClassDefFoundError: scala/co ...

- 个推 Spark实践教你绕过开发那些“坑”

Spark作为一个开源数据处理框架,它在数据计算过程中把中间数据直接缓存到内存里,能大大提高处理速度,特别是复杂的迭代计算.Spark主要包括SparkSQL,SparkStreaming,Spark ...

- Spark集群搭建【Spark+Hadoop+Scala+Zookeeper】

1.安装Linux 需要:3台CentOS7虚拟机 IP:192.168.245.130,192.168.245.131,192.168.245.132(类似,尽量保持连续,方便记忆) 注意: 3台虚 ...

随机推荐

- [转]MFC下关于“建立空文档失败”问题的分析

这类问题的出现主要在bool CWinApp::ProcessShellCommand(CCommandLineInfo& rCmdInfo); 函数的关键内容: BOOL bResult = ...

- css盒子模型(box-sizing)

盒子模型 关于CSS重要的一个概念就是CSS盒子模型.它控制着页面这些元素的高度和宽度.盒子模型多少会让人产生一些困惑,尤其当涉及到高度和宽度计算的时候.真正盒子的宽度(在页面呈现出来的宽度)和高度, ...

- TM1629A驱动程序

网上看了很多1629驱动程序,很乱,下载了几个整合了一下,下面的程序还没有烧录到开发板里面测试,程序已经做好了,但是这个方案老板不做了,所以只能在这里放着了,留着以后用吧 void TM1629A_W ...

- Android GridView使用View.GONE只隐藏内容而不隐藏空间的解决方案

最近在处理GridView的时候遇到这样一个问题:Android手机客户端接收服务端返回的一串数据(数据条数不固定),这串数据不一定都要显示到GridView上,也就是说有一部分内容需要隐藏掉,即有一 ...

- Android放大镜效果的简单实现

package com.example.myapi.pictobig; import com.example.myapi.R; import android.content.Context; impo ...

- HDU 1269 迷宫城堡(判断有向图强连通分量的个数,tarjan算法)

迷宫城堡 Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 65536/32768 K (Java/Others)Total Submis ...

- Linux下端口被占用确认

有时候关闭软件后,后台进程死掉,导致端口被占用.下面以JBoss端口8083被占用为例,列出详细解决过程. 解决方法: 1.查找被占用的端口 netstat -tln netstat -tln | g ...

- 【H5】直接拨打电话

一般<a href="tel:400-663-5999">400-663-5999</a>实现. 而形如<a href="tel:*9204 ...

- 在testbench从文件读入激励

在验证verilog逻辑模块功能时候,我们可以从文件中读入激励,便于大规模的验证.文件中的数据我们可以用c++编写程序产生. 第一种读入文件的方法是用系统函数:$readmemb, readmemh, ...

- 关于新版SDK报错You need to use a Theme.AppCompat theme的两种解决办法 - 转

android的一个小问题: Caused by: java.lang.IllegalStateException: You need to use a Theme.AppCompat theme ( ...