CIFAR100与VGG13实战

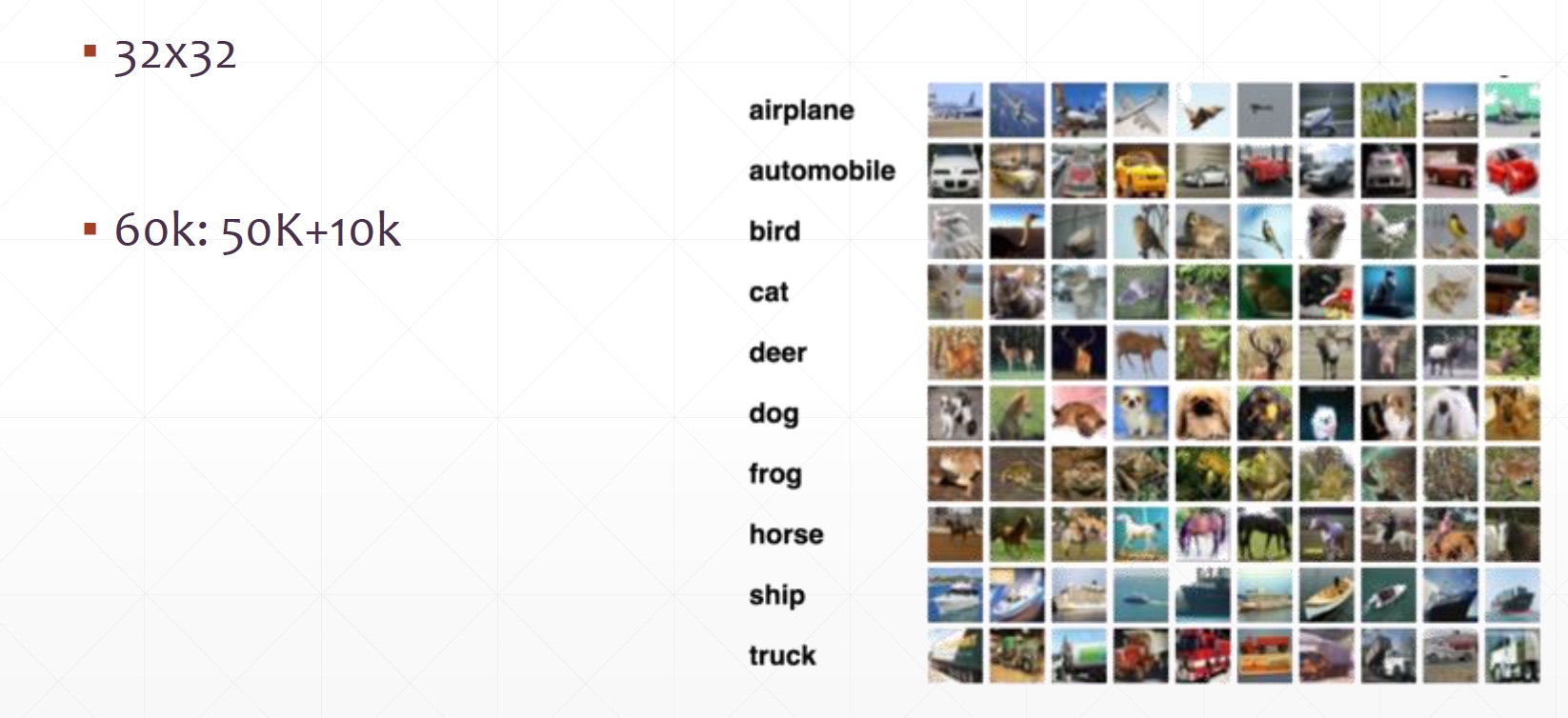

CIFAR100

13 Layers

cafar100_train

import tensorflow as tf

from tensorflow.keras import layers, optimizers, datasets, Sequential

import os

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '2'

conv_layers = [

# 5 units of conv + max polling

# unit 1

layers.Conv2D(64,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.Conv2D(64,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),

# unit2

layers.Conv2D(128,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.Conv2D(128,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),

# unit3

layers.Conv2D(256,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.Conv2D(256,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),

# unit4

layers.Conv2D(512,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.Conv2D(512,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),

# unit5

layers.Conv2D(512,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.Conv2D(512,

kernel_size=[3, 3],

padding="same",

activation=tf.nn.relu),

layers.MaxPool2D(pool_size=[2, 2], strides=2, padding='same'),

]

def preprocess(x, y):

# [0-1]

x = tf.cast(x, dtype=tf.float32) / 255.

y = tf.cast(y, dtype=tf.int32)

return x, y

(x, y), (x_test, y_test) = datasets.cifar100.load_data()

y = tf.squeeze(y, axis=1)

y_test = tf.squeeze(y_test, axis=1)

print(x.shape, y.shape, x_test.shape, y_test.shape)

train_db = tf.data.Dataset.from_tensor_slices((x, y))

train_db = train_db.shuffle(1000).map(preprocess).batch(64)

test_db = tf.data.Dataset.from_tensor_slices((x_test, y_test))

test_db = test_db.map(preprocess).batch(64)

def main():

# [b,32,32,3]-->[b,1,1,512]

conv_net = Sequential(conv_layers)

conv_net.build(input_shape=[None, 32, 32, 3])

# x = tf.random.normal([4, 32, 32, 3])

# out = conv_net(x)

# print(out.shape)

fc_net = Sequential([

layers.Dense(256, activation=tf.nn.relu),

layers.Dense(128, activation=tf.nn.relu),

layers.Dense(100, activation=None),

])

conv_net.build(input_shape=[None, 32, 32, 3])

fc_net.build(input_shape=[None, 512])

optimizer = optimizers.Adam(lr=1e-4)

# [1,2]+[3,4] = [1,2,3,4]

variables = conv_net.trainable_variables + fc_net.trainable_variables

for epoch in range(3):

for step, (x, y) in enumerate(train_db):

with tf.GradientTape() as tape:

# [b,32,32,3]

out = conv_net(x)

# flatten ==> [b,512]

out = tf.reshape(out, [-1, 512])

# [b,512] --> [b,100]

logits = fc_net(out)

# [b] --> [b,100]

y_onehot = tf.one_hot(y, depth=100)

# compute loss

loss = tf.losses.categorical_crossentropy(y_onehot,logits,from_logits=True)

loss = tf.reduce_mean(loss)

grads = tape.gradient(loss,variables)

optimizer.apply_gradients(zip(grads,variables))

if step % 100 ==0:

print(epoch,step,'loss:',float(loss))

total_num = 0

total_correct = 0

for x,y in test_db:

out = conv_net(x)

out = tf.reshape(out, [-1, 512])

logits = fc_net(out)

prob = tf.nn.softmax(logits, axis=1)

pred = tf.argmax(prob, axis=1)

pred = tf.cast(pred, dtype=tf.int32)

correct = tf.cast(tf.equal(pred, y), dtype=tf.int32)

correct = tf.reduce_sum(correct)

total_num += x.shape[0]

total_correct += int(correct)

acc = total_correct / total_num

print(epoch, 'acc:', acc)

if __name__ == '__main__':

main()

CIFAR100与VGG13实战的更多相关文章

- 基于tensorflow2.0和cifar100的VGG13网络训练

VGG是2014年ILSVRC图像分类竞赛的第二名,相比当年的冠军GoogleNet在可扩展性方面更胜一筹,此外,它也是从图像中提取特征的CNN首选算法,VGG的各种网络模型结构如下: 今天代码的原型 ...

- TensorFlow2教程(目录)

第一篇 基本操作 01 Tensor数据类型 02 创建Tensor 03 Tensor索引和切片 04 维度变换 05 Broadcasting 06 数学运算 07 前向传播(张量)- 实战 第二 ...

- Reading | 《TensorFlow:实战Google深度学习框架》

目录 三.TensorFlow入门 1. TensorFlow计算模型--计算图 I. 计算图的概念 II. 计算图的使用 2.TensorFlow数据类型--张量 I. 张量的概念 II. 张量的使 ...

- SSH实战 · 唯唯乐购项目(上)

前台需求分析 一:用户模块 注册 前台JS校验 使用AJAX完成对用户名(邮箱)的异步校验 后台Struts2校验 验证码 发送激活邮件 将用户信息存入到数据库 激活 点击激活邮件中的链接完成激活 根 ...

- GitHub实战系列汇总篇

基础: 1.GitHub实战系列~1.环境部署+创建第一个文件 2015-12-9 http://www.cnblogs.com/dunitian/p/5034624.html 2.GitHub实战系 ...

- MySQL 系列(四)主从复制、备份恢复方案生产环境实战

第一篇:MySQL 系列(一) 生产标准线上环境安装配置案例及棘手问题解决 第二篇:MySQL 系列(二) 你不知道的数据库操作 第三篇:MySQL 系列(三)你不知道的 视图.触发器.存储过程.函数 ...

- Asp.Net Core 项目实战之权限管理系统(4) 依赖注入、仓储、服务的多项目分层实现

0 Asp.Net Core 项目实战之权限管理系统(0) 无中生有 1 Asp.Net Core 项目实战之权限管理系统(1) 使用AdminLTE搭建前端 2 Asp.Net Core 项目实战之 ...

- 给缺少Python项目实战经验的人

我们在学习过程中最容易犯的一个错误就是:看的多动手的少,特别是对于一些项目的开发学习就更少了! 没有一个完整的项目开发过程,是不会对整个开发流程以及理论知识有牢固的认知的,对于怎样将所学的理论知识应用 ...

- asp.net core 实战之 redis 负载均衡和"高可用"实现

1.概述 分布式系统缓存已经变得不可或缺,本文主要阐述如何实现redis主从复制集群的负载均衡,以及 redis的"高可用"实现, 呵呵双引号的"高可用"并不是 ...

随机推荐

- 数字货币期货与现货JavaScript量化策略代码详解汇总

1.动态平衡策略 按照当前的 BTC 的价值,账户余额保留¥5000 现金和 0.1个 BTC,即现金和BTC 市值的初始比例是 1:1. 如果 BTC 的价格上涨至¥6000,即 BTC 市值大于账 ...

- Luogu P1541 乌龟棋 【线性dp】

题目背景 小明过生日的时候,爸爸送给他一副乌龟棋当作礼物. 题目描述 乌龟棋的棋盘是一行 N 个格子,每个格子上一个分数(非负整数).棋盘第1格是唯一的起点,第 N 格是终点,游戏要求玩家控制一个乌龟 ...

- 例题3-4 master-mind hints

下面先附上我的水货代码,,,,一会附上,,,刘大婶给的代码///////3ms #include<stdio.h> #include<string.h> int main() ...

- Python实现判断回文串

回文数的概念:即是给定一个数,这个数顺读和逆读都是一样的.例如:121,1221,a,aa是回文数,123,1231不是回文数. while 1: String = input('请先输入一个字符串 ...

- Ubuntu install and uinstall

一.Ubuntu中软件安装方法 1.APT方式 (1)普通安装:apt-get install softname1 softname2 -; (2)修复安装:apt-get -f install so ...

- 设置当前导航栏(navigationController)的标题

一般在有导航navigationController的情况下,要设置页面的标题很简单 self.title = @"测试"; 也可以 self.navigationItem.tit ...

- Lucky Number Eight dp

https://www.hackerrank.com/contests/w28/challenges/lucky-number-eight 设dp[i][v]表示前i位数中,得到余数是v的子序列的数目 ...

- [书目20150303]软件工程的本质:运用SEMAT内核

译者序Robert Martin作序Bertrand Meyer作序Richard Soley作序前言致谢第一部分 内核思想解释第1章 简要介绍如何使用内核1.1 为什么开发优秀软件具有很 ...

- actuator服务实战

1. actuator服务实战 1.1. 前言 actuator默认集成了很多端点查看,这里我会挑选也用到可能性大些的 1.2. Endpoints 1.2.1. 使用方式 开启服务后,直接访问:lo ...

- pickle序列化与反序列化 + eval说明

import pickle # #1.从文件中读取pickle格式with open('egon.json','rb') as f: pkl=f.read()#2.将json_str转成内存中的数据类 ...