Pytorch-tensor的激活函数

1.激活函数

激活函数的作用是能够给神经网络加入一些非线性因素,使得神经网络可以更好地解决较为复杂的问题。因为很多问题都不是线性的,你只有给它加入一些非线性因素,就能够让问题更好的解决。

函数1:RELU():

优点:

- 1.相比起Sigmoid和tanh,在SGD中能够快速收敛。

- 2.有效缓解了梯度弥散的问题。

a=torch.linspace(-1,1,10)

print(a)

# relu()小于0的都归为0,大于0的成线性

print(torch.relu(a))

输出结果

tensor([-1.0000, -0.7778, -0.5556, -0.333

3, -0.1111, 0.1111, 0.3333, 0.5556,

0.7778, 1.0000])

tensor([0.0000, 0.0000, 0.0000, 0.0000, 0

.0000, 0.1111, 0.3333, 0.5556, 0.7778,

1.0000])

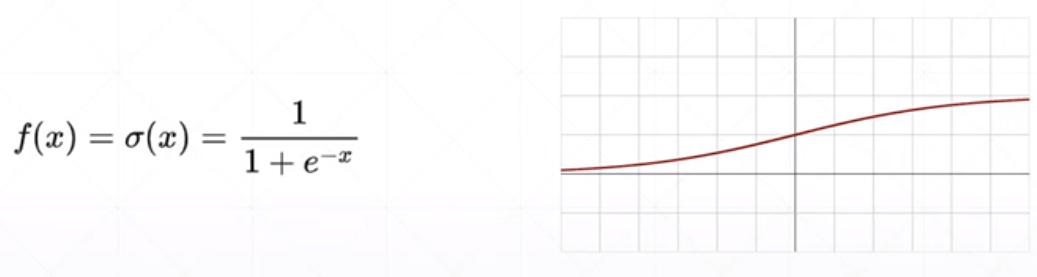

函数2:Sigmoid():

优点:

- 1.Sigmoid函数的输出映射在之间,单调连续,输出范围有限,优化稳定,可以用作输出层。

- 2.求导比较容易。

缺点:

- 1.在两个极端,容易出现梯度弥散。

- 2.其输出并不是以0为中心的。

a=torch.linspace(-100,100,10)

print(a)

# relu()小于0的都归为0,大于0的成线性

print(torch.sigmoid(a))

输出结果

tensor([-100.0000, -77.7778, -55.5556,

-33.3333, -11.1111, 11.1111,

33.3333, 55.5556, 77.7778,

100.0000])

tensor([0.0000e+00, 1.6655e-34, 7.4564e-2

5, 3.3382e-15, 1.4945e-05, 9.9999e-01,

1.0000e+00, 1.0000e+00, 1.0000e+0

0, 1.0000e+00])

函数3:Tanh():

优点:

- 1.比Sigmoid函数收敛速度更快。

- 2.相比Sigmoid函数,其输出以0为中心。

缺点:

- 仍然存在由于饱和性产生的梯度弥散。

a=torch.linspace(-10,10,10)

print(a)

# relu()小于0的都归为0,大于0的成线性

print(torch.tanh(a))

输出结果

tensor([-10.0000, -7.7778, -5.5556, -3

.3333, -1.1111, 1.1111, 3.3333,

5.5556, 7.7778, 10.0000])

tensor([-1.0000, -1.0000, -1.0000, -0.997

5, -0.8045, 0.8045, 0.9975, 1.0000,

1.0000, 1.0000])

函数4:Softmax():

softmax通俗理解的大体意思就是,Z1,Z2,,,Zn中,所有的值,先进行一个e^Zi变换,得到yi,然后在除以所有yi的累加和,得到每个值在整个数组中的比重。经过一次sofymax()函数之后,会放大值与值之间的比例,例如图中的Z1,Z2,经过softmax函数之前,是3:1,经过之后,就变成了0.88:0.12。

作用:将张量的每个元素缩放到(0,1)区间且和为1

下图详细讲解了softmax是怎么计算的,图源于网络。

图中例子代码实现如下:

import torch

import torch.nn.functional as F

if __name__ == '__main__':

data=torch.tensor([3.0,1.0,-3.0])

print(data)

y=F.softmax(data,dim=0)

print(y)

输出结果

tensor([ 3., 1., -3.])

tensor([0.8789, 0.1189, 0.0022])

2维tensor进行softmax例子代码实现如下:

import torch

import torch.nn.functional as F

if __name__ == '__main__':

data=torch.rand(2,3)

print(data)

y=F.softmax(data,dim=1)

# dim=0,就是在1维上进行softmax,也就是在列上进行

# dim=1,就是在2维上进行softmax,也就是在行上进行

print(y)

输出结果

tensor([[0.1899, 0.3969, 0.8333],

[0.9149, 0.8438, 0.4973]])

tensor([[0.2420, 0.2976, 0.4604],

[0.3861, 0.3596, 0.2543]])

Pytorch-tensor的激活函数的更多相关文章

- Pytorch Tensor 常用操作

https://pytorch.org/docs/stable/tensors.html dtype: tessor的数据类型,总共有8种数据类型,其中默认的类型是torch.FloatTensor, ...

- Pytorch Tensor, Variable, 自动求导

2018.4.25,Facebook 推出了 PyTorch 0.4.0 版本,在该版本及之后的版本中,torch.autograd.Variable 和 torch.Tensor 同属一类.更确切地 ...

- pytorch tensor与numpy转换

从官网拷贝过来的,就是做个学习记录.版本 0.4 tensor to numpy a = torch.ones(5) print(a) 输出 tensor([1., 1., 1., 1., 1.]) ...

- pytorch 3 activation 激活函数

2.3 Activation Function import torch import torch.nn.functional as F from torch.autograd import Vari ...

- pytorch tensor 维度理解.md

torch.randn torch.randn(*sizes, out=None) → Tensor(张量) 返回一个张量,包含了从标准正态分布(均值为0,方差为 1)中抽取一组随机数,形状由可变参数 ...

- pytorch tensor的索引与切片

切片方式与numpy是类似. * a[:2, :1, :, :], * 可以用-1索引. * ::2,表示所有数据,间隔为2,即 start:end:step. * a.index_select(1 ...

- Pytorch Tensor 维度的扩充和压缩

维度扩展 x.unsqueeze(n) 在 n 号位置添加一个维度 例子: import torch x = torch.rand(3,2) x1 = x.unsqueeze(0) # 在第一维的位置 ...

- 【Code】numpy、pytorch实现全连接神经网络

""" 利用numpy实现一个两层的全连接网络 网络结构是:input ->(w1) fc_h -> relu ->(w2) output 数据是随机出 ...

- Pytorch(一)

一.Pytorch介绍 Pytorch 是Torch在Python上的衍生物 和Tensorflow相比: Pytorch建立的神经网络是动态的,而Tensorflow建立的神经网络是静态的 Tens ...

- [炼丹术]使用Pytorch搭建模型的步骤及教程

使用Pytorch搭建模型的步骤及教程 我们知道,模型有一个特定的生命周期,了解这个为数据集建模和理解 PyTorch API 提供了指导方向.我们可以根据生命周期的每一个步骤进行设计和优化,同时更加 ...

随机推荐

- KTL 一个支持C++14编辑公式的K线技术工具平台 - 第九版,数据分析工具。支持通达信日线数据。增强即时插件编程体现。

K,K线,Candle蜡烛图. T,技术分析,工具平台 L,公式Language语言使用c++14,Lite小巧简易. 项目仓库:https://github.com/bbqz007/KTL 国内仓库 ...

- Android混淆后的bug日志通过mapping文件找对应行号

背景 由于项目中提测以及线上的apk都是经过混淆处理的,因此拿到日志后也无法正常查看崩溃日志的行号 这个原因是因为混淆了文件,输出的日志是对应不上源文件的,为了正确找到行号需要用到mapping.tx ...

- HiSi 3516CV500 NNIE(Neural Network Inference Engine) 摸鱼记录(1) --- 环境搭建

PS:要转载请注明出处,本人版权所有. PS: 这个只是基于<我自己>的理解, 如果和你的原则及想法相冲突,请谅解,勿喷. 前置说明 本文作为本人csdn blog的主站的备份.(Bl ...

- 元宇宙解决方案——云端GPU在元宇宙中的作用

GPU算力可以说是我们现在信息化时代的基础设施,在某种程度上说我们已经进入了算力时代,手机.电脑.车载等算力已经渗透到各行各业了. 当然算力对元宇宙也很重要,尤其是在可视化方面,元宇宙需要很逼真的渲染 ...

- kali局域网断网攻击

首先我们打开我们熟悉的kali linux操作系统,利用指令: ifconfig 来确认本机的ip地址 确认了本机的ip地址之后,利用一下的指令查看局域网下所有ip: fping -g 本机IP地址/ ...

- Orleans - 1 .NET生态构建分布式系统的利器

在当今数字化时代,构建高效.可靠的分布式系统是许多企业和开发团队面临的挑战.微软的 Orleans 框架为解决这些挑战提供了一个强大而简单的解决方案.本文将介绍 Orleans 的核心概念,并通过一个 ...

- Kafka之Producer网络传输

一.背景 在Kafka的组成部分(Broker.Consumer.Producer)中,设计理念迥异,每个部分都有自己独特的思考.而把这些部分有机地组织起来,使其成为一个整体的便是「网络传输」.区别于 ...

- 《Effective Java》笔记

2. 创建和销毁对象 1. 静态工厂方法替代构造器 优点: 名称清晰 每次调用不必new对象 可以返回原返回类型任意子类型对象 返回的对象可以随着调用而发生改变 返回的对象所属的类,在编写该静态工厂方 ...

- C# 按指定宽高缩放图片

/// <summary> /// 按指定宽高缩放图片 /// </summary> /// <param name="image">原图片&l ...

- 在命令行中使用 cl.exe编译 C/C++ 程序并执行

cl.exe是Microsoft C/C++编译器. 我的VC6.0安装目录为:D:\Program Files (x86)\Microsoft Visual Studio\Common\MSDev9 ...