Hidden Markov Models笔记

Andrew Ng CS229 讲义: https://pan.baidu.com/s/12zMYBY1NLzkluHNeMNO6MQ

HMM模型常用于NLP、语音等领域。

- 马尔科夫模型(Markov Model)

只有状态序列z。状态转移矩阵A。

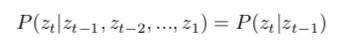

有限视野假设(limited horizon assumption),Markov性:

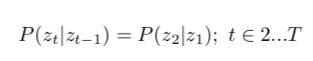

静态过程假设(stationary process assumption),参数时不变性:

两个问题:1)概率问题,2)学习问题

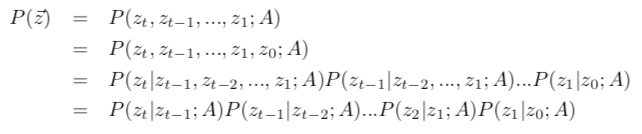

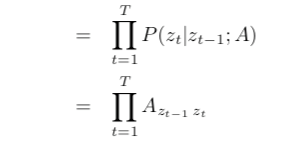

问题1)概率问题:已知转移矩阵A,求某观测状态序列z的概率是多少

根据有限视野假设,

带入计算即可。

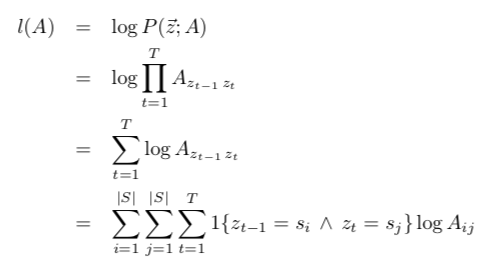

问题2)学习问题:已知观测状态序列z,求参数A最大化z出现的概率

使用最大似然估计,最大化log似然函数

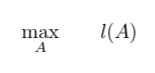

即求解问题

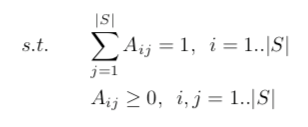

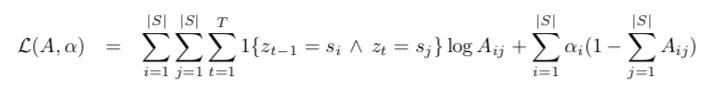

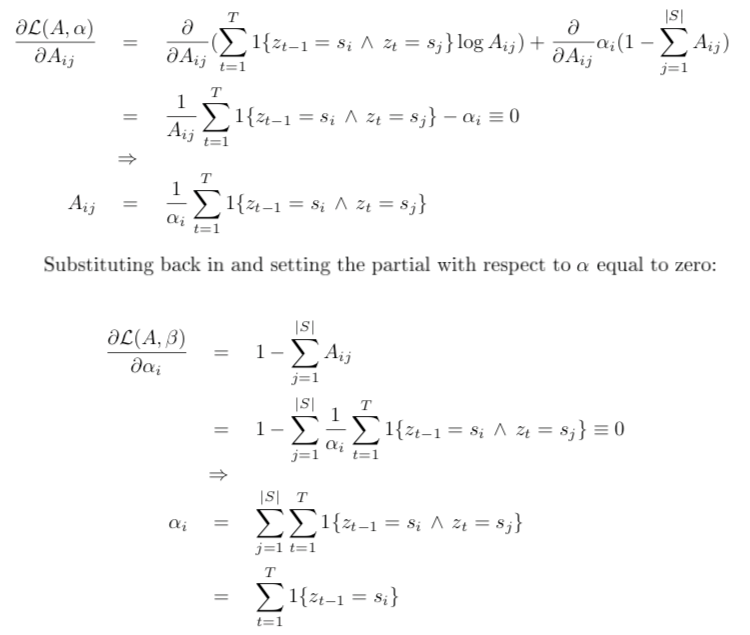

分别对参数求偏导并令其为零:

代入得到状态转移矩阵A的估计:

- 隐马尔科夫模型(Hidden Markov Model)

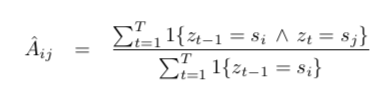

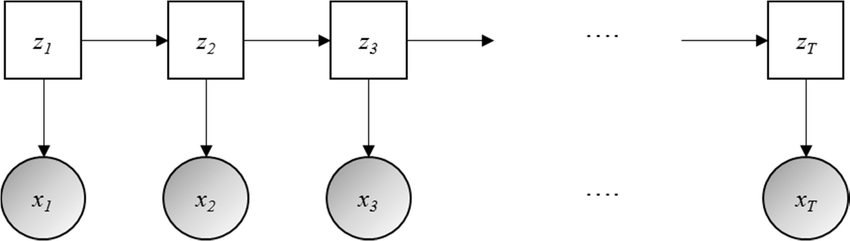

状态序列z,观测序列x。状态转移矩阵A,发射(生成输出)矩阵B。

输出独立假设(output independence assumption):

三个问题:1)概率问题,2)解码问题,3)学习问题

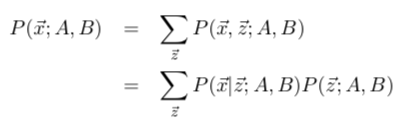

1)概率问题:已知转移矩阵A、发射矩阵B,求观测序列x的概率 - 前向算法

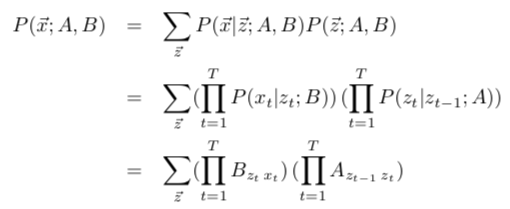

根据输出独立假设,

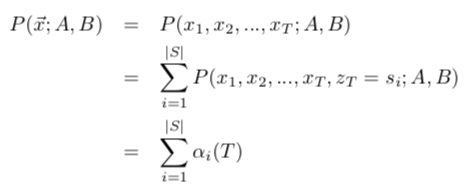

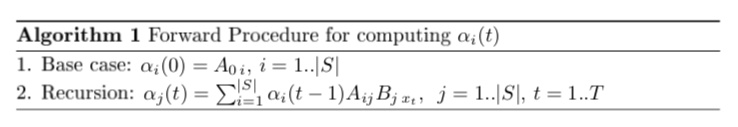

更快的做法是动态规划,即前向算法。

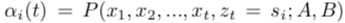

定义

重新推导概率:

类似地,对应有后向算法:

2)解码问题:已知转移矩阵A、发射矩阵B,观测序列x,求状态序列z的概率 - Viterbi算法

使用贝叶斯定理:

更快的做法同样是动态规划。和前向算法不同的地方在于,使用最大化操作代替求和操作,即Viterbi算法。也就是说,现在是跟踪最大化见过的观测子序列的概率,而不是前向算法是对见过的观测子序列的概率全部求和。

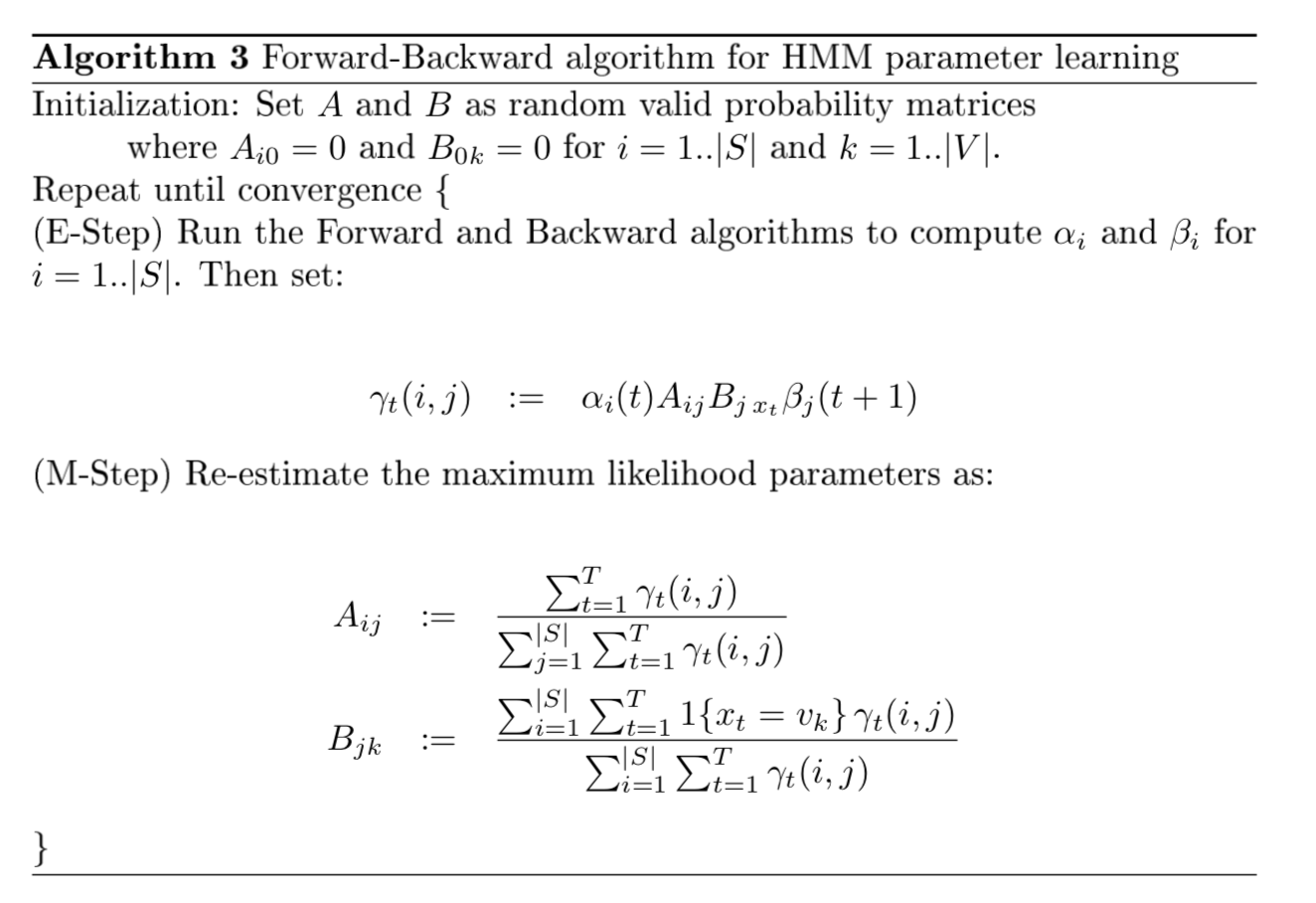

3)学习问题:已知观测序列x,求转移矩阵A、发射矩阵B - Baum-Welch算法(前向-后向算法)

可以理解x是一个很长的序列,和通常的监督学习问题不同在于并非是批量的label-feature样本。

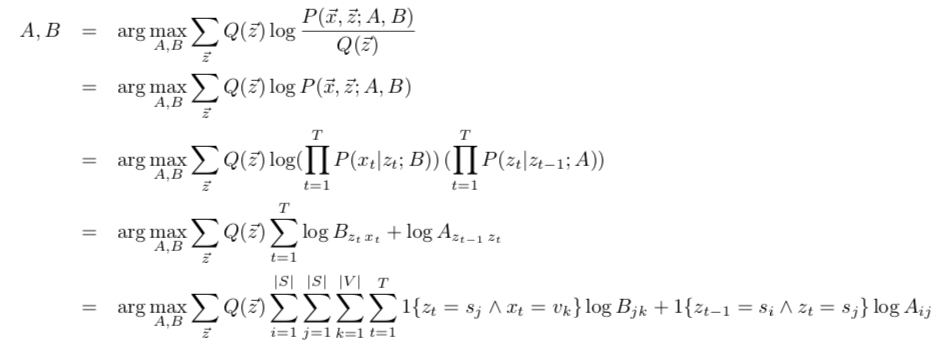

状态序列是隐变量序列。根据EM算法,E步找一个下界逼近目标函数,M步调整参数最大化这个下界:

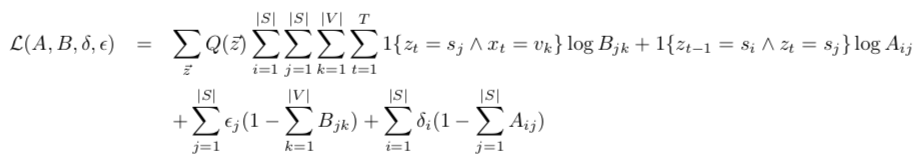

转化为Lagrange multipliers:

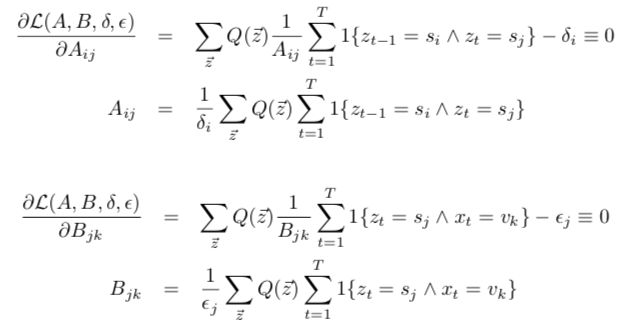

分别对参数求偏导并令其为零:

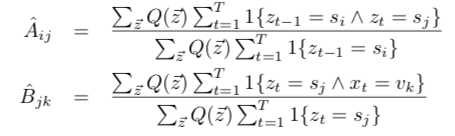

代入得到参数A,B的估计:

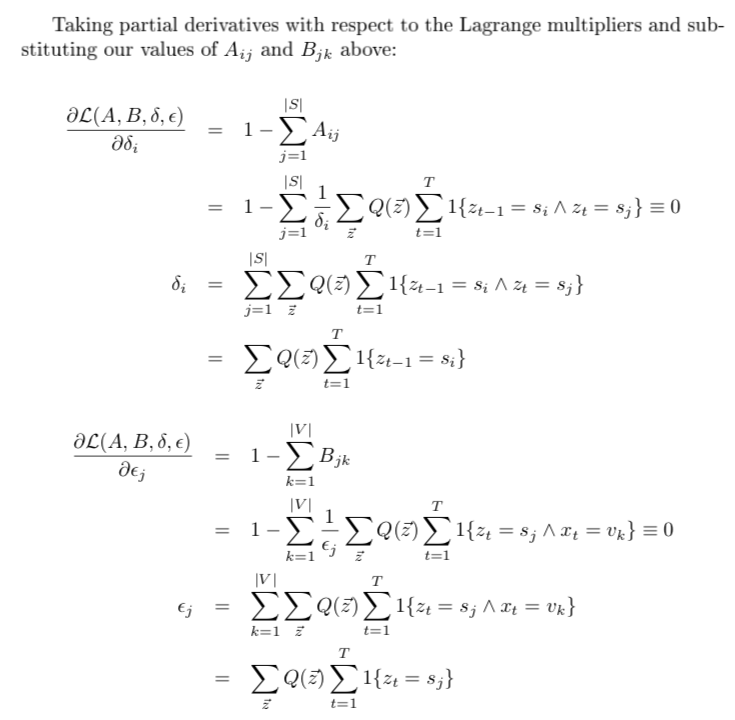

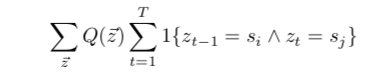

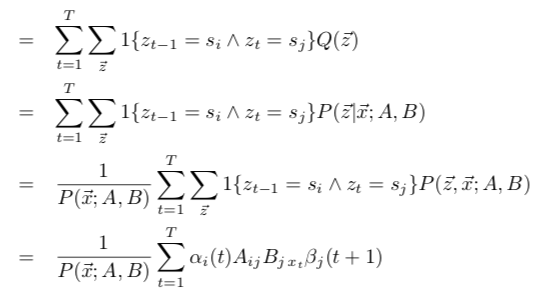

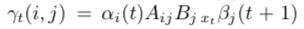

对A的分子部分使用bayes定理并用前向算法和后向算法转化:

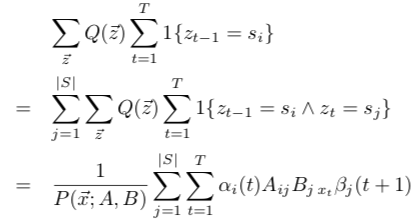

A的分母部分类似:

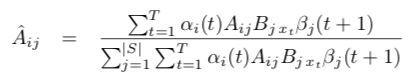

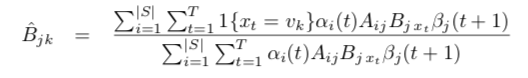

综合得到A的估计:

同理得到B的估计:

实际计算中直接计算充分统计量

和通常的EM求解的问题类似,也是非凸问题,容易陷入局部极值。因此需要做不同的初始化运行多次算法。另外,对于没有样本覆盖到A、B的转移或发射概率的实际问题,需要做平滑操作。

Hidden Markov Models笔记的更多相关文章

- 隐马尔科夫模型(Hidden Markov Models)

链接汇总 http://www.csie.ntnu.edu.tw/~u91029/HiddenMarkovModel.html 演算法笔记 http://read.pudn.com/downloads ...

- PRML读书会第十三章 Sequential Data(Hidden Markov Models,HMM)

主讲人 张巍 (新浪微博: @张巍_ISCAS) 软件所-张巍<zh3f@qq.com> 19:01:27 我们开始吧,十三章是关于序列数据,现实中很多数据是有前后关系的,例如语音或者DN ...

- 机器学习 Hidden Markov Models 1

Introduction 通常,我们对发生在时间域上的事件希望可以找到合适的模式来描述.考虑下面一个简单的例子,比如有人利用海草来预测天气,民谣告诉我们说,湿漉漉的海草意味着会下雨,而干燥的海草意味着 ...

- 机器学习 Hidden Markov Models 2

Hidden Markov Models 下面我们给出Hidden Markov Models(HMM)的定义,一个HMM包含以下几个要素: ∏=(πi)表示初始状态的向量.A={aij}状态转换矩阵 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之三

转自:http://blog.csdn.net/eaglex/article/details/6418219 隐马尔科夫模型(Hidden Markov Models) 定义 隐马尔科夫模型可以用一个 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Markov and Hidden Markov Models

循序渐进的学习步骤是: Markov Chain --> Hidden Markov Chain --> Kalman Filter --> Particle Filter Mark ...

- 机器学习 Hidden Markov Models 3

Viterbi Algorithm 前面我们提到过,HMM的第二类问题是利用HMM模型和可观察序列寻找最有可能生成该观察序列的隐藏变量的序列.简单来说,第一类问题是通过模型计算生成观察序列的概率,而第 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之五

转自:http://blog.csdn.net/eaglex/article/details/6458541 维特比算法(Viterbi Algorithm) 找到可能性最大的隐藏序列 通常我们都有一 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之四

转自:http://blog.csdn.net/eaglex/article/details/6430389 前向算法(Forward Algorithm) 一.如果计算一个可观察序列的概率? 1 ...

随机推荐

- web.xml中url-pattern匹配规则.RP

一.url-pattern的三种写法 精确匹配.以"/"开头,加上servlet名称. /ad 路径匹配.以"/"开头,加上通配符"*" ...

- 发现C#winform编程中不常用的控件(一)<FlowLayoutPanel控件><拆分器控件Splitcontainer >

第一部分:FlowLayoutPanel控件 实现效果: 将FlowLayoutPanel做为导航菜单按钮的容器 以实现 某个菜单按钮不显示时 整体的导航菜单布局不至于"缺憾" 原 ...

- Java之封装特性

Java中的三大特性:继承,封装,多态: 其中封装概念:封装是把过程和数据包围起来,对数据的访问只能通过已定义的接口. 面向对象计算始于这个基本概念,即现实世界可以被描绘成一系列完全自治.封装的 对象 ...

- C 标签使用

JSTL 核心标签库标签共有13个,功能上分为4类: 1.表达式控制标签:out.set.remove.catch 2.流程控制标签:if.choose.when.otherwise 3.循环标签:f ...

- C#之Socket断线重连

一.网上常用方法 1.当Socket.Conneted == false时,调用如下函数进行判断 /// /// 当socket.connected为false时,进一步确定下当前连接状态 /// / ...

- MySQL - ODBC安装错误问题!

MySQL的ODBC安装时候可能会出错,主要原因是缺少VC支持库,需要2010版本的VC支持库!!X86和X64分别对应MySQL对应的ODBC,不能安装一个两个都搞定,如果需要安装两个ODBC驱动, ...

- Orcale常用函数

1.ascii 作用: 返回指定的字符对应的十进制数 select ascii('A') ,ascii('a'),ascii(' ') from dual; 2.chr 作用:给出整数,返回对应的字符 ...

- loj #6235. 区间素数个数 min_12.5筛

\(\color{#0066ff}{ 题目描述 }\) 求 \(1\sim n\) 之间素数个数. \(\color{#0066ff}{输入格式}\) 一行一个数 n . \(\color{#0066 ...

- jdk 1.6.0_41 下载

Java SE Development Kit 6u41 Product / File Description File Size Download password Linux x86 65.43 ...

- CF431B Shower Line

Many students live in a dormitory. A dormitory is a whole new world of funny amusements and possibil ...