【大数据应用技术】作业十一|分布式并行计算MapReduce

本次作业在要求来自:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3319

1.用自己的话阐明Hadoop平台上HDFS和MapReduce的功能、工作原理和工作过程。

1)HDFS

HDFS是分布式文件系统,用来存储海量数据。HDFS中有两类节点:NameNode和DataNode。

NameNode是管理节点,存放文件元数据。也就是存放着文件和数据块的映射表,数据块和数据节点的映射表。也就是说,通过NameNode,我们就可以找到文件存放的地方,找到存放的数据。DataNode是工作节点,用来存放数据块,也就是文件实际存储的地方。

工作原理:客户端向NameNode发起读取元数据的消息,NameNode就会查询它的Block Map,找到对应的数据节点。然后客户端就可以去对应的数据节点中找到数据块,拼接成文件就可以了,这就是读写的流程。

2)MapReduce

MapReduce是并行处理框架,实现任务分解和调度。

工作原理:将一个大任务分解成多个小任务(map),小任务执行完了之后,合并计算结果(reduce)。也就是说,JobTracker拿到job之后,会把job分成很多个maptask和reducetask,交给他们执行。 MapTask、ReduceTask函数的输入、输出都是的形式。HDFS存储的输入数据经过解析后,以键值对的形式,输入到MapReduce()函数中进行处理,输出一系列键值对作为中间结果,在Reduce阶段,对拥有同样Key值的中间数据进行合并形成最后结果。

2.HDFS上运行MapReduce

1)准备文本文件,放在本地/home/hadoop/wc

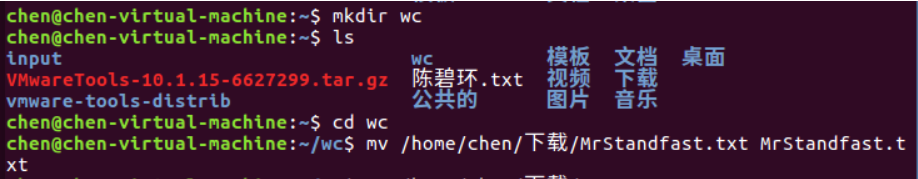

先准备一个大一点英文文本文件,我这里准备的是一个名为Mrstandfast.txt的文本文件,放在了下载目录下,如下图所示。

使用 mkdir wc 命令新建一个名为wc的文件夹,再使用 mv /home/chen/下载/MrStandfast.txt MrStandfast.txt 命令把MrStandfast.txt文件复制到wc中,如下图所示。

2)编写mapper函数和reducer函数,在本地运行测试通过

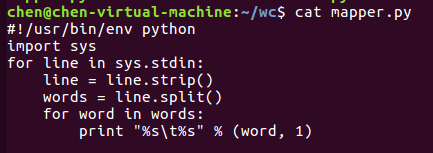

首先,我们可以先编写 mapper函数和reducer函数,使用 gedit mapper.py 命令建立mapper.py文件,在其中插入所要执行的语句,并保存关闭。同理,reducer.py也是这样。

mapper.py

#!/usr/bin/env python

import sys

for line in sys.stdin:

line = line.strip()

words = line.split()

for word in words:

print "%s\t%s" % (word, 1)

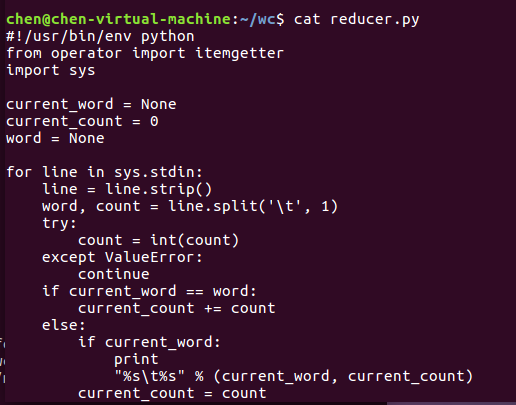

reducer.py

#!/usr/bin/env python from operator import itemgetter

import sys current_word = None

current_count = 0

word = None # input comes from STDIN

for line in sys.stdin:

# remove leading and trailing whitespace

line = line.strip() # parse the input we got from mapper.py

word, count = line.split('\t', 1) # convert count (currently a string) to int

try:

count = int(count)

except ValueError:

# count was not a number, so silently

# ignore/discard this line

continue # this IF-switch only works because Hadoop sorts map output

# by key (here: word) before it is passed to the reducer

if current_word == word:

current_count += count

else:

if current_word:

# write result to STDOUT

print '%s\t%s' % (current_word, current_count)

current_count = count

current_word = word # do not forget to output the last word if needed!

if current_word == word:

print '%s\t%s' % (current_word, current_count)

完成上述步骤后,可以使用 cat mapper.py 命令和 cat reducer.py 命令来查看,如下图所示。

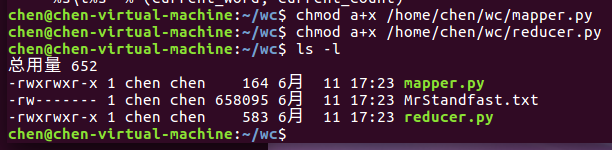

分别使用 chmod a+x /home/chen/wc/mapper.py 和 chmod a+x /home/chen/wc/reducer.py 命令修改mapper和reducer的权限。

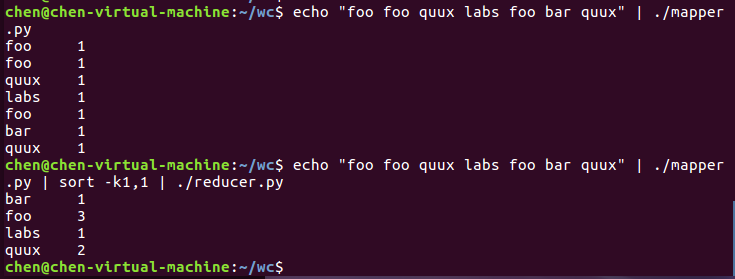

分别使用 echo "foo foo quux labs foo bar quux" | ./mapper 命令和 echo "foo foo quux labs foo bar quux" | ./mapper.py | sort -k1,1 | ./reducer.py 命令在本地测试python代码是否可执行,如下图所示。

3)启动Hadoop:HDFS, JobTracker, TaskTracker

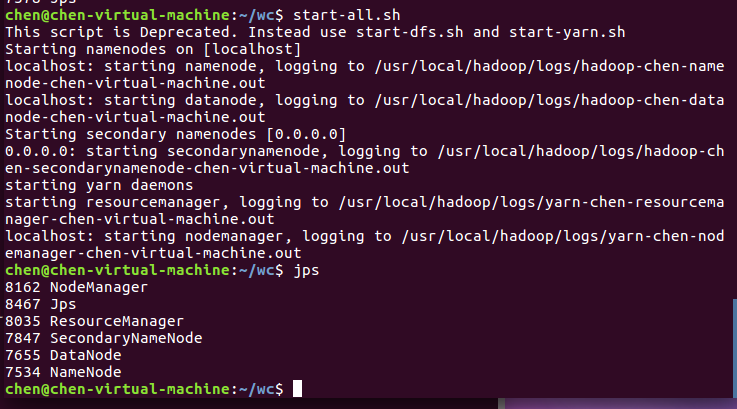

使用 start-all.sh 命令启动hadoop,再使用 jps 命令查看是否启动成功,如下图所示。

4)把文本文件上传到hdfs文件系统上 user/chen/input

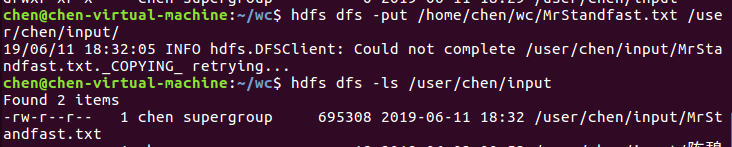

由于我先前做实验时已经创建了 /user/chen/input 这个文件夹了,所以在这里我就直接将本地文件上传即可,使用 hdfs dfs -put /home/chen/wc/MrStandfast.txt /user/chen/input/ 命令把本地的MrStandfast.txt上传至hdfs文件系统上 user/chen/input上,再使用 hdfs dfs -ls /user/chen/input/ 命令来查看文件,如下图所示。

注意:如果先前还没有创建文件夹的,可以使用 hdfs dfs -mkdir -p /user/chen/input 命令来创建文件夹,详见https://www.cnblogs.com/bhuan/p/10964927.html

5)streaming的jar文件的路径写入环境变量,让环境变量生效

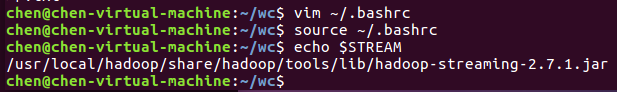

使用 vim ~/.bashrc 命令将streaming的jar文件的路径写入~/.bashrc中,并使用 source ~/.bashrc 让环境变量生效,如下图所示。

streaming的jar文件的路径:

export STREAM=$HADOOP_HOME/share/hadoop/tools/lib/hadoop-streaming-*.jar

6)建立一个shell脚本文件:streaming接口运行的脚本,名称为run.sh

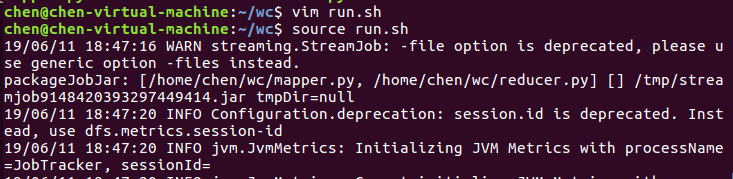

使用 vim run.sh 命令或者 gedit run.sh 命令添加streaming接口运行的脚本,再使用 source run.sh 命令使其生效,如下图所示。

run.sh文件内容

hadoop jar $STREAM \

-file /home/chen/wc/mapper.py \

-mapper /home/chen/wc/mapper.py \

-file /home/chen/wc/reducer.py \

-reducer /home/chen/wc/reducer.py \

-input /user/chen/input/*.txt \

-output /user/chen/wcountput

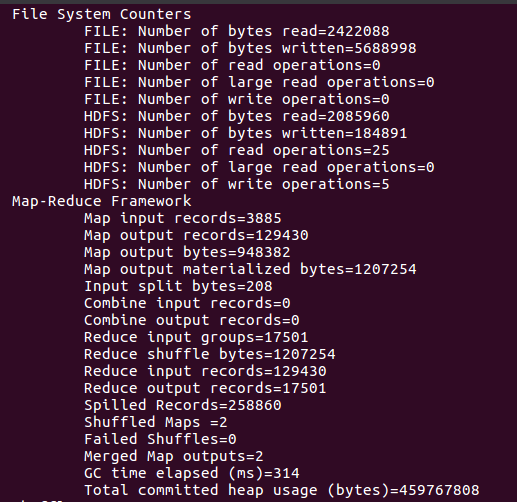

7)source run.sh来执行mapreduce

8)查看运行结果

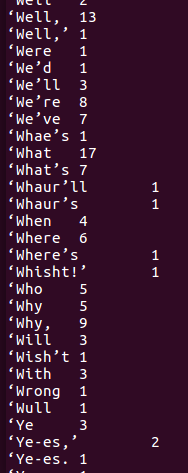

使用 hdfs dfs -cat /user/chen/wcountput/* 命令来查看运行结果,如下图所示。

【大数据应用技术】作业十一|分布式并行计算MapReduce的更多相关文章

- 作业——11 分布式并行计算MapReduce

作业的要求来自于:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3319 1.用自己的话阐明Hadoop平台上HDFS和MapRedu ...

- 大数据 --> 大数据关键技术

大数据关键技术 大数据环境下数据来源非常丰富且数据类型多样,存储和分析挖掘的数据量庞大,对数据展现的要求较高,并且很看重数据处理的高效性和可用性. 传统数据处理方法的不足 传统的数据采集来源单一,且存 ...

- 一文看懂大数据的技术生态圈,Hadoop,hive,spark都有了

一文看懂大数据的技术生态圈,Hadoop,hive,spark都有了 转载: 大数据本身是个很宽泛的概念,Hadoop生态圈(或者泛生态圈)基本上都是为了处理超过单机尺度的数据处理而诞生的.你可以把它 ...

- AI加持的阿里云飞天大数据平台技术揭秘

摘要:2019云栖大会大数据&AI专场,阿里云智能计算平台事业部研究员关涛.资深专家徐晟来为我们分享<AI加持的阿里云飞天大数据平台技术揭秘>.本文主要讲了三大部分,一是原创技术优 ...

- 中国大数据六大技术变迁记(CSDN)

大会召开前期,特别梳理了历届大会亮点以记录中国大数据技术领域发展历程,并立足当下生态圈现状对即将召开的BDTC 2014进行展望: 追本溯源,悉大数据六大技术变迁 伴随着大数据技术大会的发展,我们亲历 ...

- 最近整理出了有关大数据,微服务,分布式,Java,Python,Web前端,产品运营,交互等1.7G的学习资料,有视频教程,源码,课件,工具,面试题等等。这里将珍藏多年的资源免费分享给各位小伙伴们

大数据,微服务,分布式,Java,Python,Web前端,产品运营,交互 领取方式在篇尾!!! 基础篇.互联网架构,高级程序员必备视频,Linux系统.JVM.大型分布式电商项目实战视频...... ...

- 案例分析:大数据平台技术方案及案例(ppt)

大数据平台是为了计算,现今社会所产生的越来越大的数据量,以存储.运算.展现作为目的的平台.大数据技术是指从各种各样类型的数据中,快速获得有价值信息的能力.适用于大数据的技术,包括大规模并行处理(MPP ...

- 【HADOOP】| 环境搭建:从零开始搭建hadoop大数据平台(单机/伪分布式)-下

因篇幅过长,故分为两节,上节主要说明hadoop运行环境和必须的基础软件,包括VMware虚拟机软件的说明安装.Xmanager5管理软件以及CentOS操作系统的安装和基本网络配置.具体请参看: [ ...

- 【大数据应用技术】作业九|安装关系型数据库MySQL 安装大数据处理框架Hadoop

本次作业的要求来自:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3161 1.安装MySql 按ctrl+alt+t打开终端窗口,安 ...

- 了解大数据的技术生态系统 Hadoop,hive,spark(转载)

首先给出原文链接: 原文链接 大数据本身是一个很宽泛的概念,Hadoop生态圈(或者泛生态圈)基本上都是为了处理超过单机尺度的数据处理而诞生的.你能够把它比作一个厨房所以须要的各种工具. 锅碗瓢盆,各 ...

随机推荐

- Linux三剑客grep/sed/awk

grep/sed/awk被称为linux的“三剑客” grep更适合单纯的查找或匹配文本: sed更适合编辑匹配到的文本: awk更适合格式化文本,对文本进行较复杂各式处理: Grep --color ...

- 复盘一篇讲sklearn库学习文章(上)

认识 sklearn 官网地址: https://scikit-learn.gor/stable/ 从2007年发布以来, scikit-learn已成为重要的Python机器学习库, 简称sklea ...

- SQL Text Literals 文本

Text Literals 文本 Use the text literal notation to specify values whenever string appears in the synt ...

- 异常详细信息: System.MissingMethodException: 无法创建抽象类。

asp.net mvc 在使用post向后端传送json数据时报异常,在路由配置中添加如下即可 public static void RegisterRoutes(RouteCollection ro ...

- JSON是什么

JSON是一种取代XML的数据结构,和xml相比,它更小巧但描述能力却不差,由于它的小巧所以网络传输数据将减少更多流量从而加快速度, 那么,JSON到底是什么? JSON就是一串字符串 只不过元素会使 ...

- jquery选择器之全选择器

在CSS中,经常会在第一行写下这样一段样式 * {padding: 0; margin: 0;} 通配符*意味着给所有的元素设置默认的边距.jQuery中我们也可以通过传递*选择器来选中文档页面中的元 ...

- new 的对象如何不分配在堆而分配在栈上(方法逃逸等)

当能够明确对象不会发生逃逸时,就可以对这个对象做一个优化,不将其分配到堆上,而是直接分配到栈上,这样在方法结束时,这个对象就会随着方法的出栈而销毁,这样就可以减少垃圾回收的压力. 如方法逃逸. 逃逸分 ...

- 常用conda命令【转载】

转载地址:https://haoyu.love/blog900.html 一直在用 Conda,很多东西记不住,每次都要查 Doc.那好,就写在这里做个备忘好了. 在 bash 里面自动加载 cond ...

- 《逆袭团队》第九次团队作业【Beta】Scrum meeting 3

项目 内容 软件工程 任课教师博客主页链接 作业链接地址 团队作业9:Beta冲刺与团队项目验收 团队名称 逆袭团队 具体目标 (1)掌握软件黑盒测试技术:(2)学会编制软件项目总结PPT.项目验收报 ...

- vue响应式原理解析

# Vue响应式原理解析 首先定义了四个核心的js文件 - 1. observer.js 观察者函数,用来设置data的get和set函数,并且把watcher存放在dep中 - 2. watcher ...