海外SRC信息收集工具

海外SRC信息收集

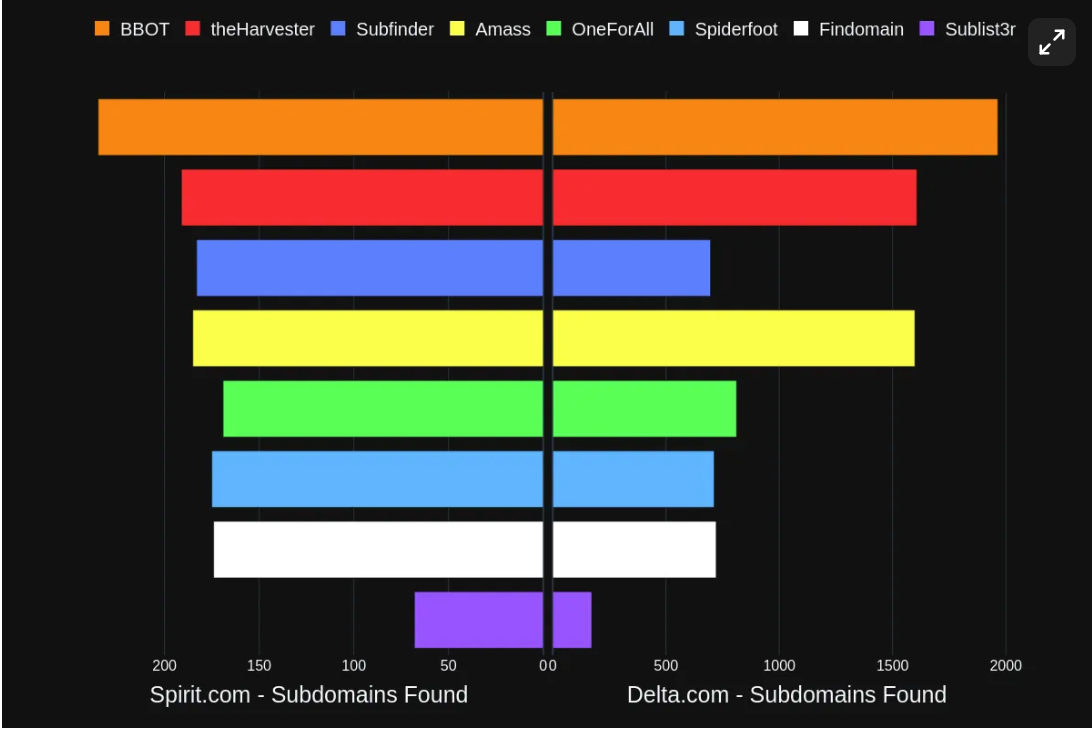

子域名爆破工具:bbot,subfinder

相关测评:https://blog.blacklanternsecurity.com/p/subdomain-enumeration-tool-face-off

bbot收集的子域名最多,subfinder跑的最快

bbot使用

api配置:vim ~/.config/bbot/secrets.yml (配置api辅助收集)

常用命令:

# 收集evilcorp.com的子域名,结果输出到evilcorp.txt文件中

bbot -t evilcorp.com -p subdomain-enum | grep '[DNS_NAME]' | cut -f2 | tee evilcorp.txt

# 提取子域名,输出到domain.txt中

cat evilcorp.txt | grep '[DNS_NAME]' | cut -f2 | tee domain.txt

# 只进行被动扫描

bbot --flags passive --targets evilcorp.com

subfinder使用

api配置:vim $HOME/.config/subfinder/provider-config.yaml(尽可能多api)

常用命令:

# 收集hackerone域名,结果保存为当前目录下hackerone2.txt

subfinder -d hackerone.com -all -silent | tee hackerone2.txt

amass使用

# 被动

amass enum --passive -d example.com -o example.txt

# DNS枚举

amass enum -brute -min-for-recursive 2 -d example.com

使用多个工具收集子域名保存为txt文件,再进行去重:

cat subdomain1.txt subdomain2.txt subdomain3.txt | anew allsubdomains.txt

cat subdomain1.txt subdomain2.txt subdomain3.txt | sort -u > allsubdomains.txt

模糊测试工具:ffuf

常用命令:

基本使用:

# 对hackerone.com进行fuzz,只输出结果

ffuf -w ./wordlist.txt -u https://hackerone.com/FUZZ -s

# 多个单词列表:

ffuf -w domains.txt:DOMAIN -w wordlist.txt:WORD -u 'https://DOMAIN/WORD'

# 过滤结果,后面加上

-mc 200,300-304,401-403

端口扫描工具:nmap

进行端口扫描得到一些隐藏信息

基本使用:

nmap -T4 -sV -sn target_ip

探测存活

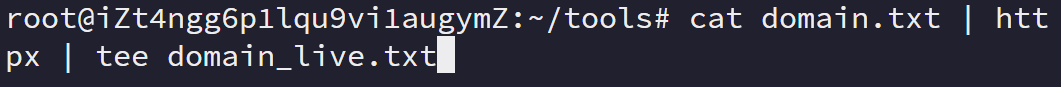

httpx:

详细:https://blog.csdn.net/u010062917/article/details/121878824

# sub.txt不带协议头,subs_live.txt带协议头

cat domain.txt | httpx | tee domain_live.txt

爬取URL

gau:

URL最多,脏数据也很多,建议过滤再去重

$ printf example.com | gau

$ cat domains.txt | gau --threads 5

$ gau example.com google.com

$ gau --o example-urls.txt example.com

$ gau --blacklist png,jpg,gif example.com

# 找到子域名后:

cat domain_live.txt | gau > gau_out.txt

waybackurls:

cat domains.txt | waybackurls > url1.txt

waymore:

找到比其他现有工具更多的链接

# 单个域名只获取 URL

waymore -i hackerone.com -mode U

# 批量获取,不下载

cat domain.txt | waymore -mode U | tee url2.txt

Hakrawler

用于收集 URL 和 JavaScript 文件位置的快速 golang 网络爬虫,

注意:传入的是URL,可以在子域名爆破后用httpx探测存活,再传入hakrawler

# 单个 URL

echo https://google.com | hakrawler

# 多个 URL

cat urls.txt | hakrawler -subs | tee url3.txt

katana

爬取URL

#

cat domain_live.txt | katana -sc -kf robotstxt,sitemapxml -jc -c 50 > url4.txt

来源:https://github.com/projectdiscovery/katana

gospider

用 Go 编写的快速网络蜘蛛

来源:https://github.com/jaeles-project/gospider

gospider -S subs_live.txt -o gospider_output -c 10 -d 2 --other-source --subs --sitemap --robots

paramspider(单独使用):

paramspider允许您从 Wayback 档案中获取与任何域或域列表相关的 URL。它会过滤掉“无聊”的 URL,让您专注于最重要的 URL(sql,xss等)

paramspider -d example.com

paramspider -l domains.txt

URL去重:

cat url1.txt url2.txt url3.txt | anew urls.txt

cat url1.txt url2.txt url3.txt | sort -u > urls.txt

目录扫描

字典(配合ffuf)

# 通用字典

https://github.com/danielmiessler/SecLists/blob/master/uzzing/403/403.md (403绕过)

https://github.com/danielmiessler/SecLists/blob/master/Fuzzing/fuzz-Bo0oM.txt(4k)

https://github.com/Bo0oM/fuzz.txt/blob/master/fuzz.txt (5k)

https://github.com/orwagodfather/WordList/blob/main/fuzz.txt(22k

https://github.com/thehlopster/hfuzz/blob/master/hfuzz.txt(18w)

https:/github.com/six2dez/OneListForAll

# 自定义字典(有时会有奇效) urls.txt是去重后的URL

获取路径字典

cat urls.txt | unfurl paths | sed 's/^.//' | sort -u | egrep -iv

"\.(jpg|swf|mp3|mp4|m3u8|ts|jpeg|gif|css|tif|tiff|png|ttf|woff|woff2|ico|pdf|svg|txt|js)" | tee paths.txt

获取参数字典

cat urls.txt | unfurl keys | sort -u | tee params.txt

dirsearch

# 不要404

python3 dirsearch.py -u https://target -x 404

# 指定字典

python3 dirsearch.py -u https://target -w /path/to/wordlist

# 递归

python3 dirsearch.py -u https://target -r

python3 dirsearch.py -u https://target -r --max-recursion-depth 3 --recursion-status 200-399

BBscan

# 从文件扫描

python BBScan.py -f urls.txt --api

# 从命令行扫描

python BBScan.py --host www.test.com

# 更多

https://github.com/lijiejie/BBScan

信息收集自动化工具

shuize:

python3 ShuiZe.py -d domain.com 收集单一的根域名资产

python3 ShuiZe.py --domainFile domain.txt 批量跑根域名列表

python3 ShuiZe.py -c 192.168.1.0,192.168.2.0,192.168.3.0 收集C段资产

python3 ShuiZe.py -f url.txt 对url里的网站漏洞检测

python3 ShuiZe.py --fofaTitle XXX大学 从fofa里收集标题为XXX大学的资产,然后漏洞检测

python3 ShuiZe.py -d domain.com --justInfoGather 1 仅信息收集,不检测漏洞

python3 ShuiZe.py -d domain.com --ksubdomain 0 不调用ksubdomain爆破子域名

绕过403

工具:https://github.com/iamj0ker/bypass-403

也可以ffuf模糊测试

海外SRC信息收集工具的更多相关文章

- 主机信息收集工具DMitry

主机信息收集工具DMitry DMitry是Kali Linux内置的一款信息收集工具.它的目标主要是Web类主机.它不仅通过主动查询.端口扫描方式,还借助第三方网站和搜索引擎获取信息. 它搜集的 ...

- Kali Linux信息收集工具

http://www.freebuf.com/column/150118.html 可能大部分渗透测试者都想成为网络空间的007,而我个人的目标却是成为Q先生! 看过007系列电影的朋友,应该都还记得 ...

- 网络数据包信息收集工具ferret-sidejack

网络数据包信息收集工具ferret-sidejack 网络数据包传递用户的各种操作和对应的信息.但是由于各种数据混在一起,不利于渗透测试人员分析.Kali Linux提供了一款信息搜集工具ferr ...

- Kali Linux信息收集工具全集

001:0trace.tcptraceroute.traceroute 描述:进行路径枚举时,传统基于ICMP协议的探测工具经常会受到屏蔽,造成探测结果不够全面的问题.与此相对基于TCP协议的探测,则 ...

- Web应用程序信息收集工具wig

Web应用程序信息收集工具wig 很多网站都使用成熟的Web应用程序构建,如CMS.分析网站所使用的Web应用程序,可以快速发现网站可能存在的漏洞.Kali Linux新增加了一款Web应用程序信 ...

- Kali Linux信息收集工具全

可能大部分渗透测试者都想成为网络空间的007,而我个人的目标却是成为Q先生! 看过007系列电影的朋友,应该都还记得那个戏份不多但一直都在的Q先生(由于年级太长目前已经退休).他为007发明了众多神奇 ...

- 【Kail 学习笔记】Dmitry信息收集工具

DMitry(Deepmagic Information Gathering Tool)是一个一体化的信息收集工具.它可以用来收集以下信息: 根据IP(或域名)来查询目标主机的Whois信息 在Net ...

- Kali学习笔记5:被动信息收集工具集

1.Shodan SHODAN搜索引擎不像百度谷歌等,它们爬取的是网页,而SHODAN搜索的是设备. 物联网使用过程中,通常容易出现安全问题,如果被黑客用SHODAN搜索到,后果不堪设想. 网站:ht ...

- 信息收集工具recon-ng详细使用教程

前言: 最近在找Recon-ng详细一点的教程,可是Google才发现资料都很零散而且不详细,所以我打算具体写一下.Recon-ng在渗透过程中主要扮演信息收集工作的角色,同时也可以当作渗透工具,不过 ...

- 菜鸡试飞----SRCの信息收集手册

whois信息 微步在线 https://x.threatbook.cn/ 站长之家 http://whois.chinaz.com/ dns信息-----检测是否存在dns域传送漏洞 子域名的收集 ...

随机推荐

- tar分段压缩导入

压缩 ll drwxrwxrwx 4 postgres postgres 20480 Oct 10 14:54 gitee-repo #分段压缩 tar czf - gitee-repo/ | spl ...

- P7706 文文的摄影布置 题解

P7706 文文的摄影布置 题解 原题 读完题,发现是线段树.单点修改+区间查询. 不过查询的值有些奇怪,就是了,我们考虑用线段树维护这个 ψ 值(下称待求值). 对于一个区间的待求值,大概有四种情况 ...

- 什么是API?(详解)

编程资料时经常会看到API这个名词,网上各种高大上的解释估计放倒了一批初学者.初学者看到下面这一段话可能就有点头痛了. API(Application Programming Interface,应用 ...

- zblog免费插件分享前端代码支持一键复制

zblog默认的代码文件在网页前端是不支持一键复制的,这会让访客复制长代码的时候不太方便,甚至有可能会出错,影响体验,下面分享一个非常简单的免费插件,安装之后,前端代码就能一键复制了. 插件使用方法: ...

- 远程连接 Ubuntu Desktop 桌面

在 Ubuntu 的 设置 > 系统 > 远程桌面 上打开 桌面共享 和 远程控制 选项. sudo apt install gnome-remote-desktop 未完待续 参考: S ...

- LaTeX 常见希腊字母

字母名称 大写 命令 小写 命令 alpha A A α \alpha beta B B β \beta gamma Γ \Gamma γ \gamma delta Δ \Delta δ \delta ...

- Typora mac激活

typora mac版本激活 我也是第一次使用mac电脑,在安装时基本上都是付费的,在mac下载使用typora是试用一段时间后是需要付费购买的,苦无能力有限只能绕一下,感谢网上的各位大佬的分享 来源 ...

- reinstall nodejs 后跑不到 command

现象 : node -v 可以跑 , ng new 这些就跑不到 (确保已经安装了 global cli) 那多半是 path 的问题 https://stackoverflow.com/questi ...

- Maven 使用方法

Maven Maven是一个项目管理工具,它包含了一个项目对象模型(POM:Project Object Model),其表现于一个XML文件(pom.xml),其中包含了项目的基本学习,依赖关系,插 ...

- Project: Kill e

接到上级任务,今天来暗杀 \(e\) 据说杀死 \(e\) 的方式就是把他算出来,好吧,现在我们还是来算一下 考虑使用如下代数式求解 \[e\ \text{site:baidu.com} \] 虽然我 ...