CS224--1:语言模型和词向量

参考:

https://www.cnblogs.com/pinard/p/7243513.html

https://blog.csdn.net/cindy_1102/article/details/88079703

http://web.stanford.edu/class/cs224n/readings/cs224n-2019-notes01-wordvecs1.pdf

1、NLP简介

1.1、什么是自然语言?

用来表示某种意义或东西的符号

1.2、NLP任务

1)、简单

拼写检查

关键词提取

同义词查询

2)、中等

信息抽取

3)、高难

机器翻译

语义分析

指代

问答

2、词向量(word vectors)

2.1、ont-hot

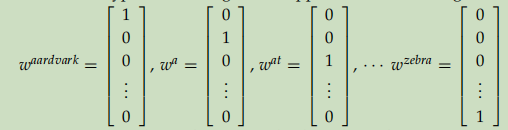

如图,每个词由V维的0,1向量组成,V是词典大小。有以下缺点:

1)、词之间凉凉正交,体现不出诸如男人、女人,中国、日本之间的相关性。

2)、当词典很大时,词向量太大。

那么我们是不是可以找到一种可以以低维的方式且能表示词之间相关性的词向量表示方法呢?

3、基于SVD的方法

4、基于迭代的方法-word2vector

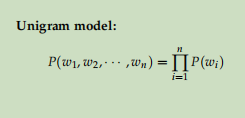

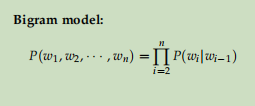

4.1、语言模型

语言模型就是对一个语言序列进行建模。

比如

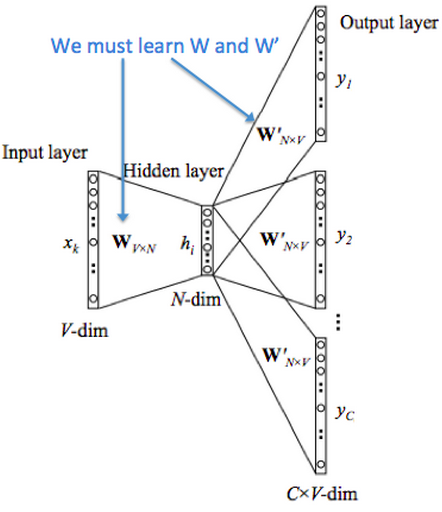

4.2、CBOW

模型思路:一个语言序列,通过某个词其周围的词预测中心词。

符号说明:

- wi : 词典里第i个词

- V : shape: (n, v), 输入的单词矩阵,n代表词向量的维度,v代表词典大小

- vi : V的第i列,shape=(n,1)

- U : shape=(v, n), 输出的单词矩阵

- ui : U的第i行,wi的输出向量表示

模型步骤:

- 对于一个序列,假设某词为x(c),其上下文为x(c-m), ...,x(c-1), x(c+1), ..., x(c+m),将其做one-hot表示

- 通过lookup得到上下文单词的嵌入词向量:v(c-m), v(c-m+1), ..., v(c+m)

- 对上下文词向量求平均:

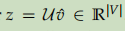

- 将U与3中得到的向量做点乘,得到一个分。

- 对z做softmax进行分类,预测属于哪个词:

- 定义损失函数,交叉熵损失:

- 根据梯度下降法不断迭代反向传播,直到loss收敛。

模型结构:

4.3、skip-gram model

模型思路:一个序列,通过中心词预测其上下文的词。

符号说明:

- wi : 词典里第i个词

- V : shape: (n, v), 输入的单词矩阵,n代表词向量的维度,v代表词典大小

- vi : V的第i列,shape=(n,1)

- U : shape=(v, n), 输出的单词矩阵

- ui : U的第i行,wi的输出向量表示

模型步骤:

- 得到中心词的one-hot表示

- lookup得到中心词的词向量

- 计算得分:

- 根据得分计算softmax, 预测上下文的词:

- 根据4得出的概率,计算预测出的词

- 同样采用交叉熵作为损失函数,此处值得留意的是,预测出的多个上下文单词之间假设是独立的,不因其与中心词的距离而受到影响,因此loss可以这么计算:

- 使用随机梯度下降法优化loss, 直到loss收敛。

模型结构:

4.4、负采样

4.5、hierarchical softmax

词向量训练的时候,假如说词典的大小为v,那么每次前向传播通常需要进行v次的点击运算,然后算出每个词的概率,非常耗时。

这里采用了两个方法减少计算,一个是把词向量进来后经过线性运算通常会加的非线性激活函数给去掉,换成求平均值。第二个就是把词分类的softmax换成一颗二叉霍夫曼树。

和之前的神经网络语言模型相比,我们的霍夫曼树的所有内部节点就类似之前神经网络隐藏层的神经元,其中,根节点的词向量对应我们的投影后的词向量,而所有叶子节点就类似于之前神经网络softmax输出层的神经元,叶子节点的个数就是词汇表的大小。在霍夫曼树中,隐藏层到输出层的softmax映射不是一下子完成的,而是沿着霍夫曼树一步步完成的,因此这种softmax取名为"Hierarchical Softmax"。

如何“沿着霍夫曼树一步步完成”呢?在word2vec中,我们采用了二元逻辑回归的方法,即规定沿着左子树走,那么就是负类(霍夫曼树编码1),沿着右子树走,那么就是正类(霍夫曼树编码0)。判别正类和负类的方法是使用sigmoid函数,即:

其中xwxw是当前内部节点的词向量,而θθ则是我们需要从训练样本求出的逻辑回归的模型参数。

使用霍夫曼树有什么好处呢?首先,由于是二叉树,之前计算量为VV,现在变成了log2Vlog2V。第二,由于使用霍夫曼树是高频的词靠近树根,这样高频词需要更少的时间会被找到,这符合我们的贪心优化思想。

CS224--1:语言模型和词向量的更多相关文章

- Deep Learning In NLP 神经网络与词向量

0. 词向量是什么 自然语言理解的问题要转化为机器学习的问题,第一步肯定是要找一种方法把这些符号数学化. NLP 中最直观,也是到目前为止最常用的词表示方法是 One-hot Representati ...

- 第一节——词向量与ELmo(转)

最近在家听贪心学院的NLP直播课.都是比较基础的内容.放到博客上作为NLP 课程的简单的梳理. 本节课程主要讲解的是词向量和Elmo.核心是Elmo,词向量是基础知识点. Elmo 是2018年提出的 ...

- NLP直播-1 词向量与ELMo模型

翻车2次,试水2次,今天在B站终于成功直播了. 人气11万. 主要讲了语言模型.词向量的训练.ELMo模型(深度.双向的LSTM模型) 预训练与词向量 词向量的常见训练方法 深度学习与层次表示 LST ...

- PyTorch基础——词向量(Word Vector)技术

一.介绍 内容 将接触现代 NLP 技术的基础:词向量技术. 第一个是构建一个简单的 N-Gram 语言模型,它可以根据 N 个历史词汇预测下一个单词,从而得到每一个单词的向量表示. 第二个将接触到现 ...

- [Algorithm & NLP] 文本深度表示模型——word2vec&doc2vec词向量模型

深度学习掀开了机器学习的新篇章,目前深度学习应用于图像和语音已经产生了突破性的研究进展.深度学习一直被人们推崇为一种类似于人脑结构的人工智能算法,那为什么深度学习在语义分析领域仍然没有实质性的进展呢? ...

- word2vec生成词向量原理

假设每个词对应一个词向量,假设: 1)两个词的相似度正比于对应词向量的乘积.即:$sim(v_1,v_2)=v_1\cdot v_2$.即点乘原则: 2)多个词$v_1\sim v_n$组成的一个上下 ...

- 学习笔记CB009:人工神经网络模型、手写数字识别、多层卷积网络、词向量、word2vec

人工神经网络,借鉴生物神经网络工作原理数学模型. 由n个输入特征得出与输入特征几乎相同的n个结果,训练隐藏层得到意想不到信息.信息检索领域,模型训练合理排序模型,输入特征,文档质量.文档点击历史.文档 ...

- 词向量之Word2vector原理浅析

原文地址:https://www.jianshu.com/p/b2da4d94a122 一.概述 本文主要是从deep learning for nlp课程的讲义中学习.总结google word2v ...

- DNN模型训练词向量原理

转自:https://blog.csdn.net/fendouaini/article/details/79821852 1 词向量 在NLP里,最细的粒度是词语,由词语再组成句子,段落,文章.所以处 ...

随机推荐

- 【Linux】Centos7 安装redis最新稳定版及问题解决

------------------------------------------------------------------------------------------------- | ...

- SDUST数据结构 - chap5 数组与广义表

选择题:

- oracle dg库因为standby_file_management参数导致应用停止

DG库的standby_file_management=manual,主库添加文件的时候,备库无法自动创建对应的文件而报错 File #154 added to control file as 'UN ...

- [XAML] 使用 XAML 格式化工具:XAML Styler

1. XAML 的问题 刚入门 WPF/UWP 之类的 XAML 平台,首先会接触到 XAML 这一新事物.初学 XAML 时对它的印象可以归纳为一个词:一坨. 随着我在 XAML 平台上工作的时间越 ...

- 一个div画同心圆

二话不说上代码 background-image:radial-gradient(7px,#00A4FF 50%,#fff 75%,#00A4FF 94%); 7px是圆的半径 效果:

- 《进击吧!Blazor!》第一章 1.初识 Blazor

作者介绍 陈超超 Ant Design Blazor 项目贡献者 拥有十多年从业经验,长期基于.Net技术栈进行架构与开发产品的工作,Ant Design Blazor 项目贡献者,现就职于正泰集团 ...

- JavaWeb三大框架基础架构——CRUD的基础功能搭建

@ 目录 介绍 注意 applicationContext.xml mybatis-config.xml web.xml 结束语 介绍 项目前端采用了bootstrap,后端是ssm三大框架 注意 这 ...

- 获取Java线程转储的常用方法

1. 线程转储简介 线程转储(Thread Dump)就是JVM中所有线程状态信息的一次快照. 线程转储一般使用文本格式, 可以将其保存到文本文件中, 然后人工查看和分析, 或者使用工具/API自动分 ...

- 基于Vue的npm组件库

前言(*❦ω❦) 思维导图可能有点高糊,有点太大了,项目和导图文件放到github或giteee上,这个思维导图也是我文章的架构,思维导图是用FeHelper插件生成的,这个是一款开源chrome插件 ...

- MySQL高可用HA——keepalived配置

0. Keepalived介绍 Keepalived是基于VRRP(Virtual Router Redundancy Protocol,虚拟路由器冗余协议)协议的一款高可用软件.Keepaili ...