Kubernetes的Local Persistent Volumes使用小记

欢迎访问我的GitHub

https://github.com/zq2599/blog_demos

内容:所有原创文章分类汇总及配套源码,涉及Java、Docker、Kubernetes、DevOPS等;

关于Local Persistent Volumes

文中将Local Persistent Volumes简称为Local PV;

- Kubernetes的Local PV自1.7版本进行alpha发布,在1.10版本beta发布,最终的正式发布(General Availability)是在1.14版本;

- 一个Local PV对应指定节点上的一处本地磁盘空间;

- 相比NFS之类的远程存储,Local PV提供了本地IO带来的更好性能;

和HostPath Volume的区别

Local PV出现之前,使用本地磁盘的方法是HostPath Volume,同为使用本地磁盘,区别在哪呢?

- 最重要的区别,就是Local PV和具体节点是有关联的,这意味着使用了Local PV的pod,重启多次都会被Kubernetes scheduler调度到同一节点,而如果用的是HostPath Volume,每次重启都可能被Kubernetes scheduler调度到新的节点,然后使用同样的本地路径;

- 当我们要用HostPath Volume的时候,既可以在PVC声明,又可以直接写到Pod的配置中,但是Local PV只能在PVC声明,对于PV资源,通常都有专人管理,这样就避免了Pod开发者擅自使用本地磁盘带来的冲突和风险;

- 另外要注意的是,HostPath Volume和Local PV都是在使用本地磁盘,和常见的分布式文件系统相比,本地磁盘故障会导致数据丢失,保存重要数据请勿使用HostPath Volume和Local PV;

基本概念说完了,接下来实战体验;

实战环境信息

- 操作系统:CentOS Linux release 7.8.2003 (Core)

- kubernetes:1.15.3

- helm:2.16.1

体验Local PV的步骤简述

本次实战的目标是快速创建Local PV,并验证该Local PV正常可用,全文由以下部分组成:

- 创建Local PV;

- 通过helm下载tomcat的chart;

- 修改chart,让tomcat使用刚才创建的Local PV;

- 部署tomcat;

- 在服务器上检查文件夹已正常写入;

参考文章

如果您想了解Kubernetes和helm的更多信息,请参考:

准备完毕,开始实操;

创建PV

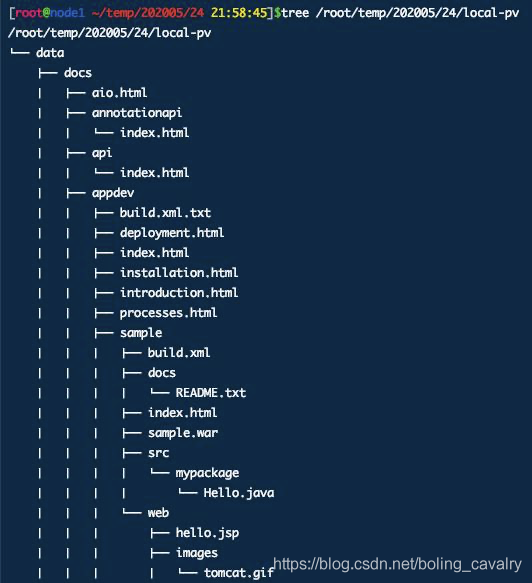

- 在kubernetes工作节点创建文件夹给Local PV使用,我这是:/root/temp/202005/24/local-pv/

- 给上述文件夹读写权限:chmod -R a+r,a+w /root/temp/202005/24/local-pv

- 创建文件local-storage-pv.yaml,内容如下:

apiVersion: v1

kind: PersistentVolume

metadata:

name: example-pv

spec:

capacity:

storage: 10Gi

volumeMode: Filesystem

accessModes:

- ReadWriteOnce

persistentVolumeReclaimPolicy: Delete

storageClassName: local-storage

local:

path: /root/temp/202005/24/local-pv

nodeAffinity:

required:

nodeSelectorTerms:

- matchExpressions:

- key: kubernetes.io/hostname

operator: In

values:

- node1

- 关于local-storage-pv.yaml有以下几点需要注意:

a. spec.storageClassName等于local-storage,后面的PVC中也要指定storageClassName等于local-storage;

b. spec.nodeAffinity是必填参数,用于建立Local PV和节点的关系,spec.nodeAffinity.required,nodeSelectorTerms.matchExpressions.values的值包含node1,表示该Local PV可以在主机名为node1的节点创建; - 执行命令kubectl apply -f local-storage-pv.yaml,即可创建PV;

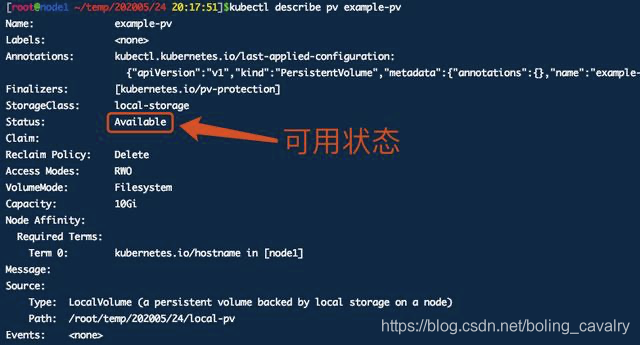

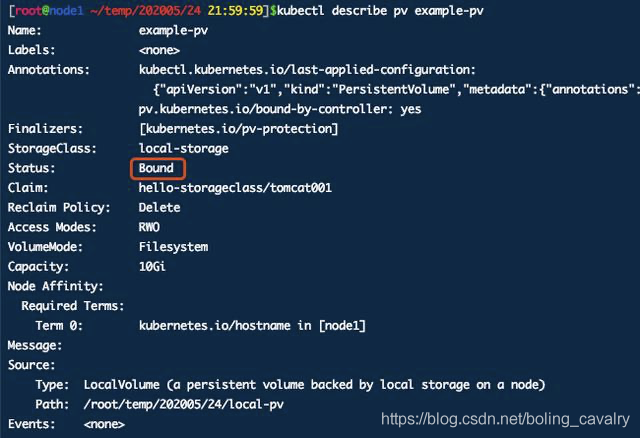

- 执行kubectl describe pv example-pv检查是否创建成功,如下图红框所示,此PV已经可用:

使用PV

接下来通过helm部署tomcat,并且让tomcat使用上述Local PV,请确保helm已经装好;

- 增加helm仓库(带有tomcat的仓库):helm repo add bitnami https://charts.bitnami.com/bitnami

- 下载tomcat的chart:helm fetch bitnami/tomcat

- chart下载成功后,当前目录出现tomcat配置压缩包tomcat-6.2.4.tgz,解压:tar -zxvf tomcat-6.2.4.tgz

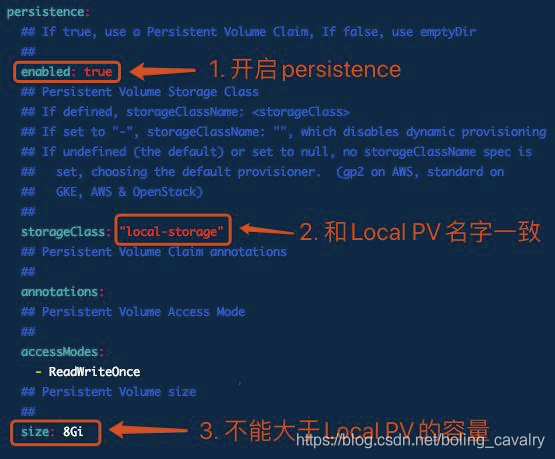

- 解压得到tomcat文件夹,进入后打开values.yaml文件,找到persistence节点,增加下图红框中的内容:

- 在tomcat目录下执行命令:helm install --name-template tomcat001 -f values.yaml . --namespace hello-storageclass

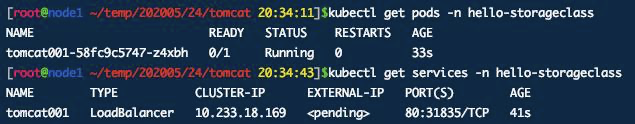

- 查看tomcat的pod和service情况,一切正常,并且端口映射到了宿主机的31835:

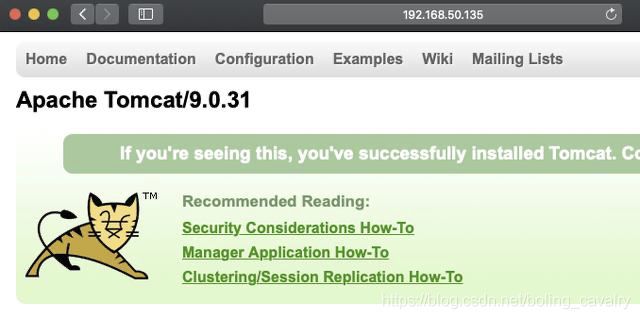

- 浏览器访问宿主机IP:31835,出现tomcat欢迎页面:

- 去目录/root/temp/202005/24/local-pv/检查磁盘使用情况,如下图,可见已分配给tomcat的PVC,并且写入了tomcat的基本数据:

- 再次查看Local PV,发现状态已经改变:

至此可以确认,tomcat用上了Local PV,数据被保存在宿主机的指定文件夹;

清理Local PV

- 一般来说,清理PV要做如下操作:

a. 删除pod,或者deployment;

b. 删除pvc;

c. 删除Local PV; - 这里由于用上了helm,因此通过helm将上述步骤1和2执行掉,既命令helm delete tomcat001

- 再在local-storage-pv.yaml所在目录执行kubectl delete -f local-storage-pv.yaml即可删除Local PV;

至此,Local PV的学习和实践就完成了,如果您正在使用这种存储,希望本文能给您一些参考;

你不孤单,欣宸原创一路相伴

欢迎关注公众号:程序员欣宸

微信搜索「程序员欣宸」,我是欣宸,期待与您一同畅游Java世界...

https://github.com/zq2599/blog_demos

Kubernetes的Local Persistent Volumes使用小记的更多相关文章

- Kubernetes存储之Persistent Volumes简介

简介 管理存储和管理计算有着明显的不同.PersistentVolume子系统给用户和管理员提供了一套API,从而抽象出存储是如何提供和消耗的细节.在这里,我们介绍两种新的API资源:Persiste ...

- kubernetes支持local volume

目录 local volume 创建一个storage class 静态创建PV 使用local volume PV 动态创建PV local volume kubernetes从1.10版本开始支持 ...

- Kubernetes Storage Persistent Volumes

链接:https://kubernetes.io/docs/concepts/storage/persistent-volumes/ 支持的参数,比如mountOptions在这里可以找到 删除正在被 ...

- no persistent volumes available for this claim and no storage class is set FailedBinding -- nfs --存储

添加PV标签oc label pv registrypv disktype=registry oc get pv --show-labels NAME CAPACITY ACCESSMODES REC ...

- 基于容器微服务的PaaS云平台设计(二)通过kubernetes实现微服务容器管理

版权声明:本文为博主原创文章,欢迎转载,转载请注明作者.原文超链接 ,博主地址:http://www.cnblogs.com/SuperXJ/ 上一章描述了基于spring cloud的微服务实例(实 ...

- 浅析Kubernetes的工作原理

先放一张Kubernetes的架构图: 整体来看,是一个老大,多个干活的这种结构,基本上所有的分布式系统都是这样,但是里面的组件名称就纷繁复杂,下面将一一解析. 1.元数据存储与集群维护 作为一个集群 ...

- kubernetes大概的工作原理

先放一张Kubernetes的架构图: 整体来看,是一个老大,多个干活的这种结构,基本上所有的分布式系统都是这样,但是里面的组件名称就纷繁复杂,下面将一一解析. 1.元数据存储与集群维护 作为一个集群 ...

- 轻松理解 Kubernetes 的核心概念

Kubernetes 迅速成为云环境中软件部署和管理的新标准. 与强大的功能相对应的是陡峭的学习曲线. 本文将提供 Kubernetes 的简化视图,从高处观察其中的重要组件,以及他们的关联. 硬件 ...

- 给小白的 PG 容器化部署教程(下)

作者:王志斌 编辑:钟华龙 本文来自社区小伙伴 王志斌 的投稿.从小白的角度,带你一步步实现将 RadonDB PostgreSQL 集群部署到 Kubernetes 上.文章分为上下两部分,< ...

随机推荐

- XML fragments parsed from previous mappers already contains value for

1. ssm项目报错: WARN [main] DefaultListableBeanFactory:1479-- Bean creation exception on FactoryBean t ...

- 经典c程序100例==91--100

[程序91] 题目:时间函数举例1 1.程序分析: 2.程序源代码: #include "stdio.h" #include "time.h" void mai ...

- 利用Github Action和.Net 5 自动执行米游社原神每日签到福利

GenshinDailyHelper 原神的签到福利是需要单独下载APP进行才可以领取,并且每天需要打卡,虽然奖励并不是很可观,但有一些摩拉,食材和可观的经验书累计起来还是挺有吸引力的.可能本身不怎么 ...

- 找回了当年一篇V4L2 linux 摄像头驱动的博客

从csdn找回 , 无缘无故被封了..当时损失不少啊!!!!!!!!! linux 摄像头驱动 :核心数据结构: /** * struct fimc_dev - abstraction ...

- kafka消费者offset存储策略

由于 consumer 在消费过程中可能会出现断电宕机等故障,consumer 恢复后,需要从故 障前的位置的继续消费,所以 consumer 需要实时记录自己消费到了哪个 offset,以便故障恢 ...

- 1、线性DP 198. 打家劫舍

198. 打家劫舍 https://leetcode-cn.com/problems/house-robber/ //dp动态规划,dp[i] 状态表示0-i家的盗的得最大值.那么dp[i] = (d ...

- MFC窗口通过OpenCV显示图片

思路非常讨巧,就是将namedWindow创建的窗口的客户区贴到MFC的图片控件里面去,然后将剩下的窗口框架隐藏掉,代码如下: cv::Mat img = cv::imread("./tes ...

- binary hacks读数笔记(dlopen、dlsym、dlerror、dlclose)

1.dlopen是一个强大的库函数.该函数将打开一个动态库,并把它装入内存.该函数主要用来加载库中的符号,这些符号在编译的时候是不知道的.比如 Apache Web 服务器利用这个函数在运行过程中加载 ...

- rgw前端替换civetweb为beast

前言 ceph的rgw现在提供了两种前端, civetweb和beast 配置 修改配置文件 rgw_frontends = civetweb port=7481 为 rgw frontends = ...

- ceph的jewel新支持的rbd-nbd

jewel版本新增加了一个驱动NBD,允许librbd实现一个内核级别的rbd NBD相比较于kernel rbd: rbd-ko是根据内核主线走的,升级kernel rbd需要升级到相应的内核,改动 ...