通俗地说逻辑回归【Logistic regression】算法(一)

在说逻辑回归前,还是得提一提他的兄弟,线性回归。在某些地方,逻辑回归算法和线性回归算法是类似的。但它和线性回归最大的不同在于,逻辑回归是作用是分类的。

还记得之前说的吗,线性回归其实就是求出一条拟合空间中所有点的线。逻辑回归的本质其实也和线性回归一样,但它加了一个步骤,逻辑回归使用sigmoid函数转换线性回归的输出以返回概率值,然后可以将概率值映射到两个或更多个离散类。

如果给出学生的成绩,比较线性回归和逻辑回归的不同如下:

- 线性回归可以帮助我们以0-100的等级预测学生的测试分数。线性回归预测是连续的(某个范围内的数字)。

- Logistic回归可以帮助预测学生是否通过。逻辑回归预测是离散的(仅允许特定值或类别)。我们还可以查看模型分类背后的概率值。

一.从回归到分类的核心 --Sigmoid Function

之前介绍线性回归的时候,它的函数是这样样子的:

h(x)=θ0 + θ1 * x1 + θ2 * x2 + θ3 * x3 ...

但这样的函数是没办法进行分类的工作的,所以我们要借助一下其他函数,那就是Sigmoid Function。

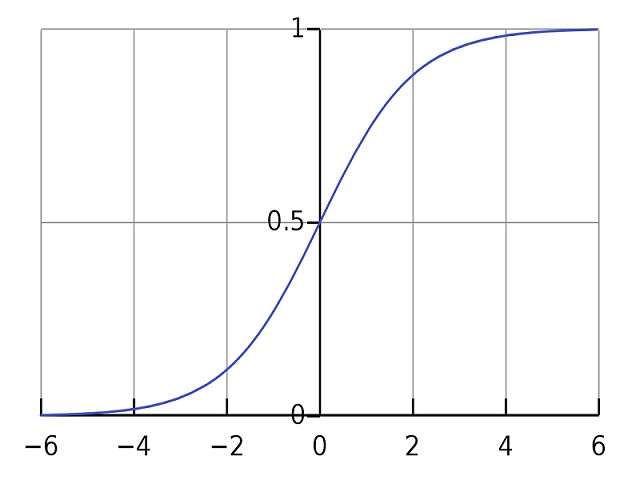

我们先来看看这个Sigmoid Function长什么样,Sigmoid Function的数学公式是这样子的:

如果表示在平面坐标轴上呢,那它长这个样子。

这个Sigmoid Function可以将线性的值,映射到[0-1]这个范围中。如果映射结果小于0.5,则认为是负的样本,如果是大于0.5,则认为是正的样本。

比方说要对垃圾邮箱进行分类,分垃圾邮箱和正常邮箱。当这个Sigmoid Function的计算出来后,小于0.5,则认为是垃圾邮箱,大于0.5则是非垃圾邮箱。

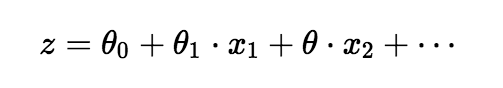

原先线性回归的计算公式是这样的:

那么将这个z函数代入到Sigmoid Function中,OK,现在我们就有了一个逻辑回归的函数了。

二.代价函数Cost Function

和线性回归一样,逻辑回归也有代价函数。并且都是通过最小化Cost Function来求得最终解的。

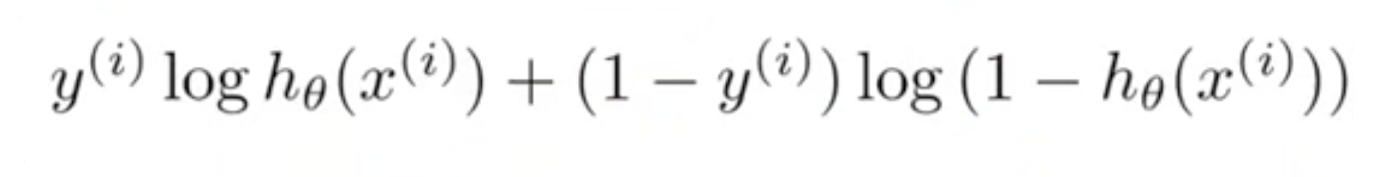

我们先来看单个点的情况,

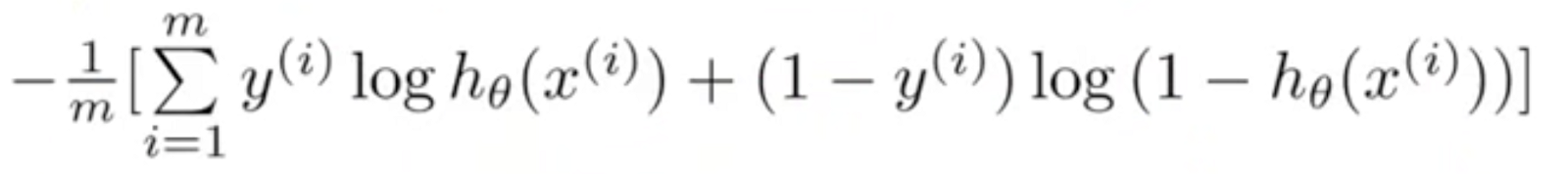

这个代价函数呢,叫做交叉熵,其中y(i)指的是预测的结果,而hθ(xi)指的是xi这个点原本的值。

那么它具体是什么意思呢,为什么叫做交叉熵?我们举两个极端的例子看看就明白了:

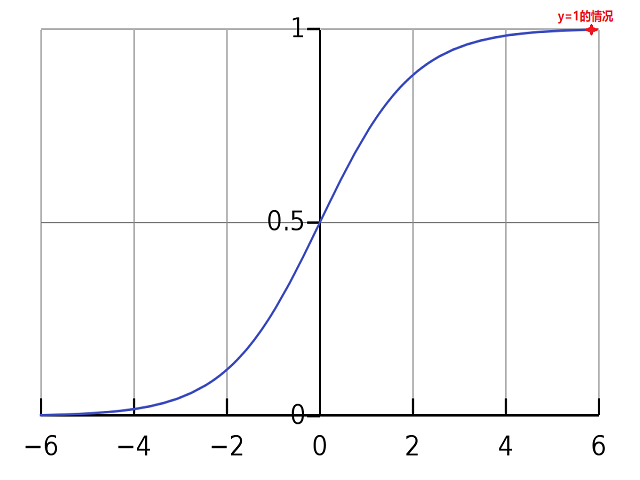

1.xi原始值hθ=1,预测结果,yi=1的情况

这个时候,代价函数的加号右边会被消掉,因为右边(1-y(i))是0,左边部分呢,因为hθ(xi)=1,故而log(1)=0。

y(i)log(hθ(xi)) = 1 * log(0) = 0

也就是说,若xi原始值是1,当预测值y=1的时候,代价函数是0的。这个也比较好理解,代价函数为0就是说预测结果和原始结果完全一致的,没有半点出差错。

2.计算结果,yi=0,原始值hθ=0

这次的结果就和上面的反过来了,因为yi=0,所以左边部分全军覆没,来看右边,

(1-yi) * log(1-hθ(xi)) = 1 * log(0) = 0

因为1-hθ(xi),最终结果还是等于0。

也就是说,这个损失函数,只要原始值与预测结果越相符,损失函数就越大,反之,损失函数就会越小。

以上说的只是一个点的情况,实际的代价函数,是要计算所有点的损失函数的均值,如下所示:

三.梯度下降

和线性回归一样,逻辑回归的解法也可以通过梯度下降来进行求解。梯度下降的目的,是为了最小化代价函数Cost function。

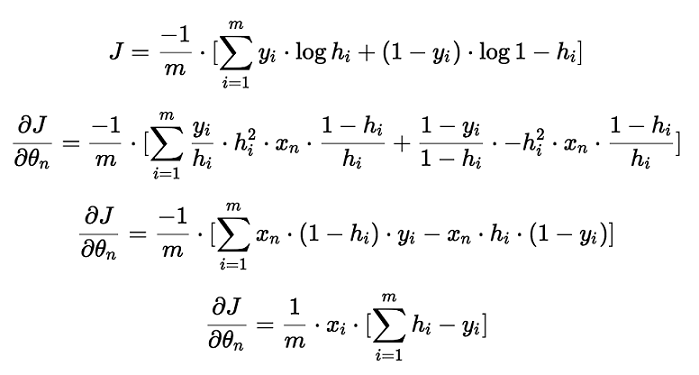

要求使用梯度下降,需要先求解偏导数,以下是求导数的一个具体过程:

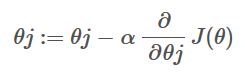

而梯度下降的计算方法也和线性回归的计算方法是一样的。只是其中的代价函数,换成了逻辑回归的代价函数。

其中,α右边部分对应我们上面对代价函数求偏导的结果。而α是用来控制训练速率的,这个在线性回归那里已经有说到,这里就不再介绍了。

最终就是对θj不断迭代,直到损失函数降到最小,那就可以求出我们要的θ值了。

四.小结

OK,今天介绍了线性回归和逻辑回归的区别,同样都是回归分析,逻辑回归能完成分类任何的核心,就算使用了Sigmoid Function。

这里留一个小问题,上面所述的逻辑回归,通常是仅仅能够进行二分类,那有没有办法来让逻辑回归实现多分类呢?

下一次将阐述用逻辑回归进行多分类,以及正则化相关内容,并介绍sklearn的逻辑回归参数和用法!!

以上~~

推荐阅读:

通俗得说线性回归算法(一)线性回归初步介绍

通俗得说线性回归算法(二)线性回归初步介绍

Scala 函数式编程指南(一) 函数式思想介绍

通俗地说决策树算法(二)实例解析

大数据存储的进化史 --从 RAID 到 Hadoop Hdfs

C,java,Python,这些名字背后的江湖!

通俗地说逻辑回归【Logistic regression】算法(一)的更多相关文章

- 机器学习总结之逻辑回归Logistic Regression

机器学习总结之逻辑回归Logistic Regression 逻辑回归logistic regression,虽然名字是回归,但是实际上它是处理分类问题的算法.简单的说回归问题和分类问题如下: 回归问 ...

- Coursera公开课笔记: 斯坦福大学机器学习第六课“逻辑回归(Logistic Regression)” 清晰讲解logistic-good!!!!!!

原文:http://52opencourse.com/125/coursera%E5%85%AC%E5%BC%80%E8%AF%BE%E7%AC%94%E8%AE%B0-%E6%96%AF%E5%9D ...

- 机器学习方法(五):逻辑回归Logistic Regression,Softmax Regression

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 技术交流QQ群:433250724,欢迎对算法.技术.应用感兴趣的同学加入. 前面介绍过线性回归的基本知识, ...

- 机器学习 (三) 逻辑回归 Logistic Regression

文章内容均来自斯坦福大学的Andrew Ng教授讲解的Machine Learning课程,本文是针对该课程的个人学习笔记,如有疏漏,请以原课程所讲述内容为准.感谢博主Rachel Zhang 的个人 ...

- ML 逻辑回归 Logistic Regression

逻辑回归 Logistic Regression 1 分类 Classification 首先我们来看看使用线性回归来解决分类会出现的问题.下图中,我们加入了一个训练集,产生的新的假设函数使得我们进行 ...

- 逻辑回归(Logistic Regression)详解,公式推导及代码实现

逻辑回归(Logistic Regression) 什么是逻辑回归: 逻辑回归(Logistic Regression)是一种基于概率的模式识别算法,虽然名字中带"回归",但实际上 ...

- 机器学习(四)--------逻辑回归(Logistic Regression)

逻辑回归(Logistic Regression) 线性回归用来预测,逻辑回归用来分类. 线性回归是拟合函数,逻辑回归是预测函数 逻辑回归就是分类. 分类问题用线性方程是不行的 线性方程拟合的是连 ...

- 机器学习入门11 - 逻辑回归 (Logistic Regression)

原文链接:https://developers.google.com/machine-learning/crash-course/logistic-regression/ 逻辑回归会生成一个介于 0 ...

- [笔记]机器学习(Machine Learning) - 02.逻辑回归(Logistic Regression)

逻辑回归算法是分类算法,虽然这个算法的名字中出现了"回归",但逻辑回归算法实际上是一种分类算法,我们将它作为分类算法使用.. 分类问题:对于每个样本,判断它属于N个类中的那个类或哪 ...

- 逻辑回归 Logistic Regression

逻辑回归(Logistic Regression)是广义线性回归的一种.逻辑回归是用来做分类任务的常用算法.分类任务的目标是找一个函数,把观测值匹配到相关的类和标签上.比如一个人有没有病,又因为噪声的 ...

随机推荐

- [JavaScript] 《JavaScript高级程序设计》笔记

1.|| 和 && 这两个逻辑运算符和c#是类似的,都是惰性的计算 a() || b() 若a()为真返回a()的结果,此时b()不计算: a()为假则返回b() a() &am ...

- Javascript设计模式——建造者模式

建造者模式是相对比较简单的一种设计模式,属于创建型模式的一种: 定义:将一个复杂的对象分解成多个简单的对象来进行构建,将复杂的构建层与表现层分离,使相同的构建过程可以创建不同的表示模式: 优点: ...

- 软件开发工具(第7章:Eclipse入门)

一.Eclipse简介 Eclipse [iˈklips],是一个开放源代 码的.基于Java的可扩展集成应 用程序开发环境. Eclipse最初主要用来进行Java语 言开发,但并非只有这个用途. ...

- .NET斗鱼直播弹幕客户端(上)

现在直播平台由于弹幕的存在,主播与观众可以更轻松地进行互动,非常受年轻群众的欢迎.斗鱼TV就是一款非常流行的直播平台,弹幕更是非常火爆.看到有不少主播接入弹幕语音播报器.弹幕点歌等模块,这都需要首先连 ...

- 分库分表(4) ---SpringBoot + ShardingSphere 实现分表

分库分表(4)--- ShardingSphere实现分表 有关分库分表前面写了三篇博客: 1.分库分表(1) --- 理论 2.分库分表(2) --- ShardingSphere(理论) 3.分库 ...

- spring boot通过Spring Data Redis集成redis

在spring boot中,默认集成的redis是Spring Data Redis,Spring Data Redis针对redis提供了非常方便的操作模版RedisTemplate idea中新建 ...

- PCA 算法核心:高维度向量向低维度投影

Principal Component Analysis:主成分分析 步骤 5 步: 1.去平均值,也就是将向量中每一项都减去各自向量的平均值 2.计算矩阵的方差,协方差,特征值, 3,.把特征值从大 ...

- 设计模式常见面试知识点总结(Java版)

设计模式 这篇总结主要是基于我设计模式系列的文章而形成的的.主要是把重要的知识点用自己的话说了一遍,可能会有一些错误,还望见谅和指点.谢谢 更多详细内容可以到我的cdsn博客上查看: https:// ...

- Ubuntu安装exfat工具

sudo apt-get undate sudo apt-get install exfat-utils

- web前端开发自学路线是怎样的?html+css+JavaScript的学习方法?

不废话,直接干货 学习前端的几个个阶段: 一阶段:html标签.html5新增标签.css样式.css3样式.媒体查询等 二阶段:JavaScript.jQuery.ajax.面向对象.http传输协 ...