循环神经网络RNN及LSTM

一、循环神经网络RNN

RNN综述 https://juejin.im/entry/5b97e36cf265da0aa81be239

RNN中为什么要采用tanh而不是ReLu作为激活函数? https://blog.csdn.net/behboyhiex/article/details/80819530

LSTM该不该使用RELU? https://blog.csdn.net/xygl2009/article/details/78855795

从RNN的结构特征可以容易看出它最擅长解决与时间序列相关的问题。

循环神经网络每一个时刻都有一个输入xi,然后根据上一时刻的状态h(i-1)和当前的输入xi计算当前的状态hi,并输出ot。

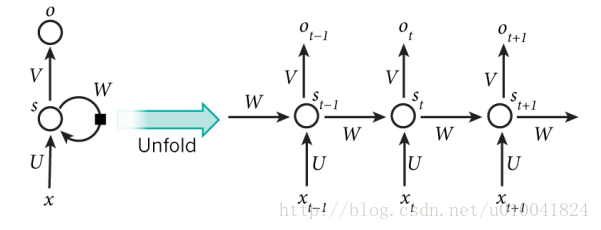

RNN的展开在模型训练有重要意义,从下图可以看到,RNN对长度为N的训练展开后,可以视为一个有N个中间层的前馈神经网络,这个前馈神经网络没有循环链接,因此可以直接使用反向传播算法训练,而不需要任何特别的优化算法。这样的训练方法称为"沿时间反向传播"(Back-Propagation Through Time),是训练RNN最常见的方法。

RNN展开图:

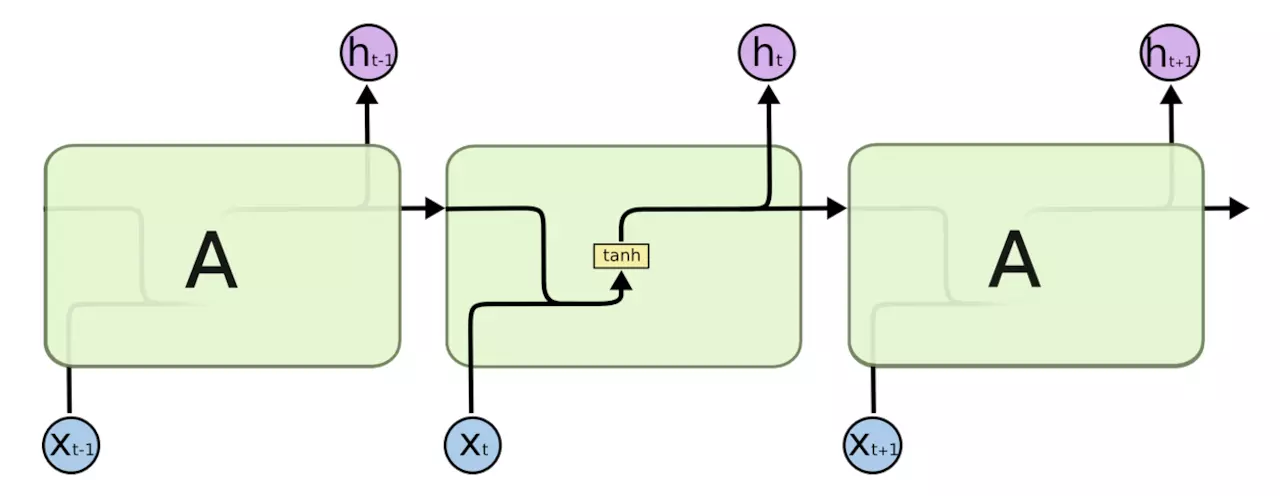

或者更清晰如图:

参考 https://www.zhihu.com/question/41949741

图 4:使用单层全连接神经网络作为循环体的 RNN 结构图,图中黄色的 tanh 小方框表示一个使用 tanh 作为激活函数的全连接层。

https://juejin.im/entry/5b97e36cf265da0aa81be239

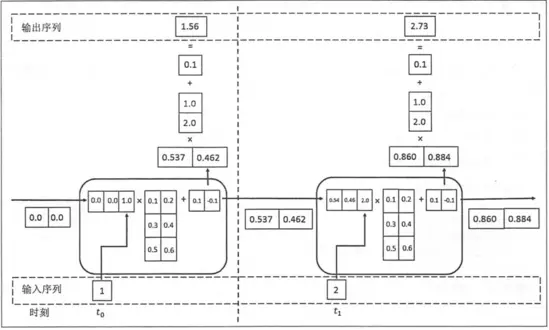

图3为RNN 的前向传播计算过程:

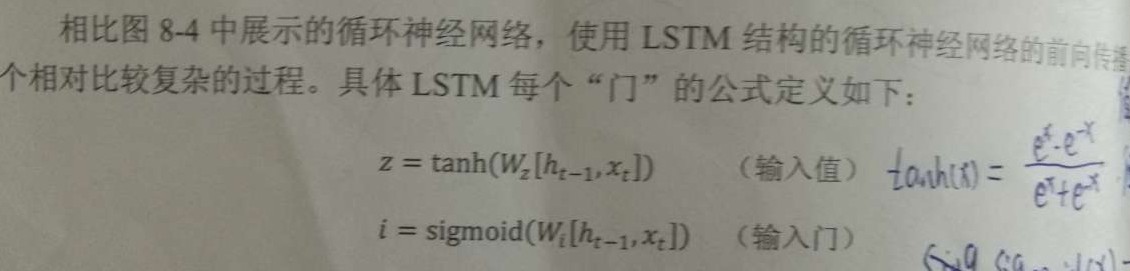

二、LSTM

LSTM综述 https://www.jianshu.com/p/9dc9f41f0b29

LSTM单元示意图:

各个门的定义示意:

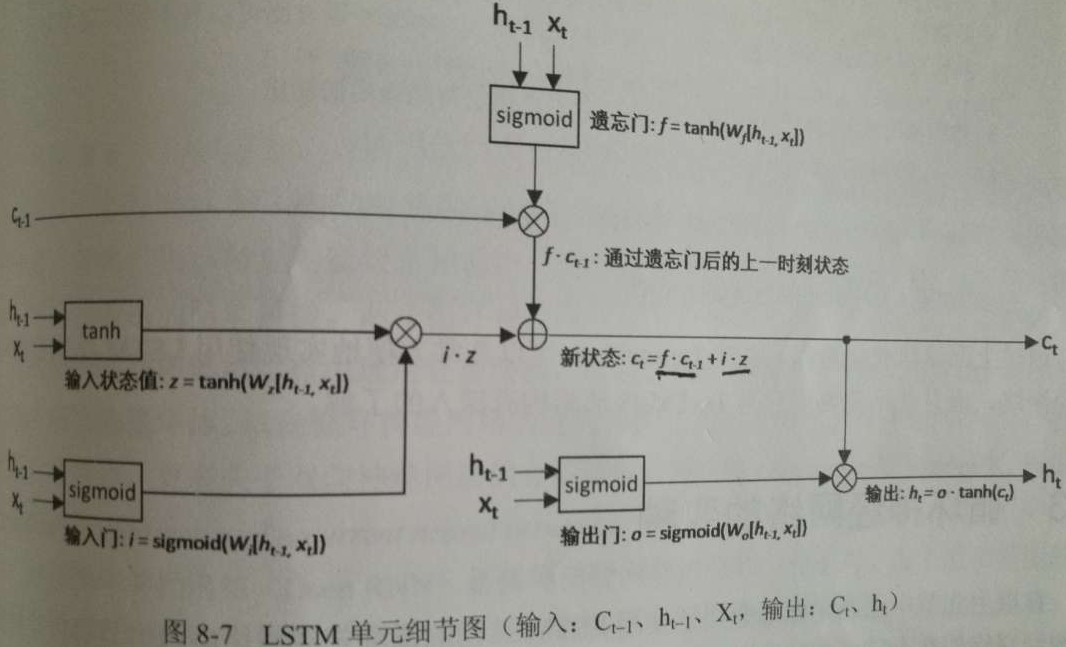

LSTM单元细节:

三、随时间反向传播算法BPTT

https://www.cnblogs.com/wacc/p/5341670.html

三、循环神经网络激活函数

https://blog.csdn.net/xygl2009/article/details/78855795

https://blog.csdn.net/behboyhiex/article/details/80819530

循环神经网络RNN及LSTM的更多相关文章

- 通过keras例子理解LSTM 循环神经网络(RNN)

博文的翻译和实践: Understanding Stateful LSTM Recurrent Neural Networks in Python with Keras 正文 一个强大而流行的循环神经 ...

- 深度学习之循环神经网络RNN概述,双向LSTM实现字符识别

深度学习之循环神经网络RNN概述,双向LSTM实现字符识别 2. RNN概述 Recurrent Neural Network - 循环神经网络,最早出现在20世纪80年代,主要是用于时序数据的预测和 ...

- 循环神经网络RNN模型和长短时记忆系统LSTM

传统DNN或者CNN无法对时间序列上的变化进行建模,即当前的预测只跟当前的输入样本相关,无法建立在时间或者先后顺序上出现在当前样本之前或者之后的样本之间的联系.实际的很多场景中,样本出现的时间顺序非常 ...

- 循环神经网络(RNN, Recurrent Neural Networks)介绍(转载)

循环神经网络(RNN, Recurrent Neural Networks)介绍 这篇文章很多内容是参考:http://www.wildml.com/2015/09/recurrent-neur ...

- 循环神经网络(RNN, Recurrent Neural Networks)介绍

原文地址: http://blog.csdn.net/heyongluoyao8/article/details/48636251# 循环神经网络(RNN, Recurrent Neural Netw ...

- 从网络架构方面简析循环神经网络RNN

一.前言 1.1 诞生原因 在普通的前馈神经网络(如多层感知机MLP,卷积神经网络CNN)中,每次的输入都是独立的,即网络的输出依赖且仅依赖于当前输入,与过去一段时间内网络的输出无关.但是在现实生活中 ...

- 用纯Python实现循环神经网络RNN向前传播过程(吴恩达DeepLearning.ai作业)

Google TensorFlow程序员点赞的文章! 前言 目录: - 向量表示以及它的维度 - rnn cell - rnn 向前传播 重点关注: - 如何把数据向量化的,它们的维度是怎么来的 ...

- 循环神经网络(RNN)的改进——长短期记忆LSTM

一:vanilla RNN 使用机器学习技术处理输入为基于时间的序列或者可以转化为基于时间的序列的问题时,我们可以对每个时间步采用递归公式,如下,We can process a sequence ...

- 循环神经网络(RNN)模型与前向反向传播算法

在前面我们讲到了DNN,以及DNN的特例CNN的模型和前向反向传播算法,这些算法都是前向反馈的,模型的输出和模型本身没有关联关系.今天我们就讨论另一类输出和模型间有反馈的神经网络:循环神经网络(Rec ...

随机推荐

- Home Assistant-自动化设备

触发器(trigger) 条件(condition) 动作(action) 自动化中的模板(template) 触发器(trigger) 时间(time)触发器时间触发器在指定的时间触发规则,可以是某 ...

- CF176E Archaeology

CF176E Archaeology 有一棵 \(n\) 个点的带权树,每个点都是黑色或白色,最初所有点都是白色的.有 \(m\) 个询问: 把点 \(x\) 从白色变成黑色 把点 \(x\) 从黑色 ...

- 移动端h5页面编写样式重置

@charset "UTF-8"; /* stylelint-enable */ /* 重置样式 */ * { -webkit-tap-highlight-color: trans ...

- .net ElasticSearch-Sql 扩展类【原创】

官方提供的是java sdk,并支持jdbc方式的查询结果输出;但是却没有.net sdk的支持. 开发 ElasticSearch-Sql 第三方开源项目的.net sdk,未来集成入bsf框架.( ...

- 讲一个关于paxos的故事...

先讲一个故事. 从前,在国王Leslie Lamport的统治下,有个黑暗的希腊城邦叫paxos.城邦里有3类人, 决策者 提议者 群众 虽然这是一个黑暗的城邦但是很民主,按照议会民主制的政治模式制订 ...

- 【Python】动手分析天猫内衣售卖数据,得到你想知道的信息

大家好,希望各位能怀着正直.严谨.专业的心态观看这篇文章.ヾ(๑╹◡╹)ノ" 接下来我们尝试用 Python 抓取天猫内衣销售数据,并分析得到中国女性普遍的罩杯数据.最受欢迎的内衣颜色是什么 ...

- 朱晔的互联网架构实践心得S2E4:小议微服务的各种玩法(古典、SOA、传统、K8S、ServiceMesh)

十几年前就有一些公司开始践行服务拆分以及SOA,六年前有了微服务的概念,于是大家开始思考SOA和微服务的关系和区别.最近三年Spring Cloud的大火把微服务的实践推到了高潮,而近两年K8S在容器 ...

- flask登录插件 flask-login

Flask-Login为Flask提供了用户会话管理,它处理了日常的登入登出且长时间记住用户的会话 使用: 1.配置,初始化 LoginManager 创建实例 loginManger = Login ...

- BFC 原理

BFC:Block-level box + Forating + Context; ------->块元素 决定其子元素如何定位, ...

- Floyd最短路(带路径输出)

摘要(以下内容来自百度) Floyd算法又称为插点法,是一种利用动态规划的思想寻找给定的加权图中多源点之间最短路径的算法,与Dijkstra算法类似. 该算法名称以创始人之一.1978年图灵奖获得者. ...