Graph Regularized Feature Selection with Data Reconstruction

Abstract

• 从图正则数据重构方面处理无监督特征选择;

• 模型的思想是所选特征不仅通过图正则保留了原始数据的局部结构,也通过线性组合重构了每个数据点;

• 所以重构误差成为判断所选特征质量的自然标准。

• 通过最小化重构误差,选择最好保留相似性和判别信息的特征;

1 Introduction

• 目前有两大类无监督特征选择算法:Similarity preserving 和 clustering performance maximization;Similarity preserving 算法选择最好保留原始数据的局部结构的代表性特征。例如,如果数据点在原始空间分布很近,那么在选择的特征上也应该分布很近;clustering performance maximization 选择能最大化某个聚类标准的判别特征。例如,引入伪标签选择最大化数据聚类效果的判别特征。

• 模型的目标是选择能同时最好保留数据在原始空间的局部结构和判别信息的特征。

• highlight:

(1)从图正则数据重构的角度考虑无监督特征选择问题。通过最小化图正则重构误差,我们选择了最好保留数据结构和判别信息的特征;

(2)通过在混合目标函数上的稀疏学习考虑特征选择问题。引入了一个 l1-norm 稀疏项作用于特征选择矩阵,特征选择矩阵的稀疏性减少了冗余和噪声特征;

(3)提出了一个迭代梯度算法。

2 Related Work

2.1 Similarity Preserving Based Feature Selection

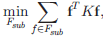

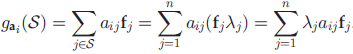

f 是特征向量,K 是预先定义的 Affinity 矩阵。因此,与流形结构相一致的特征被认为是重要的。

2.2 Clustering Based Feature Selection

clustering based feature selection 目标是选择判别特征

3 The Problem Of Graph Regularized Feature Selection With Data Reconstruction

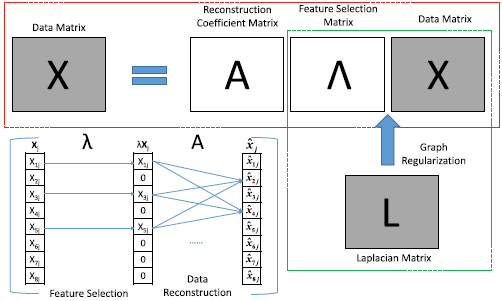

进行了一些符号说明

特征选择矩阵的学习同时保留了数据重构过程和图正则化过程。

4 The Objective Function

• 我们希望原始数据在所选特征上有一个紧致的表示,即 信息损失最小以及数据的局部结构也得到保留;

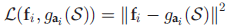

• 从所选特征上重构原始数据第 i 维的信息损失表示为:

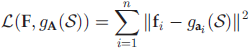

全局数据重构误差为:

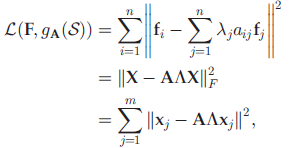

• 进一步,局部不变性。如果两个数据点在原始空间距离相近,那么在所选特征的投影上距离也相近。

• 进一步,局部不变性。如果两个数据点在原始空间距离相近,那么在所选特征的投影上距离也相近。

通过最小化下式,保留数据在所选特征上的局部几何信息:

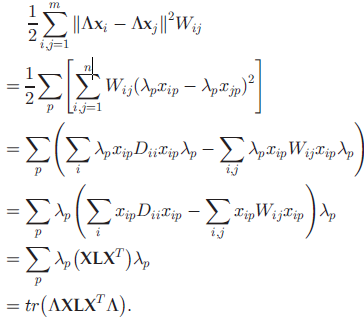

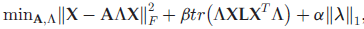

• 模型为:

但是上述模型难以求解,需要分支定界法。于是将约束放松

beta 是平衡对判别信息和相似性的保留。当 beta 较大时,保留相似性。当 beta 较小时,保留判别信息;alpha 控制所选特征的数目。

5 The Optimization

6 Experiment Results

7 Conclusion

判别信息通过最小化数据重构误差保留,相似性通过图正则保留。

Graph Regularized Feature Selection with Data Reconstruction的更多相关文章

- 【转】[特征选择] An Introduction to Feature Selection 翻译

中文原文链接:http://www.cnblogs.com/AHappyCat/p/5318042.html 英文原文链接: An Introduction to Feature Selection ...

- 单因素特征选择--Univariate Feature Selection

An example showing univariate feature selection. Noisy (non informative) features are added to the i ...

- Feature Selection Can Reduce Overfitting And RF Show Feature Importance

一.特征选择可以减少过拟合代码实例 该实例来自机器学习实战第四章 #coding=utf-8 ''' We use KNN to show that feature selection maybe r ...

- highly variable gene | 高变异基因的选择 | feature selection | 特征选择

在做单细胞的时候,有很多基因属于noise,就是变化没有规律,或者无显著变化的基因.在后续分析之前,我们需要把它们去掉. 以下是一种找出highly variable gene的方法: The fea ...

- 机器学习-特征选择 Feature Selection 研究报告

原文:http://www.cnblogs.com/xbinworld/archive/2012/11/27/2791504.html 机器学习-特征选择 Feature Selection 研究报告 ...

- the steps that may be taken to solve a feature selection problem:特征选择的步骤

參考:JMLR的paper<an introduction to variable and feature selection> we summarize the steps that m ...

- The Practical Importance of Feature Selection(变量筛选重要性)

python机器学习-乳腺癌细胞挖掘(博主亲自录制视频) https://study.163.com/course/introduction.htm?courseId=1005269003&u ...

- [Feature] Feature selection

Ref: 1.13. Feature selection Ref: 1.13. 特征选择(Feature selection) 大纲列表 3.1 Filter 3.1.1 方差选择法 3.1.2 相关 ...

- [Feature] Feature selection - Embedded topic

基于惩罚项的特征选择法 一.直接对特征筛选 Ref: 1.13.4. 使用SelectFromModel选择特征(Feature selection using SelectFromModel) 通过 ...

随机推荐

- 医院信息集成平台(ESB)实施、建设方案

医院信息集成平台(ESB)实施.建设方案 基于中立.标准.开放的IT架构和数据标准,打造插拔式医院应用生态. 解决方案 基于ESB集成总线,构建医院信息化建设顶层设计. ...

- numpy 消除Futurewarning

numpy版本过高 1.查看numpy版本 import numpy as np np.__version__ 2.卸载numpy sudo pip3 uninstall numpy 3.安装较低版本 ...

- vmware进程,虚拟机NAT模式配置固定ip,访问外网与ping通主机

vmware进程杀不掉 在使用vmware虚拟机时,如果强制结束vmware进程,可能会发现在资源监视器中有一个vmware-vmx.exe进程始终关不掉,获得管理员权限去杀或者重启都没有用,然后正常 ...

- 查看mysql是否锁表了

1.查看表是否被锁: (1)直接在mysql命令行执行:show engine innodb status\G. (2)查看造成死锁的sql语句,分析索引情况,然后优化sql. (3)然后show p ...

- PMP--1. PMBOK框架部分目录

1.1 PMBOK体系框架描述https://www.cnblogs.com/hemukg/p/11821210.html 1.2 PMBOK指南组成部分https://www.cnblogs.com ...

- 刷题79. Word Search

一.题目说明 题目79. Word Search,给定一个由字符组成的矩阵,从矩阵中查找一个字符串是否存在.可以连续横.纵找.不能重复使用,难度是Medium. 二.我的解答 惭愧,我写了很久总是有问 ...

- 从HTML到node.js以及跨域问题的解决

废话不多说,直接上代码 网页客户端 <!DOCTYPE html> <html> <head> <meta http-equiv="Content- ...

- spring cloud微服务快速教程之(九) Spring Cloud Alibaba--sentinel-限流、熔断降级

0.前言 sentinel的限流.降级功能强大,可以在控制面板中任意制定规则,然后推送到微服务中: 可以根据URL单独制定规则,也可以根据资源名批量制定规则: 需要注意的地方是:1.GITHUB文件在 ...

- 转换:使用vue-axios和vue-resource解决vue中调用网易云接口跨域的问题

本人配置成功https://segmentfault.com/a/1190000011072725

- 【37】池化层讲解(Pooling layers)

池化层(Pooling layers) 除了卷积层,卷积网络也经常使用池化层来缩减模型的大小,提高计算速度,同时提高所提取特征的鲁棒性,我们来看一下. 先举一个池化层的例子,然后我们再讨论池化层的 ...