[Scikit-learn] 2.5 Dimensionality reduction - Probabilistic PCA & Factor Analysis

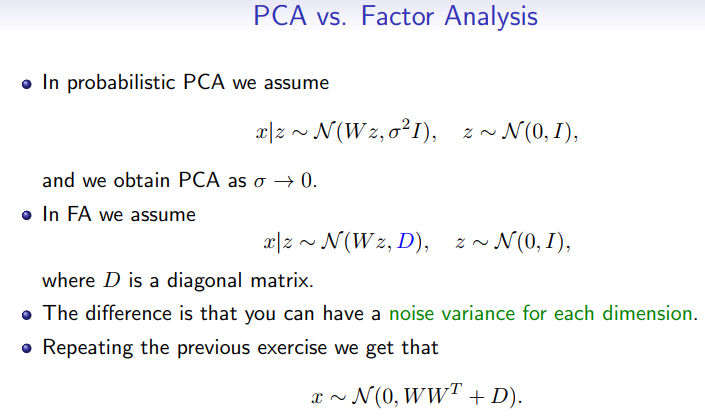

2.5.4. Factor Analysis

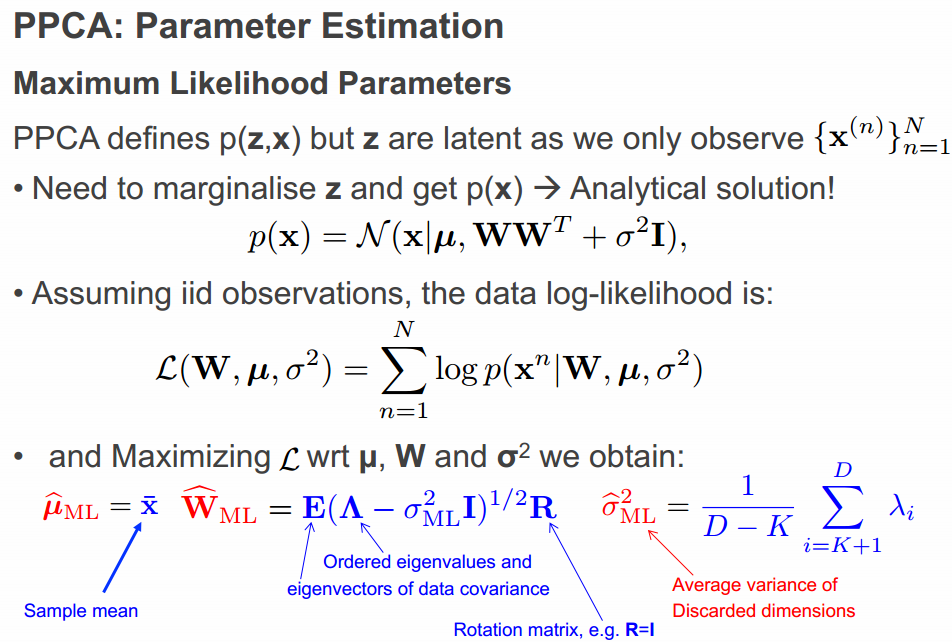

PPCA的基本性质以及人肉推导:

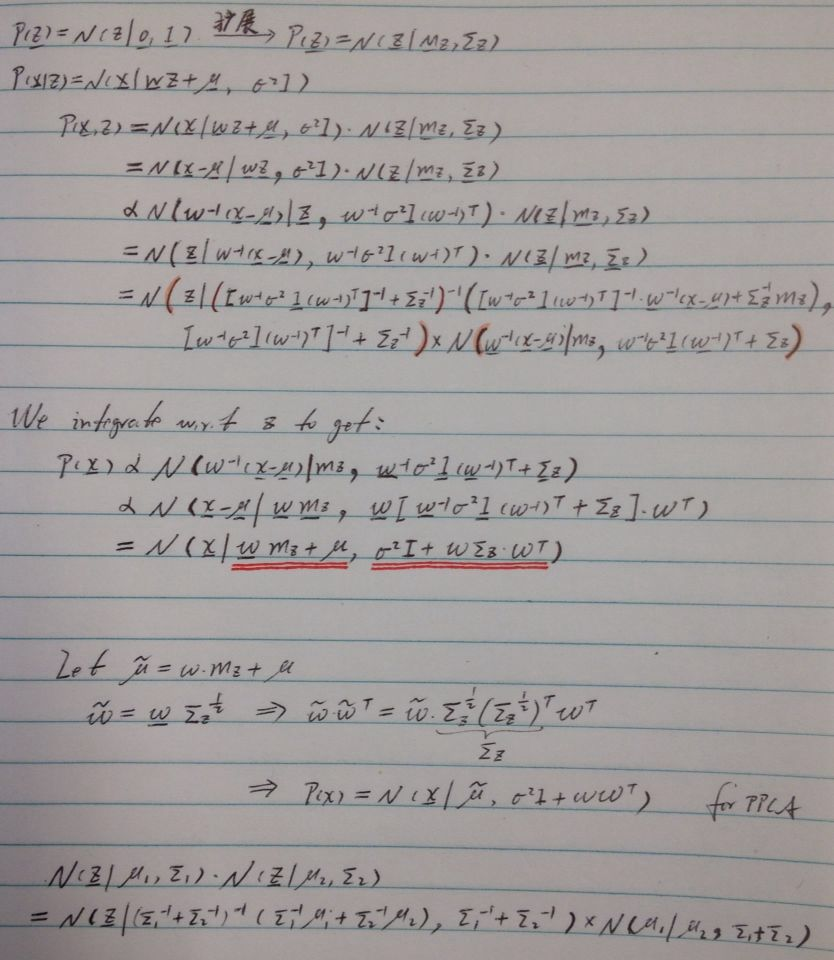

以上假设z是标准正态分布的情况。以下是对z的分布的扩展,为general normal distribution。

From: http://cs.brown.edu/courses/cs195-5/spring2012/lectures/2012-04-24_factorEM.pdf

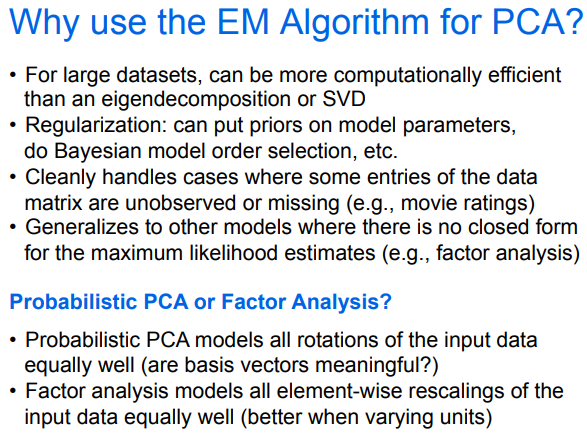

PPCA可以选择input data,保持不变性;FA不能这么搞。

但它俩都可以选择latent variables。

From: https://www.cs.ubc.ca/~schmidtm/Courses/540-W16/L12.pdf

此处可见对x的分布的估计。

主成分分析和因子分析十大不同

一般情况下主成分用于探索性分析,很少单独使用,用主成分来分析数据,可以让我们对数据有一个大致的了解。

几个常用组合:

- 主成分分析+判别分析,适用于变量多而记录数不多的情况;

- 主成分分析+多元回归分析,主成分分析可以帮助判断是否存在共线性,并用于处理共线性问题;

- 主成分分析+聚类分析,不过这种组合因子分析可以更好的发挥优势。

因子分析:

- 首先,因子分析+多元回归分析,可以利用因子分析解决共线性问题;

- 其次,可以利用因子分析,寻找变量之间的潜在结构;

- 再次,因子分析+聚类分析,可以通过因子分析寻找聚类变量,从而简化聚类变量;

- 此外,因子分析还可以用于内在结构证实

Model selection with Probabilistic PCA and Factor Analysis (FA)

http://scikit-learn.org/stable/auto_examples/decomposition/plot_pca_vs_fa_model_selection.html

[Scikit-learn] 2.5 Dimensionality reduction - Probabilistic PCA & Factor Analysis的更多相关文章

- 机器学习课程-第8周-降维(Dimensionality Reduction)—主成分分析(PCA)

1. 动机一:数据压缩 第二种类型的 无监督学习问题,称为 降维.有几个不同的的原因使你可能想要做降维.一是数据压缩,数据压缩不仅允许我们压缩数据,因而使用较少的计算机内存或磁盘空间,但它也让我们加快 ...

- [UFLDL] Dimensionality Reduction

博客内容取材于:http://www.cnblogs.com/tornadomeet/archive/2012/06/24/2560261.html Deep learning:三十五(用NN实现数据 ...

- [Scikit-learn] 4.4 Dimensionality reduction - PCA

2.5. Decomposing signals in components (matrix factorization problems) 2.5.1. Principal component an ...

- Scikit Learn: 在python中机器学习

转自:http://my.oschina.net/u/175377/blog/84420#OSC_h2_23 Scikit Learn: 在python中机器学习 Warning 警告:有些没能理解的 ...

- Stanford机器学习笔记-10. 降维(Dimensionality Reduction)

10. Dimensionality Reduction Content 10. Dimensionality Reduction 10.1 Motivation 10.1.1 Motivation ...

- 可视化MNIST之降维探索Visualizing MNIST: An Exploration of Dimensionality Reduction

At some fundamental level, no one understands machine learning. It isn’t a matter of things being to ...

- 海量数据挖掘MMDS week4: 推荐系统之数据降维Dimensionality Reduction

http://blog.csdn.net/pipisorry/article/details/49231919 海量数据挖掘Mining Massive Datasets(MMDs) -Jure Le ...

- 第八章——降维(Dimensionality Reduction)

机器学习问题可能包含成百上千的特征.特征数量过多,不仅使得训练很耗时,而且难以找到解决方案.这一问题被称为维数灾难(curse of dimensionality).为简化问题,加速训练,就需要降维了 ...

- 壁虎书8 Dimensionality Reduction

many Machine Learning problems involve thousands or even millions of features for each training inst ...

随机推荐

- PAT Baisc 1079 延迟的回文数 (20 分)

给定一个 k+1 位的正整数 N,写成 ak⋯a1a0 的形式,其中对所有 i 有 0 且 ak>0.N 被称为一个回文数,当且仅当对所有 i 有 ai=ak−i ...

- 前端知识体系:JavaScript基础-作用域和闭包-闭包的实现原理和作用以及堆栈溢出和内存泄漏原理和相应解决办法

闭包的实现原理和作用 闭包: 有权访问另一个函数作用域中的变量的函数. 创建闭包的常见方式就是,在一个函数中创建另一个函数. 闭包的作用: 访问函数内部变量.保持函数在环境中一直存在,不会被垃圾回收机 ...

- [cf1138BCircus][枚举,列等式]

https://codeforc.es/contest/1138/problem/B B. Circus time limit per test 1 second memory limit per t ...

- selenium web driver

WebDriver 支持的浏览器 IE6-10 FireFox大部分版本 Chrome Safari Opera Andrioid 系统上的自带浏览器 IOS系统上自带浏览器 HtmlUnit的无界面 ...

- Codeforces Round #539 (Div. 1) 1109F. Sasha and Algorithm of Silence's Sounds LCT+线段树 (two pointers)

题解请看 Felix-Lee的CSDN博客 写的很好,不过最后不用判断最小值是不是1,因为[i,i]只有一个点,一定满足条件,最小值一定是1. CODE 写完就A,刺激. #include <b ...

- harbor1.9仓库同步迁移

harbor 1.9 实战的仓库迁移,过程实际上就是从A push 到B.16个tag 不到100G,挺快的 1分钟多. 假设我们从A迁移到B. 1.先在A上面建立一个目标仓库.

- 02_已解决 [salt.minion :1758][ERROR ][52886] Returner mysql.returner could not be loaded: 'mysql' __virtual__ returned False: Could not import mysql returner; mysql python client is not installed.

总结:python2.7下的salt,要把 mysql-python也安装,并不是python3环境,看清,看清 Returners组件,master自动把值写入mysql数据库中,出现的问题 1.本 ...

- currentTimeMillis与 nanoTime

时间单位换算 1s=10^3ms(毫秒)=10^6μs(微秒)=10^9ns(纳秒)=10^12ps(皮秒)=10^15fs(飞秒)=10^18as(阿秒)=10^21zm(仄秒)=10^24ym(幺 ...

- P4149 [IOI2011]Race 点分治

思路: 点分治 提交:5次 题解: 刚开始用排序+双指针写的,但是调了一晚上,总是有两个点过不了,第二天发现原因是排序时的\(cmp\)函数写错了:如果对于路径长度相同的,我们从小往大按边数排序,当双 ...

- 牛客小白月赛11 Rinne Loves Edges

题库链接:https://ac.nowcoder.com/acm/contest/370/F code: #include<bits/stdc++.h> using namespace s ...