Docker Manager for Kubernetes

一、Kubernetes介绍

Kubernets是Google开源的容器集群系统,是基于Docker构建一个容器的调度服务,提供资源调度,均衡容灾,服务注册,动态伸缩等功能套件;

Kubernets提供应用部署,维护,扩展机制等功能,利用Kubernetes能方便地管理跨主机运行容器化的应用,其主要功能如下:

- 使用Docker对应用程序包装(package),实例化(instantiate),运行(run);

- 将多台Docker主机抽象为一个资源,以集群的方式运行,管理跨机器的容器,包括任务调度,弹性伸缩,滚动升级等功能。

- 使用编排系统(YAML file)快速构建容器集群,提供负载均衡,解决容器直接关联及通信问题;

- 解决Docker跨主机容器之间的通信问题。

- 自动管理和修复容器,简单说,比如创建一个集群,里面有十个容器,如果某个容器异常关闭,那么,会尝试重启或重新分配容器,始终保证会有十个容器在运行,反而杀死多余的。

Kubernetes的我修复机制使得容器集群总是运行在用户期望的状态当前Kubernetes支持GCE、vShpere、CoreOS、OpenShift。

二、Kubernetes和Mesos的区别

1)Mesos是Apache下的开源分布式资源管理框架,它被称为是分布式系统的内核;

Kubernetes是Google开源的容器集群管理系统,实现基于Docker构建容器,利用Kubernetes能很方面管理多台Docker主机中的容器。

2)Mesos负责管理集群管资源(动态运行时,某机器有额外的资源,通知master来分配);

Kubernetes抽象出新的容器组合模型并且对其编排管理(把容器自由组合提供服务这事儿搞定了,从而微服务,serverless等才真

正的优雅地在开发和运维之间不吵架地被实现),而且kubernetes把以前运维的很多很难搞的东西都变得容易了。比如OpenStack,

Kubernetes是把OpenStack里面的VM换成了容器,但是实现地更漂亮,更精简,更抽象和本质化,用起来也更容易。

3)Mesos相比Kubernetes发展的时间更久,总体情况更成熟,在生产环境有更多的使用经验,国外使用Mesos的公司有Twitter,Apple,

Airbnb,Uber等,国内也有大批知名公司在使用Mesos,比如:小米、当当、豆瓣、去哪儿、携程、唯品会、知乎、新浪微博、爱奇艺、

七牛、唯品会、bilibili、中国联通、中国移动、中国电信、华为、数人云等等。中大型公司会更倾向于使用Mesos,

因为本身这些公司有一定的开发能力,Mesos提供了良好的API而且有非常多成熟的Framework跑在Mesos上,Mesos+Marathon+Zookeeper

正常情况可以满足绝大部分需求,只需要写JSON或者DSL定义好service/application就好,只有一些特殊情况才确实需要写自己的Framework。

而kubernetes(k8s)现在也正在慢慢成熟起来,它在生产环境显然还需要更多时间来验证。京东目前已经在kubernetes上跑15W+容器了。

Mesos现在越来越适应并且被添加上了很多Kubernete的概念同时支持了很多Kubernetes的API。因此如果你需要它们的话,它将是对你的

Kubernetes应用去获得更多能力的一个便捷方式(比如高可用的主干、更加高级的调度命令、去管控很大数目结点的能力),同时能够很好的

适用于产品级工作环境中(毕竟Kubernetes任然还是一个初始版本)。

4)如果你是一个集群世界的新手,Kubernetes是一个很棒的起点。它是最快的、最简单的、最轻量级的方法去摆脱束缚,同时开启面向集群开发的实践。

它提供了一个高水平的可移植方案,因为它是被一些不同的贡献者所支持的( 例如微软、IBM、Red Hat、CoreOs、MesoSphere、VMWare等等)。

如果你已经有已经存在的工作任务(Hadoop、Spark、Kafka等等),Mesos给你提供了一个可以让你将不同工作任务相互交错的框架,然后混合进一个

包含Kubernetes 应用的新的东西。

如果你还没有用Kubernetes 系列框架完成项目的能力,Mesos给了你一个减压阀。

三、Kubernetes详解

kubernetes角色组成

- Pod

在kubernetes系统中,调度的最小颗粒不是单纯的容器,而是抽象一个Pod,Pod是一个可以被创建,销毁,调度,管理的最小的部署单元,比如一个或一组容器。Pod是kubernetes的最小操作单元,一个pod可以由一个或多个容器组成;同一个Pod只能运行在同一个主机上,共享相同的volumes、network、namespace;

- ReplicationController(RC)

RC用来管理Pod,一个RC可以由一个或多个pod组成,在RC被创建后,系统会根据定义好的副本数来创建Pod数量。在运行过程中,如果Pod数量小于定义的,就会重启停止的或重新分配Pod,反之则杀多余的。当然,也可以动态伸缩运行的Pods规模或熟悉。RC通过label关联对应的Pods,在滚动升级中,RC采用一个一个替换要更新的整个Pods中的Pod。

Replication Controller是Kubernetes系统中最有用的功能,实现复制多个Pod副本,往往一个应用需要多个Pod来支撑,并且可以保证其复制的

副本数,即使副本所调度分配的宿主机出现异常,通过Replication Controller可以保证在其它主宿机启用同等数量的Pod。Replication Controller

可以通过repcon模板来创建多个Pod副本,同样也可以直接复制已存在Pod,需要通过Label selector来关联

- Service

Service定义了一个Pod逻辑集合的抽象资源,Pod集合汇总的容器提供相同的功能。集合根据定义的Label和selector完成,当创建一个Service后,会分配一个Cluster ip,这个IP与定义的端口提供这个集合一个统一的访问接口,并且实现负载均衡

Services是Kubernetes最外围的单元,通过虚拟一个访问IP及服务端口,可以访问我们定义好的Pod资源,目前的版本是通过iptables的nat转发来实现,

转发的目标端口为Kube_proxy生成的随机端口,目前只提供GOOGLE云上的访问调度,如GCE。

- Label

Label是用于区分Pod、Service、RC的key/value键值对;仅使用在Pod、Service、Replication Controller之间的关系识别,但对这些单元本身进行操作时得使用name标签。Pod、Service、RC可以有多个label,但是每个label的key只能对应一个;主要是将Service的请求通过lable转发给后端提供服务的Pod集合;

kubernetes组件组成

- kubectl

客户端命令行工具,将接受的命令格式化后发送给kube-apiserver,作为整个系统的操作入口。

- kube-apisrver

作为整个系统的控制入口,以REST API服务提供接口

- kube-controller-manager

用来执行整改系统的后台任务,包括节点状态状况,pod个数,pods和service的关联等。

- kube-scheduler

负责节点资源管理,接受来自kube-apiserver创建Pods任务,并分配到某个节点

- etcd

负责节点间的服务发现和配置共享

- kube-proxy

运行在每个计算节点上,负责Pod网络代理。定时从etcd获取到service信息来做相应的策略

- kubelet

运行在每个计算节点上,作为agent,接受分配该节点的Pods任务及管理容器,周期性获取容器状态,反馈给kube-apiserver。

- DNS

一个可选DNS服务,用于为每个Service对象创建DNS记录,选择所有的Pod就可以通过DNS访问服务来。

Kubelet

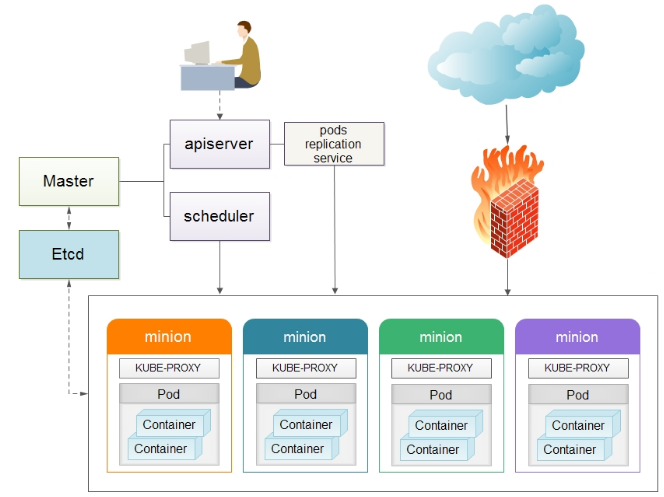

根据上图可知Kubelet是Kubernetes集群中每个Minion和Master API Server的连接点,Kubelet运行在每个Minion上,是Master API Server和Minion之间的桥梁,接收Master API Server分配给它的commands和work,与持久性键值存储etcd,file,server和http进行交互,读取配置信息。Kubelet的主要工作是管理Pod和容器的生命周期,其包括Docker,Client,Root Directory,Pod Worders,Etcd Client,Cadvisor Client以及Health Checker组件,具体工作如下:

- 通过Worker给Pod异步运行特定的Action

- 设置容器的环境变量

- 给容器绑定Volume

- 给容器绑定Port。

- 根据指定的Pod运行一个单一容器

- 杀死容器。

- 给指定的Pod创建network容器

- 删除Pod的所有容器

- 同步Pod的状态

- 从Cadvisor获取container info、 pod info、root info、machine info。

- 检测Pod的容器健康状态信息

- 在容器中运行命令

四、Kubernetes部署

基本环境

主机名 IP 节点及功能 系统版本

k8s-master 10.211.55.12 Master,etcd,registry centos 7.2

node1 10.211.55.21 Node1 centos 7.2

node2 10.211.55.22 Node1 centos 7.2

# 设置三台机器的主机名

Master上执行:

[root@localhost ~]# hostnamectl --static set-hostname k8s-master

Node1上执行:

[root@localhost ~]# hostnamectl --static set-hostname node1

Node2上执行:

[root@localhost ~]# hostnamectl --static set-hostname node2

# 在三台机器上都要设置hosts,均执行如下命令:

[root@k8s-master ~]# vim /etc/hosts

10.211.55.12 k8s-master

10.211.55.12 etcd

10.211.55.12 registry

10.211.55.21 node1

10.211.55.22 node2

# 关闭三台机器上的防火墙

[root@k8s-master ~]# systemctl disable firewalld.service

[root@k8s-master ~]# systemctl stop firewalld.service

部署Master

1)先安装docker环境

[root@k8s-master ~]# yum install -y docker

配置Docker配置文件,使其允许从registry中拉取镜像

[root@k8s-master ~]# vim /etc/sysconfig/docker #添加下面一行内容

......

OPTIONS='--insecure-registry registry:5000'

[root@k8s-master ~]# systemctl start docker

2)安装etcd

k8s运行依赖etcd,需要先部署etcd,下面采用yum方式安装:

[root@k8s-master ~]# yum install etcd -y

yum安装的etcd默认配置文件在/etc/etcd/etcd.conf,编辑配置文件:

[root@k8s-master ~]# cp /etc/etcd/etcd.conf /etc/etcd/etcd.conf.bak

[root@k8s-master ~]# cat /etc/etcd/etcd.conf

#[member]

ETCD_NAME=master #节点名称

ETCD_DATA_DIR="/var/lib/etcd/default.etcd" #数据存放位置

#ETCD_WAL_DIR=""

#ETCD_SNAPSHOT_COUNT="10000"

#ETCD_HEARTBEAT_INTERVAL="100"

#ETCD_ELECTION_TIMEOUT="1000"

#ETCD_LISTEN_PEER_URLS="http://0.0.0.0:2380"

ETCD_LISTEN_CLIENT_URLS="http://0.0.0.0:2379,http://0.0.0.0:4001" #监听客户端地址

#ETCD_MAX_SNAPSHOTS="5"

#ETCD_MAX_WALS="5"

#ETCD_CORS=""

#

#[cluster]

#ETCD_INITIAL_ADVERTISE_PEER_URLS="http://localhost:2380"

# if you use different ETCD_NAME (e.g. test), set ETCD_INITIAL_CLUSTER value for this name, i.e. "test=http://..."

#ETCD_INITIAL_CLUSTER="default=http://localhost:2380"

#ETCD_INITIAL_CLUSTER_STATE="new"

#ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_ADVERTISE_CLIENT_URLS="http://etcd:2379,http://etcd:4001" #通知客户端地址

#ETCD_DISCOVERY=""

#ETCD_DISCOVERY_SRV=""

#ETCD_DISCOVERY_FALLBACK="proxy"

#ETCD_DISCOVERY_PROXY=""

启动etcd并验证状态

[root@k8s-master ~]# systemctl start etcd

[root@k8s-master ~]# ps -ef|grep etcd

etcd 28145 1 1 14:38 ? 00:00:00 /usr/bin/etcd --name=master --data-dir=/var/lib/etcd/default.etcd --listen-client-urls=http://0.0.0.0:2379,http://0.0.0.0:4001

root 28185 24819 0 14:38 pts/1 00:00:00 grep --color=auto etcd

[root@k8s-master ~]# lsof -i:2379

COMMAND PID USER FD TYPE DEVICE SIZE/OFF NODE NAME

etcd 28145 etcd 6u IPv6 1283822 0t0 TCP *:2379 (LISTEN)

etcd 28145 etcd 18u IPv6 1284133 0t0 TCP localhost:53203->localhost:2379 (ESTABLISHED)

........

[root@k8s-master ~]# etcdctl set testdir/testkey0 0

0

[root@k8s-master ~]# etcdctl get testdir/testkey0

0

[root@k8s-master ~]# etcdctl -C http://etcd:4001 cluster-health

member 8e9e05c52164694d is healthy: got healthy result from http://etcd:2379

cluster is healthy

[root@k8s-master ~]# etcdctl -C http://etcd:2379 cluster-health

member 8e9e05c52164694d is healthy: got healthy result from http://etcd:2379

cluster is healthy

3)安装kubernets

[root@k8s-master ~]# yum install kubernetes

配置并启动kubernetes

在kubernetes master上需要运行以下组件:Kubernets API Server、Kubernets Controller Manager、Kubernets Scheduler

[root@k8s-master ~]# cp /etc/kubernetes/apiserver /etc/kubernetes/apiserver.bak

[root@k8s-master ~]# vim /etc/kubernetes/apiserver

###

# kubernetes system config

#

# The following values are used to configure the kube-apiserver

#

# The address on the local server to listen to.

KUBE_API_ADDRESS="--insecure-bind-address=0.0.0.0"

# The port on the local server to listen on.

KUBE_API_PORT="--port=8080"

# Port minions listen on

# KUBELET_PORT="--kubelet-port=10250"

# Comma separated list of nodes in the etcd cluster

KUBE_ETCD_SERVERS="--etcd-servers=http://etcd:2379"

# Address range to use for services

KUBE_SERVICE_ADDRESSES="--service-cluster-ip-range=10.254.0.0/16"

# default admission control policies

#KUBE_ADMISSION_CONTROL="--admission-control=NamespaceLifecycle,NamespaceExists,LimitRanger,SecurityContextDeny,ServiceAccount,ResourceQuota"

KUBE_ADMISSION_CONTROL="--admission-control=NamespaceLifecycle,NamespaceExists,LimitRanger,SecurityContextDeny,ResourceQuota"

# Add your own!

KUBE_API_ARGS=""

[root@k8s-master ~]# cp /etc/kubernetes/config /etc/kubernetes/config.bak

[root@k8s-master ~]# vim /etc/kubernetes/config

###

# kubernetes system config

#

# The following values are used to configure various aspects of all

# kubernetes services, including

#

# kube-apiserver.service

# kube-controller-manager.service

# kube-scheduler.service

# kubelet.service

# kube-proxy.service

# logging to stderr means we get it in the systemd journal

KUBE_LOGTOSTDERR="--logtostderr=true"

# journal message level, 0 is debug

KUBE_LOG_LEVEL="--v=0"

# Should this cluster be allowed to run privileged docker containers

KUBE_ALLOW_PRIV="--allow-privileged=false"

# How the controller-manager, scheduler, and proxy find the apiserver

KUBE_MASTER="--master=http://k8s-master:8080"

启动服务并设置开机自启动

[root@k8s-master ~]# systemctl enable kube-apiserver.service

[root@k8s-master ~]# systemctl start kube-apiserver.service

[root@k8s-master ~]# systemctl enable kube-controller-manager.service

[root@k8s-master ~]# systemctl start kube-controller-manager.service

[root@k8s-master ~]# systemctl enable kube-scheduler.service

[root@k8s-master ~]# systemctl start kube-scheduler.service

部署node

1)安装docker

[root@node1 ~]# yum install -y docker

配置Docker配置文件,使其允许从registry中拉取镜像

[root@node1 ~]# vim /etc/sysconfig/docker #添加下面一行内容

......

OPTIONS='--insecure-registry registry:5000'

[root@node1 ~]# systemctl start docker

2)安装kubernets

[root@node1 ~]# yum install kubernetes

配置并启动kubernetes

在kubernetes master上需要运行以下组件:Kubelet、Kubernets Proxy

[root@node1 ~]# cp /etc/kubernetes/config /etc/kubernetes/config.bak

[root@node1 ~]# vim /etc/kubernetes/config

###

# kubernetes system config

#

# The following values are used to configure various aspects of all

# kubernetes services, including

#

# kube-apiserver.service

# kube-controller-manager.service

# kube-scheduler.service

# kubelet.service

# kube-proxy.service

# logging to stderr means we get it in the systemd journal

KUBE_LOGTOSTDERR="--logtostderr=true"

# journal message level, 0 is debug

KUBE_LOG_LEVEL="--v=0"

# Should this cluster be allowed to run privileged docker containers

KUBE_ALLOW_PRIV="--allow-privileged=false"

# How the controller-manager, scheduler, and proxy find the apiserver

KUBE_MASTER="--master=http://k8s-master:8080"

[root@node1 ~]# cp /etc/kubernetes/kubelet /etc/kubernetes/kubelet.bak

[root@node1 ~]# vim /etc/kubernetes/kubelet

###

# kubernetes kubelet (minion) config

# The address for the info server to serve on (set to 0.0.0.0 or "" for all interfaces)

KUBELET_ADDRESS="--address=0.0.0.0"

# The port for the info server to serve on

# KUBELET_PORT="--port=10250"

# You may leave this blank to use the actual hostname

KUBELET_HOSTNAME="--hostname-override=node1" #特别注意这个,在另一个node2节点上,要改为k8s-node-2

# location of the api-server

KUBELET_API_SERVER="--api-servers=http://k8s-master:8080"

# pod infrastructure container

KUBELET_POD_INFRA_CONTAINER="--pod-infra-container-image=registry.access.redhat.com/rhel7/pod-infrastructure:latest"

# Add your own!

KUBELET_ARGS=""

启动服务并设置开机自启动

[root@node1 ~]# systemctl enable kubelet.service

[root@node1 ~]# systemctl start kubelet.service

[root@node1 ~]# systemctl enable kube-proxy.service

[root@node1 ~]# systemctl start kube-proxy.service

# 在master上查看集群中节点及节点状态

[root@k8s-master ~]# kubectl -s http://k8s-master:8080 get node

NAME STATUS AGE

k8s-node-1 Ready 10m

k8s-node-2 Ready 1m

[root@k8s-master ~]# kubectl get nodes

NAME STATUS AGE

k8s-node-1 Ready 10m

k8s-node-2 Ready 1m

kubernetes常用命令

查看node主机

[root@k8s-master ~]# kubectl get node //有的环境是用monion,那么查看命令就是"kubectl get minions"

查看pods清单

[root@k8s-master ~]# kubectl get pods

查看service清单

[root@k8s-master ~]# kubectl get services //或者使用命令"kubectl get services -o json"

查看replicationControllers清单

[root@k8s-master ~]# kubectl get replicationControllers

删除所有pods(同理将下面命令中的pods换成services或replicationControllers,就是删除所有的services或replicationContronllers)

[root@k8s-master ~]# for i in `kubectl get pod|tail -n +2|awk '{print $1}'`; do kubectl delete pod $i; done

--------------------------------------------------------------------------

除了上面那种查看方式,还可以通过Server api for REST方式(这个及时性更高)

查看kubernetes版本

[root@k8s-master ~]# curl -s -L http://10.211.55.12:8080/api/v1beta1/version | python -mjson.tool

查看pods清单

[root@k8s-master ~]# curl -s -L http://10.211.55.12:8080/api/v1beta1/pods | python -mjson.tool

查看replicationControllers清单

[root@k8s-master ~]# curl -s -L http://10.211.55.12:8080/api/v1beta1/replicationControllers | python -mjson.tool

查查看node主机(或者是minion主机,将下面命令中的node改成minion)

[root@k8s-master ~]# curl -s -L http://10.211.55.12:8080/api/v1beta1/node | python -m json.tool

查看service清单

[root@k8s-master ~]# curl -s -L http://10.211.55.12:8080/api/v1beta1/services | python -m json.tool

创建覆盖网络——Flannel

1)安装Flannel(在master、node上均执行如下命令,进行安装)

[root@k8s-master ~]# yum install flannel

2)配置Flannel(在master、node上均编辑/etc/sysconfig/flanneld)

[root@k8s-master ~]# cp /etc/sysconfig/flanneld /etc/sysconfig/flanneld.bak

[root@k8s-master ~]# vim /etc/sysconfig/flanneld

# Flanneld configuration options

# etcd url location. Point this to the server where etcd runs

FLANNEL_ETCD_ENDPOINTS="http://etcd:2379"

# etcd config key. This is the configuration key that flannel queries

# For address range assignment

FLANNEL_ETCD_PREFIX="/atomic.io/network"

# Any additional options that you want to pass

#FLANNEL_OPTIONS=""

3)配置etcd中关于flannel的key(这个只在master上操作)

Flannel使用Etcd进行配置,来保证多个Flannel实例之间的配置一致性,所以需要在etcd上进行如下配置:('/atomic.io/network/config'这个key与上文/etc/sysconfig/flannel中的配置项FLANNEL_ETCD_PREFIX是相对应的,错误的话启动就会出错)

[root@k8s-master ~]# etcdctl mk /atomic.io/network/config '{ "Network": "10.211.55.0/24" }'

{ "Network": "10.211.55.0/24" }

4)启动Flannel

启动Flannel之后,需要依次重启docker、kubernete。

在master执行:

[root@k8s-master ~]# systemctl enable flanneld.service

[root@k8s-master ~]# systemctl start flanneld.service

[root@k8s-master ~]# service docker restart

[root@k8s-master ~]# systemctl restart kube-apiserver.service

[root@k8s-master ~]# systemctl restart kube-controller-manager.service

[root@k8s-master ~]# systemctl restart kube-scheduler.service

在node上执行:

[root@node1 ~]# systemctl enable flanneld.service

[root@node1 ~]# systemctl start flanneld.service

[root@node1 ~]# service docker restart

[root@node1 ~]# systemctl restart kubelet.service

[root@node1 ~]# systemctl restart kube-proxy.service

然后通过ifconfig命令查看maste和node节点,发现docker0网桥网络的ip已经是上面指定的182.48.0.0网段了。并且在master和node节点上创建的容器间都是可以相互通信的,能相互ping通!

Docker Manager for Kubernetes的更多相关文章

- docker 集群 kubernetes 1.8 构建

1.环境说明:操作系统:CentOS7Kubernetes 版本:v1.8.3Docker 版本:v17.06-ce master 192.168.10.220 etcd kube-apiser ...

- Docker Swarm和Kubernetes在大规模集群中的性能比较

Contents 这篇文章主要针对Docker Swarm和Kubernetes在大规模部署的条件下的3个问题展开讨论.在大规模部署下,它们的性能如何?它们是否可以被批量操作?需要采取何种措施来支持他 ...

- Docker,Docker Compose,Docker Swarm,Kubernetes之间的区别

Dcoker Docker 这个东西所扮演的角色,容易理解,它是一个容器引擎,也就是说实际上我们的容器最终是由Docker创建,运行在Docker中,其他相关的容器技术都是以Docker为基础,它是我 ...

- Docker应用:Kubernetes(容器集群)

阅读目录: Docker应用:Hello World Docker应用:Docker-compose(容器编排) Docker应用:Kubernetes(容器集群) 前言: 终于出第三篇了,上个月就已 ...

- Win10上的Docker应用:Kubernetes(容器集群)

阅读目录: Docker应用:Hello World Docker应用:Docker-compose(容器编排) Docker应用:Kubernetes(容器集群) 前言: 终于出第三篇了,上个月就已 ...

- Docker+GitLab+Jenkins+kubernetes实现DevOps 持续化集成和持续化部署概念图

Docker+GitLab+Jenkins+kubernetes实现DevOps 持续化集成和持续化部署概念图 转载自:原创 IT综合 作者:百联达 时间:2017-05-09 15:48:08 41 ...

- 基于Docker本地运行Kubernetes

基于Docker本地运行Kubernetes 概览 下面的指引将高速你如何通过Docker创建一个单机.单节点的Kubernetes集群. 下图是最终的结果: 先决条件 \1. 你必须拥有一台安装有D ...

- Docker Manager for Docker Swarm deploy

一.Swarm概述 Swarm是Docker公司在2014年12月初发布的一套较为简单的工具,用来管理Docker集群,它将一群Docker宿主机变成一个单一的,虚拟的主机.Swarm使用标准的Doc ...

- Docker中部署Kubernetes

Kubernetes为Google开源的容器管理框架,提供了Docker容器的夸主机.集群管理.容器部署.高可用.弹性伸缩等一系列功能:Kubernetes的设计目标包括使容器集群任意时刻都处于用户期 ...

随机推荐

- 集合之asList的缺陷

在实际开发过程中我们经常使用asList讲数组转换为List,这个方法使用起来非常方便,但是asList方法存在几个缺陷: 一.避免使用基本数据类型数组转换为列表 使用8个基本类型数组转换为列表时会存 ...

- 数字电路中应避免产生不必要的锁存器 Latch

锁存器(Latch)是数字逻辑电路中很重要的一种基本电路,常见的锁存器包括三个端口:数据输入口.数据输出口.使能端.当使能端为高电平时,输入口的数据直接送到输出口,此时输入输出口可以看成是直接连通的: ...

- java基础四 基本语法

java基本语法: 1:java严格区分大小写,好比main和Main是完全不同的概念. 2:一个java的源文件中可以定义多个类,但是其中最多只能一个类被定义成public类,若源文件中包括publ ...

- Oracle(二)SELECT语句执行顺序

转载自:小强斋太-Study Notes,原文链接 从join on和where执行顺序认识T-SQL查询处理执行顺序 目录 一.样例 二.SELECT语句的处理过程 1. FROM阶段 2. WHE ...

- ZooKeeper(二)Java API使用

ZooKeeper官网提供了Java和C的API. 本文使用Java API来实现ZooKeeper的基本操作. 前言 下图中的Replicated Database是包含完整数据树(entire d ...

- sqlite学习笔记8:C语言中使用sqlite之创建表

前面已经说了怎样打开和关闭数据库,这次要说得是怎样运行SQL语句,来创建一张表. 要用的的函数: sqlite3_exec(sqlite3* db, const char *sql, sqlite_c ...

- phpqrcode生成动态二维码简单实例

这是一个利用phpqrcode生成动态二维码简单实例,比微信官方提供的接口还要好用.二维码是动态的,不用生成图片,可自定义二维码大小,间隙,跳转地址等. 参数设置: include_once 'php ...

- TMS Xdata Server

Xdata 在TMS中扮演的桥的角色,一年前仔细看过TMS 的源码,当时对流程很清晰,随着时间慢慢的过去,现在该忘记的都忘记了.所以用此文章来记录自己对Xdata还剩下的一点点的记忆... 光有xda ...

- FPGA-Xilinx原语调用之ODDR

记录背景:最近由于想实现GMIItoRGMII的功能,因此需要调用ODDR原语. ODDR:Dedicated Dual Data Rate (DDR) Output Register 通过ODDR把 ...

- POJ 1235 Machine Schedule 【二分图】

这道题考察对最小点覆盖的理解. 做法: 对于一个作业,它需要A的a模式和B的b模式,那么可以从a模式向b模式连一条边:可以感性的理解为每一条边就是一个作业,需要求得有多少个模式可以覆盖所有的边,也就是 ...