Tensorflow-卷积神经网络CNN

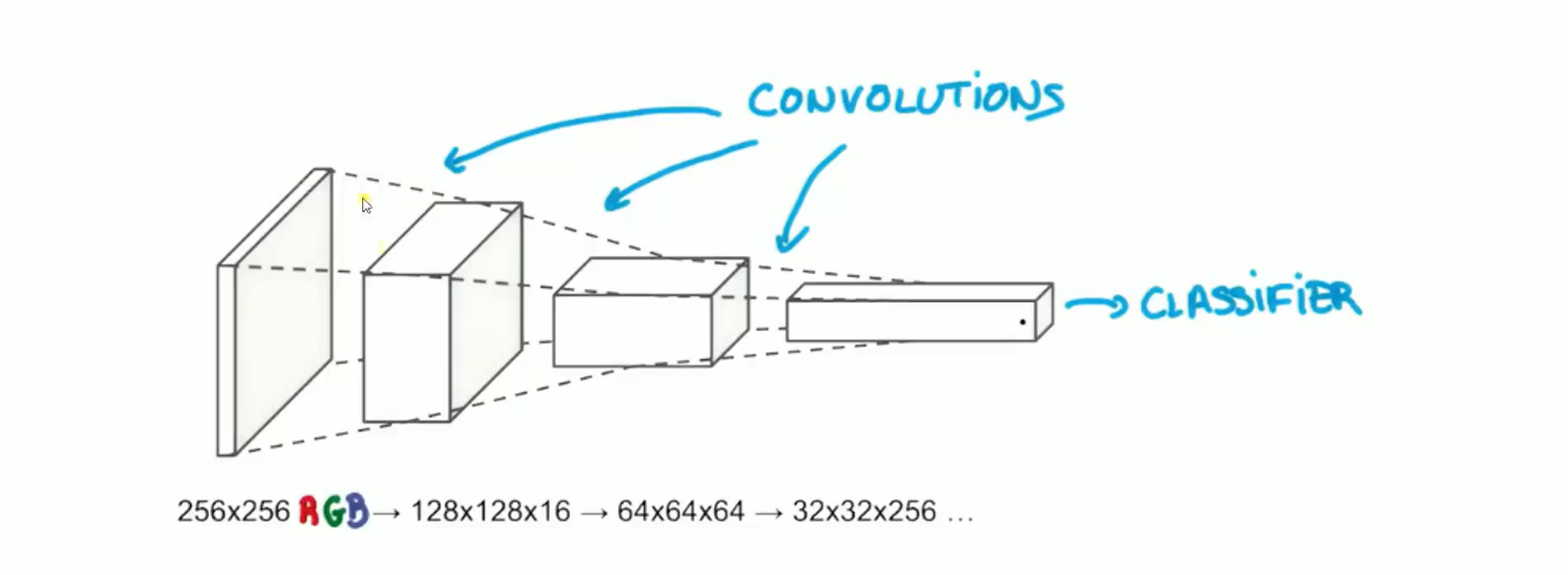

卷积神经网络CNN

结构

池化操作

手写数字-卷积神经网络实现

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

tf.compat.v1.disable_eager_execution()

import numpy as np #载入数据集

mnist=input_data.read_data_sets("MNIST_data",one_hot=True) #每个批次大小

batch_size=100

#计算一共有多少个批次

n_bath=mnist.train.num_examples // batch_size #初始化权值

def weight_variable(shape):

initial=tf.compat.v1.truncated_normal(shape,stddev=0.1)#生成一个截断的正态分布

return tf.Variable(initial) #初始化偏置值

def bias_variable(shape):

initial=tf.compat.v1.constant(0.1,shape=shape)#生成一个截断的正态分布

return tf.Variable(initial) #卷积层

def conv2d(x,W):

#strides[0]=strides[3]=1,strides[1]代表x方向的步长,strides[2]代表y方向的步长

return tf.nn.conv2d(x,W,strides=[1,1,1,1],padding='SAME') #池化层

def max_pool_2x2(x):

#ksize[1,x,y,1]

return tf.nn.max_pool(x,ksize=[1,2,2,1],strides=[1,2,2,1],padding='SAME') #定义两个placeholder

x=tf.compat.v1.placeholder(tf.float32,[None,784])#28*28

y=tf.compat.v1.placeholder(tf.float32,[None,10]) #改变x的格式转为4D的向量【batch,in_height,in_width,in_channels】

x_image=tf.compat.v1.reshape(x,[-1,28,28,1]) #初始化第一个卷积层的权值和偏置

W_conv1=weight_variable([5,5,1,32])#5*5的采样窗口,32个卷积核从1个平面抽取特征

b_conv1=bias_variable([32])#每一个卷积核一个偏置值 #把x_image和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

h_conv1=tf.nn.relu(conv2d(x_image,W_conv1)+b_conv1)

h_pool1=max_pool_2x2(h_conv1)#进行max-pooling #初始化第二个卷积层的权值和偏置

W_conv2=weight_variable([5,5,32,64])#5*5的采样窗口,64个卷积核从32个平面抽取特征

b_conv2=bias_variable([64])#每一个卷积核一个偏置值 #把x_image和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

h_conv2=tf.nn.relu(conv2d(h_pool1,W_conv2)+b_conv2)

h_pool2=max_pool_2x2(h_conv2)#进行max-pooling #28*28的图片第一次卷积后还是28*28(步长为1),第一次池化变为14*14(因为步长2)

#第二次卷积后为14*14,第二次池化为7*7

#经过以上步骤后得到64张7*7平面 #初始化第一个全连接层的权值

W_fc1=weight_variable([7*7*64,1024])#上一层有7*7*64个神经元,全连接层有1024个神经元

b_fc1=bias_variable([1024])#1024个节点 #把池化层的第二层输出扁平化为1维

h_pool2_flat=tf.compat.v1.reshape(h_pool2,[-1,7*7*64])

#求第一个全连接层的输出

h_fc1=tf.nn.relu(tf.matmul(h_pool2_flat,W_fc1)+b_fc1) #用keep_prob来表示神经元的输出概率

# keep_prob=tf.compat.v1.placeholder(tf.float32)

# h_fc1_drop=tf.nn.dropout(h_fc1,keep_prob) #初始化第二个全连接层的权值

W_fc2=weight_variable([1024,10])#上一层有7*7*64个神经元,全连接层有1024个神经元

b_fc2=bias_variable([10])#1024个节点 #计算输出

prediction=tf.nn.softmax(tf.matmul(h_fc1,W_fc2)+b_fc2) #交叉熵函数

loss=tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y,logits=prediction))

#梯度下降

train_step=tf.compat.v1.train.AdamOptimizer(1e-4).minimize(loss) #初始化变量

init=tf.compat.v1.global_variables_initializer() #结果存放在一个布尔型列表中

#返回的是一系列的True或False argmax返回一维张量中最大的值所在的位置,对比两个最大位置是否一致

correct_prediction=tf.equal(tf.argmax(y,1),tf.argmax(prediction,1)) #求准确率

#cast:将布尔类型转换为float,将True为1.0,False为0,然后求平均值

accuracy=tf.reduce_mean(tf.cast(correct_prediction,tf.float32)) with tf.compat.v1.Session() as sess:

sess.run(init)

for epoch in range(51):

for batch in range(n_bath):

#获得一批次的数据,batch_xs为图片,batch_ys为图片标签

batch_xs,batch_ys=mnist.train.next_batch(batch_size)

#进行训练

sess.run(train_step,feed_dict={x:batch_xs,y:batch_ys}) test_acc=sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels}) print("Iter "+str(epoch)+",Testing Accuracy "+str(test_acc))

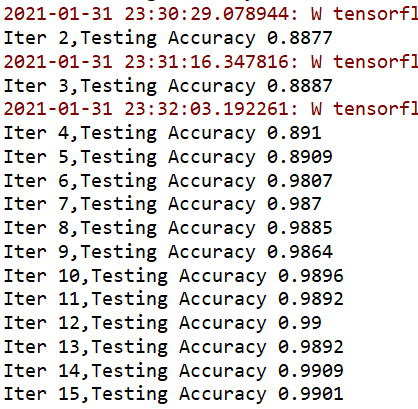

输出结果:

跑的时间有点长。。。。。

Tensorflow-卷积神经网络CNN的更多相关文章

- 深度学习之卷积神经网络CNN及tensorflow代码实例

深度学习之卷积神经网络CNN及tensorflow代码实例 什么是卷积? 卷积的定义 从数学上讲,卷积就是一种运算,是我们学习高等数学之后,新接触的一种运算,因为涉及到积分.级数,所以看起来觉得很复杂 ...

- 深度学习之卷积神经网络CNN及tensorflow代码实现示例

深度学习之卷积神经网络CNN及tensorflow代码实现示例 2017年05月01日 13:28:21 cxmscb 阅读数 151413更多 分类专栏: 机器学习 深度学习 机器学习 版权声明 ...

- 卷积神经网络CNN原理以及TensorFlow实现

在知乎上看到一段介绍卷积神经网络的文章,感觉讲的特别直观明了,我整理了一下.首先介绍原理部分. [透析] 卷积神经网络CNN究竟是怎样一步一步工作的? 通过一个图像分类问题介绍卷积神经网络是如何工作的 ...

- TensorFlow 2.0 深度学习实战 —— 浅谈卷积神经网络 CNN

前言 上一章为大家介绍过深度学习的基础和多层感知机 MLP 的应用,本章开始将深入讲解卷积神经网络的实用场景.卷积神经网络 CNN(Convolutional Neural Networks,Conv ...

- 卷积神经网络CNN总结

从神经网络到卷积神经网络(CNN)我们知道神经网络的结构是这样的: 那卷积神经网络跟它是什么关系呢?其实卷积神经网络依旧是层级网络,只是层的功能和形式做了变化,可以说是传统神经网络的一个改进.比如下图 ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(二)

用Tensorflow实现卷积神经网络(CNN) 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10737065. ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(一)

卷积神经网络(CNN)详解与代码实现 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10430073.html 目 ...

- Tensorflow卷积神经网络[转]

Tensorflow卷积神经网络 卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络, 在计算机视觉等领域被广泛应用. 本文将简单介绍其原理并分析Te ...

- 深度学习之卷积神经网络CNN

转自:https://blog.csdn.net/cxmscb/article/details/71023576 一.CNN的引入 在人工的全连接神经网络中,每相邻两层之间的每个神经元之间都是有边相连 ...

- 基于MNIST数据的卷积神经网络CNN

基于tensorflow使用CNN识别MNIST 参数数量:第一个卷积层5x5x1x32=800个参数,第二个卷积层5x5x32x64=51200个参数,第三个全连接层7x7x64x1024=3211 ...

随机推荐

- 搭建web攻防环境

提示:本实验仅用于学习参考,不可用作其他用途! 任务一.基于centos7搭建dvwa web服务靶机 在centos7安装LAMP并启动,访问phpinfo页面 从互联网下载dvwa并解压到/var ...

- DNS主从服务器配置实现

主服务器-centos7-IP:192.168.184.201 从服务器-centos7-IP:192.168.184.202 客户端-ubuntu1804-IP:192.168.184.150 ①客 ...

- vue3系列:vue3.0自定义全局弹层V3Layer|vue3.x pc桌面端弹窗组件

基于Vue3.0开发PC桌面端自定义对话框组件V3Layer. 前两天有分享一个vue3.0移动端弹出层组件,今天分享的是最新开发的vue3.0版pc端弹窗组件. V3Layer 一款使用vue3.0 ...

- HystrixRequestContext实现Request级别的上下文

一.简介 在微服务架构中,我们会有这样的需求,A服务调用B服务,B服务调用C服务,ABC服务都需要用到当前用户上下文信息(userId.orgId等),那么如何实现呢? 方案一: 拦截器加上Threa ...

- 面试官:数据库自增ID用完了会怎么样?

看到这个问题,我想起当初玩魔兽世界的时候,25H难度的脑残吼的血量已经超过了21亿,所以那时候副本的BOSS都设计成了转阶段.回血的模式,因为魔兽的血量是int型,不能超过2^32大小. 估计暴雪的设 ...

- jQuery 日常笔记

1.$(document).read(function(){$('p').click(function(){ $('p').hide();})})2.jquery是客户端脚本3.$("p&q ...

- Kafka基本原理概述

Kafka的基本介绍 Kafka是最初由Linkedin公司开发,是一个分布式.分区的.多副本的.多订阅者,基于zookeeper协调的分布式日志系统(也可以当做MQ系统),常见可以用于web/ngi ...

- maven打包 依赖jar与不依赖jar

?xml version="1.0" encoding="UTF-8"?> <assembly xmlns="http://maven.a ...

- windows端口占用

原文链接http://zhhll.icu/2020/04/08/windows/windows%E4%B9%8B%E7%AB%AF%E5%8F%A3%E5%8D%A0%E7%94%A8/ 1.查看当前 ...

- 九个最容易出错的 Hive sql 详解及使用注意事项

阅读本文小建议:本文适合细嚼慢咽,不要一目十行,不然会错过很多有价值的细节. 文章首发于公众号:五分钟学大数据 前言 在进行数仓搭建和数据分析时最常用的就是 sql,其语法简洁明了,易于理解,目前大数 ...