爬虫学习笔记(1)-- 利用Python从网页抓取数据

最近想从一个网站上下载资源,懒得一个个的点击下载了,想写一个爬虫把程序全部下载下来,在这里做一个简单的记录

Python的基础语法在这里就不多做叙述了,黑马程序员上有一个基础的视频教学,可以跟着学习一下

本篇博客为基础章:利用Python从网页端抓取数据,闲话不多说,开始正题:

首先需要学习这几个模块:

1 webbrowser:Python自带的模块,打开浏览器获取到指定的页面

2 requests:从英特网上下载文件和网页

3 Beautiful Soup:解析HTML,即网页编写的格式

4 selenium:启动并控制一个Web浏览器。selenium能够填写表单,并模拟鼠标在这个浏览器上点击

1 webbrowser模块:

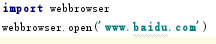

可以利用.open()方法打开指定的Url。例如在idea中输入如下代码:

运行Python文件,系统会自动打开一个浏览器,打开百度

2 requests模块:

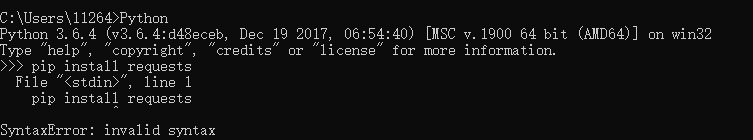

这是一个第三方模块,需要先从网上下载:

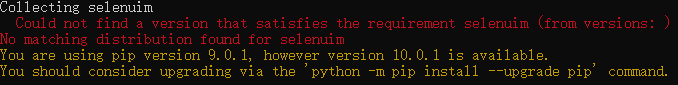

我在Python的运行环境下报错:

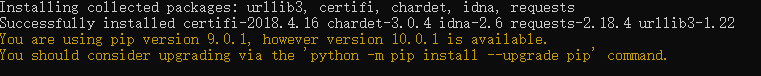

切换到cmd环境:

安装成功,在项目中加载requests模块:

import requests

# 调用requests.get()下载文件

res = requests.get('http://www.gutenberg.org/files/57156/57156-h/57156-h.htm')

# 确保程序正在下载失败时候停止

res.raise_for_status()

# Python文件使用“wb”方式打开,写入字符串会报错,因为这种打开方式为:

# 以二进制格式打开一个文件只用于写入。如果该文件已存在则将其覆盖。如果该文件不存在,创建新文件。

playFile = open('test.txt','wb')

# 利用iter_content()方法做循环

# 一段为10000字节

for chuck in res.iter_content(10000):

playFile.write(chuck)

playFile.close()

示例

这里放两个对于这个模块写的比较详细的Blog:

2.1 快速上手

2.2 用法总结

3 Beautiful Soup模块:

用于从html中提取元素信息

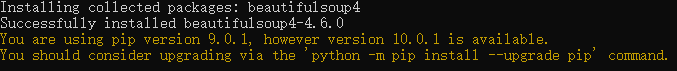

首先安装第三方模块:

在项目中加载

首先在项目中添加名为example的html网页,代码如下:

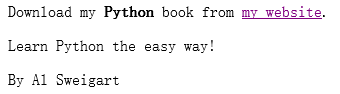

<html><head><title>The Website Title</title></head>

<body>

<p>Download my <strong>Python</strong> book from <a href="http://inventwithpython.com">my website</a>.</p>

<p class="slogan">Learn Python the easy way!</p>

<p>By <span id="author">Al Sweigart</span></p>

</body></html>

example

显示效果如下:

示例代码如下:

import requests,bs4

exampleFile = open('example.html')

exampleSoup = bs4.BeautifulSoup(exampleFile.read(),"html.parser")

print('----------通过id----------')

# 返回一个带有id = "author" 的元素,将这个Tag对象的列表保存在变量elems中

elems = exampleSoup.select("#author")

print(type(elems))

# 列表中只有一个Tag对象,只有一次匹配

print(len(elems))

print(type(elems[0]))

# 元素的文本

print(elems[0].getText())

# 一个字符串,包含开始和结束标签,以及该元素的文本

print(str(elems[0]))

# 字典,包含元素的属性以及属性值

print(elems[0].attrs)

print()

print('----------通过元素----------')

pelements = exampleSoup.select('p')

print(len(pelements))

print(str(pelements[0]))

print(pelements[0].getText())

print(str(pelements[1]))

print(pelements[1].getText())

print()

print('----------通过属性----------')

spqnelem = exampleSoup.select('span')[0]

print(len(spqnelem))

print(str(spqnelem))

print(spqnelem.get('id'))

print(spqnelem.attrs)

BeautifulSoup模块

运行结果如图所示:

值得一提的是,一开始在项目运行的时候吗,爆出如下的错误:

解决方法很简单,在调用bs4.BeautifulSoup()函数时添加“html.parser”参数

一些常用的css选择器的模式:

| 传递给select()方法的选择器 | 将匹配为... |

| soup.select('div’) | 所有名为<div>的元素 |

| soup.select('#author’) | 带有id属性为author的元素 |

| soup.select('.notice’) | 所有使用css class属性为notice的元素 |

| soup.select('div span’) | 所有在<div>元素之内的<span>元素 |

| soup.select('div>span’) | 所有直接在<div>元素之内的<span>元素,中间没有其他元素 |

| soup.select('input[name]’) | 所有名为<input>,并有一个name属性,其值无所谓的元素 |

| soup.select('input[type = 'button']’) | 所有名为<input>,并有一个type属性,其值为button的元素 |

最后贴一个BeautifulSoup的文档以便参考

4 selenium模块:

该模块可以让Python直接控制浏览器

首先导入模块,方法与之前的略有不同,首先需要下载压缩包,直接运行会报错:

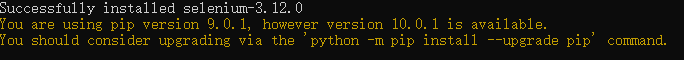

解压后在当前文件夹运行pip install selenium,按住Shift,右键选择在此处打开Powershell窗口

在项目中导入模块,方法较之前几个模块,略有不同,示例代码如下:

from selenium import webdriver

import time

bo = webdriver.Firefox()

bo.get('https://www.baidu.com/')

# 模拟点击页面按钮

link = bo.find_element_by_partial_link_text('贴吧')

link.click()

# 模拟填写表单并注册

bo.get('https://mail.qq.com/cgi-bin/loginpage')

bo.switch_to.frame('login_frame')

bo.find_element_by_css_selector('#switcher_plogin').click()

emailelem = bo.find_element_by_id('u')

emailelem.send_keys('账号')

passelem = bo.find_element_by_id('p')

passelem.send_keys('密码')

passelem.submit()

selenium

运行时报以下错误:

缺少geckodriver文件,在这里找到对应的版本后,下载之后解压到Python.exe和FireFox所在的文件夹里面即可

爬虫学习笔记(1)-- 利用Python从网页抓取数据的更多相关文章

- Python网络爬虫笔记(一):网页抓取方式和LXML示例

(一) 三种网页抓取方法 1. 正则表达式: 模块使用C语言编写,速度快,但是很脆弱,可能网页更新后就不能用了. 2. Beautiful Soup 模块使用Python编写,速度慢. ...

- Python爬虫【三】利用requests和正则抓取猫眼电影网上排名前100的电影

#利用requests和正则抓取猫眼电影网上排名前100的电影 import requests from requests.exceptions import RequestException imp ...

- 用python做网页抓取与解析入门笔记[zz]

(from http://chentingpc.me/article/?id=961) 事情的起因是,我做survey的时候搜到了这两本书:Computational Social Network A ...

- 利用python scrapy 框架抓取豆瓣小组数据

因为最近在找房子在豆瓣小组-上海租房上找,发现搜索困难,于是想利用爬虫将数据抓取. 顺便熟悉一下Python. 这边有scrapy 入门教程出处:http://www.cnblogs.com/txw1 ...

- ASP.NET网页抓取数据

我的数据通过一个TextBox输入,这些代码是写在一个button的点击事件里的. 网页数据抓取大概分为两步,第一步是获取网页源代码: 具体注释如下: var currentUrl = TextBox ...

- python3下scrapy爬虫(第六卷:利用cookie模拟登陆抓取个人中心页面)

之前我们爬取的都是那些无需登录就要可以使用的网站但是当我们想爬取自己或他人的个人中心时就需要做登录,一般进入登录页面有两种 ,一个是独立页面登陆,另一个是弹窗,我们先不管验证码登陆的问题 ,现在试一下 ...

- Python爬虫学习笔记之爬虫基础库

知识预览 beautifulsoup的简单使用 beautifulsoup的遍历文档树 beautifulsoup的搜索文档树 beautifulsoup的css选择器 回到顶部 beautifuls ...

- 商业爬虫学习笔记day7-------解析方法之bs4

一.Beautiful Soup 1.简介 Beautiful Soup 是python的一个库,最主要的功能是从网页抓取数据.其特点如下(这三个特点正是bs强大的原因,来自官方手册) a. Beau ...

- python网络爬虫学习笔记

python网络爬虫学习笔记 By 钟桓 9月 4 2014 更新日期:9月 4 2014 文章文件夹 1. 介绍: 2. 从简单语句中開始: 3. 传送数据给server 4. HTTP头-描写叙述 ...

随机推荐

- Oracle删库跑路

--10g R2 startup mount exclusive restrict; alter system enable restricted session; drop database; -- ...

- 个人常用的移动端浅灰底index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/ ...

- c#子类序列化与父类序列化(Serializable)的区别

今天码代码,遇到了一个很奇怪的问题.就是子类继承了Serializable,父类没有,最后面,子类的数据转为byte[],并存储到数据库,再从数据库出来转为子类对象,发现,父类的变量,值为空! 最后调 ...

- centos6 更新gcc glibc2.17

curl -Lks http://www.hop5.in/yum/el6/hop5.repo > /etc/yum.repos.d/hop5.repo yum install gcc wget ...

- SSM框架和SSH框架的区别

SSH和SSM定义 SSH 通常指的是 Struts2 做控制器(controller),spring 管理各层的组件,hibernate 负责持久化层. SSM 则指的是 SpringMVC 做控制 ...

- vue进阶--外卖商家页

一.准备工作 1.vue特性:轻量级.简洁.高效.组件化.数据驱动 2.技术分析:使用vue- resource与后端交互(ajax通信,ie9+) 使用vue-router作为前端路由 bet ...

- Windbg程序调试系列4-Live Debugging

上篇博文中给大家分享了使用Windbg分析线程阻塞问题: Windbg程序调试系列3-线程阻塞问题 本篇中我们继续,跟大家分享附加进程实时调试-Live Debugging. 先说一下使用Windbg ...

- 对接 第三方物流APP 手机版

昨天因为bibi项目要对接 物流信息 开始找了快递鸟文档,但是要填写申请APP,必须要注册公司才可以,这样非常麻烦.下面的第三方物理接口,绝对让你满意. https://m.kuaidi100.com ...

- Hadoop HDFS, YARN ,MAPREDUCE,MAPREDUCE ON YARN

HDFS 系统架构图 NameNode 是主节点,存储文件的元数据,如文件名,文件目录结构,文件属性(生成时间,副本数,文件权限),以及每个文件的块列表和块所在的DataNode等.NameNode将 ...

- 在java中使用Mysql数据库,如何在MyBatis的xml里面处理时间为Int类型的数据

主要是将显示在页面上的数据变成日期格式,而不是相应的毫秒数,具体的做法如下: 1.首先需要在相关的xml文件里面修改时间为下面语句,其中reg_time为要修改的日期列名 FROM_UNIXTIME( ...