OpenCV探索之路(二十四)图像拼接和图像融合技术

图像拼接在实际的应用场景很广,比如无人机航拍,遥感图像等等,图像拼接是进一步做图像理解基础步骤,拼接效果的好坏直接影响接下来的工作,所以一个好的图像拼接算法非常重要。

再举一个身边的例子吧,你用你的手机对某一场景拍照,但是你没有办法一次将所有你要拍的景物全部拍下来,所以你对该场景从左往右依次拍了好几张图,来把你要拍的所有景物记录下来。那么我们能不能把这些图像拼接成一个大图呢?我们利用opencv就可以做到图像拼接的效果!

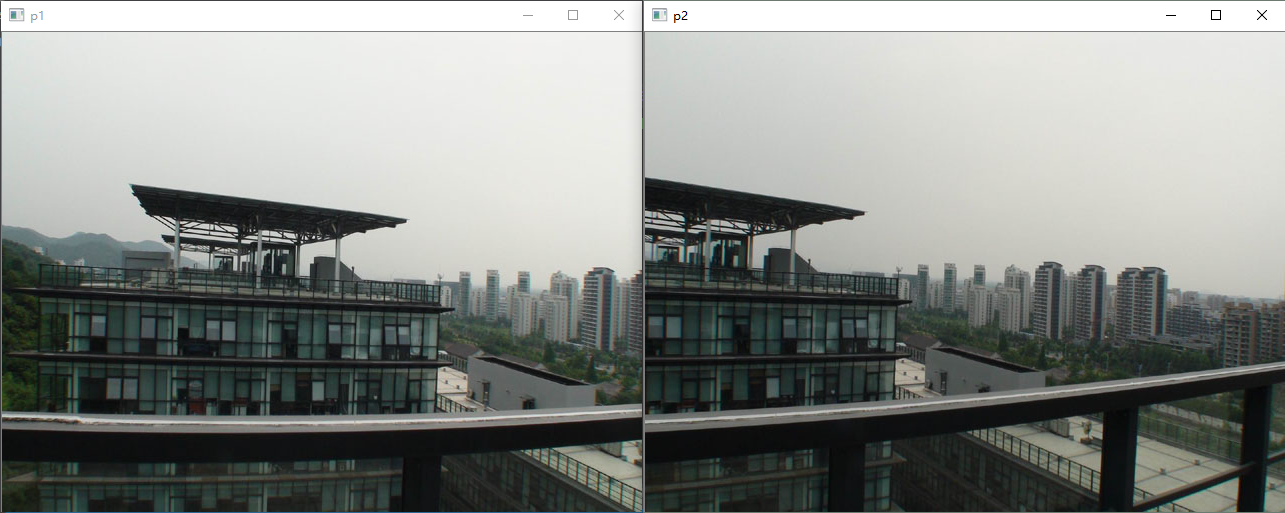

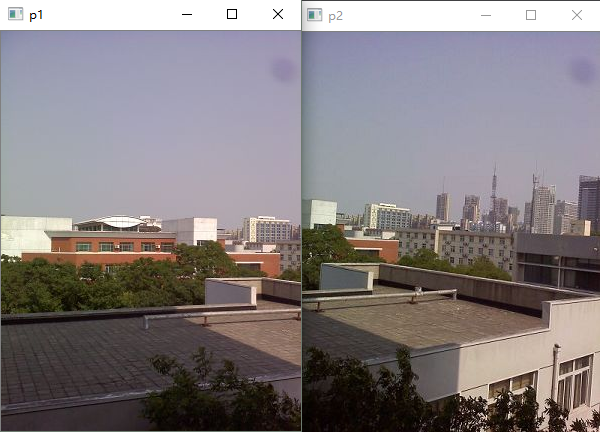

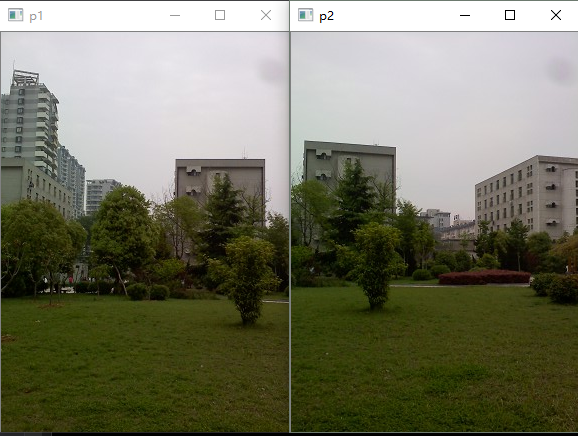

比如我们有对这两张图进行拼接。

从上面两张图可以看出,这两张图有比较多的重叠部分,这也是拼接的基本要求。

那么要实现图像拼接需要那几步呢?简单来说有以下几步:

- 对每幅图进行特征点提取

- 对对特征点进行匹配

- 进行图像配准

- 把图像拷贝到另一幅图像的特定位置

- 对重叠边界进行特殊处理

好吧,那就开始正式实现图像配准。

第一步就是特征点提取。现在CV领域有很多特征点的定义,比如sift、surf、harris角点、ORB都是很有名的特征因子,都可以用来做图像拼接的工作,他们各有优势。本文将使用ORB和SURF进行图像拼接,用其他方法进行拼接也是类似的。

基于SURF的图像拼接

用SIFT算法来实现图像拼接是很常用的方法,但是因为SIFT计算量很大,所以在速度要求很高的场合下不再适用。所以,它的改进方法SURF因为在速度方面有了明显的提高(速度是SIFT的3倍),所以在图像拼接领域还是大有作为。虽说SURF精确度和稳定性不及SIFT,但是其综合能力还是优越一些。下面将详细介绍拼接的主要步骤。

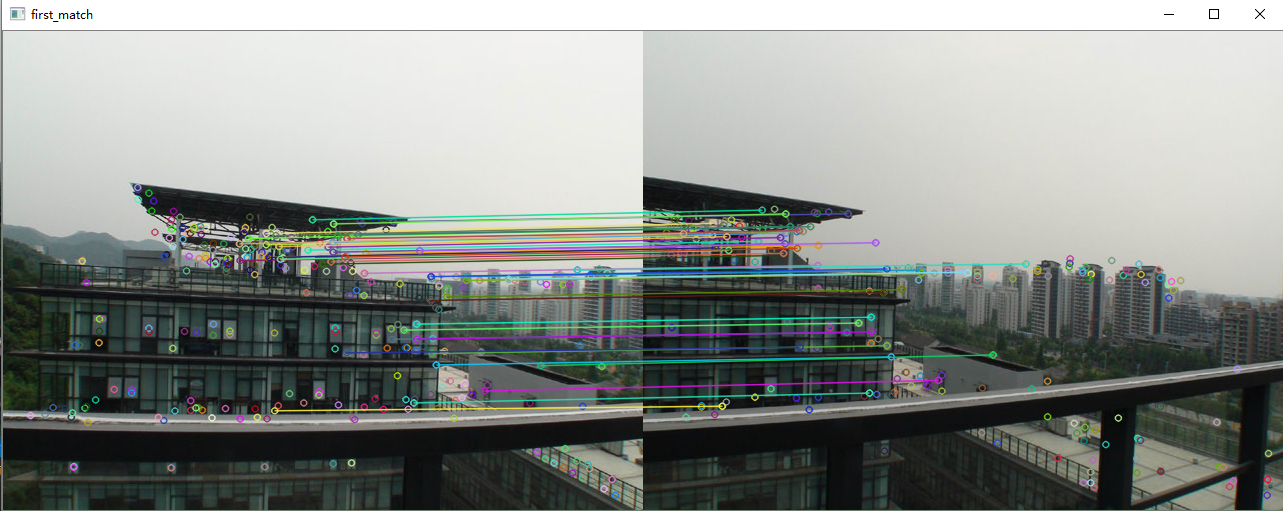

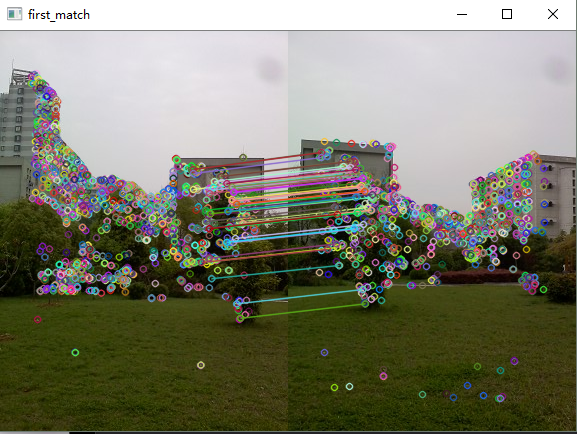

1.特征点提取和匹配

特征点提取和匹配的方法我在上一篇文章《OpenCV探索之路(二十三):特征检测和特征匹配方法汇总》中做了详细的介绍,在这里直接使用上文所总结的SURF特征提取和特征匹配的方法。

//提取特征点

SurfFeatureDetector Detector(2000);

vector<KeyPoint> keyPoint1, keyPoint2;

Detector.detect(image1, keyPoint1);

Detector.detect(image2, keyPoint2);

//特征点描述,为下边的特征点匹配做准备

SurfDescriptorExtractor Descriptor;

Mat imageDesc1, imageDesc2;

Descriptor.compute(image1, keyPoint1, imageDesc1);

Descriptor.compute(image2, keyPoint2, imageDesc2);

FlannBasedMatcher matcher;

vector<vector<DMatch> > matchePoints;

vector<DMatch> GoodMatchePoints;

vector<Mat> train_desc(1, imageDesc1);

matcher.add(train_desc);

matcher.train();

matcher.knnMatch(imageDesc2, matchePoints, 2);

cout << "total match points: " << matchePoints.size() << endl;

// Lowe's algorithm,获取优秀匹配点

for (int i = 0; i < matchePoints.size(); i++)

{

if (matchePoints[i][0].distance < 0.4 * matchePoints[i][1].distance)

{

GoodMatchePoints.push_back(matchePoints[i][0]);

}

}

Mat first_match;

drawMatches(image02, keyPoint2, image01, keyPoint1, GoodMatchePoints, first_match);

imshow("first_match ", first_match);

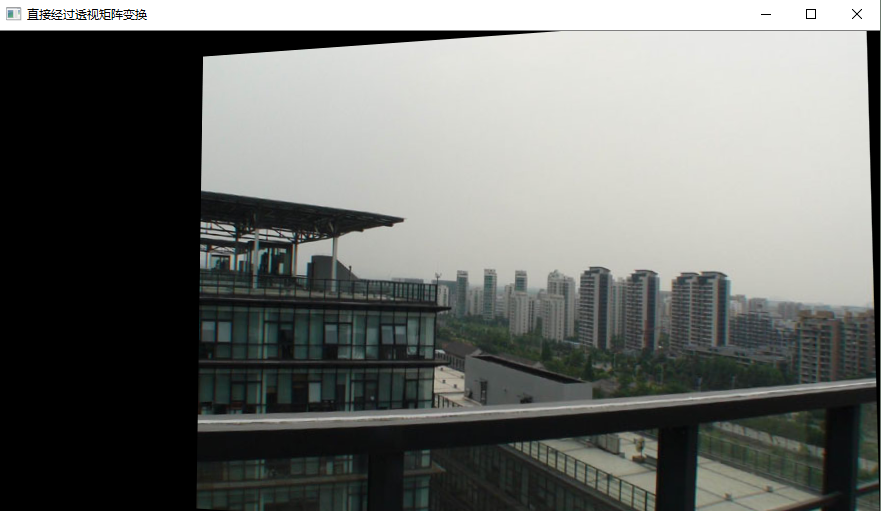

2.图像配准

这样子我们就可以得到了两幅待拼接图的匹配点集,接下来我们进行图像的配准,即将两张图像转换为同一坐标下,这里我们需要使用findHomography函数来求得变换矩阵。但是需要注意的是,findHomography函数所要用到的点集是Point2f类型的,所有我们需要对我们刚得到的点集GoodMatchePoints再做一次处理,使其转换为Point2f类型的点集。

vector<Point2f> imagePoints1, imagePoints2;

for (int i = 0; i<GoodMatchePoints.size(); i++)

{

imagePoints2.push_back(keyPoint2[GoodMatchePoints[i].queryIdx].pt);

imagePoints1.push_back(keyPoint1[GoodMatchePoints[i].trainIdx].pt);

}

这样子,我们就可以拿着imagePoints1, imagePoints2去求变换矩阵了,并且实现图像配准。值得注意的是findHomography函数的参数中我们选泽了CV_RANSAC,这表明我们选择RANSAC算法继续筛选可靠地匹配点,这使得匹配点解更为精确。

//获取图像1到图像2的投影映射矩阵 尺寸为3*3

Mat homo = findHomography(imagePoints1, imagePoints2, CV_RANSAC);

////也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout << "变换矩阵为:\n" << homo << endl << endl; //输出映射矩阵

//图像配准

Mat imageTransform1, imageTransform2;

warpPerspective(image01, imageTransform1, homo, Size(MAX(corners.right_top.x, corners.right_bottom.x), image02.rows));

//warpPerspective(image01, imageTransform2, adjustMat*homo, Size(image02.cols*1.3, image02.rows*1.8));

imshow("直接经过透视矩阵变换", imageTransform1);

imwrite("trans1.jpg", imageTransform1);

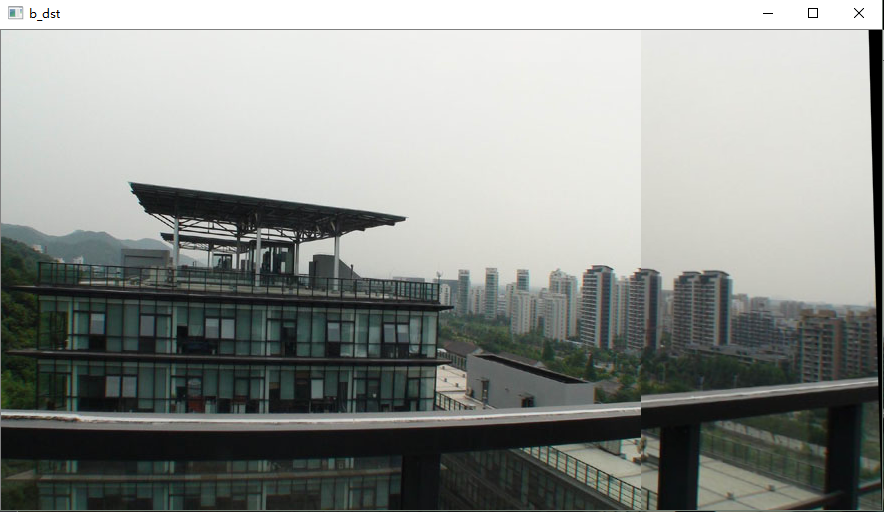

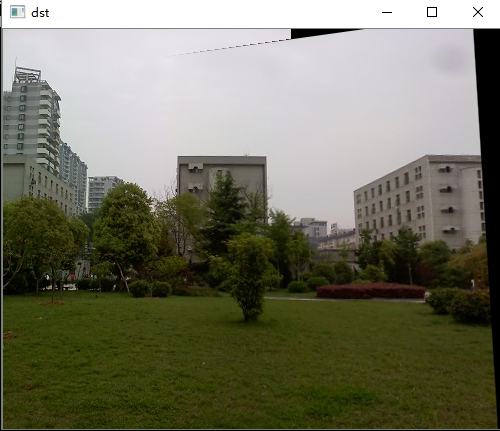

3. 图像拷贝

拷贝的思路很简单,就是将左图直接拷贝到配准图上就可以了。

//创建拼接后的图,需提前计算图的大小

int dst_width = imageTransform1.cols; //取最右点的长度为拼接图的长度

int dst_height = image02.rows;

Mat dst(dst_height, dst_width, CV_8UC3);

dst.setTo(0);

imageTransform1.copyTo(dst(Rect(0, 0, imageTransform1.cols, imageTransform1.rows)));

image02.copyTo(dst(Rect(0, 0, image02.cols, image02.rows)));

imshow("b_dst", dst);

4.图像融合(去裂缝处理)

从上图可以看出,两图的拼接并不自然,原因就在于拼接图的交界处,两图因为光照色泽的原因使得两图交界处的过渡很糟糕,所以需要特定的处理解决这种不自然。这里的处理思路是加权融合,在重叠部分由前一幅图像慢慢过渡到第二幅图像,即将图像的重叠区域的像素值按一定的权值相加合成新的图像。

//优化两图的连接处,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//开始位置,即重叠区域的左边界

double processWidth = img1.cols - start;//重叠区域的宽度

int rows = dst.rows;

int cols = img1.cols; //注意,是列数*通道数

double alpha = 1;//img1中像素的权重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //获取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到图像trans中无像素的黑点,则完全拷贝img1中的数据

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的权重,与当前处理点距重叠区域左边界的距离成正比,实验证明,这种方法确实好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}

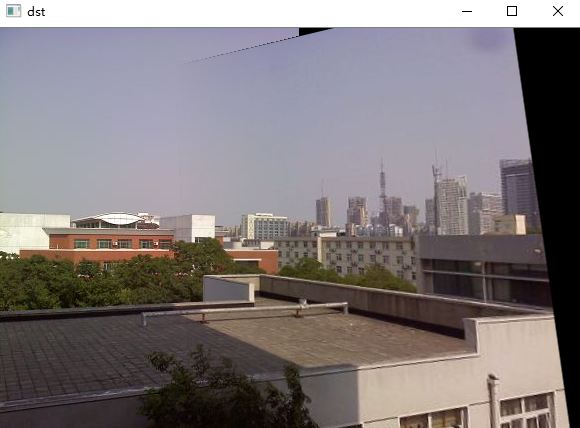

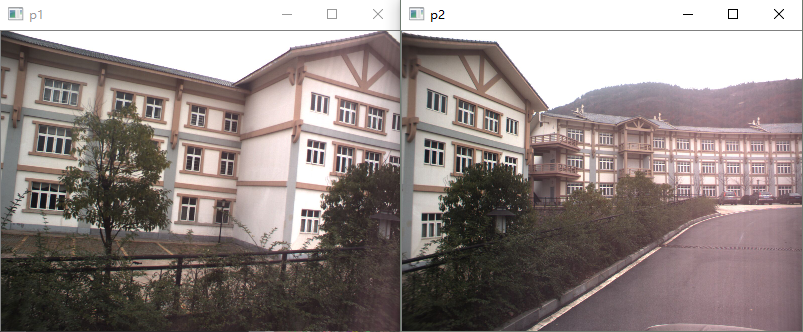

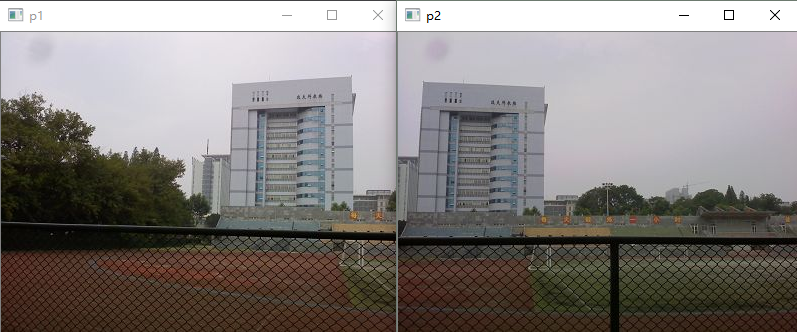

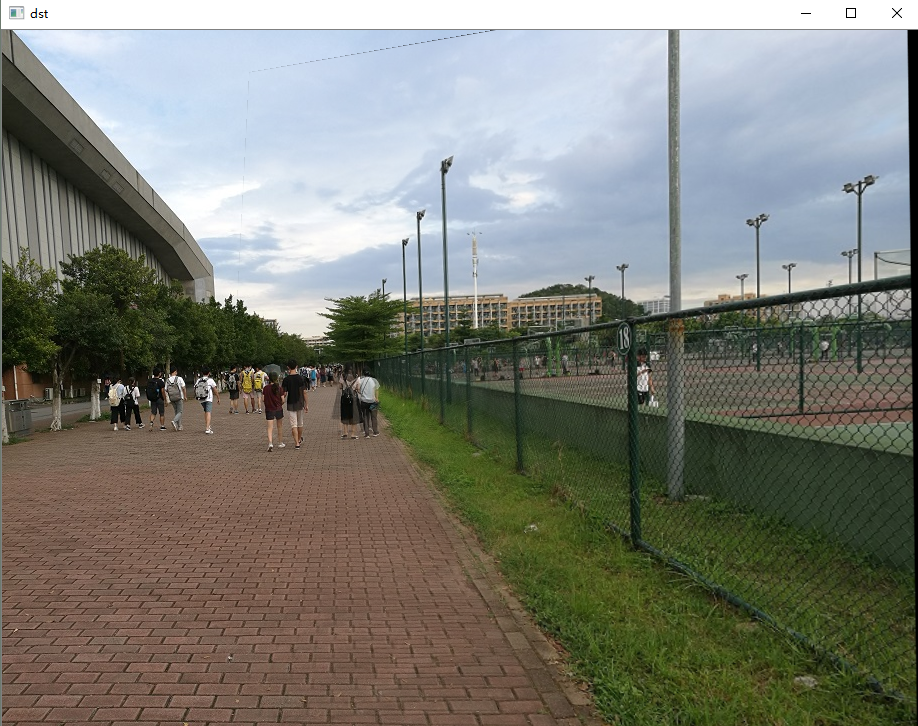

多尝试几张,验证拼接效果

测试一

测试二

测试三

最后给出完整的SURF算法实现的拼接代码。

#include "highgui/highgui.hpp"

#include "opencv2/nonfree/nonfree.hpp"

#include "opencv2/legacy/legacy.hpp"

#include <iostream>

using namespace cv;

using namespace std;

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst);

typedef struct

{

Point2f left_top;

Point2f left_bottom;

Point2f right_top;

Point2f right_bottom;

}four_corners_t;

four_corners_t corners;

void CalcCorners(const Mat& H, const Mat& src)

{

double v2[] = { 0, 0, 1 };//左上角

double v1[3];//变换后的坐标值

Mat V2 = Mat(3, 1, CV_64FC1, v2); //列向量

Mat V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

//左上角(0,0,1)

cout << "V2: " << V2 << endl;

cout << "V1: " << V1 << endl;

corners.left_top.x = v1[0] / v1[2];

corners.left_top.y = v1[1] / v1[2];

//左下角(0,src.rows,1)

v2[0] = 0;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.left_bottom.x = v1[0] / v1[2];

corners.left_bottom.y = v1[1] / v1[2];

//右上角(src.cols,0,1)

v2[0] = src.cols;

v2[1] = 0;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_top.x = v1[0] / v1[2];

corners.right_top.y = v1[1] / v1[2];

//右下角(src.cols,src.rows,1)

v2[0] = src.cols;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_bottom.x = v1[0] / v1[2];

corners.right_bottom.y = v1[1] / v1[2];

}

int main(int argc, char *argv[])

{

Mat image01 = imread("g5.jpg", 1); //右图

Mat image02 = imread("g4.jpg", 1); //左图

imshow("p2", image01);

imshow("p1", image02);

//灰度图转换

Mat image1, image2;

cvtColor(image01, image1, CV_RGB2GRAY);

cvtColor(image02, image2, CV_RGB2GRAY);

//提取特征点

SurfFeatureDetector Detector(2000);

vector<KeyPoint> keyPoint1, keyPoint2;

Detector.detect(image1, keyPoint1);

Detector.detect(image2, keyPoint2);

//特征点描述,为下边的特征点匹配做准备

SurfDescriptorExtractor Descriptor;

Mat imageDesc1, imageDesc2;

Descriptor.compute(image1, keyPoint1, imageDesc1);

Descriptor.compute(image2, keyPoint2, imageDesc2);

FlannBasedMatcher matcher;

vector<vector<DMatch> > matchePoints;

vector<DMatch> GoodMatchePoints;

vector<Mat> train_desc(1, imageDesc1);

matcher.add(train_desc);

matcher.train();

matcher.knnMatch(imageDesc2, matchePoints, 2);

cout << "total match points: " << matchePoints.size() << endl;

// Lowe's algorithm,获取优秀匹配点

for (int i = 0; i < matchePoints.size(); i++)

{

if (matchePoints[i][0].distance < 0.4 * matchePoints[i][1].distance)

{

GoodMatchePoints.push_back(matchePoints[i][0]);

}

}

Mat first_match;

drawMatches(image02, keyPoint2, image01, keyPoint1, GoodMatchePoints, first_match);

imshow("first_match ", first_match);

vector<Point2f> imagePoints1, imagePoints2;

for (int i = 0; i<GoodMatchePoints.size(); i++)

{

imagePoints2.push_back(keyPoint2[GoodMatchePoints[i].queryIdx].pt);

imagePoints1.push_back(keyPoint1[GoodMatchePoints[i].trainIdx].pt);

}

//获取图像1到图像2的投影映射矩阵 尺寸为3*3

Mat homo = findHomography(imagePoints1, imagePoints2, CV_RANSAC);

////也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout << "变换矩阵为:\n" << homo << endl << endl; //输出映射矩阵

//计算配准图的四个顶点坐标

CalcCorners(homo, image01);

cout << "left_top:" << corners.left_top << endl;

cout << "left_bottom:" << corners.left_bottom << endl;

cout << "right_top:" << corners.right_top << endl;

cout << "right_bottom:" << corners.right_bottom << endl;

//图像配准

Mat imageTransform1, imageTransform2;

warpPerspective(image01, imageTransform1, homo, Size(MAX(corners.right_top.x, corners.right_bottom.x), image02.rows));

//warpPerspective(image01, imageTransform2, adjustMat*homo, Size(image02.cols*1.3, image02.rows*1.8));

imshow("直接经过透视矩阵变换", imageTransform1);

imwrite("trans1.jpg", imageTransform1);

//创建拼接后的图,需提前计算图的大小

int dst_width = imageTransform1.cols; //取最右点的长度为拼接图的长度

int dst_height = image02.rows;

Mat dst(dst_height, dst_width, CV_8UC3);

dst.setTo(0);

imageTransform1.copyTo(dst(Rect(0, 0, imageTransform1.cols, imageTransform1.rows)));

image02.copyTo(dst(Rect(0, 0, image02.cols, image02.rows)));

imshow("b_dst", dst);

OptimizeSeam(image02, imageTransform1, dst);

imshow("dst", dst);

imwrite("dst.jpg", dst);

waitKey();

return 0;

}

//优化两图的连接处,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//开始位置,即重叠区域的左边界

double processWidth = img1.cols - start;//重叠区域的宽度

int rows = dst.rows;

int cols = img1.cols; //注意,是列数*通道数

double alpha = 1;//img1中像素的权重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //获取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到图像trans中无像素的黑点,则完全拷贝img1中的数据

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的权重,与当前处理点距重叠区域左边界的距离成正比,实验证明,这种方法确实好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}

基于ORB的图像拼接

利用ORB进行图像拼接的思路跟上面的思路基本一样,只是特征提取和特征点匹配的方式略有差异罢了。这里就不再详细介绍思路了,直接贴代码看效果。

#include "highgui/highgui.hpp"

#include "opencv2/nonfree/nonfree.hpp"

#include "opencv2/legacy/legacy.hpp"

#include <iostream>

using namespace cv;

using namespace std;

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst);

typedef struct

{

Point2f left_top;

Point2f left_bottom;

Point2f right_top;

Point2f right_bottom;

}four_corners_t;

four_corners_t corners;

void CalcCorners(const Mat& H, const Mat& src)

{

double v2[] = { 0, 0, 1 };//左上角

double v1[3];//变换后的坐标值

Mat V2 = Mat(3, 1, CV_64FC1, v2); //列向量

Mat V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

//左上角(0,0,1)

cout << "V2: " << V2 << endl;

cout << "V1: " << V1 << endl;

corners.left_top.x = v1[0] / v1[2];

corners.left_top.y = v1[1] / v1[2];

//左下角(0,src.rows,1)

v2[0] = 0;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.left_bottom.x = v1[0] / v1[2];

corners.left_bottom.y = v1[1] / v1[2];

//右上角(src.cols,0,1)

v2[0] = src.cols;

v2[1] = 0;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_top.x = v1[0] / v1[2];

corners.right_top.y = v1[1] / v1[2];

//右下角(src.cols,src.rows,1)

v2[0] = src.cols;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_bottom.x = v1[0] / v1[2];

corners.right_bottom.y = v1[1] / v1[2];

}

int main(int argc, char *argv[])

{

Mat image01 = imread("t1.jpg", 1); //右图

Mat image02 = imread("t2.jpg", 1); //左图

imshow("p2", image01);

imshow("p1", image02);

//灰度图转换

Mat image1, image2;

cvtColor(image01, image1, CV_RGB2GRAY);

cvtColor(image02, image2, CV_RGB2GRAY);

//提取特征点

OrbFeatureDetector surfDetector(3000);

vector<KeyPoint> keyPoint1, keyPoint2;

surfDetector.detect(image1, keyPoint1);

surfDetector.detect(image2, keyPoint2);

//特征点描述,为下边的特征点匹配做准备

OrbDescriptorExtractor SurfDescriptor;

Mat imageDesc1, imageDesc2;

SurfDescriptor.compute(image1, keyPoint1, imageDesc1);

SurfDescriptor.compute(image2, keyPoint2, imageDesc2);

flann::Index flannIndex(imageDesc1, flann::LshIndexParams(12, 20, 2), cvflann::FLANN_DIST_HAMMING);

vector<DMatch> GoodMatchePoints;

Mat macthIndex(imageDesc2.rows, 2, CV_32SC1), matchDistance(imageDesc2.rows, 2, CV_32FC1);

flannIndex.knnSearch(imageDesc2, macthIndex, matchDistance, 2, flann::SearchParams());

// Lowe's algorithm,获取优秀匹配点

for (int i = 0; i < matchDistance.rows; i++)

{

if (matchDistance.at<float>(i, 0) < 0.4 * matchDistance.at<float>(i, 1))

{

DMatch dmatches(i, macthIndex.at<int>(i, 0), matchDistance.at<float>(i, 0));

GoodMatchePoints.push_back(dmatches);

}

}

Mat first_match;

drawMatches(image02, keyPoint2, image01, keyPoint1, GoodMatchePoints, first_match);

imshow("first_match ", first_match);

vector<Point2f> imagePoints1, imagePoints2;

for (int i = 0; i<GoodMatchePoints.size(); i++)

{

imagePoints2.push_back(keyPoint2[GoodMatchePoints[i].queryIdx].pt);

imagePoints1.push_back(keyPoint1[GoodMatchePoints[i].trainIdx].pt);

}

//获取图像1到图像2的投影映射矩阵 尺寸为3*3

Mat homo = findHomography(imagePoints1, imagePoints2, CV_RANSAC);

////也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout << "变换矩阵为:\n" << homo << endl << endl; //输出映射矩阵

//计算配准图的四个顶点坐标

CalcCorners(homo, image01);

cout << "left_top:" << corners.left_top << endl;

cout << "left_bottom:" << corners.left_bottom << endl;

cout << "right_top:" << corners.right_top << endl;

cout << "right_bottom:" << corners.right_bottom << endl;

//图像配准

Mat imageTransform1, imageTransform2;

warpPerspective(image01, imageTransform1, homo, Size(MAX(corners.right_top.x, corners.right_bottom.x), image02.rows));

//warpPerspective(image01, imageTransform2, adjustMat*homo, Size(image02.cols*1.3, image02.rows*1.8));

imshow("直接经过透视矩阵变换", imageTransform1);

imwrite("trans1.jpg", imageTransform1);

//创建拼接后的图,需提前计算图的大小

int dst_width = imageTransform1.cols; //取最右点的长度为拼接图的长度

int dst_height = image02.rows;

Mat dst(dst_height, dst_width, CV_8UC3);

dst.setTo(0);

imageTransform1.copyTo(dst(Rect(0, 0, imageTransform1.cols, imageTransform1.rows)));

image02.copyTo(dst(Rect(0, 0, image02.cols, image02.rows)));

imshow("b_dst", dst);

OptimizeSeam(image02, imageTransform1, dst);

imshow("dst", dst);

imwrite("dst.jpg", dst);

waitKey();

return 0;

}

//优化两图的连接处,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//开始位置,即重叠区域的左边界

double processWidth = img1.cols - start;//重叠区域的宽度

int rows = dst.rows;

int cols = img1.cols; //注意,是列数*通道数

double alpha = 1;//img1中像素的权重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //获取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到图像trans中无像素的黑点,则完全拷贝img1中的数据

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的权重,与当前处理点距重叠区域左边界的距离成正比,实验证明,这种方法确实好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}

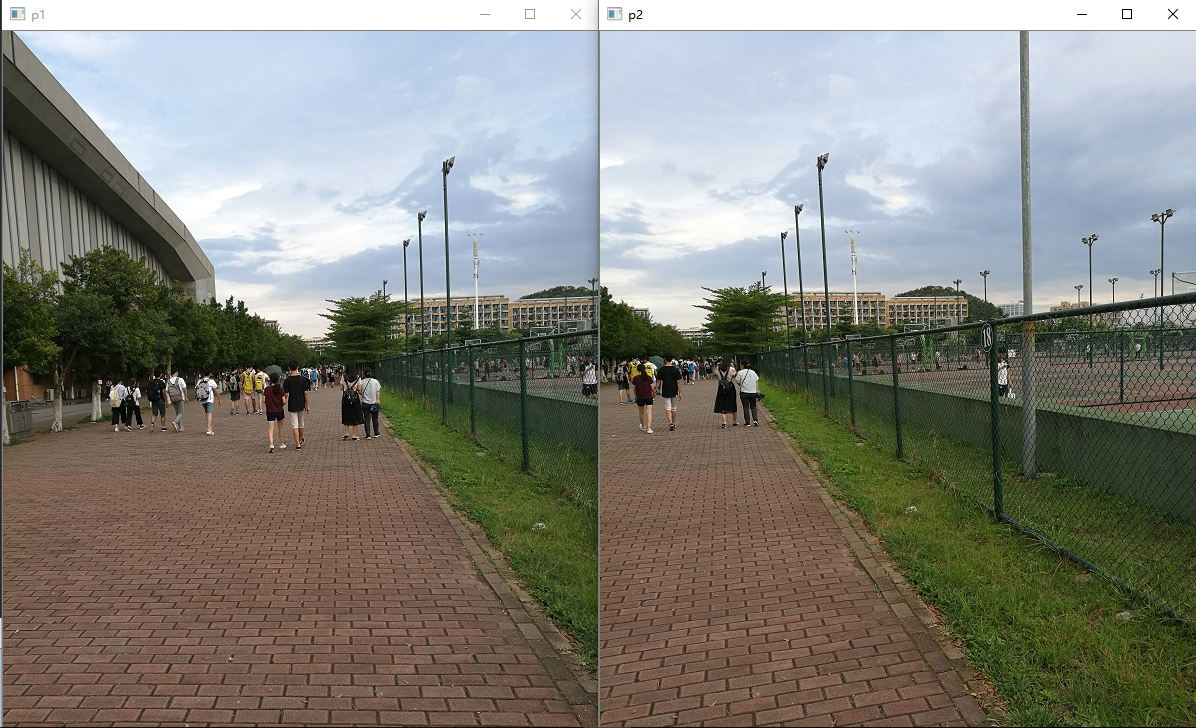

看一看拼接效果,我觉得还是不错的。

看一下这一组图片,这组图片产生了鬼影,为什么?因为两幅图中的人物走动了啊!所以要做图像拼接,尽量保证使用的是静态图片,不要加入一些动态因素干扰拼接。

opencv自带的拼接算法stitch

opencv其实自己就有实现图像拼接的算法,当然效果也是相当好的,但是因为其实现很复杂,而且代码量很庞大,其实在一些小应用下的拼接有点杀鸡用牛刀的感觉。最近在阅读sticth源码时,发现其中有几个很有意思的地方。

1.opencv stitch选择的特征检测方式

一直很好奇opencv stitch算法到底选用了哪个算法作为其特征检测方式,是ORB,SIFT还是SURF?读源码终于看到答案。

#ifdef HAVE_OPENCV_NONFREE

stitcher.setFeaturesFinder(new detail::SurfFeaturesFinder());

#else

stitcher.setFeaturesFinder(new detail::OrbFeaturesFinder());

#endif

在源码createDefault函数中(默认设置),第一选择是SURF,第二选择才是ORB(没有NONFREE模块才选),所以既然大牛们这么选择,必然是经过综合考虑的,所以应该SURF算法在图像拼接有着更优秀的效果。

2.opencv stitch获取匹配点的方式

以下代码是opencv stitch源码中的特征点提取部分,作者使用了两次特征点提取的思路:先对图一进行特征点提取和筛选匹配(1->2),再对图二进行特征点的提取和匹配(2->1),这跟我们平时的一次提取的思路不同,这种二次提取的思路可以保证更多的匹配点被选中,匹配点越多,findHomography求出的变换越准确。这个思路值得借鉴。

matches_info.matches.clear();

Ptr<flann::IndexParams> indexParams = new flann::KDTreeIndexParams();

Ptr<flann::SearchParams> searchParams = new flann::SearchParams();

if (features2.descriptors.depth() == CV_8U)

{

indexParams->setAlgorithm(cvflann::FLANN_INDEX_LSH);

searchParams->setAlgorithm(cvflann::FLANN_INDEX_LSH);

}

FlannBasedMatcher matcher(indexParams, searchParams);

vector< vector<DMatch> > pair_matches;

MatchesSet matches;

// Find 1->2 matches

matcher.knnMatch(features1.descriptors, features2.descriptors, pair_matches, 2);

for (size_t i = 0; i < pair_matches.size(); ++i)

{

if (pair_matches[i].size() < 2)

continue;

const DMatch& m0 = pair_matches[i][0];

const DMatch& m1 = pair_matches[i][1];

if (m0.distance < (1.f - match_conf_) * m1.distance)

{

matches_info.matches.push_back(m0);

matches.insert(make_pair(m0.queryIdx, m0.trainIdx));

}

}

LOG("\n1->2 matches: " << matches_info.matches.size() << endl);

// Find 2->1 matches

pair_matches.clear();

matcher.knnMatch(features2.descriptors, features1.descriptors, pair_matches, 2);

for (size_t i = 0; i < pair_matches.size(); ++i)

{

if (pair_matches[i].size() < 2)

continue;

const DMatch& m0 = pair_matches[i][0];

const DMatch& m1 = pair_matches[i][1];

if (m0.distance < (1.f - match_conf_) * m1.distance)

if (matches.find(make_pair(m0.trainIdx, m0.queryIdx)) == matches.end())

matches_info.matches.push_back(DMatch(m0.trainIdx, m0.queryIdx, m0.distance));

}

LOG("1->2 & 2->1 matches: " << matches_info.matches.size() << endl);

这里我仿照opencv源码二次提取特征点的思路对我原有拼接代码进行改写,实验证明获取的匹配点确实较一次提取要多。

//提取特征点

SiftFeatureDetector Detector(1000); // 海塞矩阵阈值,在这里调整精度,值越大点越少,越精准

vector<KeyPoint> keyPoint1, keyPoint2;

Detector.detect(image1, keyPoint1);

Detector.detect(image2, keyPoint2);

//特征点描述,为下边的特征点匹配做准备

SiftDescriptorExtractor Descriptor;

Mat imageDesc1, imageDesc2;

Descriptor.compute(image1, keyPoint1, imageDesc1);

Descriptor.compute(image2, keyPoint2, imageDesc2);

FlannBasedMatcher matcher;

vector<vector<DMatch> > matchePoints;

vector<DMatch> GoodMatchePoints;

MatchesSet matches;

vector<Mat> train_desc(1, imageDesc1);

matcher.add(train_desc);

matcher.train();

matcher.knnMatch(imageDesc2, matchePoints, 2);

// Lowe's algorithm,获取优秀匹配点

for (int i = 0; i < matchePoints.size(); i++)

{

if (matchePoints[i][0].distance < 0.4 * matchePoints[i][1].distance)

{

GoodMatchePoints.push_back(matchePoints[i][0]);

matches.insert(make_pair(matchePoints[i][0].queryIdx, matchePoints[i][0].trainIdx));

}

}

cout<<"\n1->2 matches: " << GoodMatchePoints.size() << endl;

#if 1

FlannBasedMatcher matcher2;

matchePoints.clear();

vector<Mat> train_desc2(1, imageDesc2);

matcher2.add(train_desc2);

matcher2.train();

matcher2.knnMatch(imageDesc1, matchePoints, 2);

// Lowe's algorithm,获取优秀匹配点

for (int i = 0; i < matchePoints.size(); i++)

{

if (matchePoints[i][0].distance < 0.4 * matchePoints[i][1].distance)

{

if (matches.find(make_pair(matchePoints[i][0].trainIdx, matchePoints[i][0].queryIdx)) == matches.end())

{

GoodMatchePoints.push_back(DMatch(matchePoints[i][0].trainIdx, matchePoints[i][0].queryIdx, matchePoints[i][0].distance));

}

}

}

cout<<"1->2 & 2->1 matches: " << GoodMatchePoints.size() << endl;

#endif

最后再看一下opencv stitch的拼接效果吧~速度虽然比较慢,但是效果还是很好的。

#include <iostream>

#include <opencv2/core/core.hpp>

#include <opencv2/highgui/highgui.hpp>

#include <opencv2/imgproc/imgproc.hpp>

#include <opencv2/stitching/stitcher.hpp>

using namespace std;

using namespace cv;

bool try_use_gpu = false;

vector<Mat> imgs;

string result_name = "dst1.jpg";

int main(int argc, char * argv[])

{

Mat img1 = imread("34.jpg");

Mat img2 = imread("35.jpg");

imshow("p1", img1);

imshow("p2", img2);

if (img1.empty() || img2.empty())

{

cout << "Can't read image" << endl;

return -1;

}

imgs.push_back(img1);

imgs.push_back(img2);

Stitcher stitcher = Stitcher::createDefault(try_use_gpu);

// 使用stitch函数进行拼接

Mat pano;

Stitcher::Status status = stitcher.stitch(imgs, pano);

if (status != Stitcher::OK)

{

cout << "Can't stitch images, error code = " << int(status) << endl;

return -1;

}

imwrite(result_name, pano);

Mat pano2 = pano.clone();

// 显示源图像,和结果图像

imshow("全景图像", pano);

if (waitKey() == 27)

return 0;

}

OpenCV探索之路(二十四)图像拼接和图像融合技术的更多相关文章

- OpenCV探索之路(十四):绘制点、直线、几何图形

绘制点和圆 void cvCircle( CvArr* img, CvPoint center, int radius, CvScalar color, int thickness=1, int li ...

- Bootstrap<基础二十四> 缩略图

Bootstrap 缩略图.大多数站点都需要在网格中布局图像.视频.文本等.Bootstrap 通过缩略图为此提供了一种简便的方式.使用 Bootstrap 创建缩略图的步骤如下: 在图像周围添加带有 ...

- 二十四、Struts2中的UI标签

二十四.Struts2中的UI标签 Struts2中UI标签的优势: 数据回显 页面布局和排版(Freemark),struts2提供了一些常用的排版(主题:xhtml默认 simple ajax) ...

- WCF技术剖析之二十四: ServiceDebugBehavior服务行为是如何实现异常的传播的?

原文:WCF技术剖析之二十四: ServiceDebugBehavior服务行为是如何实现异常的传播的? 服务端只有抛出FaultException异常才能被正常地序列化成Fault消息,并实现向客户 ...

- VMware vSphere 服务器虚拟化之二十四 桌面虚拟化之手动池管理物理机

VMware vSphere 服务器虚拟化之二十四 桌面虚拟化之手动池管理物理机 VMwareView手动池可以管理物理计算机 说明: 环境基于实验二十三 1.准备一台Windows 7的物理计算机名 ...

- Bootstrap入门(二十四)data属性

Bootstrap入门(二十四)data属性 你可以仅仅通过 data 属性 API 就能使用所有的 Bootstrap 插件,无需写一行 JavaScript 代码.这是 Bootstrap 中的一 ...

- 3360: [Usaco2004 Jan]算二十四

3360: [Usaco2004 Jan]算二十四 Time Limit: 10 Sec Memory Limit: 128 MBSubmit: 6 Solved: 6[Submit][Statu ...

- JAVA之旅(二十四)——I/O流,字符流,FileWriter,IOException,文件续写,FileReader,小练习

JAVA之旅(二十四)--I/O流,字符流,FileWriter,IOException,文件续写,FileReader,小练习 JAVA之旅林林总总也是写了二十多篇了,我们今天终于是接触到了I/O了 ...

- 二十四. Python基础(24)--封装

二十四. Python基础(24)--封装 ● 知识结构 ● 类属性和__slots__属性 class Student(object): grade = 3 # 也可以写在__slots ...

随机推荐

- 跟我一起读postgresql源码(六)——Executor(查询执行模块之——查询执行策略)

时光荏苒,岁月如梭.楼主已经很久没有更新了.之前说好的一周一更的没有做到.实在是事出有因,没能静下心来好好看代码.当然这不能作为我不更新的理由,时间挤挤还是有的,拖了这么久,该再写点东西了,不然人就怠 ...

- 响应式移动端去除css的hover和jq的hover还有input在苹果下的默认样式

去除css的hover: /*直接给body添加ontouchstart*/ <body ontouchstart> 去除jq的hover: var winW01 = $(window). ...

- input输入框自动填充黄色背景解决方案

chrome表单自动填充后,input文本框的背景会变成偏黄色的,这是由于chrome会默认给自动填充的input表单加上input:-webkit-autofill私有属性,然后对其赋予以下样式: ...

- java基础02 数据类型转

一.回答问题 float f1 = 6.66f; float f2 = (float) 6.67; f1==f2? /** * * @author sun * */ public class Demo ...

- Vulkan Tutorial 29 Loading models

操作系统:Windows8.1 显卡:Nivida GTX965M 开发工具:Visual Studio 2017 Introduction 应用程序现在已经可以渲染纹理3D模型,但是 vertice ...

- Echarts折线图表断点如何补全

Echarts折线图如何补全断点以及如何隐藏断点的title 做报表的时候,尤其是做图表的时候时常会碰到某一记录的值中缺少某个时间段(比如月份或季度)的值,导致图表显示残缺不全,for example ...

- 了解Java并学会创建Java项目(一个菜鸟的成长历程)

计算机语言分类:了解 1)低级语言:更接近于计算机的语言 1.1)机器语言:由0和1组成的 1.2)汇编语言:有一些助记符号2)高级语言:更接近于人的语言 2.1)面向过程的:C... 2.2)面向对 ...

- Java之集合初探(二)Iterator(迭代器),collections,打包/解包(装箱拆箱),泛型(Generic),comparable接口

Iterator(迭代器) 所有实现了Collection接口的容器都有一个iterator方法, 用来返回一个实现了Iterator接口的对象 Iterator对象称作迭代器, 用来方便的实现对容器 ...

- 【Python】debug工具-pdb(转)

Debug功能对于developer是非常重要的,python提供了相应的模块pdb让你可以在用文本编辑器写脚本的情况下进行debug. pdb是python debugger的简称. 常用的一些命令 ...

- HTML5 开发APP(MUI的一些特性)

先附mui文档地址:http://dev.dcloud.net.cn/mui/ui/ .mui的UI组件比较简单而且在文档中很好找就不过多说了. 1 在app开发中,使用HTML5+的api,必须m ...