机器学习算法 - 最近邻规则分类KNN

上节介绍了机器学习的决策树算法,它属于分类算法,本节我们介绍机器学习的另外一种分类算法:最近邻规则分类KNN,书名为【k-近邻算法】。

KNN算法的工作原理是:将预测的目标数据分别跟样本进行比较,得到一组距离的数据,取最近的K个数据,遵循少数服从多数的原则,从而获得目标数据的分类。

简单的说,就是【近朱者赤,近墨者者黑】,下面我们一起通过KNN算法来演示这句名言的内涵。

【案例背景】

我的一个表弟,自幼聪明过人,读书的时候称得上名列前茅,父母以此为骄傲。但是好景不长,自从参加工作后,结识了几个狐朋狗友,从此进入了堕落的生活,名声也臭名远扬。

家里人经分析,主要是环境影响人,让他尽快远离他那些所谓的哥们朋友,多结识些正能量有思想有理想的人,也在此祝他成功吧~

【代码演示】

from sklearn import neighbors

import numpy as np

import matplotlib.pyplot as plt

from matplotlib.colors import ListedColormap #加上这句 #构造800个随机分布的点

X1 = np.random.randint(0, 500, (250, 2))

X2 = np.random.randint(500, 1000, (250, 2))

X3 = np.random.randint(0, 1000, (300, 2)) #这里添加一些杂点

X = np.concatenate((X1, X2, X3), axis=0) #初始化数据,用0和1表示结果

y = np.ones(800, dtype=np.int)

y[0:250] = 0

y[500:650] = 0 #KNN算法核心语句,其中k=15

clf = neighbors.KNeighborsClassifier(15, weights='uniform')

clf.fit(X, y) #显示预测结果

test_x1 = 400

test_y1 = 400

test_x2 = 600

test_y2 = 600

x = np.array([[test_x1, test_y1]])

Z = clf.predict(x)

print('蓝色方块归类:', Z)

x = np.array([[test_x2, test_y2]])

Z = clf.predict(x)

print('蓝色三角归类:', Z) #将数据图形化显示, 结果0用红色显示,1用黑色显示

cmap_bold = ListedColormap(['#ff6666', '#919191'])

plt.scatter(X[:, 0], X[:, 1], c=y, cmap=cmap_bold, edgecolor='k', s=30)

plt.scatter([test_x1], [test_y1],marker='s', color='#224EFF', s= 300)

plt.scatter([test_x2], [test_y2], marker='^', color='#224EFF', s= 300)

plt.show()

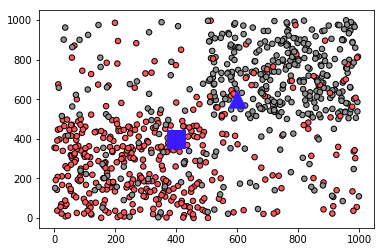

【运行结果】

蓝色方块归类: [0]

蓝色三角归类: [1]

OK, 本讲到此结束,后续更多精彩内容,请持续关注我的博客。

本文为原创文章,请珍惜作者的劳动成果,转载请注明出处。

机器学习算法 - 最近邻规则分类KNN的更多相关文章

- 机器学习--最邻近规则分类KNN算法

理论学习: 3. 算法详述 3.1 步骤: 为了判断未知实例的类别,以所有已知类别的实例作为参照 选择参数K 计算未知实例与所有已知实例的距离 选 ...

- 最近邻规则分类(k-Nearest Neighbor )机器学习算法python实现

综述 Cover和Hart在1968年提出了最初的近邻算法 是分类(classification)算法 输入基于实例的学习(instance-based learning),惰性学习(lazy lea ...

- 机器学习:最近邻规则KNN算法

这个算法就比较简单易懂了 就是把每个向量的特征值抽象成坐标,寻找最近的k个点,来进行划分 代码如下 #include <iostream> #include <cstdio> ...

- 最邻近规则分类KNN算法

例子: 求未知电影属于什么类型: 算法介绍: 步骤: 为了判断未知实例的类别,以所有已知类别的实例作为参照 选择参数K 计算未知实例与所有已知实例的距离 选择最近K个已 ...

- 每日一个机器学习算法——k近邻分类

K近邻很简单. 简而言之,对于未知类的样本,按照某种计算距离找出它在训练集中的k个最近邻,如果k个近邻中多数样本属于哪个类别,就将它判决为那一个类别. 由于采用k投票机制,所以能够减小噪声的影响. 由 ...

- # 机器学习算法总结-第一天(KNN、决策树)

KNN算法总结 KNN算法的核心思想是如果一个样本在特征空间中的k个最相邻的样本中的大多数属于某一个类别,则该样本也属于这个类别.(监督) k近邻算法(knn)是一种基本的分类与回归的算法,k-mea ...

- 如何解读「量子计算应对大数据挑战:中国科大首次实现量子机器学习算法」?——是KNN算法吗?

作者:知乎用户链接:https://www.zhihu.com/question/29187952/answer/48519630 我居然今天才看到这个问题,天……本专业,有幸听过他们这个实验的组会来 ...

- 机器学习算法笔记1_2:分类和逻辑回归(Classification and Logistic regression)

形式: 採用sigmoid函数: g(z)=11+e−z 其导数为g′(z)=(1−g(z))g(z) 如果: 即: 若有m个样本,则似然函数形式是: 对数形式: 採用梯度上升法求其最大值 求导: 更 ...

- scikit-learn中的机器学习算法封装——kNN

接前面 https://www.cnblogs.com/Liuyt-61/p/11738399.html 回过头来看这张图,什么是机器学习?就是将训练数据集喂给机器学习算法,在上面kNN算法中就是将特 ...

随机推荐

- (转)关于Tomcat的点点滴滴(体系架构、处理http请求的过程、安装和配置、目录结构、设置压缩和对中文文件名的支持、以及Catalina这个名字的由来……等)

转自:http://itfish.net/article/41668.html 总结Tomcat的体系架构.处理http请求的过程.安装和配置.目录结构.设置压缩和对中文文件名的支持.以及Cata ...

- Java Swing学习

在Java学习的过程中,我们时常会因为控制台程序的枯燥而失去了学习Java的乐趣,那么今天我们就开始学习Java的Swing.也就是GUI(Graphical user interface),在应用到 ...

- Pdf文件处理组件对比(Aspose.Pdf,Spire.Pdf,iText7)

目的 因为公司是做医疗相关软件的,所以经常和文档打交道,其中就包含了Pdf.医院的Pdf(通常是他们的报告)都千奇百怪,而我们一直以来都是在用一些免费且可能已经没人维护了的组件来处理Pdf,所以就经常 ...

- C++内联函数(03)

在C++中我们通常定义以下函数来求两个整数的最大值: 代码如下: int max(int a, int b){ return a > b ? a : b;} 为这么一个小的操作定义一个函数的好处 ...

- PhiloGL学习(3)——程序员的法宝—键盘、鼠标

前言 上一篇文章中介绍了如何让对象动起来,本文介绍如何让场景响应我们的鼠标和键盘以控制场景的缩放及对象的转动和移动等. 一. 原理分析 有了上一篇文章的基础,我们已经知道了如何让场景和对象动起来.本文 ...

- LeetCode 455. Assign Cookies (分发曲奇饼干)

Assume you are an awesome parent and want to give your children some cookies. But, you should give e ...

- python自动化运维五:paramiko

p { margin-bottom: 0.25cm; line-height: 120% } a:link { } paramiko是基于python实现的SSH2远程安全连接,支持认证以及密钥方式, ...

- 一个有意思的Python小程序(全国省会名称随机出题)

本文为作者原创,转载请注明出处(http://www.cnblogs.com/mar-q/)by 负赑屃 最近比较迷Python,仿照<Python编程快速上手>8.5写了一个随机出卷的小 ...

- Air Raid

Air Raid Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 65536/32768 K (Java/Others) Total Subm ...

- 网络基础二 tcp/ip协议簇 端口 三次握手 四次挥手 11种状态集

第1章 概念介绍 1.1 VLAN 1.1.1 什么是VLAN VLAN(Virtual LAN),翻译成中文是“虚拟局域网”.LAN可以是由少数几台家用计算机构成的网络,也可以是数以百计的计算机构成 ...