Hadoop环境安装与配置

1.基础操作系统环境安装(略)

2.JDK的安装与配置

当前各大数据软件如Hadoop等,仍然停留在Java 8上,在本实验选用的是Java 8。在自己的Linux系统中,jdk可以使用如下命令进行一键安装(需具备sudo权限)。

sudo yum install java-1.8.0-openjdk sudo yum install java-1.8.0-openjdk-devel

执行完命令后直接选择y

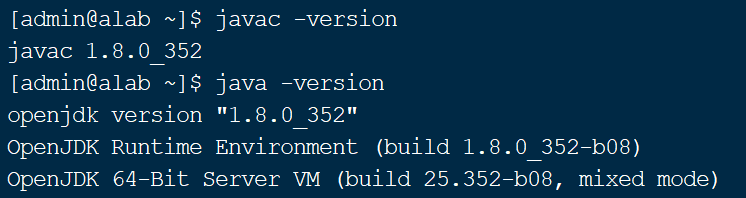

待安装完成后,需通过如下命令,检查java(jdk)是否安装成功

java -version javac -version

以下为检测情况:

3.Hadoop编译版本的下载,解压,并放置到相应目录中

注意:在接下来的操作中需将用户切换至Hadoop用户下

添加Hadoop专用的用户

在进行Hadoop配置前是需先添加一个Hadoop专用的用户,操作Hadoop系统(含安装、配置,提交计算任务等),一般给该用户配置sudo权限,以便于配置过程中执行一些高权限的操作。以下设置该用户名为hadoop,可以进行如下操作:

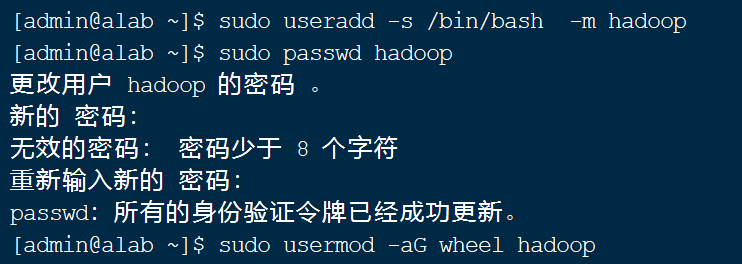

sudo useradd -s /bin/bash -m hadoop sudo passwd hadoop sudo usermod -aG wheel hadoop

按照提示输入即可(注意虽然密码长度不足8位,会出现警告,但是仍然可以设置)

上图操作命令分别对应添加Hadoop用户、设置密码和给予sudo权限。

生成SSH密钥、配置SSH免密登录

无论单节点的伪分布式部署,还是3节点的完全分布式部署,均需要配置SSH免密登录。配置免密登录需进行以下两步:

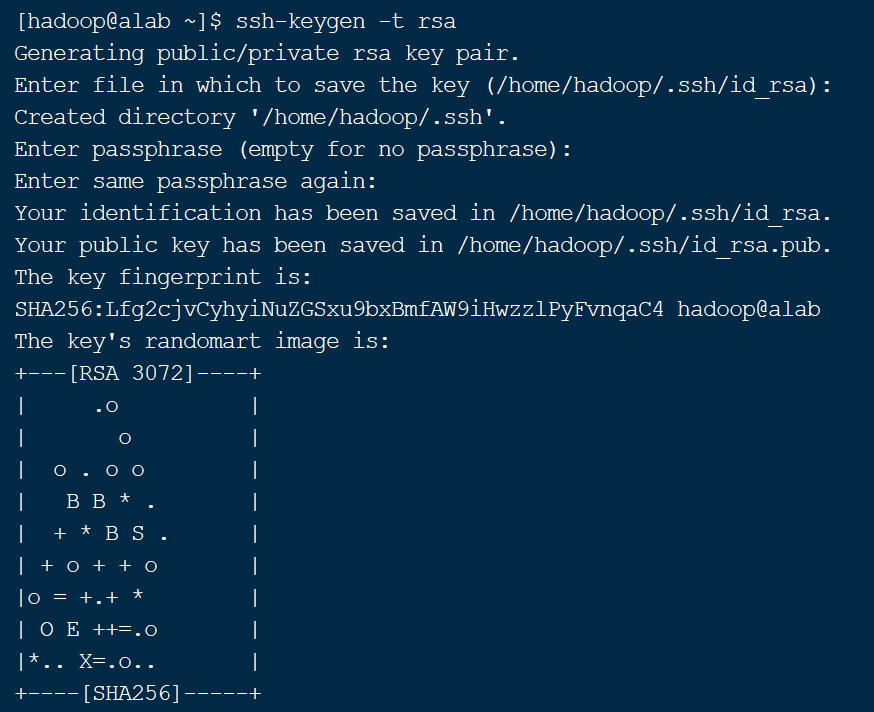

2.1.生成当前用户的密钥

ssh-keygen -t rsa

上图中所有步骤均直接按回车即可。

将生成的公钥安装到目标服务器上

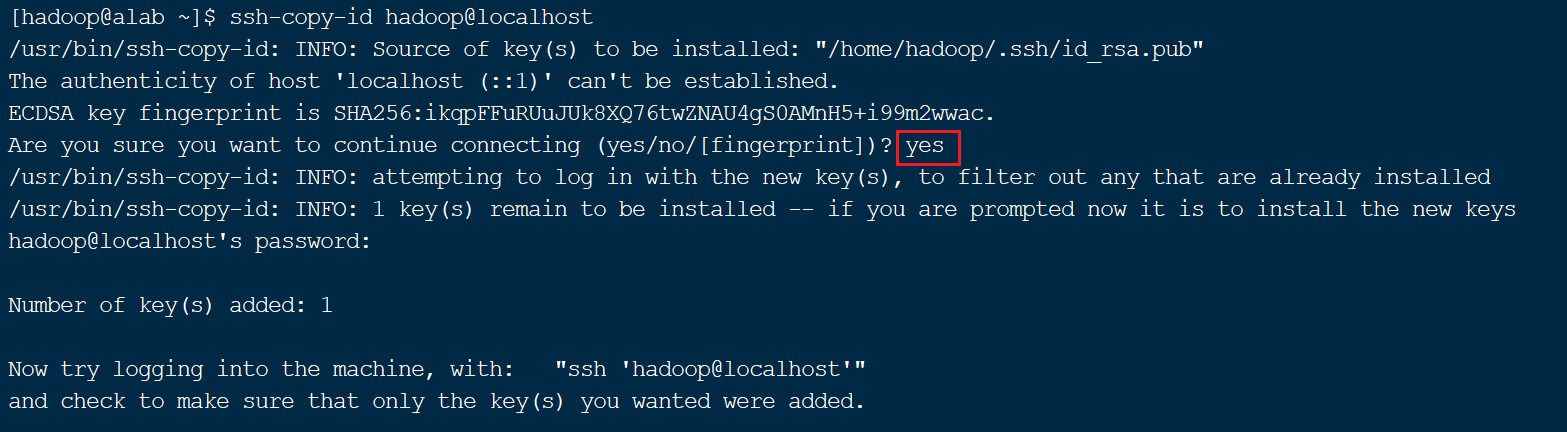

ssh-copy-id 用户名@目标服务器的IP,按照提示输入密码等

例如,安装到本机当前用户(hadoop)

ssh-copy-id hadoop@localhost

图中红框部分输入yes,其余按提示完成即可。

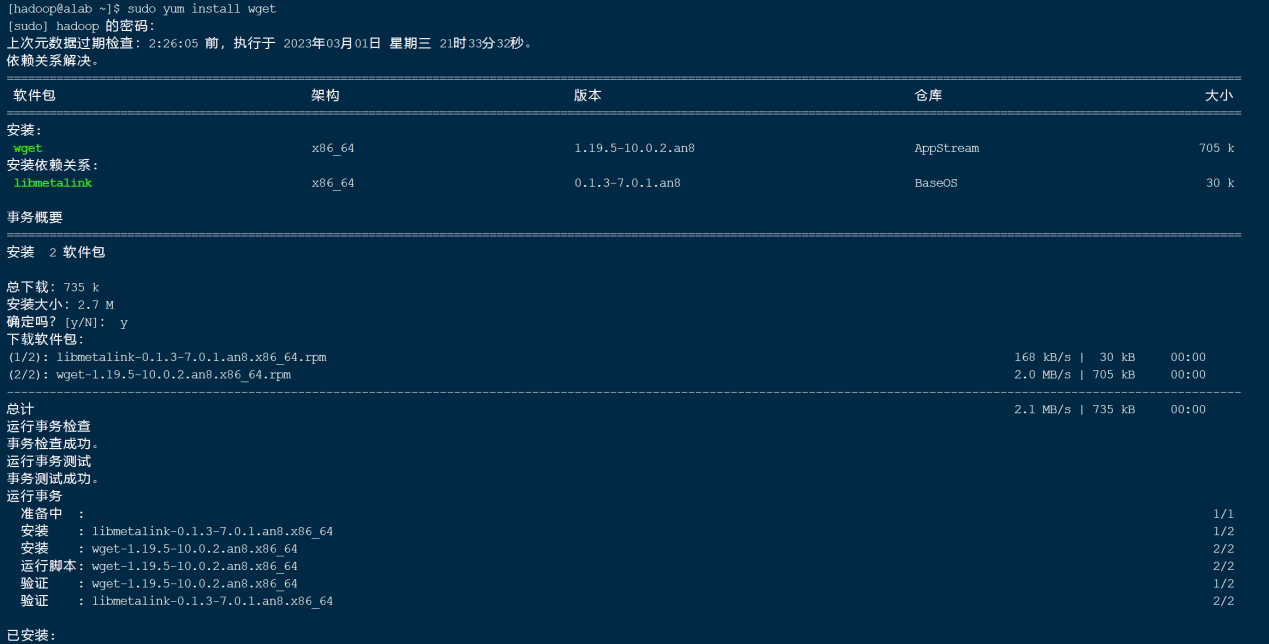

安装wget工具(Linux系统下的下载工具)

具体操作命令如下:

sudo yum install wget

这里直接选择y即可。

Hadoop伪分布式安装

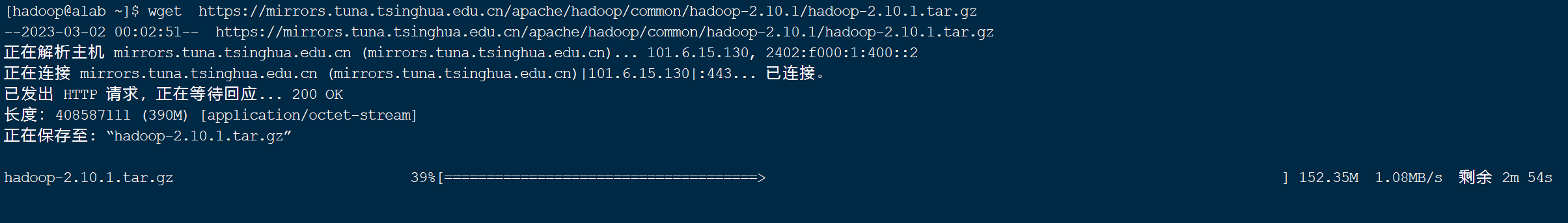

(1)下载安装包

wget https://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-2.10.1/hadoop-2.10.1.tar.gz

这里直接根据命令下载即可。

(2) 解压文件并放置到适当的位置

一般将用户自己安装的程序放在/usr/local/目录下,为了便于管理,我们统一创建/usr/local/bda/目录,并将此目录(及其子目录)的所有者改为hadoop

sudo mkdir /usr/local/bda

sudo chown -R hadoop:hadoop /usr/local/bda

cd ~ # 切换回hadoop用户的home目录

tar xzvf hadoop-2.10.1.tar.gz

注意:如果提示找不到 tar 命令,则需要先安装,如下面命令所示:

sudo yum install tar

将解压后的文件夹移动到/usr/local/bda/目录下,并改名为hadoop

mv ~/hadoop-2.10.1 /usr/local/bda/hadoop

4.Hadoop环境的配置

Hadoop 2.x主要由HDFS、yarn、MapReduce三部分组成,因此总共有5个文件需要进行配置,分别是:

(1) hadoop-env.sh: Hadoop运行环境

(2) core-site.xml: 集群全局参数

(3) hdfs-site.xml: HDFS的配置

(4) yarn-site.xml: 集群资源管理系统参数

(5) mapred-site.xml:MapReduce的参数

需要说明的是:在执行完本节(4.3)的配置后,实际上完成的是整个Hadoop的配置(含MapReduce、YARN)而不仅仅是HDFS的配置。

- 建立Hadoop所需的目录

因为HDFS、MapReduce正常工作,需要一些专用的目录的辅助。因此在开始配置之前,需要建立相应的文件夹,操作如下:

mkdir /usr/local/bda/hadoop/tmp

mkdir /usr/local/bda/hadoop/var

mkdir /usr/local/bda/hadoop/dfs

mkdir /usr/local/bda/hadoop/dfs/name

mkdir /usr/local/bda/hadoop/dfs/data

- 配置hadoop-env.sh

Hadoop系统环境,只需要配置一个环境变量:JAVA_HOME,也就是告诉Hadoop系统,java的安装位置,使用如下命令打开配置文件:

vim /usr/local/bda/hadoop/etc/hadoop/hadoop-env.sh

进行如下修改,然后保存、退出(:wq)。

- 配置core-site.xml

vim /usr/local/bda/hadoop/etc/hadoop/core-site.xml

添加到core-site.xml文件configuration中的内容如下:

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/bda/hadoop/tmp</value>

<description>A base for other temporary directories.</description>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

说明:此处进行了两项配置,(1)配置了hadoop的临时目录;(2)配置了文件系统缺省的主机和端口。因为是伪分布式系统,所以此处的主机名是localhost

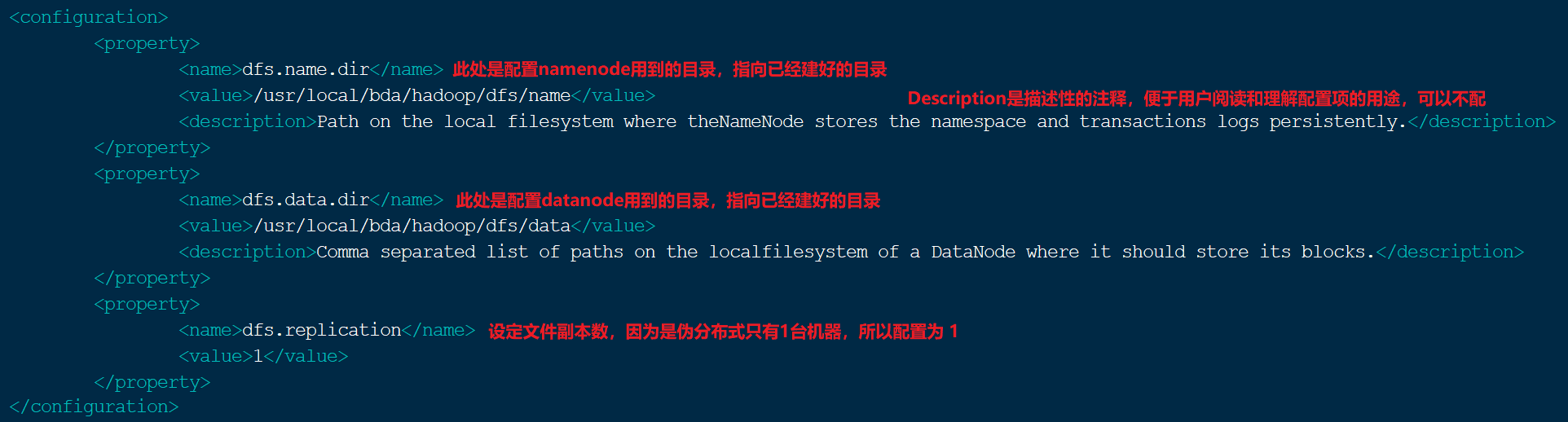

- 配置hdfs-site.xml

vim /usr/local/bda/hadoop/etc/hadoop/hdfs-site.xml

进行如下图的配置,各项的说明见下图中的红字,保存,退出

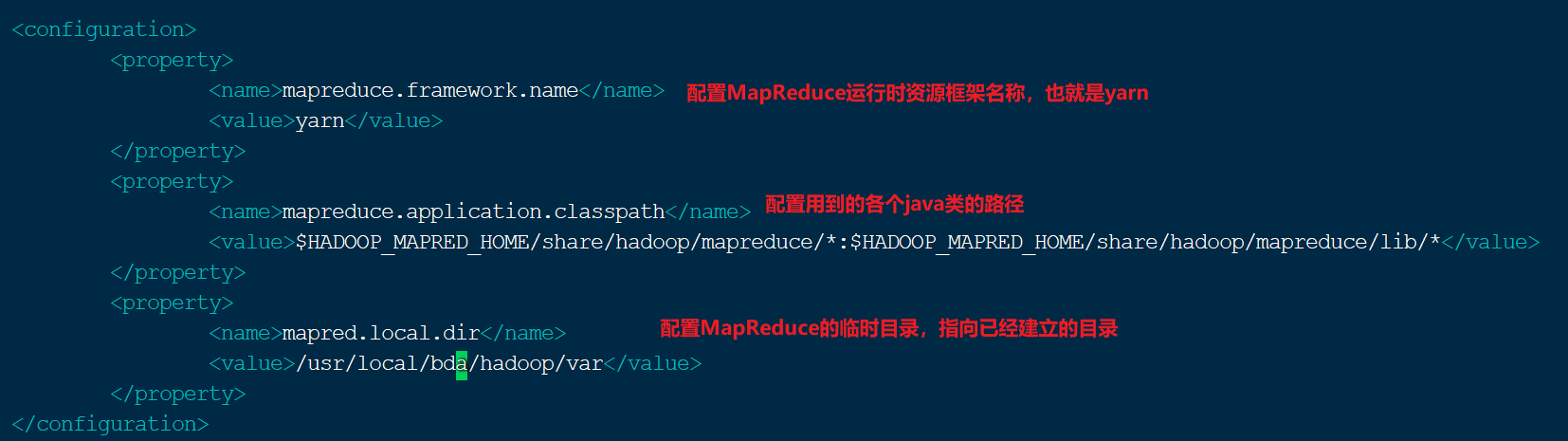

- 配置mapred-site.xml

首先,将mapred-site.xml的配置模板文件mapred-site.xml.template复制一份,并命名为mapred-site.xml

然后用vim打开进行编辑

vim /usr/local/bda/hadoop/etc/hadoop/mapred-site.xml

配置内容如下图所示,保存、退出

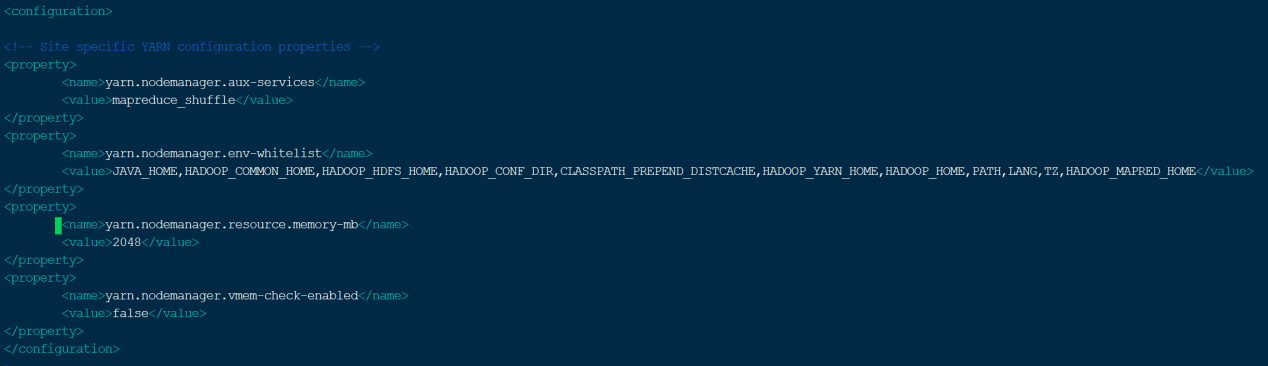

- 配置yarn-site.xml

vim /usr/local/bda/hadoop/etc/hadoop/yarn-site.xml

配置内容如下图所示,保存、退出

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_HOME,PATH,LANG,TZ,HADOOP_MAPRED_HOME</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

5.Hadoop环境的验证

5.1.HDFS文件系统格式化及服务启动、关闭

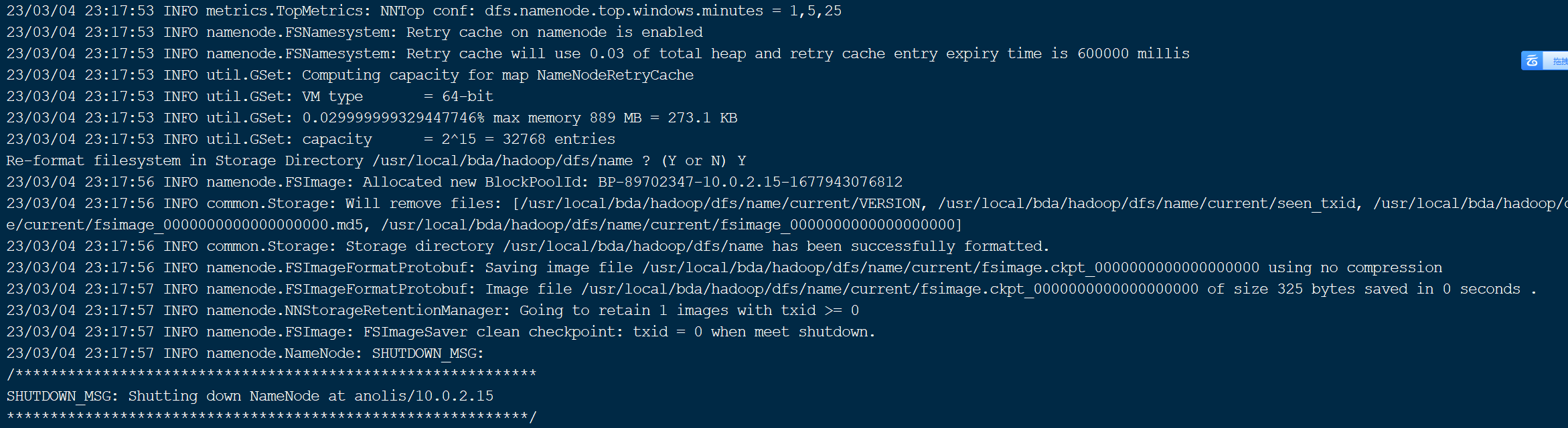

5.1.1. HDFS文件系统格式化

如同其它的文件系统一样,HDFS在使用之前也要先进行格式化操作,使用如下的命令进行:

/usr/local/bda/hadoop/bin/hdfs namenode -format

执行HDFS文件系统格式化命令后,会有较大的输出信息,可以检查是否有ERROR信息。

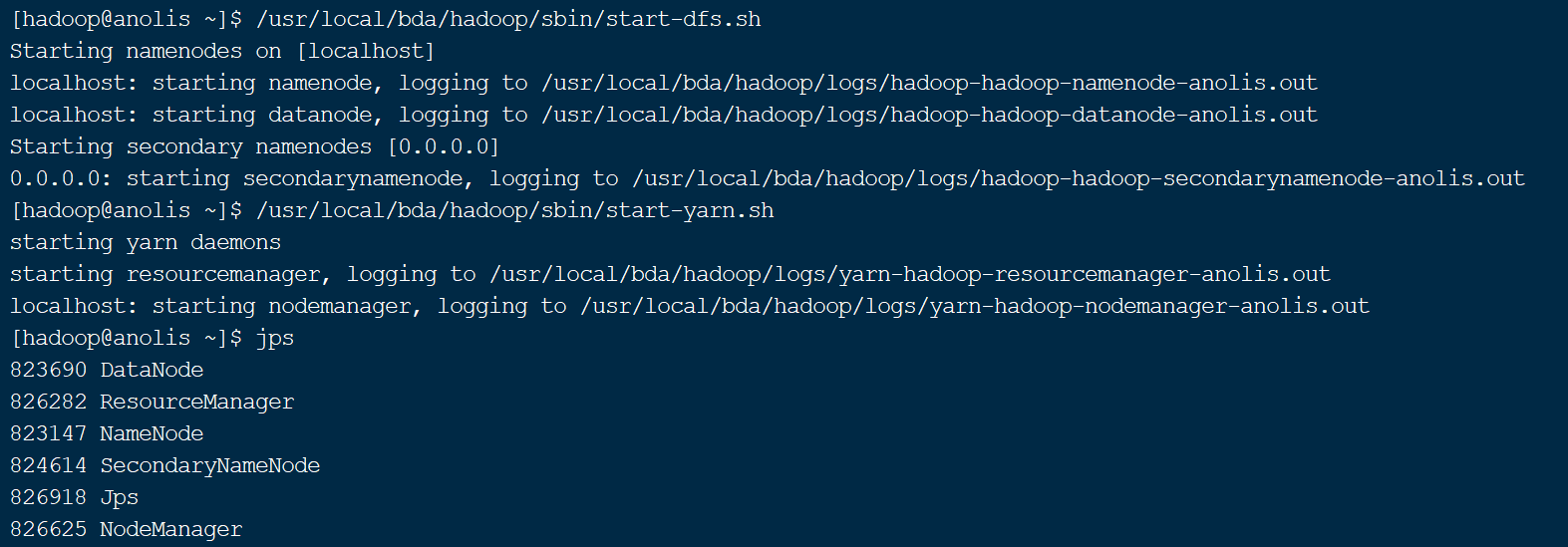

5.1.2. 启动HDFS服务及验证

(1) 输入如下命令,启动dfs服务

/usr/local/bda/hadoop/sbin/start-dfs.sh

需要注意的是首次启动时,需要输入yes。其后再次启动则无需输入。

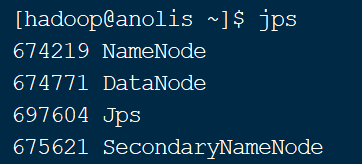

(2)输入 jps 命令,查看相关进程是否正常

jps命令的作用是查看当前系统中正在运行的java进程。如图15所示,执行完start-dfs.sh脚本后正常情况下有3个HDFS的进程,一个是NameNode进程,一个是DataNode进程,还有一个是SecondaryNameNode进程。除此之外还有jps进程自己。

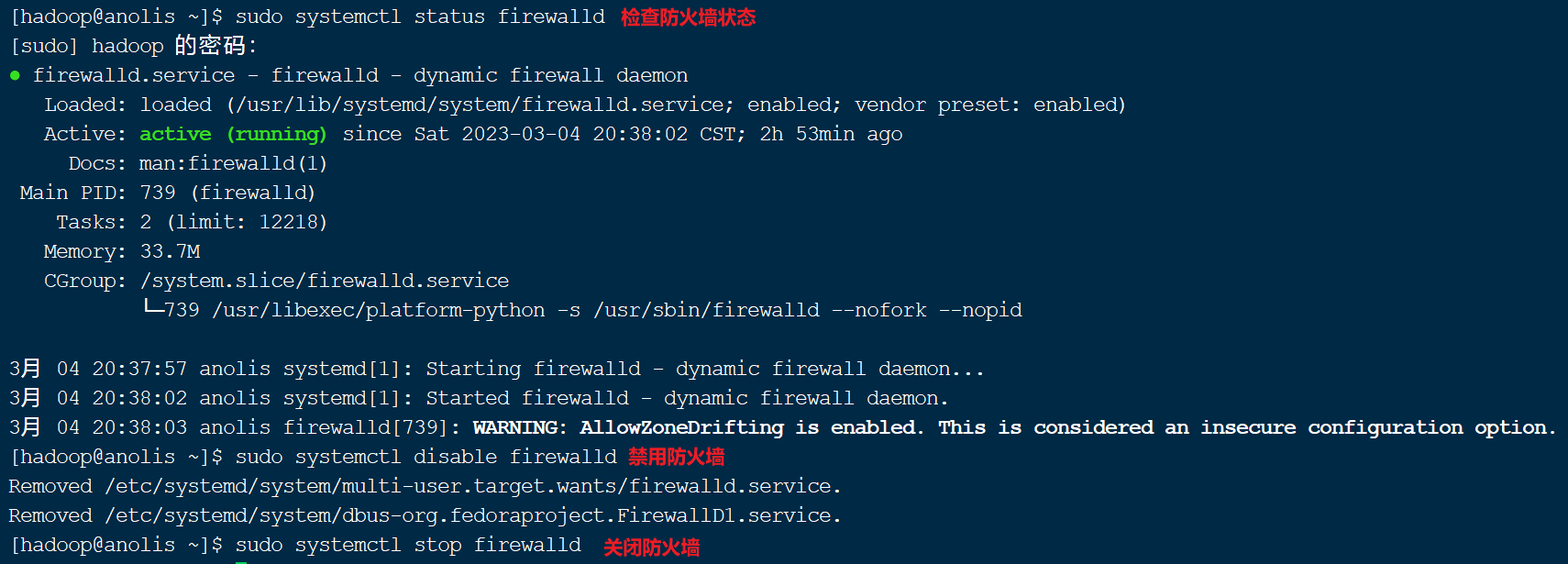

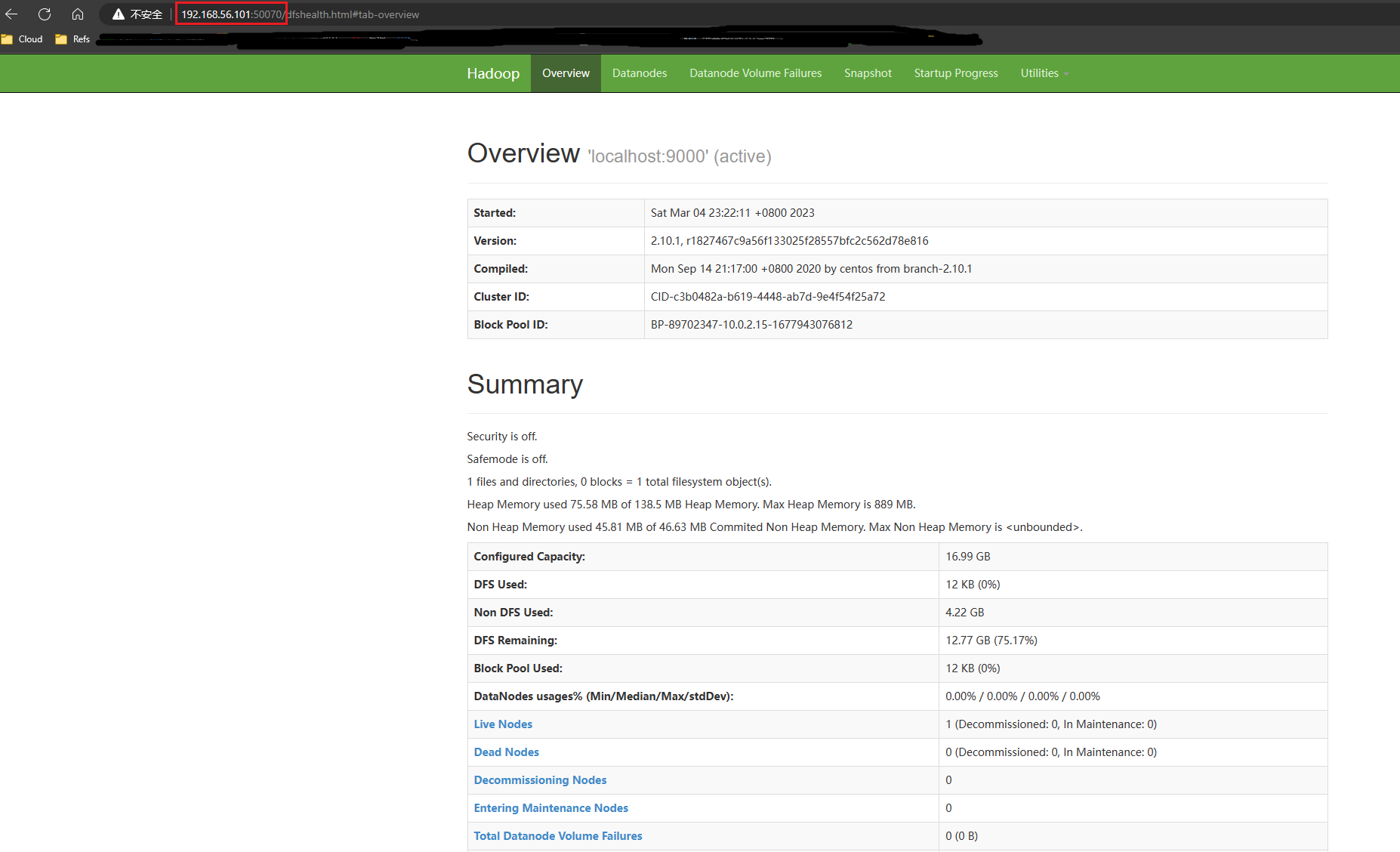

(3)访问hdfs的http服务端口

HDFS提供了http服务端口,可以通过浏览器访问,但是需要注意的是,为了访问该端口,需要在防火墙上打开该端口,或者直接关闭防火墙。

检查防火墙状态

sudo systemctl status firewalld

禁用防火墙

sudo systemctl status firewalld

关闭防火墙

sudo systemctl stop firewalld

关闭防火墙端口后,就可以在windows系统打开浏览器,地址栏中输入虚拟机的“小网IP”及HDFS的http服务端口(2.x版本是50070)

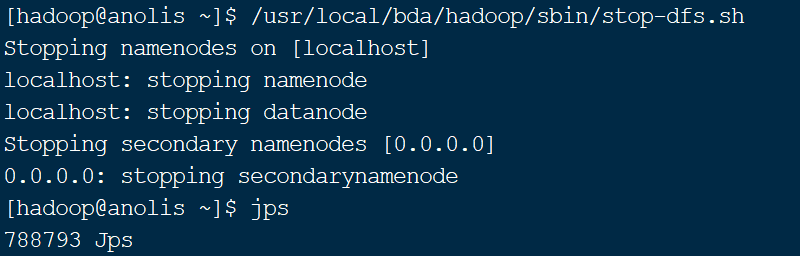

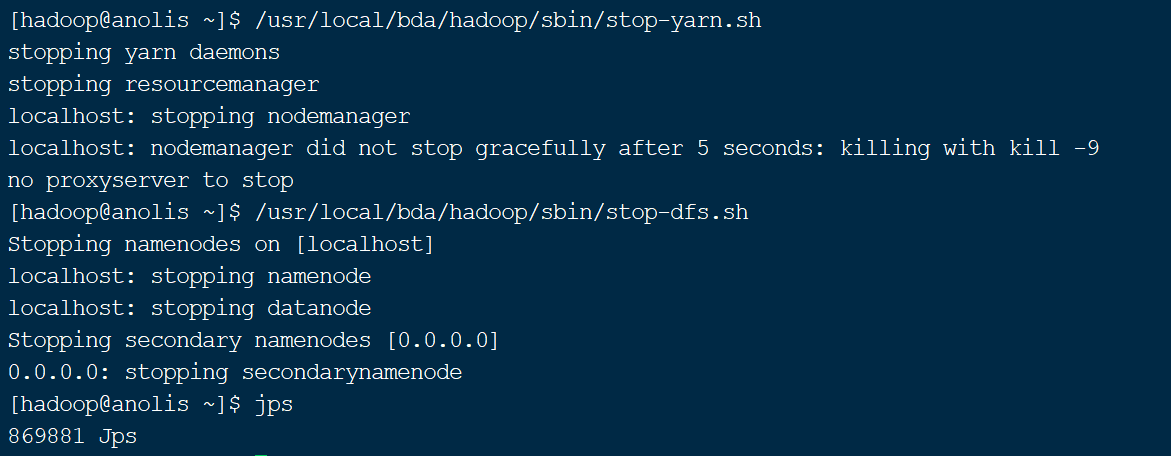

5.1.3. 停止HDFS服务

注意:在关闭服务器之前,一定要先使用stop-dfs.sh命令停止HDFS文件系统,如果不执行该命令,直接进行服务器的关机操作,则HDFS系统很容易受到损坏。

5.2.YARN服务启动及关闭

与HDFS类似,Hadoop提供了YARN服务的启动(start-yarn.sh)和关闭(stop-yarn.sh)命令。需要注意的是,YARN服务一般在HDFS服务启动后启动,并在HDFS服务关闭之前关闭。其执行顺序一般是:

start-dfs.sh →start-yarn.sh →stop-yarn.sh →stop-dfs.sh

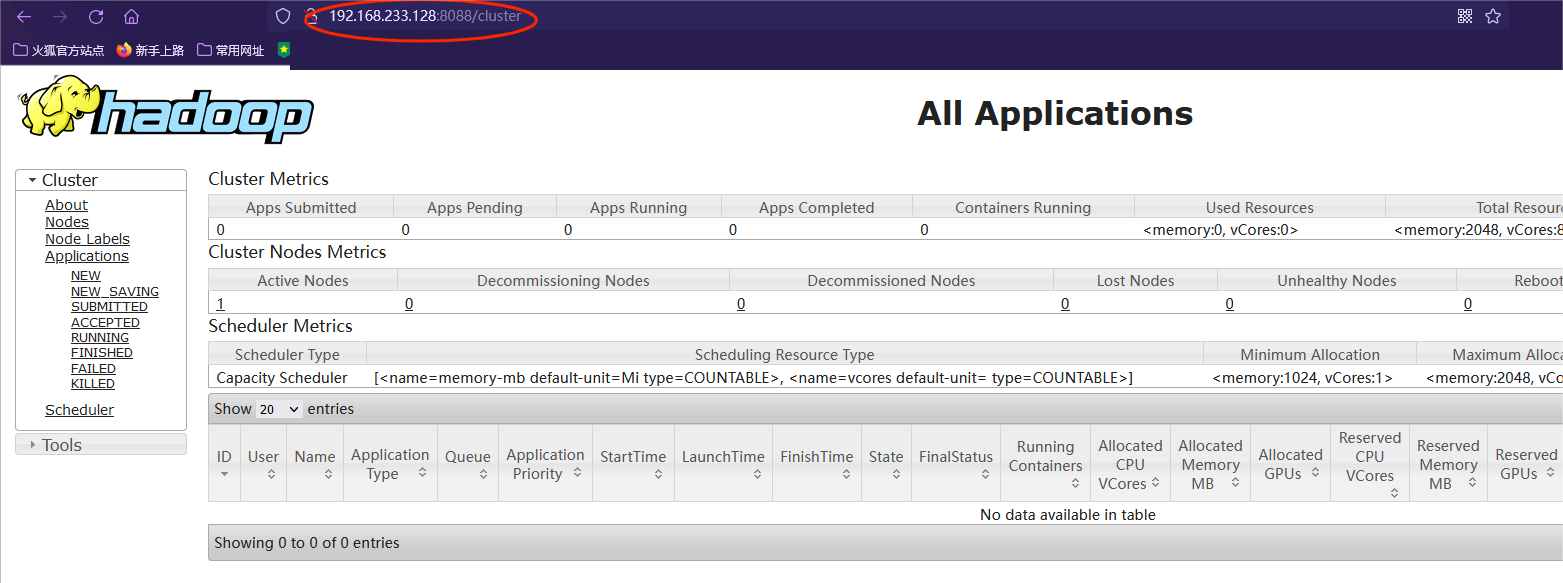

与HDFS类似,也可以通过浏览器输入服务器的小网IP+8088端口,访问YARN的http服务,查看在执行的计算任务及系统资源情况(需要打开防火墙端口,或者关闭防火墙)

(注:请各位大佬手下留情,有不足的地方请指出!!)

Hadoop环境安装与配置的更多相关文章

- hadoop环境安装及简单Map-Reduce示例

说明:这篇博客来自我的csdn博客,http://blog.csdn.net/lxxgreat/article/details/7753511 一.参考书:<hadoop权威指南--第二版(中文 ...

- hadoop的安装和配置(三)完全分布式模式

博主会用三篇文章为大家详细说明hadoop的三种模式: 本地模式 伪分布模式 完全分布模式 完全分布式模式: 前面已经说了本地模式和伪分布模式,这两种在hadoop的应用中并不用于实际,因为几乎没人会 ...

- Ubuntu下伪分布式模式Hadoop的安装及配置

1.Hadoop运行模式Hadoop有三种运行模式,分别如下:单机(非分布式)模式伪分布式(用不同进程模仿分布式运行中的各类节点)模式完全分布式模式注:前两种可以在单机运行,最后一种用于真实的集群环境 ...

- Hadoop(2)-CentOS下的jdk和hadoop的安装与配置

准备工作 下载jdk8和hadoop2.7.2 使用sftp的方式传到hadoop100上的/opt/software目录中 配置环境 如果安装虚拟机时选择了open java,请先卸载 rpm -q ...

- Linux中Hadoop的安装与配置

一.准备 1,配通网络 ping www.baidu.com 之前安装虚拟机时配过 2,关闭防火墙 systemctl stop firewalld systemctl disable firewal ...

- ubuntu在虚拟机下的安装 ~~~ Hadoop的安装及配置 ~~~ Hdfs中eclipse的安装

前言 Hadoop是基于Java语言开发的,具有很好跨平台的特性.Hadoop的所要求系统环境适用于Windows,Linux,Mac系统,我们推荐选择使用Linux或Mac系统.而Linux系统则 ...

- 【Cloud Computing】Hadoop环境安装、基本命令及MapReduce字数统计程序

[Cloud Computing]Hadoop环境安装.基本命令及MapReduce字数统计程序 1.虚拟机准备 1.1 模板机器配置 1.1.1 主机配置 IP地址:在学校校园网Wifi下连接下 V ...

- 第1章 开发环境安装和配置(二)安装JDK、SDK、NDK

原文 第1章 开发环境安装和配置(二)安装JDK.SDK.NDK 无论是用C#和VS2015开发Androd App还是用Java和Eclipse开发Androd App,都需要先安装JDK和Andr ...

- Nginx+Python+uwsgi+Django的web开发环境安装及配置

Nginx+Python+uwsgi+Django的web开发环境安装及配置 nginx安装 nginx的安装这里就略过了... python安装 通常系统已经自带了,这里也略过 uwsgi安装 官网 ...

- RabbitMQ消息队列之一:RabbitMQ的环境安装及配置

RabbitMQ简介: MQ全称为Message Queue, 消息队列(MQ)是一种应用程序对应用程序的通信方法.应用程序通过读写出入队列的消息(针对应用程序的数据)来通信,而无需专用连接来链接它们 ...

随机推荐

- c#优雅高效的读取字节数组——不安全代码(1)

在开发上位机的经历中,会有很多需要和下位机交互通信的场景,大多数都会定义一个和硬件的通信协议,最终在上位机代码中的形式其实就是符合通信协议的字节数组. 目录 场景 如何解析字节数组到类或结构体中 建立 ...

- SpringBoot开发简单接口流程

SpringBoot开发接口 初始化 新建项目 (1)使用 IDEA 的过程,新建Project,左侧选 Spring Initializr,点Next (2)选 8 版本,点Next (3)左侧选择 ...

- Spring配置动态数据库

前言 本文主要介绍使用spring boot 配置多个数据库,即动态数据库 开始搭建 首先创建一个SpringWeb项目--dynamicdb(spring-boot2.5.7) 然后引入相关依赖lo ...

- CANoe学习笔记(一):创建第一个仿真工程(基于CAN):点灯

目录 内容: ①创建两个节点,Switch和Light节点 ②创建两个Panel界面 ③capl代码实现Switch控制Light亮灭 事先准备: 养成良好的习惯,将不同文件放入不同文件夹,创建如下几 ...

- [ESP] 私有版Rainmaker User Mapping

[ESP] 私有版Rainmaker User Mapping 1. 设备烧录的程序esp-rainmaker/examples/gpio这个demo 我这里是自己的工程,可以参照 idf.py se ...

- GO通道:无缓冲通道与缓冲通道

转载请注明出处: 1.通道定义 在多个协程之间进行通信和管理,可以使用 Go 语言提供的通道(Channel)类型.通道是一种特殊的数据结构,可以在协程之间进行传递数据,从而实现协程之间的通信和同步. ...

- C#/.Net的多播委托到底是啥?彻底剖析下

前言 委托在.Net里面被托管代码封装了之后,看起来似乎有些复杂.但是实际上委托即是函数指针,而多播委托,即是函数指针链.本篇来只涉及底层的逻辑,慎入. 概括 1.示例代码 public delega ...

- Java 判断一个字符串是否是对称字符串 例如"abc"不是对称字符串,"aba"、"abba"、"aaa"、"mnanm"是对称字符串

代码如下: public static void main(String[] args) { String str = "1QabcdcbaQ"; StringBuilder sb ...

- 数据结构课后题答案 - XDU_953

参考书: 数据结构与算法分析(第二版) 作者:荣政 编 出版社:西安电子科技大学出版社 出版日期:2021年01月01日 答案解析:

- 【小小Demo】在线聊天小🌰子

easy-chat 一个简单的即时通讯demo. 环境 jdk1.8 idea maven springboot 2.1.1.RELEASE websocket 项目启动 修改maven设置 打开ID ...