Spark笔记之使用UDAF(User Defined Aggregate Function)

一、UDAF简介

先解释一下什么是UDAF(User Defined Aggregate Function),即用户定义的聚合函数,聚合函数和普通函数的区别是什么呢,普通函数是接受一行输入产生一个输出,聚合函数是接受一组(一般是多行)输入然后产生一个输出,即将一组的值想办法聚合一下。

关于UDAF的一个误区

我们可能下意识的认为UDAF是需要和group by一起使用的,实际上UDAF可以跟group by一起使用,也可以不跟group by一起使用,这个其实比较好理解,联想到mysql中的max、min等函数,可以:

select max(foo) from foobar group by bar;

表示根据bar字段分组,然后求每个分组的最大值,这时候的分组有很多个,使用这个函数对每个分组进行处理,也可以:

select max(foo) from foobar;

这种情况可以将整张表看做是一个分组,然后在这个分组(实际上就是一整张表)中求最大值。所以聚合函数实际上是对分组做处理,而不关心分组中记录的具体数量。

二、UDAF使用

2.1 继承UserDefinedAggregateFunction

使用UserDefinedAggregateFunction的套路:

1. 自定义类继承UserDefinedAggregateFunction,对每个阶段方法做实现

2. 在spark中注册UDAF,为其绑定一个名字

3. 然后就可以在sql语句中使用上面绑定的名字调用

下面写一个计算平均值的UDAF例子,首先定义一个类继承UserDefinedAggregateFunction:

package cc11001100.spark.sql.udaf import org.apache.spark.sql.Row

import org.apache.spark.sql.expressions.{MutableAggregationBuffer, UserDefinedAggregateFunction}

import org.apache.spark.sql.types._ object AverageUserDefinedAggregateFunction extends UserDefinedAggregateFunction { // 聚合函数的输入数据结构

override def inputSchema: StructType = StructType(StructField("input", LongType) :: Nil) // 缓存区数据结构

override def bufferSchema: StructType = StructType(StructField("sum", LongType) :: StructField("count", LongType) :: Nil) // 聚合函数返回值数据结构

override def dataType: DataType = DoubleType // 聚合函数是否是幂等的,即相同输入是否总是能得到相同输出

override def deterministic: Boolean = true // 初始化缓冲区

override def initialize(buffer: MutableAggregationBuffer): Unit = {

buffer(0) = 0L

buffer(1) = 0L

} // 给聚合函数传入一条新数据进行处理

override def update(buffer: MutableAggregationBuffer, input: Row): Unit = {

if (input.isNullAt(0)) return

buffer(0) = buffer.getLong(0) + input.getLong(0)

buffer(1) = buffer.getLong(1) + 1

} // 合并聚合函数缓冲区

override def merge(buffer1: MutableAggregationBuffer, buffer2: Row): Unit = {

buffer1(0) = buffer1.getLong(0) + buffer2.getLong(0)

buffer1(1) = buffer1.getLong(1) + buffer2.getLong(1)

} // 计算最终结果

override def evaluate(buffer: Row): Any = buffer.getLong(0).toDouble / buffer.getLong(1) }

然后注册并使用它:

package cc11001100.spark.sql.udaf

import org.apache.spark.sql.SparkSession

object SparkSqlUDAFDemo_001 {

def main(args: Array[String]): Unit = {

val spark = SparkSession.builder().master("local[*]").appName("SparkStudy").getOrCreate()

spark.read.json("data/user").createOrReplaceTempView("v_user")

spark.udf.register("u_avg", AverageUserDefinedAggregateFunction)

// 将整张表看做是一个分组对求所有人的平均年龄

spark.sql("select count(1) as count, u_avg(age) as avg_age from v_user").show()

// 按照性别分组求平均年龄

spark.sql("select sex, count(1) as count, u_avg(age) as avg_age from v_user group by sex").show()

}

}

使用到的数据集:

{"id": 1001, "name": "foo", "sex": "man", "age": 20}

{"id": 1002, "name": "bar", "sex": "man", "age": 24}

{"id": 1003, "name": "baz", "sex": "man", "age": 18}

{"id": 1004, "name": "foo1", "sex": "woman", "age": 17}

{"id": 1005, "name": "bar2", "sex": "woman", "age": 19}

{"id": 1006, "name": "baz3", "sex": "woman", "age": 20}

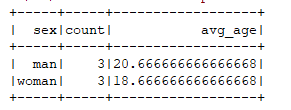

运行结果:

2.2 继承Aggregator

还有另一种方式就是继承Aggregator这个类,优点是可以带类型:

package cc11001100.spark.sql.udaf import org.apache.spark.sql.expressions.Aggregator

import org.apache.spark.sql.{Encoder, Encoders} /**

* 计算平均值

*

*/

object AverageAggregator extends Aggregator[User, Average, Double] { // 初始化buffer

override def zero: Average = Average(0L, 0L) // 处理一条新的记录

override def reduce(b: Average, a: User): Average = {

b.sum += a.age

b.count += 1L

b

} // 合并聚合buffer

override def merge(b1: Average, b2: Average): Average = {

b1.sum += b2.sum

b1.count += b2.count

b1

} // 减少中间数据传输

override def finish(reduction: Average): Double = reduction.sum.toDouble / reduction.count override def bufferEncoder: Encoder[Average] = Encoders.product // 最终输出结果的类型

override def outputEncoder: Encoder[Double] = Encoders.scalaDouble } /**

* 计算平均值过程中使用的Buffer

*

* @param sum

* @param count

*/

case class Average(var sum: Long, var count: Long) {

} case class User(id: Long, name: String, sex: String, age: Long) {

}

调用:

package cc11001100.spark.sql.udaf

import org.apache.spark.sql.SparkSession

object AverageAggregatorDemo_001 {

def main(args: Array[String]): Unit = {

val spark = SparkSession.builder().master("local[*]").appName("SparkStudy").getOrCreate()

import spark.implicits._

val user = spark.read.json("data/user").as[User]

user.select(AverageAggregator.toColumn.name("avg")).show()

}

}

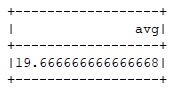

运行结果:

.

Spark笔记之使用UDAF(User Defined Aggregate Function)的更多相关文章

- 转:Spark User Defined Aggregate Function (UDAF) using Java

Sometimes the aggregate functions provided by Spark are not adequate, so Spark has a provision of ac ...

- Spark笔记之使用UDF(User Define Function)

一.UDF介绍 UDF(User Define Function),即用户自定义函数,Spark的官方文档中没有对UDF做过多介绍,猜想可能是认为比较简单吧. 几乎所有sql数据库的实现都为用户提供了 ...

- spark自定义函数之——UDAF使用详解及代码示例

UDAF简介 UDAF(User Defined Aggregate Function)即用户定义的聚合函数,聚合函数和普通函数的区别是什么呢,普通函数是接受一行输入产生一个输出,聚合函数是接受一组( ...

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十五)Spark编写UDF、UDAF、Agg函数

Spark Sql提供了丰富的内置函数让开发者来使用,但实际开发业务场景可能很复杂,内置函数不能够满足业务需求,因此spark sql提供了可扩展的内置函数. UDF:是普通函数,输入一个或多个参数, ...

- spark笔记 环境配置

spark笔记 spark简介 saprk 有六个核心组件: SparkCore.SparkSQL.SparkStreaming.StructedStreaming.MLlib,Graphx Spar ...

- Hadoop生态圈-Hive的自定义函数之UDAF(User-Defined Aggregation Function)

Hadoop生态圈-Hive的自定义函数之UDAF(User-Defined Aggregation Function) 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任.

- 【理解】column must appear in the GROUP BY clause or be used in an aggregate function

column "ms.xxx_time" must appear in the GROUP BY clause or be used in an aggregate functio ...

- invalid in the select list because it is not contained in either an aggregate function or the GROUP BY clause

Column 'dbo.tbm_vie_View.ViewID' is invalid in the select list because it is not contained in either ...

- must appear in the GROUP BY clause or be used in an aggregate function

今天在分组统计的时候pgsql报错 must appear in the GROUP BY clause or be used in an aggregate function,在mysql里面是可以 ...

随机推荐

- python3【基础】-赋值与深浅拷贝

一.Python的变量及其存储 在高级语言中,变量是对内存及其地址的抽象.对于python而言,python的一切变量都是对象,变量的存储,采用了引用语义的方式,存储的只是一个变量的值所在的内存地址, ...

- #Leetcode# 373. Find K Pairs with Smallest Sums

https://leetcode.com/problems/find-k-pairs-with-smallest-sums/ You are given two integer arrays nums ...

- JwtUtils 工具类

/** * jwt工具类 */ public class JwtUtils { public static final String SUBJECT = "onehee"; *** ...

- Docker(二)-Docker安装

官方文档:https://docs.docker.com/ Docker 支持多平台的安装(Linux/Windows/OS X). 因为Docker原生支持Linux,所以,可以直接在Linux上运 ...

- 设置close

- Python之路:Python操作 RabbitMQ、Redis、Memcache、SQLAlchemy

Memcached Memcached 是一个高性能的分布式内存对象缓存系统,用于动态Web应用以减轻数据库负载.它通过在内存中缓存数据和对象来减少读取数据库的次数,从而提高动态.数据库驱动网站的速度 ...

- 学习Spring Boot:(十一) 自定义装配参数

前言 SpringMVC 中 Controller 中方法的参数非常灵活,得益于它的强大自动装配,这次将根据上次遗留下的问题,将研究下装配参数. 正文 SpringMVC中使用了两个接口来处理参数: ...

- 【bzoj4012】 HNOI2015—开店

http://www.lydsy.com/JudgeOnline/problem.php?id=4012 (题目链接) 题意 一棵树,每条边有正边权,每个点的点权非负.若干组询问,强制在线,每次查询点 ...

- alpine编译安装tengine,并使用supervisor启动

Alpine是一个小型的linux系统,官方docker镜像只有不到5MB,非常适合作为容器镜像. Alpine Linux is a security-oriented, lightweight L ...

- 使用highlight.js高亮静态页面的语言代码

显示静态的代码其实html的pre标签基本可以满足需求了,至少不会将换行的文本显示成一堆字符串. 不过能使静态的文本能高亮显示,倒更炫酷一点.其实很简单的,引入highlight.js包,可以使用cd ...