Hadoop的SecondaryNameNode的作用是什么?

- 为节省篇幅,将SecondaryNameNode简称SNN,NameNode简称NN。

NN与fsimage、edits文件

NN负责管理HDFS中所有的元数据,包括但不限于文件/目录结构、文件权限、块ID/大小/数量、副本策略等等。客户端执行读写操作前,先从NN获得元数据。当NN在运行时,元数据都是保存在内存中,以保证响应时间。

显然,元数据只保留在内存中是非常不可靠的,所以也需要持久化到磁盘。NN内部有两类文件用于持久化元数据:

fsimage文件(镜像文件),以fsimage_为前缀,是序列化存储的元数据的整体快照;

edits文件(又称edit log),以edits_为前缀,是顺序存储的元数据的增量修改(即客户端写入操作)日志。

这两类文件均存储在${dfs.namenode.name.dir}/current/路径下,如下所示。

[root@master current]# pwd

/usr/local/src/hadoop-2.6.1/dfs/name/current

[root@master current]# ls -l

total 1040

-rw-r--r-- 1 root root 1048576 Aug 18 02:07 edits_inprogress_0000000000000000001

-rw-r--r-- 1 root root 351 Aug 18 01:59 fsimage_0000000000000000000

-rw-r--r-- 1 root root 62 Aug 18 01:59 fsimage_0000000000000000000.md5

-rw-r--r-- 1 root root 2 Aug 18 02:00 seen_txid

-rw-r--r-- 1 root root 206 Aug 18 01:59 VERSION

可见,当前正在写入的edits文件名会有"inprogress"标识,而seen_txid文件保存的就是当前正在写入的edits文件的ID。

在任意时刻,最近的fsimage和edits文件的内容加起来就是全量元数据。NN在启动时,就会将最近的fsimage文件加载到内存,并重放它之后记录的edits文件,恢复元数据的现场。

SNN与checkpoint过程

为了避免edits文件过大,以及缩短NN启动时恢复元数据的时间,我们需要定期地将edits文件合并到fsimage文件,该合并过程叫做checkpoint(这个词是真正被用烂了哈)。

由于NN的负担已经比较重,再让它来进行I/O密集型的文件合并操作就不太科学了,所以Hadoop引入了SNN负责这件事。也就是说,SNN是辅助NN进行checkpoint操作的角色。

checkpoint的触发由hdfs-site.xml中的两个参数来控制。

dfs.namenode.checkpoint.period:触发checkpoint的周期长度,默认为1小时。

dfs.namenode.checkpoint.txns:两次checkpoint之间最大允许进行的操作数,默认为100万。

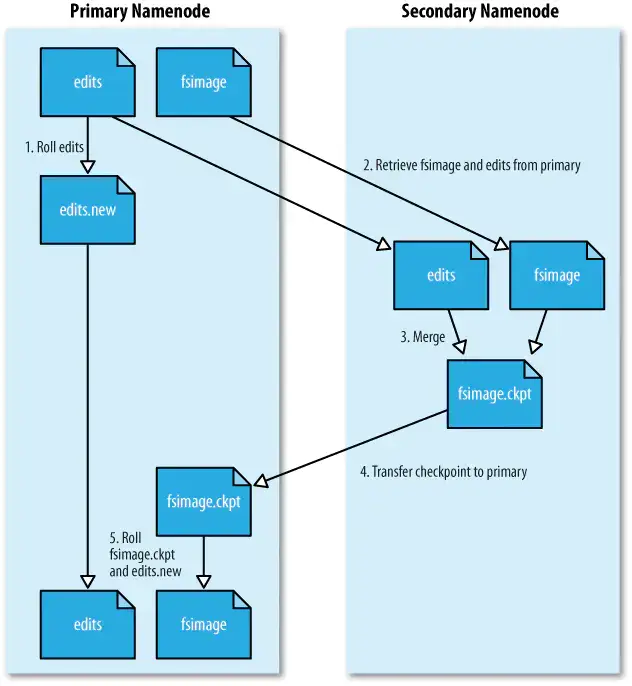

只要满足上述两个参数的条件之一,就会触发checkpoint过程,叙述如下:

NN生成新的edits_inprogress文件,后续的修改日志将写入该文件中,之前正在写的edits文件即为待合并状态。

将待合并的edits文件和fsimage文件一起复制到SNN本地。

SNN像NN启动时一样,将fsimage文件加载到内存,并重放edits文件进行合并。生成合并结果为fsimage.chkpoint文件。

SNN将fsimage.chkpoint复制回NN,并重命名为正式的fsimage文件名。

Hadoop官方给出的图示如下。虽然文件名称不同,但思想是一样的。

如果开启了NN高可用呢?

上面说的都是集群只有一个NN的情况。如果有两个NN并且开启了HA的话,SNN就没用了——checkpoint过程会直接交给Standby NN来负责。Active NN会将edits文件同时写到本地与共享存储(QJM方案就是JournalNode集群)上去,Standby NN从JournalNode集群拉取edits文件进行合并,并保持fsimage文件与Active NN的同步。

Hadoop的SecondaryNameNode的作用是什么?的更多相关文章

- hadoop各个类及其作用

1.基础包(包括工具包和安全包) 包括工具和安全包.其中,hdfs.util包含了一些HDFS实现需要的辅助数据结构:hdfs.security.token.block和hdfs.security.t ...

- SecondaryNameNode 的作用

Secondary NameNode:它究竟有什么作用? 尽量不要将 secondarynamede 和 namenode 放在同一台机器上. 1. NameNode NameNode 主要是用来保存 ...

- hadoop 根据SecondaryNameNode恢复Namenode

1.修改conf/core-site.xml 增加 <property> <name>fs.checkpoint.period</name> <value&g ...

- Hadoop守护进程的作用(转)

概述: <ignore_js_op> Hadoop是一个能够对大量数据进行分布式处理的软件框架,实现了Google的MapReduce编程模型和框架,能够把应用程序分割成许多的 小的工作单 ...

- Hadoop中Combiner的作用

1.Partition 把 Map任务输出的中间结果按 key的范围划分成 R份( R是预先定义的 Reduce任务的个数),划分时通常使用hash函数如: hash(key) mod R,这样可以保 ...

- Hadoop SecondaryNameNode备份及恢复

1.同步各个服务器时间 yum install ntp ntpdate ntp.fudan.edu.cn hdfs-site.xml配置 如果没有配置这一项,hadoop默认是0.0.0.0:5009 ...

- Hadoop集群datanode死掉或者secondarynamenode进程消失处理办法

当Hadoop集群的某单个节点出现问题时,一般不必重启整个系统,只须重启这个节点,它会自动连入整个集群. 在坏死的节点上输入如下命令即可: hadoop-daemon.sh start datanod ...

- Hadoop(9)-HDFS的NameNode和SecondaryNameNode详解

1.NN和2NN工作机制 首先,我们做个假设,如果存储在NameNode节点的磁盘中,因为经常需要进行随机访问,还有响应客户请求,必然是效率过低.因此,元数据需要存放在内存中.但如果只存在内存中,一旦 ...

- hadoop面试100道收集(带答案)

1.列出安装Hadoop流程步骤 a) 创建hadoop账号 b) 更改ip c) 安装Java 更改/etc/profile 配置环境变量 d) 修改host文件域名 e) 安装ssh 配置无密码登 ...

随机推荐

- Day15_阿里短信

学于黑马和传智播客联合做的教学项目 感谢 黑马官网 传智播客官网 微信搜索"艺术行者",关注并回复关键词"乐优商城"获取视频和教程资料! b站在线视频 1.开通 ...

- PHP popen() 函数

定义和用法 popen() 函数使用 command 参数打开进程文件指针. 如果出错,该函数返回 FALSE. 语法 popen(command,mode) 参数 描述 command 必需.规定要 ...

- luogu P4726 【模板】多项式指数函数 多项式 exp 牛顿迭代 泰勒展开

LINK:多项式 exp 做多项式的题 简直在嗑药. 前置只是 泰勒展开 这个东西用于 对于一个函数f(x) 我们不好得到 其在x处的取值. 所以另外设一个函数g(x) 来在x点处无限逼近f(x). ...

- spring的IOC(反转控制)

Spring概念 1.1.1 spring 是什么 Spring 是分层的 Java SE/EE 应用 full-stack 轻量级开源框架,以 IoC(Inverse Of Control:反转控制 ...

- “随手记”开发记录day12

就我们团队昨天的讨论,今天进行更改. 今天我们先简单的更改了之前的粉色背景图,因为用户反应总览界面的“总览”二字,是深粉色背景不太美观.进过多次更改之后使颜色变得更舒适.

- Linux学习笔记之配置网络

1.打开VMware Workstation虚拟机 2.在VMware下安装虚拟ubunt系统后配置网络,如图所示配置,即可. 3.检查笔记本所使用的网段 ①按 “win + R ”键,并输入“cmd ...

- 《SOD框架企业级应用数据架构实战》新书简介和预定

SOD框架“企业级”应用数据架构实战 ----致敬平凡的程序员! 历时两年写成, 两大MVP: 张善友. 刘冰(宇内流云) JAVA技术专家 申毅 联合推荐! 10年磨一剑:汇聚作者超过10年的架构工 ...

- C#LeetCode刷题之#447-回旋镖的数量(Number of Boomerangs)

问题 该文章的最新版本已迁移至个人博客[比特飞],单击链接 https://www.byteflying.com/archives/3792 访问. 给定平面上 n 对不同的点,"回旋镖&q ...

- [C/C++]快速读入代码(快读)

快读 1.为什么要有快读 好吧,有些题目看上去十分简单,例如https://www.luogu.com.cn/problem/P4305这道题,实际上数据量巨多,光是一个测试点就可能有几个MB,在这种 ...

- Shiro+SpringBoot认证

该博客以Web为基础 一.引入依赖 shiro-all包含shiro所有的包.shiro-core是核心包.shiro-web是与web整合.shiro-spring是与spring整合.shiro- ...