Hadoop-2.4.1 ubuntu集群安装配置教程

一.环境

系统: Ubuntu 14.04 32bit

Hadoop版本: Hadoop 2.4.1 (stable)

JDK版本: 1.7

集群数量:3台

注意事项:我们从Apache官方网站下载的Hadoop2.4.1是linux32位系统可执行文件,所以如果需要在64位系统上部署则需要单独下载src 源码自行编译。

二.准备工作

(三台机器都需要进行以下前四步配置)

1.安装ubuntu14.04 32bits

2.创建新用户hadoop并增加管理员权限

输入如下命令(整个hadoop配置最好切换到root权限进行,在ubuntu下使用root必须给root设置密码才可使用:sudo passwd root):

root@ubuntu:~# sudo adduser hadoop

按照提示输入信息,密码设置为hadoop,回车确定。结束之后系统会自动创建用户主目录,创建用户同名的组。(adduser命令包装了useradd,虽然在别的linux系统下两个命令一样,但在ubuntu下使用useradd时,并没有创建同名的用户主目录。)

让该用户获得管理员权限:

hadoop@ubuntu:~# sudo vim /etc/sudoers

修改文件如下:

# User privilege specification

root ALL=(ALL) ALL

hadoop ALL=(ALL) ALL

保存退出,hadoop用户就拥有了root权限。

3.安装jdk(安装完之后用java -version查看jdk版本)

已经下载好java安装包,根据安装教程进行安装

4.修改机器网络配置

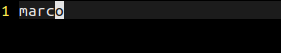

修改机器的hostname为Master,Slave1,Slave2(对应三台机器):

hadoop@ubuntu:~# sudo vim /etc/hostname

(marco对应为Master,Slave1,Slave2)

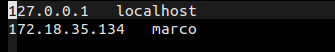

三台机器的IP必须固定。修改hosts文件。

hadoop@ubuntu:~# sudo vim /etc/hosts

添加字段:IP hostname

(marco对应为Master,Slave1,Slave2)

完成后重启机器,然后在终端可以看到hostname的变化。

(配置完之后可以互相ping主机名测试是否配置成功)

5.配置SSH无密码登陆

安装ssh(如果系统没有默认安装或者版本过旧使用以下命令,确保三台机器都有ssh服务)

hadoop@Master:~# sudo apt-get install ssh

生成Master的公钥:

hadoop@Master:~# cd ~/.ssh

hadoop@Master:~# ssh-keygen -t rsa # 一直按回车就可以,生成的密钥保存为.ssh/id_rsa

Master 节点需能无密码 ssh 本机,这一步还是在 Master 节点上执行:

hadoop@Master:~# cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

(完成后可以用ssh Master验证)

接着将公匙传输到 Slave1(Slave2) 节点:

hadoop@Master:~# scp ~/.ssh/id_rsa.pub hadoop@Slave1:/home/hadoop/

然后在Slave1节点上将ssh公钥保存到相应位置:

hadoop@Slave1:~# cat ~/id_rsa.pub >> ~/.ssh/authorized_keys

最后在Master节点就可以无密码ssh到Slave1(Slave2)了。

三.配置集群/分布式环境

1.下载并解压hadoop-2.4.1.tar.gz文件在/home/hadoop目录下。(在Master下配置,之后再将配置传输到slave节点)

2.修改文件slaves

hadoop@Master:~# cd /home/hadoop/etc/hadoop/

hadoop@Master:~# vim slaves

将原来 localhost 删除,把所有Slave的主机名写上,每行一个。如下:

Slave1

Slave2

3.修改文件core-site.xml

将原来的如下内容

<property>

</property>

改为下面的配置。后面的配置文件的修改类似。

<property>

<name>fs.defaultFS</name>

<value>hdfs://Master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/home/hadoop/hadoopInfo/tmp</value>

</property>

(如果启动服务时找不到hadoopInfo/tmp,需手动在三台机器创建该目录)

4.修改hdfs-site.xml

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/home/hadoop/hadoopInfo/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/home/hadoop/hadoopInfo/tmp/dfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

5.修改文件mapred-site.xml,这个文件不存在,首先需要从模板中复制一份:

hadoop@Master:~# cp mapred-site.xml.template mapred-site.xml

然后配置修改如下:

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

6.修改文件yarn-site.xml:

<property>

<name>yarn.resourcemanager.hostname</name>

<value>Master</value>

</property>

7.配置好后,将 Master 上的 Hadoop 文件复制到各个节点上(虽然直接采用 scp 复制也可以正确运行,但会有所不同,如符号链接 scp 过去后就有点不一样了。所以先打包再复制比较稳妥)。

hadoop@Master:~# cd /home/hadoop

hadoop@Master:~# sudo tar -zcf ./hadoop-2.4.1.tar.gz ./hadoop-2.4.1

hadoop@Master:~# scp ./hadoop-2.4.1.tar.gz Slave1:/home/hadoop

在Slave1(Slave2)上执行:

hadoop@Slave1:~# sudo tar -zxf ~/hadoop-2.4.1.tar.gz

hadoop@Slave1:~# sudo chown -R hadoop:hadoop /home/hadoop

注意事项:切换 Hadoop 的模式,不管是从集群切换到伪分布式,还是从伪分布式切换到集群,如果遇到无法正常启动的情况,可以删除所涉及节点的临时文件夹,这样虽然之前的数据会被删掉,但能保证集群正确启动。或者可以为集群模式和伪分布式模式设置不同的临时文件夹(未验证)。所以如果集群以前能启动,但后来启动不了,特别是 DataNode 无法启动,不妨试着删除所有节点(包括 Slave 节点)上的 tmp 文件夹,重新执行一次 bin/hdfs namenode -format,再次启动试试。

8.然后在Master节点上就可以启动hadoop了。

hadoop@Master:~# cd /home/hadoop/hadoop-2.4.1

hadoop@Master:~# bin/hdfs namenode -format # 首次运行需要执行初始化,后面不再需要

hadoop@Master:~# sbin/start-dfs.sh

hadoop@Master:~# sbin/start-yarn.sh

通过命令JPS可以查看各个节点所启动的过程。

可以看到Master节点启动了NameNode、SecondrryNameNode、ResourceManager进程。

Slave节点则启动了DataNode和NodeManager进程。

可以通过http://master:50070/进入hadoop的管理界面。

关闭Hadoop集群也是在Master节点上执行:

hadoop@Master:~# sbin/stop-dfs.sh

hadoop@Master:~# sbin/stop-yarn.sh

四.应用案例:

在官网上有一个hadoop单节点和集群的hadoop job示例,

http://hadoop.apache.org/docs/r1.2.1/mapred_tutorial.html

根据链接里的 Example: WordCount v2.0 部分进行操作

Hadoop-2.4.1 ubuntu集群安装配置教程的更多相关文章

- Hadoop集群安装配置教程_Hadoop2.6.0_Ubuntu/CentOS

摘自:http://www.powerxing.com/install-hadoop-cluster/ 本教程讲述如何配置 Hadoop 集群,默认读者已经掌握了 Hadoop 的单机伪分布式配置,否 ...

- Ubuntu 14.04下Hadoop2.4.1集群安装配置教程

一.环境 系统: Ubuntu 14.04 64bit Hadoop版本: hadoop 2.4.1 (stable) JDK版本: OpenJDK 7 台作为Master,另3台作为Slave. 所 ...

- Hadoop 2.6.1 集群安装配置教程

集群环境: 192.168.56.10 master 192.168.56.11 slave1 192.168.56.12 slave2 下载安装包/拷贝安装包 # 存放路径: cd /usr/loc ...

- Redis3.0.7 cluster/集群 安装配置教程

1.前言 环境:CentOS-6.7-i386-LiveDVD 安装的CentOs系统 节点: 6个节点,3个主节点.3个从节点(由于redis默认需要3个主节点,如果想每个主节点有一个从节点,这是最 ...

- 菜鸟玩云计算之十八:Hadoop 2.5.0 HA 集群安装第1章

菜鸟玩云计算之十八:Hadoop 2.5.0 HA 集群安装第1章 cheungmine, 2014-10-25 0 引言 在生产环境上安装Hadoop高可用集群一直是一个需要极度耐心和体力的细致工作 ...

- 集群安装配置Hadoop具体图解

集群安装配置Hadoop 集群节点:node4.node5.node6.node7.node8. 详细架构: node4 Namenode,secondnamenode,jobtracker node ...

- 菜鸟玩云计算之十九:Hadoop 2.5.0 HA 集群安装第2章

菜鸟玩云计算之十九:Hadoop 2.5.0 HA 集群安装第2章 cheungmine, 2014-10-26 在上一章中,我们准备好了计算机和软件.本章开始部署hadoop 高可用集群. 2 部署 ...

- spark集群安装配置

spark集群安装配置 一. Spark简介 Spark是一个通用的并行计算框架,由UCBerkeley的AMP实验室开发.Spark基于map reduce 算法模式实现的分布式计算,拥有Hadoo ...

- CentOS下Hadoop-2.2.0集群安装配置

对于一个刚开始学习Spark的人来说,当然首先需要把环境搭建好,再跑几个例子,目前比较流行的部署是Spark On Yarn,作为新手,我觉得有必要走一遍Hadoop的集群安装配置,而不仅仅停留在本地 ...

随机推荐

- 【AnjularJS系列前篇 】 适用场景

AngularJS是一个 MV* 框架,最适于开发客户端的单页面应用.它不是个功能库,而是用来开发动态网页的框架. 它专注于扩展HTML的功能,提供动态数据绑定(data binding),而且它能跟 ...

- Java以流的方式将指定文件夹里的.txt文件全部复制到另一文件夹,并删除原文件夹中所有.txt文件

import java.io.BufferedReader; import java.io.BufferedWriter; import java.io.File; import java.io.Fi ...

- luogu p1004

P1004 题意 类似一个比较小的方格(N<=9),有的点是0,有的点有数, A->B的路径经过的点加上该点代表的数,求两次A->B的最大解(最优解) 一个令人恼的问题是两条路径如果 ...

- 用 JavaScript 实现简单拼图游戏

本篇主要讲解,如何利用原生的 JavaScript 来实现一个简单的拼图小游戏. 线上体验地址:拼图 一.游戏的基础逻辑 想用一门语言来开发游戏,必须先了解如何使用这门语言来实现一些基础逻辑,比如图像 ...

- [Hibernate]Access to DialectResolutionInfo cannot be null when 'hibernate.dialect' not set

使用Hibernate官方文档上的下面代码进行測试时报出这个异常. org.hibernate.HibernateException: Access to DialectResolutionInfo ...

- 配置 Phpstorm + Xdebug + xampp

配置 Phpstorm + Xdebug + xampp 1 Xampp 安装好xampp,配置 httpd.conf 在xampp面板中 单击后会出现一些配置文件,httpd.conf位于第一个 将 ...

- 试用友盟SDK实现Android分享微信朋友圈

社会化分享是眼下必学且火热的功能.之前有写第三方登录,那仅仅是社会化分享的一部分.今天来玩玩分享微信朋友圈. 为了方便操作,还是依照步骤写. 一,注冊 注冊应用已经在这里具体说明过了,这里就不多提了. ...

- WinForm容器内控件批量效验是否同意为空?设置是否仅仅读?设置是否可用等方法分享

WinForm容器内控件批量效验是否同意为空?设置是否仅仅读?设置是否可用等方法分享 在WinForm程序中,我们有时须要对某容器内的全部控件做批量操作.如批量推断是否同意为空?批量设置为仅仅读.批量 ...

- Non-ASCII character '\xe8' in file xxx.py on line 8, but no encoding declared

使用网上某个python程序.编译时报错: File "xxx.py", line 8 SyntaxError: Non-ASCII character '\xe8 ...

- $(window).load(function(){})跟$(document).ready(function(){})跟$(function(){})区别

1.页面DOM加载完成 2.$(document).ready(function(){}) 的简写是 $(function(){}) 执行 3.图片样式等所有HTML元素加载完毕 4.$(windo ...