selenium异步爬取(selenium+Chromedriver)

在我们进行数据爬去的过程中,我们有时候会遇到异步加载信息的情况,以豆瓣电影分来排行榜为例,当我们在查看数据的过程中,会发现网页源码中并不包含我们想要的全部数据,但是当我们在进行向下滚动的时候,数据会一点点的加载出来,这就说明它是通过异步加载模式展示出的数据。在urllib3中,支持的也仅仅是当前的HTML页面,所以,我们要使用异步加载模式进行数据的获取。

在这个时候,我们一般会采用以下两种方法来进行数据的加载:一种是模拟浏览器进行页面访问(selenium),另外一种是进行更深层次的HTTP请求访问分析,同时再利用分析加载出的路径进行异步数据加载。

selenium下载

selenium是一个利用模拟浏览器进行调用的的模块,他可以直接通过一些特定支持的主流浏览器进行本地浏览器的数据驱动执行,而后会模拟浏览器进行数据加载,通过网页分析后获取到我们需要的所有数据。

Windows下下载selenium,使用 pip install selenium 即可

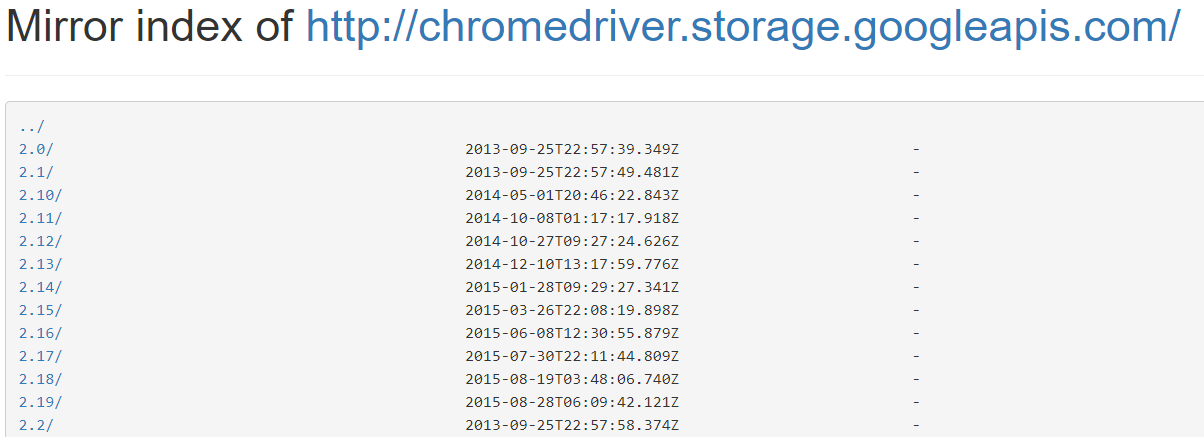

Chromedriver下载

Chromedriver是基于Google的一个独立服务器,它实现了W3C标准的webdriver。

要想进行在Google浏览器上模拟数据的加载,那就必须下载这个工具。下载Chromedriver之前,我们需要知道我们的Google浏览器的版本是什么,注意,一定要与自己的版本相匹配,否则会出错,例如,使用 79.0.3945.29的Google浏览器,就要下载版本为79开头的Chromedriver驱动。

下载Chromedriver国内地址:http://npm.taobao.org/mirrors/chromedriver/ 找到对应版本的Chromedriver,下载后解压。

如果没有查询到自己的版本,那就需要进入Chromedriver官网进行下载, 对于不能进行Google访问的,可以下载谷歌访问助手,按照教程安装即可。

selenium异步爬取

(1)创建项目,命名为selenium_demo,将下载到的Chromedriver拷贝到工作区中(或者放置在我们能够明确知道路径的位置中)。

(2)创建python文件,命名为t1.py,将以下代码复制其中。

1 '''

2 @Description: selenium异步爬取

3 @Version: 1.0

4 @Autor: Montoin Yan

5 @Date: 2020-02-06 20:43:01

6 @LastEditors : Montoin Yan

7 @LastEditTime : 2020-02-08 21:55:48

8 '''

9

10 import selenium,selenium.webdriver

11 import time #追加延迟处理,防止在爬取过程中被封

12 import re

13

14 URL = 'https://movie.douban.com/typerank?type_name=剧情&type=11&interval_id=100:90&action=' #设置网页的根路径

15

16 CHROME_DRIVER = "chromedriver.exe" #这里填写你Chromedriver的所在路径

17

18 HEADERS = {

19 'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/79.0.3945.29 Safari/537.36'

20 }

21

22 class Movie: #定义一个保存电影信息的类

23 def __init__(self,type): #初始化

24 self.img = None #电影图片

25 self.name = None #电影名称

26 self.type = None #电影类型,是通过上一级解析出来的

27 self.rank = None #电影评分

28 self.crew = None #演员列表

29 self.rating = None #电影平均分

30 self.comment = None #评论人数

31 def __repr__(self)->str:

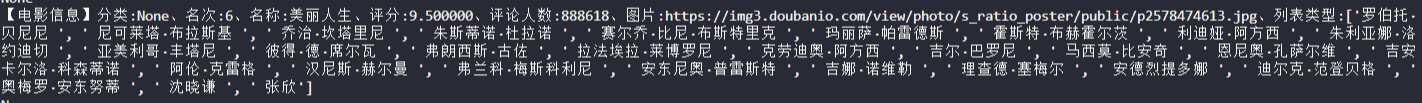

32 return "【电影信息】分类:%s、名次:%d、名称:%s、评分:%f、评论人数:%d、图片:%s、列表类型:%s" % \

33 (self.type,self.rank,self.name,self.rating,self.comment,self.img,self.crew)

34

35 def main(): #主函数

36 driver = selenium.webdriver.Chrome(executable_path=CHROME_DRIVER) #加载浏览器驱动

37 driver.get(url=URL) #访问加载路径

38 for item in range(2): #设置加载次数

39 target = driver.find_element_by_id("footer") #通过分析可以知道,这个元素是用来定义页面尾部的

40 driver.execute_script("arguments[0].scrollIntoView();",target) #通过js定义滚动操作

41 time.sleep(2) #每间隔两秒进行一次滚动处理

42 time.sleep(2) #因为异步加载需要时间,所以在爬取之后需要停顿两秒

43 count = 0 #抓取计数,进行统计

44 try:

45 for content in driver.find_elements_by_xpath("//div[@class='movie-content']"): #通过xpath定位所有的div块且属性为movi-content

46 time.sleep(0.2)

47 movie = Movie("情剧") #实例化电影信息

48 movie.img = content.find_element_by_class_name("movie-img").get_property("src") #通过上面爬取下来的地址img上的解析,获取到图片的src地址

49 if movie.img:

50 movie.name = content.find_element_by_class_name("movie-name-text").text #名称

51 movie.rank = int(content.find_element_by_class_name("rank-num").text) #名次

52 movie.crew = content.find_element_by_class_name("movie-crew").text.split("/") #列表名称

53 movie.rating = float(content.find_element_by_class_name("rating_num").text) #平均分

54 movie.comment = int(re.sub("\D","",content.find_element_by_class_name("comment-num").text)) #评论人数

55 print(movie)

56 print(movie.type)

57 count += 1

58 if count >= 50:

59 raise Exception("123")

60

61 except Exception as exp: #抛出异常信息

62 print(exp)

63 pass

64

65 if __name__ == "__main__":

66 main()

调试运行,会发现自动弹出Google浏览器,出现收到测试软件控制的内容,如下图所示:

然后会发现浏览器自动进行向下滚动的操作来帮我们加载数据。

可以打印出结果:

selenium异步爬取(selenium+Chromedriver)的更多相关文章

- selenium登录爬取知乎出现:请求异常请升级客户端后重试的问题(用Python中的selenium接管chrome)

一.问题使用selenium自动化测试爬取知乎的时候出现了:错误代码10001:请求异常请升级客户端后重新尝试,这个错误的产生是由于知乎可以检测selenium自动化测试的脚本,因此可以阻止selen ...

- [python爬虫] Selenium定向爬取PubMed生物医学摘要信息

本文主要是自己的在线代码笔记.在生物医学本体Ontology构建过程中,我使用Selenium定向爬取生物医学PubMed数据库的内容. PubMed是一个免费的搜寻引擎,提供生物医学方 ...

- Python3.x:Selenium+PhantomJS爬取带Ajax、Js的网页

Python3.x:Selenium+PhantomJS爬取带Ajax.Js的网页 前言 现在很多网站的都大量使用JavaScript,或者使用了Ajax技术.这样在网页加载完成后,url虽然不改变但 ...

- selenium+phantomjs爬取京东商品信息

selenium+phantomjs爬取京东商品信息 今天自己实战写了个爬取京东商品信息,和上一篇的思路一样,附上链接:https://www.cnblogs.com/cany/p/10897618. ...

- selenium+phantomjs爬取bilibili

selenium+phantomjs爬取bilibili 首先我们要下载phantomjs 你可以到 http://phantomjs.org/download.html 这里去下载 下载完之后解压到 ...

- 使用selenium 多线程爬取爱奇艺电影信息

使用selenium 多线程爬取爱奇艺电影信息 转载请注明出处. 爬取目标:每个电影的评分.名称.时长.主演.和类型 爬取思路: 源文件:(有注释) from selenium import webd ...

- scrapy中使用selenium来爬取页面

scrapy中使用selenium来爬取页面 from selenium import webdriver from scrapy.http.response.html import HtmlResp ...

- Python使用asyncio+aiohttp异步爬取猫眼电影专业版

asyncio是从pytohn3.4开始添加到标准库中的一个强大的异步并发库,可以很好地解决python中高并发的问题,入门学习可以参考官方文档 并发访问能极大的提高爬虫的性能,但是requests访 ...

- [python爬虫] Selenium定向爬取海量精美图片及搜索引擎杂谈

我自认为这是自己写过博客中一篇比较优秀的文章,同时也是在深夜凌晨2点满怀着激情和愉悦之心完成的.首先通过这篇文章,你能学到以下几点: 1.可以了解Python简单爬取图片的一些思路和方法 ...

随机推荐

- 解决maven依赖冲突问题

解决maven依赖冲突问题 1.idea 安装maven helper插件 2.打开pom.xml文件 底部多出一个Dependency Analyzer选项 点开这个选项 找到冲突,点击右键,选择E ...

- 如何在TVM上集成Codegen(下)

如何在TVM上集成Codegen(下) Bring DNNL to TVM: JSON Codegen/Runtime 现在实现将中继图序列化为JSON表示的DNNL codegen,然后实现DNNL ...

- RGB Color Codes Chart

RGB Color Codes Chart RGB颜色空间 RGB颜色空间或RGB颜色系统,从红色.绿色和蓝色的组合中构造所有颜色. 红色.绿色和蓝色各使用8位,它们的整数值从0到255.这使得256 ...

- C#后台定义一个DataTable并手动写入静态数据(测试数据)

//创建一个DataTable,并为之添加数据(自定义DataTable) DataTable dtz = new DataTable(); //添加Table中的列 DataColumn dc1 = ...

- springmvc——自定义类型转换器

一.什么是springmvc类型转换器? 在我们的ssm框架中,前端传递过来的参数都是字符串,在controller层接收参数的时候springmvc能够帮我们将大部分字符串类型的参数自动转换为我们指 ...

- Docker与k8s的恩怨情仇(一)—成为PaaS前浪的Cloud Foundry

转载请注明出处:葡萄城官网,葡萄城为开发者提供专业的开发工具.解决方案和服务,赋能开发者. 大家在工作中或许或多或少都接触过Docker,那你知道Docker以及容器化背后的原理到底是什么吗? 容器化 ...

- npm install 动不动卡住咋办?

Hello 我是大粽子 孩子静消消,必定在作妖.我这三天静消消,也是在憋大招. 提前预告下,最近和视频号的文档正在较劲,剩下的功能大家猜猜.暂时没有留言功能,可以私信回复,猜对的下次购买时提我大名10 ...

- Java第二次博客作业

Java第二次博客作业 时间过的很快啊,在不知不觉中这门课程的学习也就快要过去一半了,现在就来总结一下在这个第二个月的学习当中存在的问题以及得到的心得. 1.前言 第四次题目集和第五次题目集给我的感觉 ...

- TopN算法,流式数据获取前N条数据

背景:由于业务需求,用户想要统计每周,每月,几个月,一年之中的前N条数据. 根据已有的思路无非就是对全部的数据进行排序,然后取出前N条数据,可是这样的话按照目前最优的排序算法复杂度也在O(nlog(n ...

- UBoot的编译与烧写

每当我们学习任何编译语言之前,第一节课都是介绍我们要学习的是什么,以及编译语言和工具,最后写一个小程序编译并运行就算入门,也就是所谓的"Hello, world!".这里也不例外, ...