Pytorch实战学习(一):用Pytorch实现线性回归

《PyTorch深度学习实践》完结合集_哔哩哔哩_bilibili

P5--用Pytorch实现线性回归

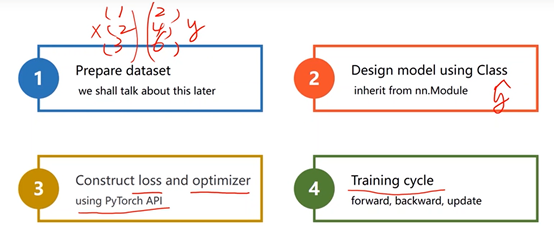

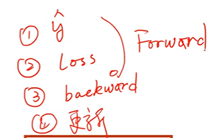

建立模型四大步骤

一、Prepare dataset

mini-batch:x、y必须是矩阵

## Prepare Dataset:mini-batch, X、Y是3X1的Tensor

x_data = torch.Tensor([[1.0], [2.0], [3.0]])

y_data = torch.Tensor([[2.0], [4.0], [6.0]])

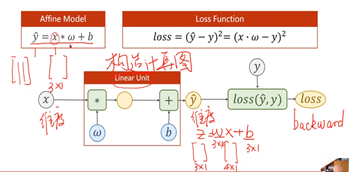

二、Design model

1、重点是构造计算图

##Design Model ##构造类,继承torch.nn.Module类

class LinearModel(torch.nn.Module):

## 构造函数,初始化对象

def __init__(self):

##super调用父类

super(LinearModel, self).__init__()

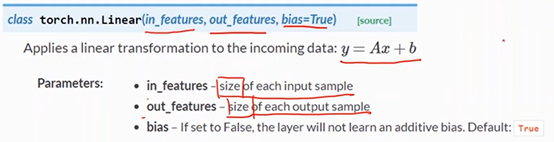

##构造对象,Linear Unite,包含两个Tensor:weight和bias,参数(1, 1)是w的维度

self.linear = torch.nn.Linear(1, 1) ## 构造函数,前馈运算

def forward(self, x):

## w*x+b

y_pred = self.linear(x)

return y_pred model = LinearModel()

2、设置w的维度,后一层的神经元数量 X 前一层神经元数量

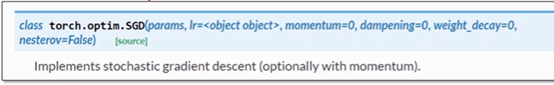

三、Construct Loss and Optimizer

##Construct Loss and Optimizer ##损失函数,传入y和y_presd

criterion = torch.nn.MSELoss(size_average = False) ##优化器,model.parameters()找出模型所有的参数,Lr--学习率

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

1、损失函数

2、优化器

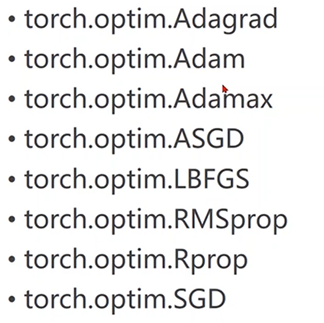

可用不同的优化器进行测试对比

四、Training cycle

## Training cycle for epoch in range(100):

y_pred = model(x_data)

loss = criterion(y_pred, y_data)

print(epoch, loss) ##梯度归零

optimizer.zero_grad()

##反向传播

loss.backward()

##更新

optimizer.step()

完整代码

import torch ## Prepare Dataset:mini-batch, X、Y是3X1的Tensor

x_data = torch.Tensor([[1.0], [2.0], [3.0]])

y_data = torch.Tensor([[2.0], [4.0], [6.0]]) ##Design Model ##构造类,继承torch.nn.Module类

class LinearModel(torch.nn.Module):

## 构造函数,初始化对象

def __init__(self):

##super调用父类

super(LinearModel, self).__init__()

##构造对象,Linear Unite,包含两个Tensor:weight和bias,参数(1, 1)是w的维度

self.linear = torch.nn.Linear(1, 1) ## 构造函数,前馈运算

def forward(self, x):

## w*x+b

y_pred = self.linear(x)

return y_pred model = LinearModel() ##Construct Loss and Optimizer ##损失函数,传入y和y_presd

criterion = torch.nn.MSELoss(size_average = False) ##优化器,model.parameters()找出模型所有的参数,Lr--学习率

optimizer = torch.optim.SGD(model.parameters(), lr=0.01) ## Training cycle for epoch in range(100):

y_pred = model(x_data)

loss = criterion(y_pred, y_data)

print(epoch, loss) ##梯度归零

optimizer.zero_grad()

##反向传播

loss.backward()

##更新

optimizer.step() ## Outpue weigh and bias

print('w = ', model.linear.weight.item())

print('b = ', model.linear.bias.item()) ## Test Model

x_test = torch.Tensor([[4.0]])

y_test = model(x_test)

print('y_pred = ', y_test.data)

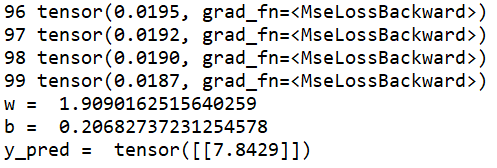

运行结果

训练100次后,得到的 weight and bias,还有预测的y

Pytorch实战学习(一):用Pytorch实现线性回归的更多相关文章

- 对比学习:《深度学习之Pytorch》《PyTorch深度学习实战》+代码

PyTorch是一个基于Python的深度学习平台,该平台简单易用上手快,从计算机视觉.自然语言处理再到强化学习,PyTorch的功能强大,支持PyTorch的工具包有用于自然语言处理的Allen N ...

- 深度学习之PyTorch实战(3)——实战手写数字识别

上一节,我们已经学会了基于PyTorch深度学习框架高效,快捷的搭建一个神经网络,并对模型进行训练和对参数进行优化的方法,接下来让我们牛刀小试,基于PyTorch框架使用神经网络来解决一个关于手写数字 ...

- 深度学习之PyTorch实战(1)——基础学习及搭建环境

最近在学习PyTorch框架,买了一本<深度学习之PyTorch实战计算机视觉>,从学习开始,小编会整理学习笔记,并博客记录,希望自己好好学完这本书,最后能熟练应用此框架. PyTorch ...

- 参考《深度学习之PyTorch实战计算机视觉》PDF

计算机视觉.自然语言处理和语音识别是目前深度学习领域很热门的三大应用方向. 计算机视觉学习,推荐阅读<深度学习之PyTorch实战计算机视觉>.学到人工智能的基础概念及Python 编程技 ...

- 深度学习之PyTorch实战(2)——神经网络模型搭建和参数优化

上一篇博客先搭建了基础环境,并熟悉了基础知识,本节基于此,再进行深一步的学习. 接下来看看如何基于PyTorch深度学习框架用简单快捷的方式搭建出复杂的神经网络模型,同时让模型参数的优化方法趋于高效. ...

- PyTorch 实战:计算 Wasserstein 距离

PyTorch 实战:计算 Wasserstein 距离 2019-09-23 18:42:56 This blog is copied from: https://mp.weixin.qq.com/ ...

- pytorch例子学习-DATA LOADING AND PROCESSING TUTORIAL

参考:https://pytorch.org/tutorials/beginner/data_loading_tutorial.html DATA LOADING AND PROCESSING TUT ...

- pytorch的学习资源

安装:https://github.com/pytorch/pytorch 文档:http://pytorch.org/tutorials/beginner/blitz/tensor_tutorial ...

- 【pytorch】学习笔记(三)-激励函数

[pytorch]学习笔记-激励函数 学习自:莫烦python 什么是激励函数 一句话概括 Activation: 就是让神经网络可以描述非线性问题的步骤, 是神经网络变得更强大 1.激活函数是用来加 ...

- 【pytorch】学习笔记(二)- Variable

[pytorch]学习笔记(二)- Variable 学习链接自莫烦python 什么是Variable Variable就好像一个篮子,里面装着鸡蛋(Torch 的 Tensor),里面的鸡蛋数不断 ...

随机推荐

- LeetCode_单周赛_329

2544. 交替数字和 代码1 转成字符串,逐个判断 class Solution { public int alternateDigitSum(int n) { char[] s = (" ...

- python新冠疫情分析-世界疫情数据爬取

事情发展:1.毕业设计是关于疫情数据的可视化展示(基于java,需要做数据可视化,需要做管理员端对数据进行增删改查处理)2.飞起来速度学爬虫,参考了非常多资料,比如b站的黑马爬取(报错,就是在切片那里 ...

- JZOJ 1075. 【GDKOI2006】新红黑树

\(\text{Problem}\) A君和B君在玩一种叫做新红黑树的游戏,即在一棵由红枝和黑枝构成的树上轮流砍树枝,每次砍一枝,A君每次只能砍红枝,B君每次只能砍黑枝,当其中某人已经没有树枝砍的时候 ...

- PostgreSQL TOAST技术解析

一.TOAST是什么? TOAST是"The Oversized-Attribute Storage Technique"(超尺寸字段存储技术)的缩写,主要用于存储一个大字段的值. ...

- 一次线上OOM问题分析

现象 线上某个服务有接口非常慢,通过监控链路查看发现,中间的 GAP 时间非常大,实际接口并没有消耗很多时间,并且在那段时间里有很多这样的请求. 原因分析 先从监控链路分析了一波,发现请求是已经打到服 ...

- 图扑 Web SCADA 智慧制硅厂,打造新时代制硅工业

前言 我国目前是全球最大的工业硅生产国.消费国和贸易国,且未来该产业的主要增量也将来源于我国.绿色低碳发展已成为全球大趋势和国际社会的共识,随着我国"双碳"目标的推进,光伏产业链快 ...

- IIS SSL认证流程& url重写

一.SSL认证 也就是我们常说的服务器认证,为的是启动加密传输协议https,步骤如下: 1.生成证书请求 进入IIS,选择服务器的服务器证书设置选项, 创建证书申请,填值如图所示 选择加密服务提供程 ...

- 微信小程序分享百度网盘文件的实现思路

需求: 在小程序中点击按钮,获取百度网盘文件的下载地址. 实现思路: 1.网盘文件的下载地址,使用官方API只能自己下载,别人通过dlink无法下载,所以采用网页端生成接口. 好处是可以自定义提取码, ...

- AttributeError: module 'openai' has no attribute 'ChatCompletion'的解决办法

原因 openai库版本过旧 解决办法(二选一) pip install -U openai 下载安装包放入你的项目根目录下, 改名格式zip为whl(即:openai-0.27.0-py3-none ...

- virtualbox装配fedora时,安装增强功能包时会报错解决

virtualbox安装fedora时,安装增强功能包时会报错解决 Building the main GuestAdditions module [失败]安装前需要先安装下面几个包才可以避免这个问题 ...