ReLU函数

Rectifier(neural networks)

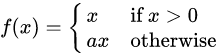

在人工神经网络中,rectfier(整流器,校正器)是一个激活函数,它的定义是:参数中为正的部分。

其中,x是神经元的输入。这也被称为ramp function(斜坡函数),类似于电气工程中半波整流。

由来:

2000年由Hahnloser et al等人首次将该激活函数引入动态网络中,具有强烈的生物学动机和数学理论。

此激活函数在 convolutional networks中被广泛应用,比logistic sigmoid更有效和实用。

rectfier是2017年深度神经网络中最流行的激活函数。

ReLU:

采用rectifier的单元被称为rectfier linear unit(ReLU)

rectifier的平滑近似是analytic function:

被称为softplus function。它的偏导数是

Rectified linear units在computer vision,speech recognition 等深度神经网络中有广泛应用。

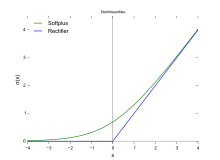

Plot of the rectifier (blue) and softplus (green) functions near x = 0

Variants:

Noisy ReLUs

Rectfier linear units可以被扩展成包含Gaussian noise,

Noisy ReLUs成功应用在一些计算机视觉任务上。

Leaky ReLUs

Leaky ReLUs allow a small, non-zero gradient when the unit is not active.

Parametric ReLUs将coefficient of leakage(泄露系数)转化为与其它神经网络参数一起学习的参数

注意,如果a<=1,那么它等价于

就与maxout networks有关

就与maxout networks有关

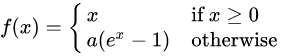

ELUs:

Exponential linear units try to make the mean activations closer to zero which speeds up learning. It has been shown that ELUs can obtain higher classification accuracy than ReLUs

a是需要调的参数,且a>=0

Advantages

请参考

https://en.wikipedia.org/wiki/Rectifier_(neural_networks)

Potential problems

请参考

https://en.wikipedia.org/wiki/Rectifier_(neural_networks)

ReLU函数的更多相关文章

- 神经网络的另一种非线性阶跃函数---ReLU函数

import numpy as np import matplotlib.pylab as plt from matplotlib.font_manager import FontProperties ...

- relu函数为分段线性函数,为什么会增加非线性元素

relu函数为分段线性函数,为什么会增加非线性元素 我们知道激活函数的作用就是为了为神经网络增加非线性因素,使其可以拟合任意的函数.那么relu在大于的时候就是线性函数,如果我们的输出值一直是在大于0 ...

- relu函数是否存在梯度消失问题以及relu函数的死亡节点问题

relu函数是否存在梯度消失问题以及relu函数的死亡节点问题 存在,在小于的时候,激活函数梯度为零,梯度消失,神经元不更新,变成了死亡节点. 出现这个原因可能是因为学习率太大,导致w更新巨大,使得输 ...

- ReLU函数的缺陷

ReLU激活功能并不完美. 它有一个被称为 “ReLU 死区” 的问题:在训练过程中,一些神经元会“死亡”,即它们停止输出 0 以外的任何东西.在某些情况下,你可能会发现你网络的一半神经元已经死亡,特 ...

- CNN卷积层:ReLU函数

卷积层的非线性部分 一.ReLU定义 ReLU:全称 Rectified Linear Units)激活函数 定义 def relu(x): return x if x >0 else 0 #S ...

- python实现并绘制 sigmoid函数,tanh函数,ReLU函数,PReLU函数

Python绘制正余弦函数图像 # -*- coding:utf-8 -*- from matplotlib import pyplot as plt import numpy as np impor ...

- ReLU 函数

线性整流函数(Rectified Linear Unit, ReLU),又称修正线性单元,是一种人工神经网络中常用的激活函数(activation function),通常指代以斜坡函数及其变种 为代 ...

- ReLU激活函数的缺点

训练的时候很”脆弱”,很容易就”die”了,训练过程该函数不适应较大梯度输入,因为在参数更新以后,ReLU的神经元不会再有激活的功能,导致梯度永远都是零. 例如,一个非常大的梯度流过一个 ReLU 神 ...

- 激活函数(ReLU, Swish, Maxout)

神经网络中使用激活函数来加入非线性因素,提高模型的表达能力. ReLU(Rectified Linear Unit,修正线性单元) 形式如下: \[ \begin{equation} f(x)= \b ...

随机推荐

- shell正则表达式和cut命令

正则表达式 符号 描述 $ 匹配输入字符串的结尾位置 () 标记一个子表达式的开始和结束位置 * 匹配前面的子表达式零次或多次 + 匹配前面的子表达式一次或多次 . 匹配除换行符(\n)之外的任何单字 ...

- windows下使用cmd命令杀死进程

tasklist 使用以上命令显示当前进程,及其PID等,如图所示 找到我要删除的进程的pid(好像有点费劲?) 出现以下提示 原因:没有管理员权限,使用管理员模式打开 在Windows菜单栏中找到命 ...

- CentOS6.5源码安装mysql-5.5.21

本文参考自 http://www.cnblogs.com/ShanFish/p/6531365.html,但不局限于它. 一. 卸载旧版本 .检查是否安装mysql组件 # rpm -qa | gre ...

- 【记】VirtualBox安装CentOS6

推荐随笔 VirtualBox中安装CentOS-6.6虚拟机 问题1: 在选择虚拟硬盘大小时,最好不要用默认的8G 我的分区 /boot 200M swap 1024M /home 4096M / ...

- 值得收藏!my.cnf配置文档详解

MySql对于开发人员来说应该都比较熟悉,不管是小白还是老码农应该都能熟练使用.但是要说到的各种参数的配置,我敢说大部分人并不是很熟悉,当我们需要优化mysql,改变某项参数的时候.还是要到处在网上查 ...

- SEATA 分布式事务入门DEMO

Simple Extensible Autonomous Transacation Architecture,seata是简单的.可扩展.自主性高的分布式架构 SEATA Server Configu ...

- js-xlsx 一个实用的js 导出列表插件

在前端开发过程中,导出列表功能的开发无非两种,一种是有后台生成,发生给前端下载,第二种是前端进行列表的导出工作.之前接触了一种前端导出列表的插件 tableExport.js ,但是其缺点很明显,需要 ...

- dp - 递推

C. Multiplicity time limit per test 3 seconds memory limit per test 256 megabytes input standard inp ...

- FFT 入门

推荐博客 :https://oi.men.ci/fft-notes/ 卷积的理解 : https://www.zhihu.com/question/22298352?rf=21686447 题目链接 ...

- 【 Tomcat 】tomcat8.0 基本参数调优配置-----(2)

Tomcat 的缺省配置是不能稳定长期运行的,也就是不适合生产环境,它会死机,让你不断重新启动,甚至在午夜时分唤醒你.对于操作系统优化来说,是尽可能的增大可使用的内存容量.提高CPU 的频率,保证文件 ...