Python 基础爬虫架构

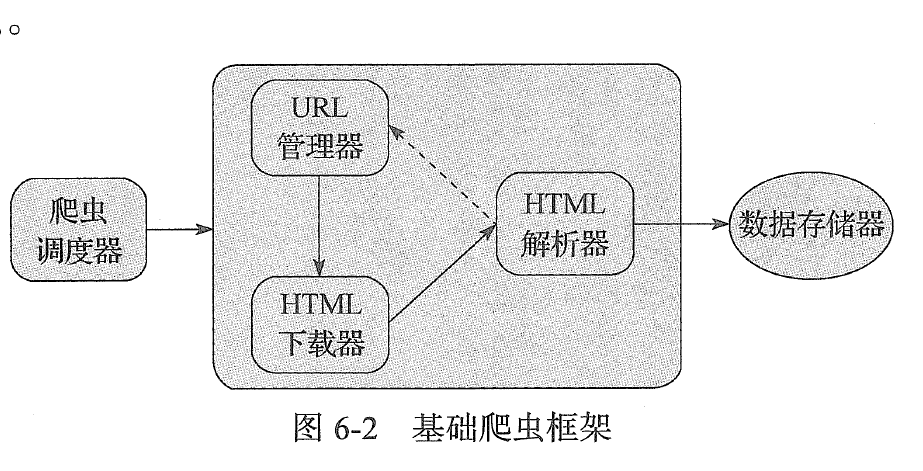

基础爬虫框架主要包括五大模块,分别为爬虫调度器、url管理器、HTML下载器、HTML解析器、数据存储器。

1:爬虫调度器主要负责统筹其他四个模块的协调工作

2: URL管理器负责管理URL连接,维护已经爬取的URL集合和未爬取的URL集合,提供获取新URL链接的接口

3: HTML下载器用于从URL管理器中获取未爬取的URL链接并下载HTML网页

4:HTML解析器用于从HTML下载器中获取已经下载的HTML网页,并从中解析出新的URL连接交给URL管理器,解析出有效数据交给数据存储器

URL管理器主要包括两个变量,一个是已爬取URL的集合,另一个是未爬取URL的集合。采用Python中的set类型,主要是使用set的去重复功能,防止链接重复爬取,重复爬取容易造成死循环。链接去重复在Python爬虫开发中是必备的功能,解决方案主要有三种:1:内存去重2:

关系数据库去重3:缓存数据库去重。大型成熟的爬虫基本上采用缓存数据库的去重方案

URL管理器除了具有两个URL集合,还需要以下接口

1:判断是否有待取的URL,方法定义为has_new_url()

2:添加新的URL到未爬取集合中,方法定义为add_new_url(url),add_new_urls(urls)

3:获取一个未爬取的URL,方法定义为get_new_url()

4:获取未爬取URL集合的大小,方法定义为new_url_size()

5:获取已经爬取的URL集合的大小,方法定义为old_url_size()

URL管理器

#coding:utf-8

class UrlManager(object):

def __init__(self):

self.new_urls = set() # 未爬取URL集合

self.old_urls = set() # 已爬取URL集合

def has_new_url(self):

# 判断是否有未爬取的URL

return self.new_url_size() != 0

def get_new_url(self):

# 获取一个未爬取的URL

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url

def add_new_url(self, url):

# 将新的URL添加到未爬取的URL结合中

if url is None:

return

if url not in self.old_urls and url not in self.new_urls:

self.new_urls.add(url) # 将新的url添加到列表中

# 批量添加url

def add_new_urls(self, urls):

# 将新的URL添加到未爬取的URL集合中

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)

# 获取未爬取url集合的大小

def new_url_size(self):

return len(self.new_urls)

# 获取已经爬取URL集合的大小

def old_url_size(self):

return len(self.old_urls)

HTML下载器

# coding:utf-8

import requests

import urllib2

import sys

type = sys.getfilesystemencoding()

class HtmlDownloader(object):

def download(slef, url):

if url is None:

return None

user_agent = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'

headers = {'User-Agent': user_agent}

req = urllib2.Request(url, headers=headers)

response = urllib2.urlopen(req)

if response.getcode() == 200:

html = response.read().decode("UTF-8").encode(type)

return html

return None

HTML解析器

#coding:utf-8

import re

import urlparse

from bs4 import BeautifulSoup

class HtmlParser(object):

# page_url下载页面的URL

# html_cont 下载的网页内容

# 返回URL和数据

def parser(self, page_url, html_cont):

if page_url is None or html_cont is None:

return

soup = BeautifulSoup(html_cont, 'html.parser')

new_urls = self._get_new_urls(page_url, soup)

new_data = self._get_new_data(page_url, soup)

return new_urls, new_data

# page_url下载页面的url

# soup:soup

# 返回新的URL集合

def _get_new_urls(self, page_url, soup):

new_urls = set()

# 抽取符合要求的a标记

links = soup.find_all('a', href=re.compile(r'/item/.*'))

for link in links:

# 提取href属性

new_url = link['href']

# 拼接成完整网址

new_full_url = urlparse.urljoin(page_url, new_url)

new_urls.add(new_full_url)

return new_urls

# 下载页面的url

def _get_new_data(self, page_url, soup):

data = {}

data['url'] = page_url

title = soup.find('dd', class_='lemmaWgt-lemmaTitle-title').find('h1')

data['title'] = title.get_text()

summary = soup.find('div', class_='lemma-summary')

# 获取tag中包含的所有文本内容,包括子孙tag中的内容,并将结果作为Unicode字符串返回

data['summary'] = summary.get_text()

return data

数据存储器:

# coding:utf-8

import codecs

import sys

from urllib import unquote

class DataOutput(object):

def __init__(self):

self.datas = []

def store_data(self, data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = codecs.open('baike.html', 'w','utf-8')

fout.write("<html>")

fout.write("<body>")

fout.write("<table>")

for data in self.datas:

fout.write("<tr>")

fout.write("<td>%s</td>" % data['url'])

fout.write("<td>%s</td>" % data['title'])

fout.write("<td>%s</td>" % data['summary'])

fout.write("</tr>")

self.datas.remove(data)

fout.write("</table>")

fout.write("</body>")

fout.write("</html>")

fout.close()

爬虫调度器

# coding:utf-8

from DataOutput import DataOutput

from HtmlDownloader import HtmlDownloader

from HtmlParser import HtmlParser

from UrlManager import UrlManager

class SpiderMan(object):

def __init__(self):

self.manager = UrlManager()

self.downloader = HtmlDownloader()

self.parser = HtmlParser()

self.output = DataOutput()

def crawl(self, root_url):

# 添加入口URL

self.manager.add_new_url(root_url)

# 判断url管理器中是否有新的url,同时判断抓取了多少个url

while (self.manager.has_new_url() and self.manager.old_url_size() < 100):

try:

# 从URL管理器获取新的url

new_url = self.manager.get_new_url()

# html下载器下载网页

html = self.downloader.download(new_url)

# HTML解析器抽取网页数据

new_urls, data = self.parser.parser(new_url, html)

# 将抽取的url添加到URL管理器中

self.manager.add_new_urls(new_urls)

# 数据存储器存储文件

self.output.store_data(data)

print u"已经抓取%s个链接" % self.manager.old_url_size()

except Exception, e:

print "crawl failed"

self.output.output_html()

if __name__ == "__main__":

spider_man = SpiderMan()

spider_man.crawl("https://baike.baidu.com/item/%E7%BD%91%E7%BB%9C%E7%88%AC%E8%99%AB")

Python 基础爬虫架构的更多相关文章

- Python基础爬虫

搭建环境: win10,Python3.6,pycharm,未设虚拟环境 之前写的爬虫并没有架构的思想,且不具备面向对象的特征,现在写一个基础爬虫架构,爬取百度百科,首先介绍一下基础爬虫框架的五大模块 ...

- Python基础+爬虫基础

Python基础+爬虫基础 一.python的安装: 1.建议安装Anaconda,会自己安装一些Python的类库以及自动的配置环境变量,比较方便. 二.基础介绍 1.什么是命名空间:x=1,1存在 ...

- 零python基础--爬虫实践总结

网络爬虫,是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本. 爬虫主要应对的问题:1.http请求 2.解析html源码 3.应对反爬机制. 觉得爬虫挺有意思的,恰好看到知乎有人分享的一个爬虫 ...

- Python基础——爬虫以及简单的数据分析

目标:使用Python编写爬虫,获取链家青岛站的房产信息,然后对爬取的房产信息进行分析. 环境:win10+python3.8+pycharm Python库: import requests imp ...

- python基础爬虫,翻译爬虫,小说爬虫

基础爬虫: # -*- coding: utf-8 -*- import requests url = 'https://www.baidu.com' # 注释1 headers = { # 注释2 ...

- python 基础-爬虫-数据处理,全部方法

生成时间戳 1. time.time() 输出 1515137389.69163 ===================== 生成格式化的时间字符串 1. time.ctime() 输出 Fri Ja ...

- python基础-爬虫

爬虫引入 爬虫: 1 百度:搜索引擎 爬虫:spider 种子网站开始爬,下载网页,分析链接,作为待抓取的网页 分词 index:词--->某个结果 Page rank(1 网站很大(互链) ...

- Python开发爬虫之理论篇

爬虫简介 爬虫:一段自动抓取互联网信息的程序. 什么意思呢? 互联网是由各种各样的网页组成.每一个网页对应一个URL,而URL的页面上又有很多指向其他页面的URL.这种URL之间相互的指向关系就形成了 ...

- python爬虫主要就是五个模块:爬虫启动入口模块,URL管理器存放已经爬虫的URL和待爬虫URL列表,html下载器,html解析器,html输出器 同时可以掌握到urllib2的使用、bs4(BeautifulSoup)页面解析器、re正则表达式、urlparse、python基础知识回顾(set集合操作)等相关内容。

本次python爬虫百步百科,里面详细分析了爬虫的步骤,对每一步代码都有详细的注释说明,可通过本案例掌握python爬虫的特点: 1.爬虫调度入口(crawler_main.py) # coding: ...

随机推荐

- 【重点突破】—— Vue2.0 transition 动画Demo实践填坑

前言:vue1.0版本和2.0版本的过渡系统改变是很大的,具体请详看文档介绍.本文转载自郭锦荣的博客,一共列举了四种transition的使用实践,分别是css过渡.css动画.javascript钩 ...

- Java Web---登录验证和字符编码过滤器

什么是过滤器? 在Java Web中,过滤器即Filter.Servlet API中提供了一个Filter接口(javax.servlet.Filter).开发web应用时,假设编写的Java类实现了 ...

- ES标准中的相等比较算法 SameValue SameValueZero

1.相等比较算法 The Abstract Equality Comparison Algorithm (==) The Strict Equality Comparison Algorithm (= ...

- JAVA 模块

commons-lang3 maven repository, 项目主页 fastjson maven repository, 项目主页 fastjson 是阿里巴巴开源的序列化和反序列化 JSON ...

- (三)EasyUI 使用——form表单1

form表单组件主要有以下内容(如下图) 1. validatebox验证框 姓名:必填/1-4个字符/必填中文 邮箱:必填/1-30个字符/必填符合邮箱格式/后缀必须是com或cn 密码验证 ...

- silverlight计时器

引用using System.Windows.Threading; DispatcherTimer dispatchertimer = new DispatcherTimer();//创建一个新的计时 ...

- 同时安装office2016与visio2016的实现过程

visio 2016安装问题 同时安装office2016与visio2016的实现过程 visio2016 but failed

- 檢查php文件中是否含有bom的php文件

原文链接: http://www.cnblogs.com/Athrun/archive/2010/05/27/1745464.html 另一篇文章:<关于bom.php>,http://h ...

- JWT—JSON Web Token - 理解JWT网络间应用用户安全认证交互设计

原文地址:http://blog.leapoahead.com/2015/09/06/understanding-jwt/ 官网地址:https://jwt.io/ JSON Web Token(JW ...

- linux 设置tomcat快捷启动方式

在linux下搭建好tomcat之后,每次启动和关闭都要去tomcat的bin目录下执行./startup.sh和./shutdown.sh 这是很不方便的,下面介绍如何像执行ls mv cp等命令一 ...