Cpython解释器下实现并发编程——多进程、多线程、协程、IO模型

一、背景知识

进程即正在执行的一个过程。进程是对正在运行的程序的一个抽象。

进程的概念起源于操作系统,是操作系统最核心的概念,也是操作系统提供的最古老也是最重要的抽象概念之一。操作系统的其他所有内容都是围绕进程的概念展开的。

一、操作系统相关的知识

详情见链接:http://www.cnblogs.com/linhaifeng/p/6295875.html

即使可以利用的CPU只有一个(早期的计算机确实如此),也能保证支持(伪)并发的能力。将一个单独的CPU变成多个虚拟的CPU(多道技术:时间多路复用和空间多路复用+硬件上支持隔离),没有进程的抽象,现在计算机将不复存在。

二、必备的理论基础

1、操作系统的作用

隐藏丑陋复杂的硬件接口,提供良好的抽象接口

管理、调度进程,并且将多个进程对硬件的竞争变得有序

2、多道技术

1、产生背景:针对单核,实现并发

现在的主机一般是多核,那么每个核都会利用多道技术

有4个CPU,运行于CPU1的某个程序遇到IO阻塞,会等到IO结再重新调度,会被重新调度到4个CPU中的任意一个,具体由操作系统调度算法决定。

2、空间上的复用:如内存中同时有多道程序

3、时间上的复用:复用一个CPU的时间片

强调:遇到IO切,占用CPU时间过长也切,核心在切之前将进程的状态保存下来,这样才能保存下次切换回来时,能基于上次切走的位置继续运行

二、python并发编程之多进程

一、多进程理论部分

1、什么是进程

进程:正在进行的一个过程或者说一个任务。而负责执行任务则是CPU。

举例(单核+多道,实现多个进程的并发自行)

一个时间段有许多任务要做:下载课程的视频,洗衣服,和朋友聊天,做饭(在一个任务正在运行时,不需要人工干预时,切换做另外一件事情,设定好相应的提醒,或者定时执行动作)

2、进程与程序的区别

程序仅仅只是一堆代码而已,而进程指的是程序的运行过程。

做蛋糕的食谱就是程序(即用适当形式描述的算法)

计算机科学家就是处理器(cpu)

而做蛋糕的各种原料就是输入数据。

进程就是厨师阅读食谱、取来各种原料以及烘制蛋糕等一系列动作的总和。

需要强调的是:同一个程序执行两次那也是两个进程。比如一个播放器,同时播放两个视频,是两个进程。

3、并发与并行

在用户看来,无论是并行还是并发,都是‘同时’运行的;不管进程还是线程,都只是一个任务而已,真正干活的是CPU,CPU来做这些任务,而一个CPU同一时刻只能执行一个任务。

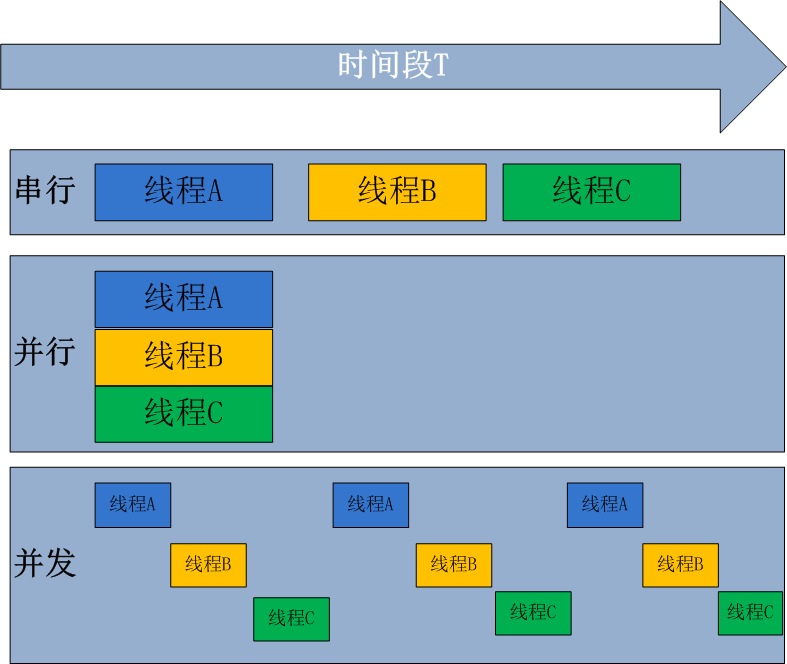

一 并发:是伪并行,即看起来是同时运行。单个cpu+多道技术就可以实现并发,(并行也属于并发)

二 并行:同时运行,只有具备多个cpu才能实现并行

单核下,可以利用多道技术,多个核,每个核也都可以利用多道技术(多道技术是针对单核而言的)

有四个核,六个任务,这样同一时间有四个任务被执行,假设分别被分配给了cpu1,cpu2,cpu3,cpu4,

一旦任务1遇到I/O就被迫中断执行,此时任务5就拿到cpu1的时间片去执行,这就是单核下的多道技术

而一旦任务1的I/O结束了,操作系统会重新调用它(需知进程的调度、分配给哪个cpu运行,由操作系统说了算),可能被分配给四个cpu中的任意一个去执行

所有现代计算机经常会在同一时间做很多件事,一个用户的PC(无论是单cpu还是多cpu),都可以同时运行多个任务(一个任务可以理解为一个进程)。

启动一个进程来杀毒(360软件)

启动一个进程来看电影(暴风影音)

启动一个进程来聊天(腾讯QQ)

所有的这些进程都需被管理,于是一个支持多进程的多道程序系统是至关重要的

多道技术概念回顾:内存中同时存入多道(多个)程序,cpu从一个进程快速切换到另外一个,使每个进程各自运行几十或几百毫秒,这样,虽然在某一个瞬间,一个cpu只能执行一个任务,但在1秒内,cpu却可以运行多个进程,这就给人产生了并行的错觉,即伪并发,以此来区分多处理器操作系统的真正硬件并行(多个cpu共享同一个物理内存)

4、同步、异步 和 阻塞、非阻塞

1、同步

所谓同步,就是在发出一个功能调用时,在没有得到结果之前,该调用就不会返回。按照这个定义,其实绝大多数函数都是同步调用。但是一般而言,我们在说同步、异步的时候,特指那些需要其他部件协作或者需要一定时间完成的任务。

#举例:

1. multiprocessing.Pool下的apply #发起同步调用后,就在原地等着任务结束,根本不考虑任务是在计算还是在io阻塞,总之就是一股脑地等任务结束

2. concurrent.futures.ProcessPoolExecutor().submit(func,).result()

3. concurrent.futures.ThreadPoolExecutor().submit(func,).result()

2、异步

异步的概念和同步相对。当一个异步功能调用发出后,调用者不能立刻得到结果。当该异步功能完成后,通过状态、通知或回调来通知调用者。如果异步功能用状态来通知,那么调用者就需要每隔一定时间检查一次,效率就很低(有些初学多线程编程的人,总喜欢用一个循环去检查某个变量的值,这其实是一 种很严重的错误)。如果是使用通知的方式,效率则很高,因为异步功能几乎不需要做额外的操作。至于回调函数,其实和通知没太多区别。

#举例:

1. multiprocessing.Pool().apply_async() #发起异步调用后,并不会等待任务结束才返回,相反,会立即获取一个临时结果(并不是最终的结果,可能是封装好的一个对象)。

2. concurrent.futures.ProcessPoolExecutor(3).submit(func,)

3. concurrent.futures.ThreadPoolExecutor(3).submit(func,)

3、阻塞

阻塞调用是指调用结果返回之前,当前线程会被挂起(如遇到io操作)。函数只有在得到结果之后才会将阻塞的线程激活。有人也许会把阻塞调用和同步调用等同起来,实际上他是不同的。对于同步调用来说,很多时候当前线程还是激活的,只是从逻辑上当前函数没有返回而已。

#举例:

1. 同步调用:apply一个累计1亿次的任务,该调用会一直等待,直到任务返回结果为止,但并未阻塞住(即便是被抢走cpu的执行权限,那也是处于就绪态);

2. 阻塞调用:当socket工作在阻塞模式的时候,如果没有数据的情况下调用recv函数,则当前线程就会被挂起,直到有数据为止。

4、非阻塞

非阻塞和阻塞的概念相对应,指在不能立刻得到结果之前也会立刻返回,同时该函数不会阻塞当前线程。

5、小结

1. 同步与异步针对的是函数/任务的调用方式:

同步就是当一个进程发起一个函数(任务)调用的时候,一直等到函数(任务)完成,而进程继续处于激活状态。而异步情况下是当一个进程发起一个函数(任务)调用的时候,不会等函数返回,而是继续往下执行当,函数返回的时候通过状态、通知、事件等方式通知进程任务完成。 2. 阻塞与非阻塞针对的是进程或线程:

阻塞是当请求不能满足的时候就将进程挂起,而非阻塞则不会阻塞当前进程

5、进程的创建

凡是硬件,都是需要有操作系统去管理,只要有操作系统,就有进程的概念,就需要创建进程的方式,一些操作系统只为一个应用程序设计。比如微波炉控制器。

1、对于通用系统(跑许多应用程序),需要有系统运行过程中创建或撤销进程的能力,主要分为4个形式创建新的进程

1. 系统初始化(查看进程linux中用ps命令,windows中用任务管理器,前台进程负责与用户交互,后台运行的进程与用户无关,运行在后台并且只在需要时才唤醒的进程,称为守护进程,如电子邮件、web页面、新闻、打印)

2. 一个进程在运行过程中开启了子进程(如nginx开启多进程,os.fork,subprocess.Popen等)

3. 用户的交互式请求,而创建一个新进程(如用户双击暴风影音)

4. 一个批处理作业的初始化(只在大型机的批处理系统中应用)

2、新进程的创建都是由一个已经存在的进程执行了一个用于创建进程的系统调用而创建的:

1. 在UNIX中该系统调用是:fork,fork会创建一个与父进程一模一样的副本,二者有相同的存储映像、同样的环境字符串和同样的打开文件(在shell解释器进程中,执行一个命令就会创建一个子进程)

2. 在windows中该系统调用是:CreateProcess,CreateProcess既处理进程的创建,也负责把正确的程序装入新进程。

from multiprocessing import Process

import time,random class MyProcess(Process):

def __init__(self,name):

super(MyProcess,self).__init__()

self.name=name def run(self):

print('%s is piaoing' %self.name)

time.sleep(random.randint(1,3))

print('%s is over' % self.name) if __name__ == '__main__':

p=MyProcess('P1')

p.start() #仅仅只是向操作系统发送了一个创建子进程p的信号

print('主')

开启子进程

3、创建子进程:unix和Windows的差异

1.相同的是:进程创建后,父进程和子进程有各自不同的地址空间(多道技术要求物理层面实现进程之间内存的隔离),任何一个进程的在其地址空间中的修改都不会影响到另外一个进程。

2.不同的是:在UNIX中,子进程的初始地址空间是父进程的一个副本,提示:子进程和父进程是可以有只读的共享内存区的。但是对于windows系统来说,从一开始父进程与子进程的地址空间就是不同的。

6、进程的终止(了解)

1. 正常退出(自愿,如用户点击交互式页面的叉号,或程序执行完毕调用发起系统调用正常退出,在linux中用exit,在windows中用ExitProcess)

2. 出错退出(自愿,python a.py中a.py不存在)

3. 严重错误(非自愿,执行非法指令,如引用不存在的内存,1/0等,可以捕捉异常,try...except...)

4. 被其他进程杀死(非自愿,如kill -9)

7、进程层次结构

无论UNIX还是windows,进程只有一个父进程,不同的是:

1. 在UNIX中所有的进程,都是以init进程为根,组成树形结构。父子进程共同组成一个进程组,这样,当从键盘发出一个信号时,该信号被送给当前与键盘相关的进程组中的所有成员。

2. 在windows中,没有进程层次的概念,所有的进程都是地位相同的,唯一类似于进程层次的暗示,是在创建进程时,父进程得到一个特别的令牌(称为句柄),该句柄可以用来控制子进程,但是父进程有权把该句柄传给其他子进程,这样就没有层次了。

8、进程的状态

tail -f access.log |grep '404'

执行程序tail,开启一个子进程,执行程序grep,开启另外一个子进程,两个进程之间基于管道'|'通讯,将tail的结果作为grep的输入。

进程grep在等待输入(即I/O)时的状态称为阻塞,此时grep命令都无法运行

其实在两种情况下会导致一个进程在逻辑上不能运行,

1. 进程挂起是自身原因,遇到I/O阻塞,便要让出CPU让其他进程去执行,这样保证CPU一直在工作

2. 与进程无关,是操作系统层面,可能会因为一个进程占用时间过多,或者优先级等原因,而调用其他的进程去使用CPU。

因而一个进程由三种状态

9、进程并发的实现(了解)

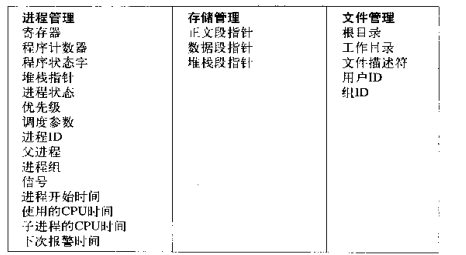

进程并发的实现在于,硬件中断一个正在运行的进程,把此时进程运行的所有状态保存下来,为此,操作系统维护一张表格,即进程表(process table),每个进程占用一个进程表项(这些表项也称为进程控制块)

该表存放了进程状态的重要信息:程序计数器、堆栈指针、内存分配状况、所有打开文件的状态、帐号和调度信息,以及其他在进程由运行态转为就绪态或阻塞态时,必须保存的信息,从而保证该进程在再次启动时,就像从未被中断过一样。

二、python并发编程之多进程实战

1、multiprocessing模块介绍

python中的多线程无法利用多核优势,如果想要充分地使用多核CPU的资源(os.cpu_count()查看),在python中大部分情况需要使用多进程。Python提供了multiprocessing。

multiprocessing模块用来开启子进程,并在子进程中执行我们定制的任务(比如函数),该模块与多线程模块threading的编程接口类似。

multiprocessing模块的功能众多:支持子进程、通信和共享数据、执行不同形式的同步,提供了Process、Queue、Pipe、Lock等组件。

需要再次强调的一点是:与线程不同,进程没有任何共享状态,进程修改的数据,改动仅限于该进程内。

2、Process类的介绍

1、创建进程的类

Process([group [, target [, name [, args [, kwargs]]]]]),由该类实例化得到的对象,表示一个子进程中的任务(尚未启动) 强调:

1. 需要使用关键字的方式来指定参数

2. args指定的为传给target函数的位置参数,是一个元组形式,必须有逗号

2、参数介绍

group参数未使用,值始终为None

target表示调用对象,即子进程要执行的任务

args表示调用对象的位置参数元组,args=(1,2,'egon',)

kwargs表示调用对象的字典,kwargs={'name':'egon','age':18}

name为子进程的名称

3、方法介绍

p.start():启动进程,并调用该子进程中的p.run()

p.run():进程启动时运行的方法,正是它去调用target指定的函数,我们自定义类的类中一定要实现该方法 p.terminate():强制终止进程p,不会进行任何清理操作,如果p创建了子进程,该子进程就成了僵尸进程,使用该方法需要特别小心这种情况。如果p还保存了一个锁那么也将不会被释放,进而导致死锁

p.is_alive():如果p仍然运行,返回True p.join([timeout]):主线程等待p终止(强调:是主线程处于等的状态,而p是处于运行的状态)。timeout是可选的超时时间,需要强调的是,p.join只能join住start开启的进程,而不能join住run开启的进程

4、属性介绍

p.daemon:默认值为False,如果设为True,代表p为后台运行的守护进程,当p的父进程终止时,p也随之终止,并且设定为True后,p不能创建自己的新进程,必须在p.start()之前设置 p.name:进程的名称 p.pid:进程的pid p.exitcode:进程在运行时为None、如果为–N,表示被信号N结束(了解即可) p.authkey:进程的身份验证键,默认是由os.urandom()随机生成的32字符的字符串。这个键的用途是为涉及网络连接的底层进程间通信提供安全性,这类连接只有在具有相同的身份验证键时才能成功(了解即可)

3、Process类的使用

注意:在Windows中Process()必须放到 #if __name__ == '__main__':下

Since Windows has no fork, the multiprocessing module starts a new Python process and imports the calling module.

If Process() gets called upon import, then this sets off an infinite succession of new processes (or until your machine runs out of resources).

This is the reason for hiding calls to Process() inside

if __name__ == "__main__"

since statements inside this if-statement will not get called upon import.

由于Windows没有fork,多处理模块启动一个新的Python进程并导入调用模块。

如果在导入时调用Process(),那么这将启动无限继承的新进程(或直到机器耗尽资源)。

这是隐藏对Process()内部调用的原,使用if __name__ == “__main __”,这个if语句中的语句将不会在导入时被调用。

详细解释

1、创建并开启子进程的两种方式

from multiprocessing import Process

import time,random def piao(name):

print('%s is piaoing' %name)

time.sleep(random.randint(1,3))

print('%s is over' % name) if __name__ == '__main__':

# p=Process(target=piao,kwargs={'name':'alex'})

p=Process(target=piao,args=('alex',))

p.start() #仅仅只是向操作系统发送了一个创建子进程p的信号

print('主')

开启进程方式一

from multiprocessing import Process

import time,random class MyProcess(Process):

def __init__(self,name):

super(MyProcess,self).__init__()

self.name=name def run(self):

print('%s is piaoing' %self.name)

time.sleep(random.randint(1,3))

print('%s is over' % self.name) if __name__ == '__main__':

p=MyProcess('P1')

p.start() #仅仅只是向操作系统发送了一个创建子进程p的信号

print('主')

开启进程的方式二

练习一:把上周所学的socket通信变成并发的形式

from socket import *

from multiprocessing import Process server=socket(AF_INET,SOCK_STREAM)

server.setsockopt(SOL_SOCKET,SO_REUSEADDR,1)

server.bind(('127.0.0.1',8080))

server.listen(5) def talk(conn,client_addr):

while True:

try:

msg=conn.recv(1024)

if not msg:break

conn.send(msg.upper())

except Exception:

break if __name__ == '__main__': #windows下start进程一定要写到这下面

while True:

conn,client_addr=server.accept()

p=Process(target=talk,args=(conn,client_addr))

p.start()

server端

from socket import * client=socket(AF_INET,SOCK_STREAM)

client.connect(('127.0.0.1',8080)) while True:

msg=input('>>: ').strip()

if not msg:continue client.send(msg.encode('utf-8'))

msg=client.recv(1024)

print(msg.decode('utf-8'))

client端

这么实现有没有问题??

每来一个客户端,都在服务端开启一个进程,如果并发来一个万个客户端,要开启一万个进程吗,你自己尝试着在你自己的机器上开启一万个,10万个进程试一试。

解决方法:进程池

2、Process对象的join方法

from multiprocessing import Process

import time

import random class Piao(Process):

def __init__(self,name):

self.name=name

super().__init__()

def run(self):

print('%s is piaoing' %self.name)

time.sleep(random.randrange(1,3))

print('%s is piao end' %self.name) p=Piao('egon')

p.start()

p.join(0.0001) #等待p停止,等0.0001秒就不再等了

print('开始')

join:主进程等,等待子进程结束

from multiprocessing import Process

import time

import random

def piao(name):

print('%s is piaoing' %name)

time.sleep(random.randint(1,3))

print('%s is piao end' %name) p1=Process(target=piao,args=('egon',))

p2=Process(target=piao,args=('alex',))

p3=Process(target=piao,args=('yuanhao',))

p4=Process(target=piao,args=('wupeiqi',)) p1.start()

p2.start()

p3.start()

p4.start() #有的同学会有疑问:既然join是等待进程结束,那么我像下面这样写,进程不就又变成串行的了吗?

#当然不是了,必须明确:p.join()是让谁等?

#很明显p.join()是让主线程等待p的结束,卡住的是主线程而绝非进程p, #详细解析如下:

#进程只要start就会在开始运行了,所以p1-p4.start()时,系统中已经有四个并发的进程了

#而我们p1.join()是在等p1结束,没错p1只要不结束主线程就会一直卡在原地,这也是问题的关键

#join是让主线程等,而p1-p4仍然是并发执行的,p1.join的时候,其余p2,p3,p4仍然在运行,等#p1.join结束,可能p2,p3,p4早已经结束了,这样p2.join,p3.join.p4.join直接通过检测,无需等待

# 所以4个join花费的总时间仍然是耗费时间最长的那个进程运行的时间

p1.join()

p2.join()

p3.join()

p4.join() print('主线程') #上述启动进程与join进程可以简写为

# p_l=[p1,p2,p3,p4]

#

# for p in p_l:

# p.start()

#

# for p in p_l:

# p.join()

有了join,程序不就是串行了吗???

4、守护进程

主进程创建守护进程

其一:守护进程会在主进程代码执行结束后就停止

其二:守护进程无法再开启子进程,否则抛出异常

from multiprocessing import Process

import time

import random class Piao(Process):

def __init__(self,name):

self.name=name

super().__init__()

def run(self):

print('%s is piaoing' %self.name)

time.sleep(random.randrange(1,3))

print('%s is piao end' %self.name) p=Piao('egon')

p.daemon=True #一定要在p.start()前设置,设置p为守护进程,禁止p创建子进程,并且父进程代码执行结束,p即终止运行

p.start()

print('主')

示例1

from multiprocessing import Process

import time def foo():

print(123)

time.sleep(1)

print('end123') def bar():

print(456)

time.sleep(3)

print('end456') if __name__ == '__main__':

p1 = Process(target=foo)

p2 = Process(target=bar) # p1.daemon = False

p1.daemon = True #一定要在p1.start()前设置,设置p1为守护进程,禁止p1创建子进程,并且父进程代码执行结束,p1即终止运行

p1.start()

p2.start() print("主")

# 打印该行则主进程代码结束,则守护进程p1应该被终止,可能会有p1任务执行的打印信息123,因为主进程打印"主",p1也执行了,但是随即被终止

主进程代码运行完毕,守护进程就会结束

5、进程同步锁(了解,生产使用数据库(已经做好))

进程之间数据不共享,但是共享同一套文件系统,所以访问同一个文件,或同一个打印终端,是没有问题的,

竞争带来的结果就是错乱,如何控制,就是加锁处理

from multiprocessing import Process

import os,time

def work():

print('%s is running' %os.getpid())

time.sleep(2)

print('%s is done' %os.getpid()) if __name__ == '__main__':

for i in range(3):

p=Process(target=work)

p.start()

并发运行,效率高,但竞争同一打印终端,带来了打印错乱

from multiprocessing import Process,Lock

import time def work(name,mutex):

mutex.acquire() #加锁,可以设定锁的时间

print('task %s is running' %name)

time.sleep(2)

print('task %s is done' %name)

mutex.release() #解锁 if __name__ == '__main__':

mutex = Lock()

p1 = Process(target=work,args=('wzs',mutex)) #args传参数以元组的实行传

p2 = Process(target=work,args=('egon',mutex)) #args传参数以元组的实行传

p1.start()

p2.start() print('主')

由并发变成了串行,牺牲了运行效率,但避免了竞争

多个进程共享一个文件:模拟抢票(文件当数据库)

{"count": 6}

db.txt

import json

import os

import time

import random

from multiprocessing import Process,Lock

def search():

dic = json.load(open('db.txt'))

print('\033[32m[%s] 看到剩余票数<%s> \033[0m' %(os.getpid(),dic['count'])) def get_tickert():

'''

模拟抢票过程中,数据库操作

:return:

'''

dic = json.load(open('db.txt'))

time.sleep(random.randint(1,3)) ##模拟读取数据库网络延迟

if dic['count'] > 0:

dic['count'] -= 1

time.sleep(random.randint(1,3)) ##模拟写数据库的网络延迟

json.dump(dic,open('db.txt','w'))

print('\033[31m[%s] 购票成功 \033[0m' %os.getpid())

print('\033[32m[%s] 看到剩余票数<%s> \033[0m' % (os.getpid(), dic['count'])) def task(mutex):

'''

抢票过程,加锁(多人操作(读写)同一份数据)

:param mutex:

:return:

'''

# 方式一:手动加锁,释放锁

# search() #查看数据库,并发执行

# mutex.acquire()

# get_tickert() #购票操作,串行

# mutex.release()

# 方式二:支持with(加锁,释放)

search() #查看数据库,并发执行

with mutex:

get_tickert() #购票操作,串行 if __name__ == '__main__':

mutex = Lock()

for i in range(10):

p = Process(target=task,args=(mutex,))

p.start()

模拟抢票

总结:

#加锁可以保证多个进程修改同一块数据时,同一时间只能有一个任务可以进行修改,即串行的修改,没错,速度是慢了,但牺牲了速度却保证了数据安全。

虽然可以用文件共享数据实现进程间通信,但问题是:

1.效率低(共享数据基于文件,而文件是硬盘上的数据)

2.需要自己加锁处理 #因此我们最好找寻一种解决方案能够兼顾:1、效率高(多个进程共享一块内存的数据)2、帮我们处理好锁问题。这就是mutiprocessing模块为我们提供的基于消息的IPC通信机制:队列和管道。

1 队列和管道都是将数据存放于内存中

2 队列又是基于(管道+锁)实现的,可以让我们从复杂的锁问题中解脱出来,

我们应该尽量避免使用共享数据,尽可能使用消息传递和队列,避免处理复杂的同步和锁问题,而且在进程数目增多时,往往可以获得更好的可获展性。

复制代码

6、队列(推荐使用)

进程彼此之间互相隔离,要实现进程间通信(IPC),multiprocessing模块支持两种形式:队列和管道,这两种方式都是使用消息传递的

1、创建创建队列的类(底层就是以管道和锁定的方式实现)

Queue([maxsize]):创建共享的进程队列,Queue是多进程安全的队列,可以使用Queue实现多进程之间的数据传递。

2、参数介绍

maxsize是队列中允许最大项数,省略则无大小限制

3、方法介绍

主要方法

q.put方法用以插入数据到队列中,put方法还有两个可选参数:blocked和timeout。如果blocked为True(默认值),并且timeout为正值,该方法会阻塞timeout指定的时间,直到该队列有剩余的空间。如果超时,会抛出Queue.Full异常。如果blocked为False,但该Queue已满,会立即抛出Queue.Full异常。

q.get方法可以从队列读取并且删除一个元素。同样,get方法有两个可选参数:blocked和timeout。如果blocked为True(默认值),并且timeout为正值,那么在等待时间内没有取到任何元素,会抛出Queue.Empty异常。如果blocked为False,有两种情况存在,如果Queue有一个值可用,则立即返回该值,否则,如果队列为空,则立即抛出Queue.Empty异常.

q.get_nowait():同q.get(False)

q.put_nowait():同q.put(False)

q.empty():调用此方法时q为空则返回True,该结果不可靠,比如在返回True的过程中,如果队列中又加入了项目。

q.full():调用此方法时q已满则返回True,该结果不可靠,比如在返回True的过程中,如果队列中的项目被取走。

q.qsize():返回队列中目前项目的正确数量,结果也不可靠,理由同q.empty()和q.full()一样

其他方法(了解)

q.cancel_join_thread():不会在进程退出时自动连接后台线程。可以防止join_thread()方法阻塞

q.close():关闭队列,防止队列中加入更多数据。调用此方法,后台线程将继续写入那些已经入队列但尚未写入的数据,但将在此方法完成时马上关闭。如果q被垃圾收集,将调用此方法。关闭队列不会在队列使用者中产生任何类型的数据结束信号或异常。例如,如果某个使用者正在被阻塞在get()操作上,关闭生产者中的队列不会导致get()方法返回错误。

q.join_thread():连接队列的后台线程。此方法用于在调用q.close()方法之后,等待所有队列项被消耗。默认情况下,此方法由不是q的原始创建者的所有进程调用。调用q.cancel_join_thread方法可以禁止这种行为

#JoinableQueue([maxsize]):这就像是一个Queue对象,但队列允许项目的使用者通知生成者项目已经被成功处理。通知进程是使用共享的信号和条件变量来实现的。 #参数介绍:

maxsize是队列中允许最大项数,省略则无大小限制。

#方法介绍:

JoinableQueue的实例p除了与Queue对象相同的方法之外还具有:

q.task_done():使用者使用此方法发出信号,表示q.get()的返回项目已经被处理。如果调用此方法的次数大于从队列中删除项目的数量,将引发ValueError异常

q.join():生产者调用此方法进行阻塞,直到队列中所有的项目均被处理。阻塞将持续到队列中的每个项目均调用q.task_done()方法为止

生产者消费者模型

在并发编程中使用生产者和消费者模式能够解决绝大多数并发问题。该模式通过平衡生产线程和消费线程的工作能力来提高程序的整体处理数据的速度。

为什么要使用生产者和消费者模式

在线程世界里,生产者就是生产数据的线程,消费者就是消费数据的线程。在多线程开发当中,如果生产者处理速度很快,而消费者处理速度很慢,那么生产者就必须等待消费者处理完,才能继续生产数据。同样的道理,如果消费者的处理能力大于生产者,那么消费者就必须等待生产者。为了解决这个问题于是引入了生产者和消费者模式。

什么是生产者消费者模式

生产者消费者模式是通过一个容器来解决生产者和消费者的强耦合问题。生产者和消费者彼此之间不直接通讯,而通过阻塞队列来进行通讯,所以生产者生产完数据之后不用等待消费者处理,直接扔给阻塞队列,消费者不找生产者要数据,而是直接从阻塞队列里取,阻塞队列就相当于一个缓冲区,平衡了生产者和消费者的处理能力。

4、生产者消费者模型总结

#程序中有两类角色

一类负责生产数据(生产者)

一类负责处理数据(消费者) #引入生产者消费者模型为了解决的问题是:

平衡生产者与消费者之间的速度差 #如何实现:

生产者-》队列——》消费者

#生产者消费者模型实现类程序的解耦和

5、实战

from multiprocessing import Process,Queue

import time,os

def producer(q,name):

for i in range(3):

time.sleep(1)

res='%s%s' %(name,i)

q.put(res)

print('\033[45m<%s> 生产了 [%s]\033[0m' %(os.getpid(),res)) def consumer(q):

while True:

res=q.get()

if res is None:break

time.sleep(1.5)

print('\033[34m<%s> 吃了 [%s]\033[0m' % (os.getpid(), res)) if __name__ == '__main__':

q=Queue()

#生产者们:即厨师们

p1=Process(target=producer,args=(q,'包子'))

p2=Process(target=producer,args=(q,'饺子'))

p3=Process(target=producer,args=(q,'馄饨')) #消费者们:即吃货们

c1=Process(target=consumer,args=(q,))

c2=Process(target=consumer,args=(q,)) p1.start()

p2.start()

p3.start()

c1.start()

c2.start() p1.join()

p2.join()

p3.join()

q.put(None)

q.put(None) print('主')

范例一

from multiprocessing import Process, JoinableQueue

import time, os def producer(q, name):

for i in range(3):

time.sleep(1)

res = '%s%s' % (name, i)

q.put(res)

print('\033[45m<%s> 生产了 [%s]\033[0m' % (os.getpid(), res))

q.join() def consumer(q):

while True:

res = q.get()

time.sleep(1.5)

print('\033[34m<%s> 吃了 [%s]\033[0m' % (os.getpid(), res))

q.task_done() if __name__ == '__main__':

q = JoinableQueue() # 生产者们:即厨师们

p1 = Process(target=producer, args=(q, '包子'))

p2 = Process(target=producer, args=(q, '饺子'))

p3 = Process(target=producer, args=(q, '馄饨')) # 消费者们:即吃货们

c1 = Process(target=consumer, args=(q,))

c2 = Process(target=consumer, args=(q,)) c1.daemon=True

c2.daemon=True

p1.start()

p2.start()

p3.start()

c1.start()

c2.start() p1.join() print('主')

范例二

7、共享数据

基于消息传递的并发编程是大势所趋 即便是使用线程,推荐做法也是将程序设计为大量独立的线程集合 通过消息队列交换数据。这样极大地减少了对使用锁定和其他同步手段的需求, 还可以扩展到分布式系统中

进程间通信应该尽量避免使用本节所讲的共享数据的方式

进程间数据是独立的,可以借助于队列或管道实现通信,二者都是基于消息传递的 虽然进程间数据独立,但可以通过Manager实现数据共享,事实上Manager的功能远不止于此

from multiprocessing import Process,Manager,Lock

# 不加锁,数据就乱了,是并行的

def task(dic):

dic['count'] -=1 if __name__ == '__main__':

m = Manager()

dic = m.dict({'count':100})

p_l = []

for i in range(100):

p = Process(target=task,args=(dic,))

p_l.append(p)

p.start()

for p in p_l:

p.join()

print(dic)

并行:不加锁顺序乱了

from multiprocessing import Process,Manager,Lock

# 加锁,保证数据安全(处理效率会低)

def task(dic,mutex):

with mutex:

dic['count'] -=1 if __name__ == '__main__':

mutex = Lock()

m = Manager()

dic = m.dict({'count':100})

p_l = []

for i in range(100):

p = Process(target=task,args=(dic,mutex))

p_l.append(p)

p.start()

for p in p_l:

p.join()

print(dic)

加锁,保证数据安全(处理效率会低)

8、进程池

在利用Python进行系统管理的时候,特别是同时操作多个文件目录,或者远程控制多台主机,并行操作可以节约大量的时间。多进程是实现并发的手段之一,需要注意的问题是:

- 很明显需要并发执行的任务通常要远大于核数

- 一个操作系统不可能无限开启进程,通常有几个核就开几个进程

- 进程开启过多,效率反而会下降(开启进程是需要占用系统资源的,而且开启多余核数目的进程也无法做到并行)

例如当被操作对象数目不大时,可以直接利用multiprocessing中的Process动态成生多个进程,十几个还好,但如果是上百个,上千个。。。手动的去限制进程数量却又太过繁琐,此时可以发挥进程池的功效。

我们就可以通过维护一个进程池来控制进程数目,比如httpd的进程模式,规定最小进程数和最大进程数...

ps:对于远程过程调用的高级应用程序而言,应该使用进程池,Pool可以提供指定数量的进程,供用户调用,当有新的请求提交到pool中时,如果池还没有满,那么就会创建一个新的进程用来执行该请求;但如果池中的进程数已经达到规定最大值,那么该请求就会等待,直到池中有进程结束,就重用进程池中的进程。

创建进程池的类:如果指定numprocess为3,则进程池会从无到有创建三个进程,然后自始至终使用这三个进程去执行所有任务,不会开启其他进程

Pool([numprocess [,initializer [, initargs]]]):创建进程池

1、参数介绍:

numprocess:要创建的进程数,如果省略,将默认使用cpu_count()的值

initializer:是每个工作进程启动时要执行的可调用对象,默认为None

initargs:是要传给initializer的参数组

2、方法介绍

p.apply(func [, args [, kwargs]]):在一个池工作进程中执行func(*args,**kwargs),然后返回结果。需要强调的是:此操作并不会在所有池工作进程中并执行func函数。如果要通过不同参数并发地执行func函数,必须从不同线程调用p.apply()函数或者使用p.apply_async()

p.apply_async(func [, args [, kwargs]]):在一个池工作进程中执行func(*args,**kwargs),然后返回结果。此方法的结果是AsyncResult类的实例,callback是可调用对象,接收输入参数。当func的结果变为可用时,将理解传递给callback。callback禁止执行任何阻塞操作,否则将接收其他异步操作中的结果。 p.close():关闭进程池,防止进一步操作。如果所有操作持续挂起,它们将在工作进程终止前完成

P.join():等待所有工作进程退出。此方法只能在close()或teminate()之后调用

基本用法

方法apply_async()和map_async()的返回值是AsyncResul的实例obj。实例具有以下方法

obj.get():返回结果,如果有必要则等待结果到达。timeout是可选的。如果在指定时间内还没有到达,将引发一场。如果远程操作中引发了异常,它将在调用此方法时再次被引发。

obj.ready():如果调用完成,返回True

obj.successful():如果调用完成且没有引发异常,返回True,如果在结果就绪之前调用此方法,引发异常

obj.wait([timeout]):等待结果变为可用。

obj.terminate():立即终止所有工作进程,同时不执行任何清理或结束任何挂起工作。如果p被垃圾回收,将自动调用此函数

其他方法(了解)

三、Python并发编程之多线程

一、多线程理论知识

1、什么是线程

在传统系统中,每个进程有一个地址空间,而且默认就有一个控制线程。

线程顾名思义,就是一条流水线工作的过程。线程的工作需要CPU。

进程只是用来把资源集中到一起(进程只是一个资源单位,或者说资源集合),而线程才是CPU上的执行单位。

多线程(即多个控制线程)的概念是在一个进程中存在多个控制线程,多个控制线程共享该进程的地址空间。相当于一个车间内有多条流水线,都共用一个车间的资源。

2、线程的创建开销小

1、创建进程与创建线程的开销

创建进程的开销远大于线程:创建一个进程,需要应用程序向CPU申请内存空间,这个空间至少有一个线程。

创建线程,是在已有的内存空间创建,无需申请内存空间,所以开销小。

2、进程之间是竞争关系,线程之间是协作关系

进程会抢占硬件和系统的资源,他们之间是竞争关系。

同一个进程的线程之间是合作关系,是同一个程序写的程序内开启的。

3、为何要用线程

多线程指的是,在一个进程中开启多个进程。简单地讲:若多个任务共用一块地址空间,那么必须在一个进程内开启多个线程。详细的讲,分为以下四点:

1、多线程共享一个进程的地址空间

2、线程比进程更轻量级,线程比进程更容易创建可撤销。在许多操作系统中,创建一个线程比创建一个进程要快10-100倍,在大量线程需要动态和快速修改时,这一特性很有用。

3、若多个线程都是cpu密集型的,那么并不能获得性能是个的增强,但是若存在大量的计算和大量的I/O处理,拥有多个线程允许这些活动彼此重叠运行,从而会加快程序执行的速度。

4、在多个cpu系统中,为了最大限度的利用多核,可以开启多个线程,比开进程开销小的多。(但这一条不适用于Python)

4、多线程的应用举例

开启一个字处理软件进程,该进程肯定需要办不止一件事情,比如监听键盘输入,处理文字,定时自动将文字保存到硬盘,这三个任务操作的都是同一块数据,因而不能用多进程。

只能在一个进程里并发地开启三个线程,如果是单线程,那就只能是,键盘输入时,不能处理文字和自动保存,自动保存时又不能输入和处理文字。

更多内容请参考:http://www.cnblogs.com/linhaifeng/articles/7430082.html

二、多线程实战部分

1、threading模块

threading模块完全模仿了multiprocess模块的接口,二者在使用层面,有很大的相似性。

详解介绍见官网链接:https://docs.python.org/3/library/threading.html?highlight=threading#

2、开启线程的两种方式

from threading import Thread

from multiprocessing import Process

import os

import time

import random

def task():

print('%s is running' %os.getpid())

time.sleep(random.randint(1,3))

print('%s is done' %os.getpid()) if __name__ == '__main__':

t = Thread(target=task,) ##开启线程,速度比较快,人感觉不到间隔

# t = Process(target=task,)

t.start()

print('主')

方式一:直接开

from threading import Thread

import os

import time

import random class Mythread(Thread):

def __init__(self,name):

super().__init__()

self.name = name

def run(self):

print('%s is running' %os.getpid())

time.sleep(random.randint(1,3))

print('%s is running' %os.getpid())

if __name__ == '__main__':

t = Mythread('线程1')

t.start()

print('主',os.getpid())

方式二:使用类

3、在一个进程下开启多个线程与一个进程下开启多个子进程的区别

from threading import Thread

from multiprocessing import Process

import os def work():

print('hello') if __name__ == '__main__':

#在主进程下开启线程

t1 = Thread(target=work,) t1.start()

print('主进程/主线程----------')

'''

打印结果:

hello

主进程/主线程

''' #主进程下开启子进程

t2 = Process(target=work)

t2.start() print('主进程/主线程')

'''

打印结果:

主进程/主线程

hello

'''

开启线程和开启进程的速度

from threading import Thread

from multiprocessing import Process

import os def work():

print('hello',os.getpid()) if __name__ == '__main__':

#在主进程下开启多个线程,每个线程都跟主进程的pid一样

t1 = Thread(target=work)

t2 = Thread(target=work)

t1.start()

t2.start()

print('主进程/主线程pid',os.getpid())

print('--------------------------') #开多个进程,每个进程都有不同的pid

p1 = Process(target=work)

p2 = Process(target=work) p1.start()

p2.start()

print('主进程/主线程pid',os.getpid())

查看主进程/主线程和子进程/线程的gid

from threading import Thread

from multiprocessing import Process

import os def work():

global n

n = 0 if __name__ == '__main__':

# n = 100

# p = Process(target=work)

# p.start()

# p.join()

# print('主',n) #毫无疑问自今年后才能p已经将自己的全局n改成了0,但改的仅仅是它自己的,查看父进程的n仍然为100 n = 1

t = Thread(target=work)

t.start()

t.join()

print('主',n) #查看结果为0,因为同一个进程内的线程之间共享进程内的数据

同一个进程内的线程共享该进程的数据

4、练习

练习一:使用多线程实现并发

import multiprocessing

import threading

import socket import socket

s = socket.socket(socket.AF_INET,socket.SOCK_STREAM) s.bind(('127.0.0.1',8081)) s.listen(5) def action(conn):

while True:

data = conn.recv(1024)

print(data)

conn.send(data.upper()) if __name__ == '__main__':

while True:

conn,addr = s.accept() p = threading.Thread(target=action,args=(conn,))

p.start()

server.py

import socket

s = socket.socket(socket.AF_INET,socket.SOCK_STREAM)

s.connect(('127.0.0.1',8081)) while True:

msg = input('>>').strip()

if not msg:continue s.send(msg.encode('utf-8'))

data = s.recv(1024)

print(data)

client.py

练习二:三个任务——一个接受用户输入,一个将用户输入的内容格式化成大写,一个将格式化后的结果存入文件

from threading import Thread

msg_l = []

format_l = [] def talk():

while True:

msg = input('>>'.strip())

if not msg:continue

msg_l.append(msg) def format_msg():

while True:

if msg_l:

res = msg_l.pop()

format_l.append(res.upper()) def save():

while True:

if format_l:

with open('db.txt','a',encoding='utf-8') as f:

res = format_l.pop()

f.write('%s\n' %res) if __name__ == '__main__':

t1 = Thread(target=talk,)

t2 = Thread(target=format_msg,)

t3 = Thread(target=save)

t1.start()

t2.start()

t3.start()

代码实现

5、线程相关的其他方法

Thread实例对象的方法

# isAlive(): 返回线程是否活动的。

# getName(): 返回线程名。

# setName(): 设置线程名。 threading模块提供的一些方法:

# threading.currentThread(): 返回当前的线程变量。

# threading.enumerate(): 返回一个包含正在运行的线程的list。正在运行指线程启动后、结束前,不包括启动前和终止后的线程。

# threading.activeCount(): 返回正在运行的线程数量,与len(threading.enumerate())有相同的结果。

from threading import Thread

import threading

from multiprocessing import Process

import os

def work():

import time

time.sleep(3)

print(threading.current_thread().getName()) if __name__ == '__main__':

# 在主进程下开启线程

t = Thread(target=work,)

t.start() print(threading.current_thread().getName()) #返回线程名

print(threading.current_thread()) ##主线程

print(threading.enumerate()) ##连同主线程在内有两个运行的线程

print(threading.active_count()) #返回正在运行的线程的数量

print('主进程/主线程') '''

####返回的结果

MainThread

<_MainThread(MainThread, started 11772)>

[<_MainThread(MainThread, started 11772)>, <Thread(Thread-1, started 4720)>]

2

主进程/主线程

Thread-1

'''

实战一

主线程等待子线程结束

from threading import Thread

import time def say(name):

time.sleep(2)

print('%s say hello' %name) if __name__ == '__main__':

t = Thread(target=say,args=('engon',))

t.start()

t.join()

print('主线程')

print(t.is_alive()) '''

##返回的结果

engon say hello

主线程

主线程等待子线程结束

6、守护线程

无论是进程还是线程,都遵循:守护xxx线程会等待主xxx线程运行完毕后被销毁

需要强调的是:运行完毕并终止运行

对进程来说,运行完毕指的是主进程代码

对主线程来说,运行完毕指的是主线程所在的进程内所有非守护线程统统完毕,主线程才算运行完毕

详细解释

主进程在其代码结束后,就已经算运行完毕了(守护进程在此时就被回收),然后主进程会一直等非守护的子进程都运行完毕后,回收子进程的资源(否则会产生僵尸进程),才会结束

2 主进程在其他非守护线程运行完毕后才算运行完毕(守护线程在此时就被回收)。因为线程的结束意味着进程的结束,进程整体的资源都将被回收,而进程必须保证非守护线程都运行完毕才能结束。

from threading import Thread

import os

import time

import random def task():

print('%s is running' %os.getpid())

time.sleep(random.randint(1,3))

print('%s is done' %os.getpid()) if __name__ == '__main__':

t = Thread(target=task,)

t.daemon=True

t.start() ##开线程比较快,瞬间可以完。开完直接运行下面的代码

print('主') ##守护线程在主线程停止后,立马停止

主线程和一个守护线程

from threading import Thread

import time

def foo():

print(123)

time.sleep(4)

print("end123") def bar():

print(456)

time.sleep(3)

print("end456") if __name__ == '__main__':

t1=Thread(target=foo)

t2=Thread(target=bar) t1.daemon=True

t1.start()

t2.start()

print("main-------")

一个主线程、一个守护线程和其他线程

7、Python GIL(global interpreter Lock)

1、GIL介绍

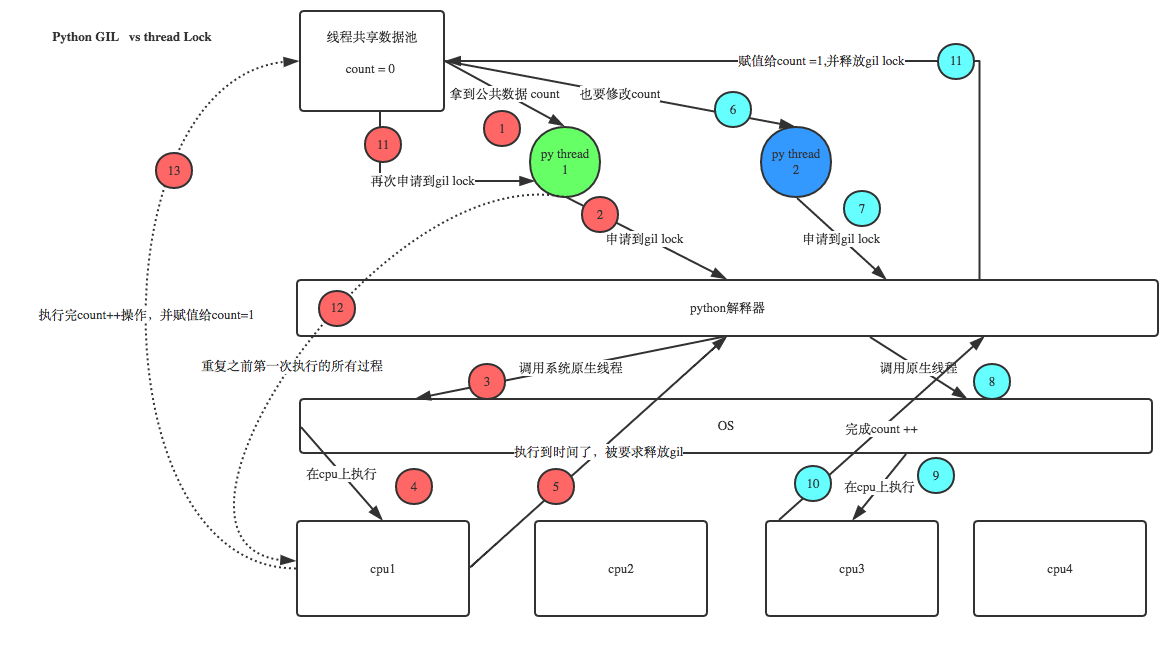

在Cpython解释器中,同一个进程下开启的多线程,同一时刻只能有一个线程执行,无法利用多核优势

这篇文章透彻的剖析了GIL对python多线程的影响,强烈推荐看一下: http://www.dabeaz.com/python/UnderstandingGIL.pdf

GIL本质就是一把互斥锁,既然是互斥锁,所有互斥锁的本质都一样,都是将并发运行变成串行,以此来控制同一时间内共享数据只能被一个任务所修改,进而保证数据安全。

保证不同的数据安全,就应该加不同的锁。

在Python的进程内,不仅有程序主线程或者改主线程开启的其他线程,还有解释器开启的垃圾回收等解释器界别的线程(所有线程都运行在一个进程中)

所有数据都是共享的,这其中,代码作为一种数据也是被所有线程共享的

2 所有线程的任务,都需要将任务当做参数传给解释器的代码去执行,即所有的线程要想运行自己的任务,首先需要解决的是能够访问到解释器的代码

多个线程先访问到解释器的代码,即拿到执行权限,然后将target的代码交给解释器去执行

解释器的代码是所有线程共享的,所有垃圾回收线程也可能访问到解释器的代码而去执行,这导致了一个问题:对于同一数据100,可能线程1执行x=100的同时,而垃圾回收执行100的操作,解决这种问题就是枷锁处理。保证Python解释器同一时间只能执行一个任务的代码

2、GIL与Lock

GIL保护的是解释器级的数据,保护用户自己的数据则需要自己枷锁处理,如下图

3、GIL与多线程

有了GIL的存放,同一时刻同一进程中只有一个线程执行

问题:Python进程可以利用多核,但是开销大;而Python多线程开销小,但却无法利用多核优势。

解决这个问题,需要再几个点上达成一致:

CPU到底是用来计算的,还是用来用I/O的?

多CPU意味着可以有多个核并行完成计算,所以多个核并行完成计算,所以多核提升的是计算性能。

每个CPU一旦遇到I/O阻塞,仍然需要等待,所以多核对I/O操作没什么用处。

结论:

对计算来说,CPU越多越好,但是对于I/O来说,再多的CPU也没用

对运行一个程序来说,随着cpu的增多执行效率肯定有所提高。因为一个程序不会是纯计算或纯I/O型的,所以我们只能相对的去看一个程序到底是计算密集型还是I/O密集型的,从而进一步分析Python的多线程到底有无用武之地。

一、分析

我们有四个任务需要处理,处理方式肯定是要玩出并发的效果,解决方案:

方案一:开启四个进程

方案二:一个进程下,开启四个线程 二、单核情况下,分析结果

若四个任务是计算密集型,没有多核来并行计算,方案一徒增了创建进程的开销,方案二更优

若四个任务是I/O密集型,方案一创建进程的开销大,且进程的切换速度远不如线程,方案二更优 三、多核情况下,分析结果

若四个任务是计算密集型,多核意味着并行计算,在Python中一个进程同一时刻只有一个线程执行,用不上多核,方案一更优

若四个任务是I/O密集型,再多的核也解决不了I/O问题,方案二更优 四、结论

现在的计算机上都是多核,Python对于计算密集型的任务开多线程的效率并不能带来多大性能上的提升,甚至不如串行(没有大量切换);但对于I/0密集型的任务效率还是显著提升的。

4、多线程性能测试

rom multiprocessing import Process

from threading import Thread

import os

import time def work():

res = 0

for i in range(1000000):

res *=i if __name__ == '__main__':

l = []

print(os.cpu_count()) ##查看cpu的核数

start = time.time()

for i in range(50):

# p = Process(target=work,) ##进程运行时间3.547938108444214 运行时间长,消耗系统资源多

p = Thread(target=work,) ##线程运行时间 2.401473045349121 运行时间短,消耗系统资源少

l.append(p)

p.start() for p in l:

p.join()

stop = time.time() print('run time is %s' %(stop -start))

计算密集型的程序:多进程效率高

from multiprocessing import Process

from threading import Thread

import threading

import os

import time

def work():

time.sleep(2) if __name__ == '__main__':

l = []

print(os.cpu_count()) #查看本机cpu核数

start =time.time()

for i in range(50):

# p = Process(target=work,) ##进程运行时间4.241140365600586 运行时间长,消耗系统资源多

p = Thread(target=work, ) ##线程运行时间 2.0055272579193115运行时间短,消耗系统资源少

l.append(p)

p.start() for p in l:

p.join()

stop = time.time() print('run time is %s' % (stop - start))

I/O密集型的程序:多线程效率高

5、应用

多线程用于I/O密集型业务:如socket,爬虫,web程序

多进程用于计算型密集型业务:如金融分析(数据分析)

8、同步锁(互斥锁)

需要注意的:

- 线程抢的是GIL锁,GIL锁相当于执行权限,拿到了执行权限后才能拿到 互斥锁Lock,其他线程也可以抢到GIL,但若没有Lock仍然没有被释放则阻塞,即便是拿到执行权限GIL也要立即交出来

- join是等待所有,即整体串行,而锁住修改共享数据的部分,即部分串行,要想保证数据安全的根本原理在于让并发变成串行,join与互斥锁都可以实现,毫无疑问,互斥锁的部分串行效率要更高

- 注意GIL和互斥锁的经典分析

1、GIL和Lock

Python已经有了一个GIL来保证同一时间只能执行一个线程了,为什么还需要有Lock?

需要知晓的是:锁的目的是为了保护共享的数据,同一时间只能有一个线程来修改共享的数据。保护不同的数据就应该加不同的锁。

GIL和Lock是两把锁,保护的数据不一样,前者是解释器级别的(保护的是解释器级别的数据,比如垃圾回收的数据),后者是保护用户自己开发的应用程序的数据,很明显GIL不负责这件事,只能用户自定义加锁处理。

锁通常被用来实现对共享资源的同步访问。为每一个共享资源创建一个Lock对象,当你需要访问该资源时,调用acquire方法来获取锁对象(如果其它线程已经获得了该锁,则当前线程需等待其被释放),待资源访问完后,再调用release方法释放锁:

from threading import Thread,Lock

import os,time

def work():

global n

lock.acquire()

temp=n

time.sleep(0.1)

n=temp-1

lock.release()

if __name__ == '__main__':

lock=Lock()

n=100

l=[]

for i in range(100):

p=Thread(target=work)

l.append(p)

p.start()

for p in l:

p.join() print(n) #结果肯定为0,由原来的并发执行变成串行,牺牲了执行效率保证了数据安全

加锁练习

100个线程去抢GIL锁,即抢执行权限

肯定有一个线程先抢到GIL(暂且称为线程1),然后开始执行,一旦执行就会拿到lock.acquire()

极有可能线程1还未运行完毕,就有另外一个线程2抢到GIL,然后开始运行,但线程2发现互斥锁lock还未被线程1释放,于是阻塞,被迫交出执行权限,即释放GIL

直到线程1重新抢到GIL,开始从上次暂停的位置继续执行,直到正常释放互斥锁lock,然后其他的线程再重复2 3 4的过程

#不加锁:并发执行,速度快,数据不安全

from threading import current_thread,Thread,Lock

import os,time

def task():

global n

print('%s is running' %current_thread().getName())

temp=n

time.sleep(0.5)

n=temp-1 if __name__ == '__main__':

n=100

lock=Lock()

threads=[]

start_time=time.time()

for i in range(100):

t=Thread(target=task)

threads.append(t)

t.start()

for t in threads:

t.join() stop_time=time.time()

print('主:%s n:%s' %(stop_time-start_time,n)) '''

Thread-1 is running

Thread-2 is running

......

Thread-100 is running

主:0.5216062068939209 n:99

''' #不加锁:未加锁部分并发执行,加锁部分串行执行,速度慢,数据安全

from threading import current_thread,Thread,Lock

import os,time

def task():

#未加锁的代码并发运行

time.sleep(3)

print('%s start to run' %current_thread().getName())

global n

#加锁的代码串行运行

lock.acquire()

temp=n

time.sleep(0.5)

n=temp-1

lock.release() if __name__ == '__main__':

n=100

lock=Lock()

threads=[]

start_time=time.time()

for i in range(100):

t=Thread(target=task)

threads.append(t)

t.start()

for t in threads:

t.join()

stop_time=time.time()

print('主:%s n:%s' %(stop_time-start_time,n)) '''

Thread-1 is running

Thread-2 is running

......

Thread-100 is running

主:53.294203758239746 n:0

''' #有的同学可能有疑问:既然加锁会让运行变成串行,那么我在start之后立即使用join,就不用加锁了啊,也是串行的效果啊

#没错:在start之后立刻使用jion,肯定会将100个任务的执行变成串行,毫无疑问,最终n的结果也肯定是0,是安全的,但问题是

#start后立即join:任务内的所有代码都是串行执行的,而加锁,只是加锁的部分即修改共享数据的部分是串行的

#单从保证数据安全方面,二者都可以实现,但很明显是加锁的效率更高.

from threading import current_thread,Thread,Lock

import os,time

def task():

time.sleep(3)

print('%s start to run' %current_thread().getName())

global n

temp=n

time.sleep(0.5)

n=temp-1 if __name__ == '__main__':

n=100

lock=Lock()

start_time=time.time()

for i in range(100):

t=Thread(target=task)

t.start()

t.join()

stop_time=time.time()

print('主:%s n:%s' %(stop_time-start_time,n)) '''

Thread-1 start to run

Thread-2 start to run

......

Thread-100 start to run

主:350.6937336921692 n:0 #耗时是多么的恐怖

'''

互斥锁与join的区别(重点!!!)

9、死锁现象与递归锁

进程也有死锁与递归锁。

1、死锁

所谓死锁:是指两个或两个以上的进程或线程在执行过程中,因争夺资源而造成的一种互相等待的现象,若无外力作用,它们无法推进下去。此时称系统处于死锁状态或系统产生了死锁,这些永远在互相等待的进程称为死锁进程。

from threading import Thread,Lock,current_thread,RLock

import time mutexA = Lock()

mutexB = Lock()

# mutexA = mutexB = RLock() class Mythead(Thread):

def run(self):

self.f1()

self.f2() def f1(self):

mutexA.acquire()

print('%s 拿到了A锁' % self.name) # 同 current_thread().getName() mutexB.acquire()

print('%s 拿到了B锁' % self.name) mutexB.release()

mutexA.release() def f2(self):

mutexB.acquire()

print('%s 拿到了B锁' % self.name) # 同 current_thread().getName()

time.sleep(0.2)

mutexA.acquire()

print('%s 拿到了A锁' % self.name) mutexA.release()

mutexB.release() if __name__ == '__main__':

for i in range(10):

t = Mythead()

t.start() '''

#返回下面的内容,就卡住了

Thread-1 拿到了A锁

Thread-1 拿到了B锁

Thread-1 拿到了B锁

Thread-2 拿到了A锁

'''

死锁

解决产生死锁卡住的方法:使用递归锁,在Python中为了支持在同一线程中多次请求同一资源,Python提供了可重入锁Rlock。

这个Rloclk内部维护着一个Lock和一个conuter变量,counter记录了acquire的次数,从而使得资源可以被多次require。直到一个线程所有的acquire都被release,其他的线程才能获得资源。上面的例子若使用Rlock代替lock,则不会发生死锁:

mutexA=mutexB=threading.RLock() #一个线程拿到锁,counter加1,该线程内又碰到加锁的情况,则counter继续加1,这期间所有其他线程都只能等待,等待该线程释放所有锁,即counter递减到0为止

10、信号量Semaphore

同进程一样

Semaphore管理一个内置的计数器,每当调用acquire()时内置计数器-1;调用release()时内置计数器+1,;计数器不能小于0;当计数器为0时,acquire()将阻塞线程直到其他线程调用release().

from threading import Thread,Semaphore,current_thread

import time,random sm=Semaphore(5)

def task():

with sm:

print('%s 正在上厕所' %current_thread().getName())

time.sleep(random.randint(1,3)) if __name__ == '__main__':

for i in range(20):

t=Thread(target=task)

t.start()

信号量实战

from threading import Thread,Semaphore,current_thread

from concurrent.futures import ThreadPoolExecutor

import time,random def task(id):

print('%s 正在上厕所' %current_thread().getName())

time.sleep(random.randint(1,3)) if __name__ == '__main__':

t=ThreadPoolExecutor(5)

# for i in range(20):

# t.submit(task,i) t.map(task,range(20))

t.shutdown(wait=True)

注意map的用法

与进程池是完全不同的概念,进程池Pool(4),最大只能产生4个进程,而且从头到尾都只是这四个进程,不会产生新的,而信号量是产生一堆线程/进程

10、定时器

指定n秒后执行某操作

from threading import Timer def hello(id):

print("hello world",id) t = Timer(1,hello,args=(30,)) ##疑惑:定时器是否可以自定义时间(还是单位只能是s) t.start() # after 1 seconds, "hello, world" will be printed

11、线程queue

1、堆栈:后进先出

class queue.LifoQueue(maxsize=0) #last in fisrt out

import queue q = queue.LifoQueue()

q.put('first')

q.put(2)

q.put(3) print(q.get())

print(q.get())

print(q.get()) '''

结果

3

2

first

'''

堆栈

2、队列:先进先出

class queue.Queue(maxsize=0) #先进先出

import queue

# 放元素

q = queue.Queue()

q.put('')

q.put(2)

q.put(3)

# 取元素

print(q.get())

print(q.get())

print(q.get()) '''

结果

1

2

3

'''

队列

3、优先级设置

class queue.PriorityQueue(maxsize=0) #存储数据时可设置优先级的队列

put进入一个元组,元组第一个元素是优先级(通常是数字,也可以是非数字之间的比较),数字越小优先级越高

import queue

q = queue.PriorityQueue() q.put((10,'a'))

q.put((5,'b'))

q.put((20,'c')) print(q.get())

print(q.get())

print(q.get()) '''

结果如下

(5, 'b')

(10, 'a')

(20, 'c')

'''

队列优先级

4、其他

Constructor for a priority queue. maxsize is an integer that sets the upperbound limit on the number of items that can be placed in the queue. Insertion will block once this size has been reached, until queue items are consumed. If maxsize is less than or equal to zero, the queue size is infinite. The lowest valued entries are retrieved first (the lowest valued entry is the one returned by sorted(list(entries))[0]). A typical pattern for entries is a tuple in the form: (priority_number, data). exception queue.Empty

Exception raised when non-blocking get() (or get_nowait()) is called on a Queue object which is empty. exception queue.Full

Exception raised when non-blocking put() (or put_nowait()) is called on a Queue object which is full. Queue.qsize()

Queue.empty() #return True if empty

Queue.full() # return True if full

Queue.put(item, block=True, timeout=None)

Put item into the queue. If optional args block is true and timeout is None (the default), block if necessary until a free slot is available. If timeout is a positive number, it blocks at most timeout seconds and raises the Full exception if no free slot was available within that time. Otherwise (block is false), put an item on the queue if a free slot is immediately available, else raise the Full exception (timeout is ignored in that case). Queue.put_nowait(item)

Equivalent to put(item, False). Queue.get(block=True, timeout=None)

Remove and return an item from the queue. If optional args block is true and timeout is None (the default), block if necessary until an item is available. If timeout is a positive number, it blocks at most timeout seconds and raises the Empty exception if no item was available within that time. Otherwise (block is false), return an item if one is immediately available, else raise the Empty exception (timeout is ignored in that case). Queue.get_nowait()

Equivalent to get(False). Two methods are offered to support tracking whether enqueued tasks have been fully processed by daemon consumer threads. Queue.task_done()

Indicate that a formerly enqueued task is complete. Used by queue consumer threads. For each get() used to fetch a task, a subsequent call to task_done() tells the queue that the processing on the task is complete. If a join() is currently blocking, it will resume when all items have been processed (meaning that a task_done() call was received for every item that had been put() into the queue). Raises a ValueError if called more times than there were items placed in the queue. Queue.join() block直到queue被消费完毕

其他

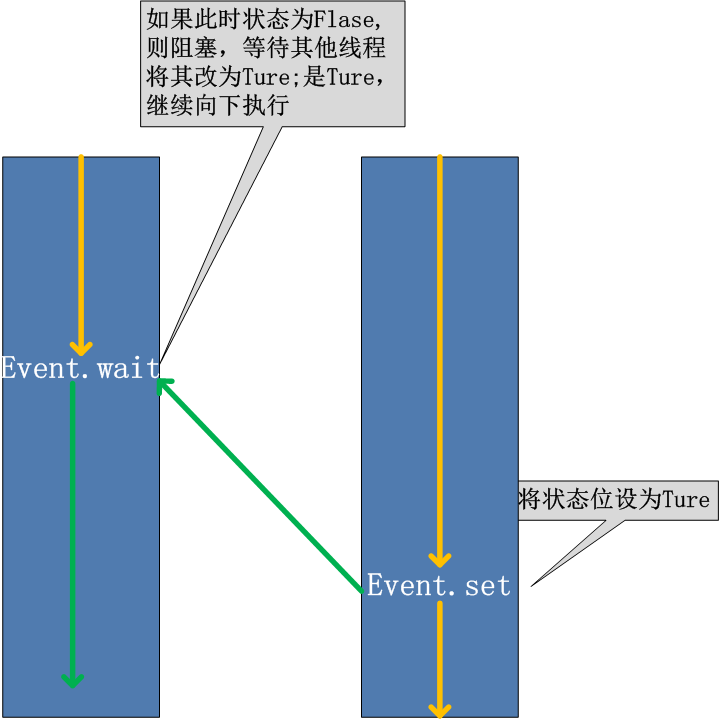

12、事件

线程的一个关键特性是每个线程都是独立运行切状态不可预测。若程序中的其他线程需要判断某个线程的状态来确定自己下一步的操作,这时线程同步问题就会变得非常棘手。

为了解决这些问题,我们需要使用threading库中的Event对象中的信号标志被设置为假。若有线程等待一个Event对象,而这个Event对象的标志为假,那么这个线程将会被一直阻塞直至为真。一个线程若将一个Event对象的信号标志设置为真,它将唤醒所有等待这个Event对象的线程。若一个线程等待一个呗设置为真的Event对象,那么它将忽略这个事件,继续执行。

event.isSet() :返回event的状态值

event.wait() :若event.isSet() == Flase将阻塞线程

event.set() :设置event的状态值为True,所有阻塞池的线程激活进入就绪状态,等待操作系统调度

event.clear() :恢复event的状态值为False。

例如,有多个工作线程尝试链接MySQL,我们想要在链接前确保MySQL服务正常才让那些工作线程去连接MySQL服务器,如果连接不成功,都会去尝试重新连接。那么我们就可以采用threading.Event机制来协调各个工作线程的连接操作

from threading import Thread,Event

import threading

import time,random def conn_mysql():

count = 1

while not event.is_set():

if count > 3:

raise TimeoutError('链接超时')

print('<%s> 第%s次尝试链接' %(threading.current_thread().getName(),count))

event.wait()

count += 1

print('<%s>链接成功' %threading.current_thread().getName()) def check_mysql():

print('[%s]正在检查mysql' %threading.current_thread().getName())

time.sleep(random.randint(2,4))

event.set() if __name__ == '__main__':

event = Event()

conn1 = Thread(target=conn_mysql)

conn2 = Thread(target=conn_mysql)

check = Thread(target=check_mysql) conn1.start()

conn2.start()

check.start()

13、条件Condition(了解)

使得线程等待,只有满足某条件时,才会释放n个线程

import threading

def run(n):

conn.acquire()

conn.wait()

print("run the thread: %s" %n)

conn.release() if __name__ == '__main__':

conn = threading.Condition()

for i in range(10):

t = threading.Thread(target=run,args=(i,))

t.start() while True:

inp = input('>>>')

if inp == 'q':

break

conn.acquire()

conn.notify(int(inp))

conn.release()

实例一

import threading

def condition_func(): ret = False

inp = input('>>>')

if inp == '':

ret = True return ret def run(n):

con.acquire()

con.wait_for(condition_func)

print("run the thread: %s" %n)

con.release() if __name__ == '__main__': con = threading.Condition()

for i in range(10):

t = threading.Thread(target=run, args=(i,))

t.start()

实例二

14、Python标准模块—concurrent.futures

https://docs.python.org/dev/library/concurrent.futures.html

#1 介绍

concurrent.futures模块提供了高度封装的异步调用接口

ThreadPoolExecutor:线程池,提供异步调用

ProcessPoolExecutor: 进程池,提供异步调用

Both implement the same interface, which is defined by the abstract Executor class. #2 基本方法

#submit(fn, *args, **kwargs)

异步提交任务 #map(func, *iterables, timeout=None, chunksize=1)

取代for循环submit的操作 #shutdown(wait=True)

相当于进程池的pool.close()+pool.join()操作

wait=True,等待池内所有任务执行完毕回收完资源后才继续

wait=False,立即返回,并不会等待池内的任务执行完毕

但不管wait参数为何值,整个程序都会等到所有任务执行完毕

submit和map必须在shutdown之前 #result(timeout=None)

取得结果 #add_done_callback(fn)

回调函数

#介绍

The ProcessPoolExecutor class is an Executor subclass that uses a pool of processes to execute calls asynchronously. ProcessPoolExecutor uses the multiprocessing module, which allows it to side-step the Global Interpreter Lock but also means that only picklable objects can be executed and returned. class concurrent.futures.ProcessPoolExecutor(max_workers=None, mp_context=None)

An Executor subclass that executes calls asynchronously using a pool of at most max_workers processes. If max_workers is None or not given, it will default to the number of processors on the machine. If max_workers is lower or equal to 0, then a ValueError will be raised. #用法

from concurrent.futures import ThreadPoolExecutor,ProcessPoolExecutor import os,time,random

def task(n):

print('%s is runing' %os.getpid())

time.sleep(random.randint(1,3))

return n**2 if __name__ == '__main__': executor=ProcessPoolExecutor(max_workers=3) futures=[]

for i in range(11):

future=executor.submit(task,i)

futures.append(future)

executor.shutdown(True)

print('+++>')

for future in futures:

print(future.result())

ProcessPoolExecutor

#介绍

ThreadPoolExecutor is an Executor subclass that uses a pool of threads to execute calls asynchronously.

class concurrent.futures.ThreadPoolExecutor(max_workers=None, thread_name_prefix='')

An Executor subclass that uses a pool of at most max_workers threads to execute calls asynchronously. Changed in version 3.5: If max_workers is None or not given, it will default to the number of processors on the machine, multiplied by 5, assuming that ThreadPoolExecutor is often used to overlap I/O instead of CPU work and the number of workers should be higher than the number of workers for ProcessPoolExecutor. New in version 3.6: The thread_name_prefix argument was added to allow users to control the threading.Thread names for worker threads created by the pool for easier debugging. #用法

与ProcessPoolExecutor相同

ThreadPoolExecutor

from concurrent.futures import ThreadPoolExecutor,ProcessPoolExecutor import os,time,random

def task(n):

print('%s is runing' %os.getpid())

time.sleep(random.randint(1,3))

return n**2 if __name__ == '__main__': executor=ThreadPoolExecutor(max_workers=3) # for i in range(11):

# future=executor.submit(task,i) executor.map(task,range(1,12)) #map取代了for+submit

map的用法

from concurrent.futures import ThreadPoolExecutor,ProcessPoolExecutor

from multiprocessing import Pool

import requests

import json

import os def get_page(url):

print('<进程%s> get %s' %(os.getpid(),url))

respone=requests.get(url)

if respone.status_code == 200:

return {'url':url,'text':respone.text} def parse_page(res):

res=res.result()

print('<进程%s> parse %s' %(os.getpid(),res['url']))

parse_res='url:<%s> size:[%s]\n' %(res['url'],len(res['text']))

with open('db.txt','a') as f:

f.write(parse_res) if __name__ == '__main__':

urls=[

'https://www.baidu.com',

'https://www.python.org',

'https://www.openstack.org',

'https://help.github.com/',

'http://www.sina.com.cn/'

] # p=Pool(3)

# for url in urls:

# p.apply_async(get_page,args=(url,),callback=pasrse_page)

# p.close()

# p.join() p=ProcessPoolExecutor(3)

for url in urls:

p.submit(get_page,url).add_done_callback(parse_page) #parse_page拿到的是一个future对象obj,需要用obj.result()拿到结果

回调函数

四、Python并发编程之协程

一、引子

线程才是程序的执行单位。

基于当线程来实现并发,即用一个主线程下实现并发。

上下文切换:当CPU从执行一个线程切换到执行另外一个线程的时候,它需要先存储当前线程的本地的数据,程序指针等,然后载入另一个线程的本地数据,程序指针等,最后才开始执行。这种切换称为“上下文切换”(“context switch”)。CPU会在一个上下文中执行一个线程,然后切换到另外一个上下文中执行另外一个线程,上下文切换并不廉价。如果没有必要,应该减少上下文切换的发生

进程: 一个程序需要运行所需的资源的集合

每个进程数据是独立的

每个进程里至少有一个线程

每个进程里有可以多有个线程

线程数据是共享的

进程间共享数据的代价是高昂的,所以要尽量避免进程间的数据共享

线程间的数据本来就是共享的

并发的本质:切换+保持状态

CPU切换任务的两种情况:一种情况是任务发生了阻塞,另外一种情况是该任务计算的时间过长。

第二种情况并不能提升效率:若多个任务都是纯计算的,任务切换反而会降低效率。可以使用yeild来验证。

yiled可以保存状态,yield的状态保存与操作系统的保存线程状态很像,但是yield是代码级别控制的,更轻量级

send可以把一个函数的结果传给另外一个函数,以此实现单线程内程序之间的切换

# 串行执行

import time

def consumer(res):

'''任务1:接收数据,处理数据'''

pass def producer():

'''任务2:生产数据'''

res = []

for i in range(100000):

res.append(i)

return res start = time.time()

res = producer()

consumer(res) ##consumer(producer)会降低效率

stop = time.time()

print(stop - start) #0.013000726699829102 # 基于yeild实现并发执行 import time

def consumer():

'''任务1:接收数据,处理数据'''

while True:

x = yield

def producer():

'''任务2:生产数据'''

g = consumer()

next(g)

for i in range(100000):

g.send(i) start = time.time()

##yeild保存状态,实现两个任务之间直接来回切换,达到并发的效果

producer()

stop = time.time()

print(stop - start) ##.057003021240234375

任务切换有可能反而会降低效率

第一情况的切换。在任务一遇到IO情况下,切换任务二区执行,这样就可以利用任务一阻塞的时间完成任务二的计算,效率的提升就在于此。

import time

def consumer():

'''任务1:接收数据,处理数据'''

while True:

x = yield

def producer():

'''任务2:生产数据'''

g = consumer()

next(g)

for i in range(100000):

g.send(i)

time.sleep(2)

start = time.time()

producer() ##并发执行,但是任务producer遇到io就会阻塞住,并不会切换到该线程内的其他任务执行

stop = time.time()

print(stop - start)

yeild并不能实现遇到I0切换(会一直卡住)

协程的本质就是在单线程下,由用户自己控制一个任务遇到IO阻塞了就切换到另一个任务去执行,以此来提升效率。

为了实现它,我们需要找一中可以同时满足以下条件的解决方案:

可以控制多个任务之间的切换,切换之前将任务的状态保存下来,以便重新运行时,可以基于暂停的位置继续执行

可以检测IO操作,再遇到IO的情况下才发生切换

二、协程介绍

协程:是单线程下的并发,又称微线程,纤程。英文名Coroutine。一句话说明什么是线程:协程是一种用户态的轻量级线程,即协程是由用户程序自己控制调度的。

1、需要强调的是

1. python的线程属于内核级别的,即由操作系统控制调度(如单线程遇到io或执行时间过长就会被迫交出cpu执行权限,切换其他线程运行)

2. 单线程内开启协程,一旦遇到io,就会从应用程序级别(而非操作系统)控制切换,以此来提升效率(!!!非io操作的切换与效率无关)

2、对比操作系统控制线程的切换,用户在单线程内控制协程的切换

优点:

1. 协程的切换开销更小,属于程序级别的切换,操作系统完全感知不到,因而更加轻量级

2. 单线程内就可以实现并发的效果,最大限度地利用cpu

缺点:

1. 协程的本质是单线程下,无法利用多核,可以是一个程序开启多个进程,每个进程内开启多个线程,每个线程内开启协程

2. 协程指的是单个线程,因而一旦协程出现阻塞,将会阻塞整个线程

3、协程的特点

必须在只有一个单线程里实现并发

修改共享数据不需加锁

用户程序里自己保存多个控制流的上下文栈

附加:一个协程遇到IO操作自动切换到其它协程(如何实现检测IO,yield、greenlet都无法实现,就用到了gevent模块(select机制))

三、Greenlet

若单线程下任务过多,使用yeild生成器的方式过于麻烦(需要先得到初始化一次的生成器,然后再调用send)。有更简单方便的方式:使用greenlet模块可以简单地实现多个任务之间的切换。

1、安装模块

pip3 install greenlet

2、使用实例

#导入greenlet里面的greenlet类

from greenlet import greenlet def eat(name):

print('%s eat 1' %name)

g2.switch('alex')

print('%s eat 2' %name)

g2.switch()

def paly(name):

print('%s paly 1' %name)

g1.switch()

print('%s paly 2' %name) g1 = greenlet(eat)

g2 = greenlet(paly) '''

结果:

alex eat 1

alex paly 1

alex eat 2

alex paly 2

'''

greenlet使用

3、单纯的切换(在没有IO的情况下或者没哟重复开辟内存空间的操作),反而会降低程序的速度

# 串行执行

import time

def f1():

res = 1

for i in range(10000000):

res += i def f2():

res = 1

for i in range(10000000):

res *= i

start = time.time()

f1()

f2()

stop = time.time()

print('run time is %s' %(stop - start)) #1.6420936584472656 # 并发执行

from greenlet import greenlet

import time def f1():

res = 1

for i in range(10000000):

res += i

g2.switch() def f2():

res = 1

for i in range(10000000):

res *= 1

g1.switch()

start = time.time()

g1=greenlet(f1)

g2=greenlet(f2)

g1.switch()

stop=time.time()

print('run time is %s' %(stop - start)) #8.826504707336426

greenlet还是没有解决遇到IO自动切换来提升效率的问题。

四、Gevent

1、介绍

gevent是一个第三方库,可以轻松通过gevent实现并发同步与异步编程,在gevent中用到的主要模式是Greenlet, 它是以C扩展模块形式接入Python的轻量级协程。 Greenlet全部运行在主程序操作系统进程的内部,但它们被协作式地调度。

2、安装和用法

pip3 install gevent

用法

g1=gevent.spawn(func,1,,2,3,x=4,y=5)创建一个协程对象g1,spawn括号内第一个参数是函数名,如eat,后面可以有多个参数,可以是位置实参或关键字实参,都是传给函数eat的 g2=gevent.spawn(func2) g1.join() #等待g1结束 g2.join() #等待g2结束 #或者上述两步合作一步:gevent.joinall([g1,g2]) g1.value#拿到func1的返回值

3、遇到IO阻塞时会自动切换任务

gevent.sleep(2)模拟的是gevent可以识别的io阻塞,而time.sleep(2)或其他的阻塞,gevent是不能直接识别的需要用下面一行代码,打补丁,就可以识别了

import gevent

def eat(name):

print('%s eat 1' %name)

gevent.sleep(2)

print('%s eat 2' %name) def play(name):

print('%s play 1' %name)

gevent.sleep(1)

print('%s play 2' %name) g1=gevent.spawn(eat,'egon')

g2=gevent.spawn(play,name='egon')

g1.join()

g2.join()

#或者gevent.joinall([g1,g2])

print('主'

遇到IO阻塞自动切换

from gevent import monkey;monkey.patch_all()必须放到被打补丁者的前面,如time,socket模块之前

或者我们干脆记忆成:要用gevent,需要将from gevent import monkey;monkey.patch_all()放到文件的开头

from gevent import monkey;monkey.patch_all() import gevent

import time

def eat():

print('eat food 1')

time.sleep(2)

print('eat food 2') def play():

print('play 1')

time.sleep(1)

print('play 2') g1=gevent.spawn(eat)

g2=gevent.spawn(play_phone)

gevent.joinall([g1,g2])

print('主')

我们可以用threading.current_thread().getName()来查看每个g1和g2,查看的结果为DummyThread-n,即假线程

4、gevent之同步与异步

from gevent import spawn,joinall,monkey;monkey.patch_all() import time

def task(pid):

time.sleep(0.5)

print('task %s done' %pid) def synchronous():

'''同步'''

for i in range(10):

task(i) def asynchronous():

'''异步'''

g_l = [spawn(task,i) for i in range(10)]

joinall(g_l) if __name__ == '__main__':

print('Synchronous:')

synchronous() print('Asynchronous:')

asynchronous()

'''

程序的重要部分是将task函数封装到Greenlet内部线程的gevent.spawn。 初始化的greenlet列表存放在数组threads中,此数组被传给gevent.joinall 函数,后者阻塞当前流程,并执行所有给定的greenlet。执行流程只会在 所有greenlet执行完后才会继续向下走

'''

gevent之同步与异步

5、gevent之应用举例一:协程应用——爬虫

from gevent import monkey;monkey.patch_all()

import gevent

import requests

import time def get_page(url):

print('Get:%s' %url)

response = requests.get(url)

if response.status_code == 200:

print('%d bytes received from %s' %(len(response.text),url)) start_time = time.time() gevent.joinall([

gevent.spawn(get_page,'https://www.python.org/'),

gevent.spawn(get_page,'https://www.yahoo.com/'),

gevent.spawn(get_page,'https://github.com/'),

]) stop_time = time.time()

print('run time is %s' %(stop_time - start_time))

协程应用:爬虫

6、gevent之应用举例二:

通过gevent实现单线程下的socket并发(from gevent import monkey;monkey.patch_all()一定要放到导入socket模块之前,否则gevent无法识别socket的阻塞)

from gevent import monkey;monkey.patch_all()

from socket import *

import gevent #如果不想用money.patch_all()打补丁,可以用gevent自带的socket

# from gevent import socket

# s=socket.socket() def server(server_ip,port):

s=socket(AF_INET,SOCK_STREAM)

s.setsockopt(SOL_SOCKET,SO_REUSEADDR,1)

s.bind((server_ip,port))

s.listen(5)

while True:

conn,addr=s.accept()

gevent.spawn(talk,conn,addr) def talk(conn,addr):

try:

while True:

res=conn.recv(1024)

print('client %s:%s msg: %s' %(addr[0],addr[1],res))

conn.send(res.upper())

except Exception as e:

print(e)

finally:

conn.close() if __name__ == '__main__':

server('127.0.0.1',8080)

服务端

from socket import * client=socket(AF_INET,SOCK_STREAM)

client.connect(('127.0.0.1',8080)) while True:

msg=input('>>: ').strip()

if not msg:continue client.send(msg.encode('utf-8'))

msg=client.recv(1024)

print(msg.decode('utf-8'))

客户端

from threading import Thread

from socket import *

import threading def client(server_ip,port):

c=socket(AF_INET,SOCK_STREAM) #套接字对象一定要加到函数内,即局部名称空间内,放在函数外则被所有线程共享,则大家公用一个套接字对象,那么客户端端口永远一样了

c.connect((server_ip,port)) count=0

while True:

c.send(('%s say hello %s' %(threading.current_thread().getName(),count)).encode('utf-8'))

msg=c.recv(1024)

print(msg.decode('utf-8'))

count+=1

if __name__ == '__main__':

for i in range(500):

t=Thread(target=client,args=('127.0.0.1',8080))

t.start()

多线程并发多个客户端

Cpython解释器下实现并发编程——多进程、多线程、协程、IO模型的更多相关文章

- Cpython解释器下实现并发编程

一 背景知识 二 python并发编程之多进程 三 python并发编程之多线程 四 python并发编程之协程 五 python并发编程之IO模型 六 补充:paramiko模块 七 作业 一 背景 ...

- Cpython 解释器下实现并发编程

背景知识: 顾明思议: 进程即正在执行的一个过程,进程是对正在运行程序的一个抽象. 进程的概念起源于操作系统, 是操作系统最核心的概念,也是操作系统提供的最古老的最重要的抽象概念之一.操作系统的其他所 ...

- Python并发编程04 /多线程、生产消费者模型、线程进程对比、线程的方法、线程join、守护线程、线程互斥锁

Python并发编程04 /多线程.生产消费者模型.线程进程对比.线程的方法.线程join.守护线程.线程互斥锁 目录 Python并发编程04 /多线程.生产消费者模型.线程进程对比.线程的方法.线 ...

- python并发编程之线程/协程

python并发编程之线程/协程 part 4: 异步阻塞例子与生产者消费者模型 同步阻塞 调用函数必须等待结果\cpu没工作input sleep recv accept connect get 同 ...

- 05网络并发 ( GIL+进程池与线程池+协程+IO模型 )

目录 05 网络并发 05 网络并发

- Python3 与 C# 并发编程之~ 协程篇

3.协程篇¶ 去年微信公众号就陆陆续续发布了,我一直以为博客也汇总同步了,这几天有朋友说一直没找到,遂发现,的确是漏了,所以补上一篇 在线预览:https://github.lesschina.c ...

- python采用 多进程/多线程/协程 写爬虫以及性能对比,牛逼的分分钟就将一个网站爬下来!

首先我们来了解下python中的进程,线程以及协程! 从计算机硬件角度: 计算机的核心是CPU,承担了所有的计算任务.一个CPU,在一个时间切片里只能运行一个程序. 从操作系统的角度: 进程和线程,都 ...

- python 多进程/多线程/协程 同步异步

这篇主要是对概念的理解: 1.异步和多线程区别:二者不是一个同等关系,异步是最终目的,多线程只是我们实现异步的一种手段.异步是当一个调用请求发送给被调用者,而调用者不用等待其结果的返回而可以做其它的事 ...

- Python 多进程 多线程 协程 I/O多路复用

引言 在学习Python多进程.多线程之前,先脑补一下如下场景: 说有这么一道题:小红烧水需要10分钟,拖地需要5分钟,洗菜需要5分钟,如果一样一样去干,就是简单的加法,全部做完,需要20分钟:但是, ...

随机推荐

- npm更新升级

更新 npm install npm -g

- objective-c启用ARC时的内存管理 (循环引用)

PDF版下载:http://download.csdn.net/detail/cuibo1123/7443125 在Objective-C中,内存的引用计数一直是一个让人比较头疼的问 ...

- background-color没有none值

在工作中发现, 这样是没反应的, 要写这个样式才能去掉背景颜色(background-color:transparent;)

- codeforces#525 Div2---ABC

A---Ehab and another constriction problem https://codeforc.es/contest/1088/problem/A 题意:给定一个数$x$找两个在 ...

- System.InvalidOperationException: 此实现不是 Windows 平台 FIPS 验证的加密算法的一部分。

x 昨天还好好地,然后清理一下电脑垃圾,就突然报这个错误了; 网上搜索了一下:找到解决方案了,但是由于底层知识的功力不够,至今未知具体怎么导致的... 解决方案↓ 进注册表 按Win+R运行reged ...

- ubuntu 搜狗输入法 在中断失效

实测是更换了皮肤后,出现在中断输入故障,乱码.在其他界面可能是正常的,更换语言没用. killall fcitx输入法突然好了(根据网友所说,更改一堆东西貌似并没有什么用) 此时关闭输入法皮肤一切正常 ...

- [No0000E3]C# 数据类型

在 C# 中,变量分为以下几种类型: 值类型(Value types) 引用类型(Reference types) 指针类型(Pointer types) 值类型(Value types) 值类型变量 ...

- iOS中的静态库与动态库,区别、制作和使用

如果我们有些功能要给别人用,但是又不想公开代码实现,比如高德地图.第三方登录分享等等,这时候我们就要打包成库了.库分静态库和动态库两种: 静态库:以.a 和 .framework为文件后缀名.动态库: ...

- [daily][dpdk] 内核模块(网卡驱动)无法卸载

由于程序的异常退出, 内核的引用计数没有被清除(我猜的). 所以驱动不能被卸载掉, 强制也不行. 如下: [root@localhost ~]# insmod /opt/scorpion/KingKo ...

- kafka相关命令

查看kafka消费组对应的信息:./kafka-consumer-groups.sh --bootstrap-server 172.17.6.10:9092 --describe --group fr ...