tensorflow之tf.train.exponential_decay()指数衰减法

exponential_decay(learning_rate, global_steps, decay_steps, decay_rate, staircase=False, name=None)

使用方式:

tf.tf.train.exponential_decay()

例子:

tf.train.exponential_decay(self.config.e_lr, self.e_global_steps,self.config.decay_steps, self.config.decay_rate, staircase=True)

在 Tensorflow 中,exponential_decay()是应用于学习率的指数衰减函数(实现指数衰减学习率)。

在训练模型时,通常建议随着训练的进行逐步降低学习率。该函数需要`global_step`值来计算衰减的学习速率。

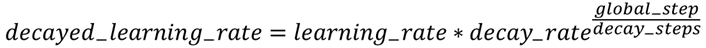

该函数返回衰减后的学习率。该函数的计算方程式如下

参数:

- learning_rate - 初始学习率

- global_step - 用于衰减计算的全局步骤。 一定不为负数。喂入一次 BACTH_SIZE 计为一次 global_step

- decay_steps - 衰减速度,一定不能为负数,每间隔decay_steps次更新一次learning_rate值

- decay_rate - 衰减系数,衰减速率,其具体意义参看函数计算方程(对应α^t中的α)。

- staircase - 若 ‘ True ’ ,则学习率衰减呈 ‘ 离散间隔 ’ (discrete intervals),具体地讲,`global_step / decay_steps`是整数除法,衰减学习率( the decayed learning rate )遵循阶梯函数;若为 ’ False ‘ ,则更新学习率的值是一个连续的过程,每步都会更新学习率。

返回值:

- 与初始学习率 ‘ learning_rate ’ 相同的标量 ’ Tensor ‘ 。

优点:

- 训练伊始可以使用较大学习率,以快速得到比较优的解。

- 后期通过逐步衰减后的学习率进行迭代训练,以使模型在训练后期更加稳定。

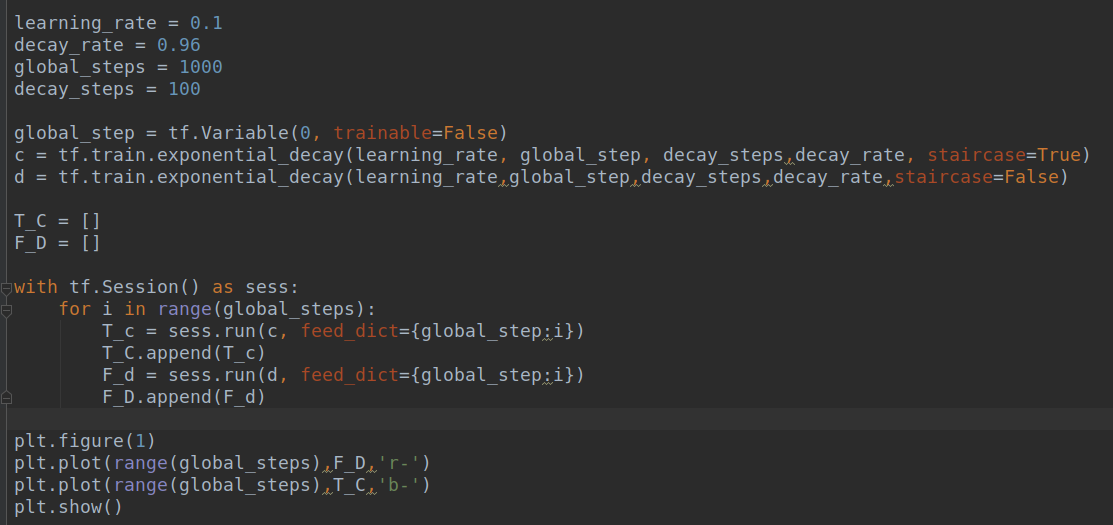

示例代码:

import tensorflow as tf

import matplotlib.pyplot as plt

learning_rate = 0.1

decay_rate = 0.96

global_steps = 1000

decay_steps = 100

global_step = tf.Variable(0, trainable = Fasle)

c = tf.train.exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase=True)

d = tf.train.exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase=False)

T_C = []

F_D = []

with tf.Session() as sess:

for i in range(global_steps):

T_c = sess.run(c, feed_dict={global_step: i})

T_C.append(T_c)

F_d = sess.run(d, feed_dict={global_step: i})

F_D.append(F_d)

plt.figure(1)

plt.plot(range(global_steps), F_D, 'r-')

plt.plot(range(global_steps), T_C, 'b-')

plt.show()

实操:

运行结果:

备注:

(1)

台阶形状的蓝色线是 staircase = True

线条形状的红色线是 staircase = Fasle

(2)

初始学习率 learning_rate 为0.1,总训练次数 global_setps 为 1000 次;staircase=True时,每隔 decay_steps = 100 次更新一次 学习率 learning_rate,而staircase=True时,每一步均会更新一次学习率 learning_rate ,

(3)

训练过程中,decay_rate的数值保持步不变。

参考文献:https://www.cnblogs.com/gengyi/p/9898960.html

tensorflow之tf.train.exponential_decay()指数衰减法的更多相关文章

- TensorFlow 中的 tf.train.exponential_decay() 指数衰减法

exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase=False, name=None) 使 ...

- tensorflow中 tf.train.slice_input_producer 和 tf.train.batch 函数(转)

tensorflow数据读取机制 tensorflow中为了充分利用GPU,减少GPU等待数据的空闲时间,使用了两个线程分别执行数据读入和数据计算. 具体来说就是使用一个线程源源不断的将硬盘中的图片数 ...

- TensorFlow:tf.train.Saver()模型保存与恢复

1.保存 将训练好的模型参数保存起来,以便以后进行验证或测试.tf里面提供模型保存的是tf.train.Saver()模块. 模型保存,先要创建一个Saver对象:如 saver=tf.train.S ...

- tensorflow中 tf.train.slice_input_producer 和 tf.train.batch 函数

tensorflow数据读取机制 tensorflow中为了充分利用GPU,减少GPU等待数据的空闲时间,使用了两个线程分别执行数据读入和数据计算. 具体来说就是使用一个线程源源不断的将硬盘中的图片数 ...

- tensorflow的tf.train.Saver()模型保存与恢复

将训练好的模型参数保存起来,以便以后进行验证或测试.tf里面提供模型保存的是tf.train.Saver()模块. 模型保存,先要创建一个Saver对象:如 saver=tf.train.Saver( ...

- 【转载】 tensorflow中 tf.train.slice_input_producer 和 tf.train.batch 函数

原文地址: https://blog.csdn.net/dcrmg/article/details/79776876 ----------------------------------------- ...

- [Tensorflow] 使用 tf.train.Checkpoint() 保存 / 加载 keras subclassed model

在 subclassed_model.py 中,通过对 tf.keras.Model 进行子类化,设计了两个自定义模型. import tensorflow as tf tf.enable_eager ...

- TensorFlow 实战(二)—— tf.train(优化算法)

Training | TensorFlow tf 下以大写字母开头的含义为名词的一般表示一个类(class) 1. 优化器(optimizer) 优化器的基类(Optimizer base class ...

- tensorflow API _ 3 (tf.train.polynomial_decay)

学习率的三种调整方式:固定的,指数的,多项式的 def _configure_learning_rate(num_samples_per_epoch, global_step): "&quo ...

随机推荐

- Keycode对照表(键码对照表)

https://segmentfault.com/a/1190000005828048 字母和数字键的键码值(keyCode) 按键 键码 按键 键码 按键 键码 按键 键码 A 65 J 74 S ...

- Android Studio(五):修改Android Studio项目包名

Android Studio相关博客: Android Studio(一):介绍.安装.配置 Android Studio(二):快捷键设置.插件安装 Android Studio(三):设置Andr ...

- hdu 3805 Triangle Conjecture

Problem - 3805 题意是给出边的长度的,求出边长相等的三角形,输出任意一种答案.边长是1~n的数,每个只能用一次. 其实比较容易可以看出,无论我们怎么操作,只要保持边长总和都是相邻整数就是 ...

- js实现圆形的碰撞检测

文章地址:https://www.cnblogs.com/sandraryan/ 碰撞检测这个东西写小游戏挺有用der~~~ 注释写的还挺全,所以就不多说了,看注释 这是页面结构.wrap存放生成的小 ...

- 版本号/缓存刷新 laravel mix函数

很多开发者会给编译的前端资源添加时间戳或者唯一令牌后缀以强制浏览器加载最新版本而不是代码的缓存副本.Mix 可以使用 version 方法为你处理这种场景. version 方法会自动附加唯一哈希到已 ...

- IntStack(存放int型值,带迭代器) 附模板化实现 p406

1 该栈只用于存在int型数据 #include "../require.h" #include <iostream> using namespace std; cla ...

- java分配内存空间

分配内存空间 数组名=new 数据类型[数组长度]: new关键字用来实现为数组或对象分配内存 (堆内存) 数组具有固定的长度.获取数组的长度: 数组名.length 定义数组+分配内存空间 数据类型 ...

- [转]解决pip安装太慢的问题

阅读目录 临时使用: 经常在使用Python的时候需要安装各种模块,而pip是很强大的模块安装工具,但是由于国外官方pypi经常被墙,导致不可用,所以我们最好是将自己使用的pip源更换一下,这样就能解 ...

- 记前端状态管理库Akita中的一个坑

记状态管理库Akita中的一个坑 Akita是什么 Akita是一种基于RxJS的状态管理模式,它采用Flux中的多个数据存储和Redux中的不可变更新的思想,以及流数据的概念,来创建可观察的数据存储 ...

- Python--day38--多进程的方法属性总结

多进程的方法属性: