Java爬虫系列四:使用selenium-java爬取js异步请求的数据

在之前的系列文章中介绍了如何使用httpclient抓取页面html以及如何用jsoup分析html源文件内容得到我们想要的数据,但是有时候通过这两种方式不能正常抓取到我们想要的数据,比如看如下例子。

1.需求场景:

想要抓取股票的最新价格,页面F12信息如下:

按照前面的方式,爬取的代码如下:

/**

* @description: 爬取股票的最新股价

* @author: JAVA开发老菜鸟

* @date: 2021-10-16 21:47

*/

public class StockPriceSpider {

Logger logger = LoggerFactory.getLogger(this.getClass());

public static void main(String[] args) {

StockPriceSpider stockPriceSpider = new StockPriceSpider();

String html = stockPriceSpider.httpClientProcess();

stockPriceSpider.jsoupProcess(html);

}

private String httpClientProcess() {

String html = "";

String uri = "http://quote.eastmoney.com/sh600036.html";

//1.生成httpclient,相当于该打开一个浏览器

CloseableHttpClient httpClient = HttpClients.createDefault();

CloseableHttpResponse response = null;

//2.创建get请求,相当于在浏览器地址栏输入 网址

HttpGet request = new HttpGet(uri);

try {

request.setHeader("user-agent","Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/94.0.4606.54 Safari/537.36");

request.setHeader("accept", "application/json, text/javascript, */*; q=0.01");

// HttpHost proxy = new HttpHost("3.211.17.212", 80);

// RequestConfig config = RequestConfig.custom().setProxy(proxy).build();

// request.setConfig(config);

//3.执行get请求,相当于在输入地址栏后敲回车键

response = httpClient.execute(request);

//4.判断响应状态为200,进行处理

if (response.getStatusLine().getStatusCode() == HttpStatus.SC_OK) {

//5.获取响应内容

HttpEntity httpEntity = response.getEntity();

html = EntityUtils.toString(httpEntity, "utf-8");

logger.info("访问{} 成功,返回页面数据{}", uri, html);

} else {

//如果返回状态不是200,比如404(页面不存在)等,根据情况做处理,这里略

logger.info("访问{},返回状态不是200", uri);

logger.info(EntityUtils.toString(response.getEntity(), "utf-8"));

}

} catch (ClientProtocolException e) {

e.printStackTrace();

} catch (IOException e) {

e.printStackTrace();

} finally {

//6.关闭

HttpClientUtils.closeQuietly(response);

HttpClientUtils.closeQuietly(httpClient);

}

return html;

}

private void jsoupProcess(String html) {

Document document = Jsoup.parse(html);

Element price = document.getElementById("price9");

logger.info("股价为:>>> {}", price.text());

}

}

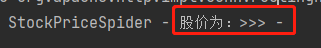

运行结果:

纳尼,股价为"-" ?不可能。

之所以爬不到正确的结果,是因为这个值在网站上是通过异步加载渲染的,因此不能正常获取。

2.java爬取异步加载的数据的方法

那如何爬取异步加载的数据呢?通常有两种做法:

2.1内置浏览器内核

内置浏览器就是在抓取的程序中启动一个浏览器内核,使我们获取到 js 渲染后的页面就和静态页面一样。常用的内核有

- Selenium

- PhantomJs

- HtmlUnit

这里我选了Selenium,它是一个模拟浏览器,是进行自动化测试的工具,它提供一组 API 可以与真实的浏览器内核交互。当然,爬虫也可以用它。

具体做法如下:

- 引入pom依赖

<dependency>

<groupId>org.seleniumhq.selenium</groupId>

<artifactId>selenium-java</artifactId>

<version>3.141.59</version>

</dependency>

配置对应浏览器的驱动

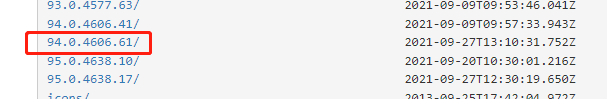

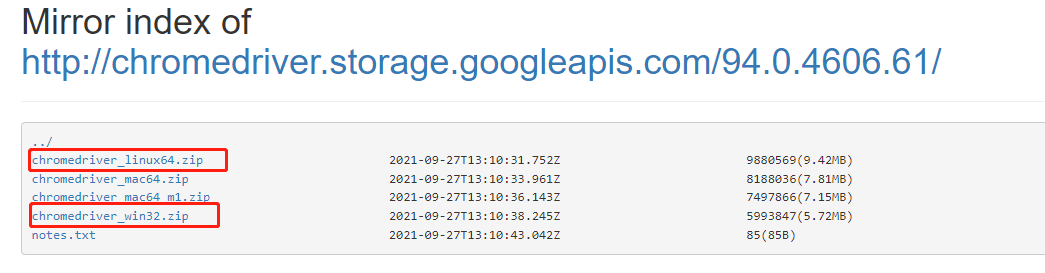

要使用selenium,需要下载浏览器的驱动,根据不同的浏览器要下载的驱动程序也不一样,下载地址为:https://npm.taobao.org/mirrors/chromedriver/

我用的是谷歌浏览器,因此下载了对应版本的windows和linux驱动。

下载后需要配置进java环境变量里面,指定驱动的目录:

System.getProperties().setProperty("webdriver.chrome.driver", "F:/download/chromedriver_win32_1/chromedriver.exe");

代码实现:

Logger logger = LoggerFactory.getLogger(this.getClass()); public static void main(String[] args) { StockPriceSpider stockPriceSpider = new StockPriceSpider();

stockPriceSpider.seleniumProcess();

} private void seleniumProcess() { String uri = "http://quote.eastmoney.com/sh600036.html"; // 设置 chromedirver 的存放位置

System.getProperties().setProperty("webdriver.chrome.driver", "F:/download/chromedriver_win32_1/chromedriver.exe"); // 设置浏览器参数

ChromeOptions chromeOptions = new ChromeOptions();

chromeOptions.addArguments("--no-sandbox");//禁用沙箱

chromeOptions.addArguments("--disable-dev-shm-usage");//禁用开发者shm

chromeOptions.addArguments("--headless"); //无头浏览器,这样不会打开浏览器窗口

WebDriver webDriver = new ChromeDriver(chromeOptions); webDriver.get(uri);

WebElement webElements = webDriver.findElement(By.id("price9"));

String stockPrice = webElements.getText();

logger.info("最新股价为 >>> {}", stockPrice);

webDriver.close();

}

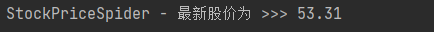

执行结果:

爬取成功!

2.2反向解析法

反向解析法就是通过F12查找到 Ajax 异步获取数据的链接,直接调用该链接得到json结果,然后直接解析json结果获取想要的数据。

这个方法的关键就在于找到这个Ajax链接。这种方式我没有去研究,感兴趣的可以百度下。这里略。

3.结束语

以上即为如何通过selenium-java爬取异步加载的数据的方法。通过本方法,我写了一个小工具:

持仓市值通知系统,他会每日根据自己的持仓配置,自动计算账户总市值,并邮件通知到指定邮箱。

用到的技术如下:

相关代码已经上传到我的码云,感兴趣可以看下。

Java爬虫系列四:使用selenium-java爬取js异步请求的数据的更多相关文章

- 爬虫系列4:Requests+Xpath 爬取动态数据

爬虫系列4:Requests+Xpath 爬取动态数据 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参 ...

- Java爬虫系列二:使用HttpClient抓取页面HTML

爬虫要想爬取需要的信息,首先第一步就要抓取到页面html内容,然后对html进行分析,获取想要的内容.上一篇随笔<Java爬虫系列一:写在开始前>中提到了HttpClient可以抓取页面内 ...

- Java爬虫学习(1)之爬取新浪微博博文

本次学习采用了webmagic框架,完成的是一个简单的小demo package com.mieba.spiader; import us.codecraft.webmagic.Page; impor ...

- 爬虫系列3:Requests+Xpath 爬取租房网站信息并保存本地

数据保存本地 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参考前文 爬虫系列2:https://www ...

- 爬虫系列2:Requests+Xpath 爬取租房网站信息

Requests+Xpath 爬取租房网站信息 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参考前文 ...

- 爬虫系列1:Requests+Xpath 爬取豆瓣电影TOP

爬虫1:Requests+Xpath 爬取豆瓣电影TOP [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]: ...

- 爬虫系列(1)-----python爬取猫眼电影top100榜

对于Python初学者来说,爬虫技能是应该是最好入门,也是最能够有让自己有成就感的,今天在整理代码时,整理了一下之前自己学习爬虫的一些代码,今天先上一个简单的例子,手把手教你入门Python爬虫,爬取 ...

- scrapy爬虫系列之二--翻页爬取及日志的基本用法

功能点:如何翻页爬取信息,如何发送请求,日志的简单实用 爬取网站:腾讯社会招聘网 完整代码:https://files.cnblogs.com/files/bookwed/tencent.zip 主要 ...

- (转)Python网络爬虫实战:世纪佳缘爬取近6万条数据

又是一年双十一了,不知道从什么时候开始,双十一从“光棍节”变成了“双十一购物狂欢节”,最后一个属于单身狗的节日也成功被攻陷,成为了情侣们送礼物秀恩爱的节日. 翻着安静到死寂的聊天列表,我忽然惊醒,不行 ...

随机推荐

- jquery mobile cdn

<head> <link rel="stylesheet" href="http://code.jquery.com/mobile/1.3.2/jque ...

- delta源码阅读

阅读思路: 1.源码编译 2.功能如何使用 3.实现原理 4.源码阅读(通读+记录+分析) 源码结构 源码分析 元数据 位置:org.apache.spark.sql.delta.actions下的a ...

- 性能测试必备命令(4)- pstree

性能测试必备的 Linux 命令系列,可以看下面链接的文章哦 https://www.cnblogs.com/poloyy/category/1819490.html 介绍 显示进程树 语法格式 ps ...

- LVS负载均衡集群--NAT模式部署

目录: 一.企业群集应用概述 二.负载均衡群集架构 三.负载均衡群集工作模式分析 四.关于LVS虚拟服务器 五.NAT模式 LVS负载均衡群集部署 一.企业群集应用概述 1.群集的含义 Cluster ...

- DataGridView高度自动调整

AutoResizeGrid.cs代码 /// <summary> /// 根据行数据,自动调整DataGridView高度 /// </summary> public sea ...

- 处理burp log 小脚本

burp 日志保存 保存的日志格式为 将日志中的数据包 每个数据包保存到一个单独的txt里面 然后可以控制目录放进不同的目录中 #coding=utf-8 import re import os de ...

- 274 day04_Map,斗地主案例

day04 [Map] 主要内容 Map集合 教学目标 [ ] 能够说出Map集合特点 [ ] 使用Map集合添加方法保存数据 [ ] 使用"键找值"的方式遍历Map集合 [ ...

- jquery动态生成dom(比如append)导致js事件无效

如果无效用这个方法: on() 方法在被选元素及子元素上添加一个或多个事件处理程序. <div id="zkdiv"> <input type="bu ...

- php去除html标签

function cutstr_html($string){ $string = strip_tags($string); $string = preg_replace(["\t" ...

- 【tp6】解决Driver [Think] not supported.

使用助手函数view时会出现 解决方法:使用composer安装composer require topthink/think-view