TensorFlow实现线性回归

from __future__ import print_functionimport tensorflow as tfimport numpyimport matplotlib.pyplot as pltrng = numpy.random# Parameters# 模型的超参数# 学习率learning_rate = 0.01# 训练迭代次数training_epochs = 1000display_step = 50# 模拟生成的一段训练数据# Training Datatrain_X = numpy.asarray([3.3, 4.4, 5.5, 6.71, 6.93, 4.168, 9.779, 6.182, 7.59, 2.167,7.042, 10.791, 5.313, 7.997, 5.654, 9.27, 3.1])train_Y = numpy.asarray([1.7, 2.76, 2.09, 3.19, 1.694, 1.573, 3.366, 2.596, 2.53, 1.221,2.827, 3.465, 1.65, 2.904, 2.42, 2.94, 1.3])# train_X的长度n_samples = train_X.shape[0]# 占位符X = tf.placeholder("float")Y = tf.placeholder("float")# 随机权重和偏置W = tf.Variable(rng.randn(), name="weight")b = tf.Variable(rng.randn(), name="bias")# 决策函数pred = tf.add(tf.multiply(X, W), b)# 损失函数cost = tf.reduce_sum(tf.pow(pred - Y, 2)) / (2 * n_samples)# 优化方法optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost)# 模型参数初始化init = tf.initialize_all_variables()# 创建计算图with tf.Session() as sess:sess.run(init)# 迭代训练循环for epoch in range(training_epochs):for (x, y) in zip(train_X, train_Y):# feed_dict将数据放入模型sess.run(optimizer, feed_dict={X: x, Y: y})# 每隔50次显示一下损失函数的值if (epoch + 1) % display_step == 0:c = sess.run(cost, feed_dict={X: train_X, Y: train_Y})print("Epoch:", '%04d' % (epoch + 1), "cost=", "{:.9f}".format(c), \"W=", sess.run(W), "b=", sess.run(b))###############print("Optimization Finished!")# 训练结束时,显示最终损失函数的值training_cost = sess.run(cost, feed_dict={X: train_X, Y: train_Y})print("Training cost=", training_cost, "W=", sess.run(W), "b=", sess.run(b), '\n')# 用matplotlib生成一幅图plt.plot(train_X, train_Y, 'ro', label='Original data')plt.plot(train_X, sess.run(W) * train_X + sess.run(b), label='Fitted line')plt.legend()plt.show()# 生成一段测试文件test_X = numpy.asarray([6.83, 4.668, 8.9, 7.91, 5.7, 8.7, 3.1, 2.1])test_Y = numpy.asarray([1.84, 2.273, 3.2, 2.831, 2.92, 3.24, 1.35, 1.03])print("Testing... (Mean square loss Comparison)")# 用训练好的参数根据test_x预测对应的ytesting_cost = sess.run(tf.reduce_sum(tf.pow(pred - Y, 2)) / (2 * test_X.shape[0]),feed_dict={X: test_X, Y: test_Y})print("Testing cost=", testing_cost)# 比较一下训练的损失函数值和测试损失函数值print("Absolute mean square loss difference:", abs(training_cost - testing_cost))plt.plot(test_X, test_Y, 'bo', label='Testing data')plt.plot(train_X, sess.run(W) * train_X + sess.run(b), label='Fitted line')plt.legend()plt.show()

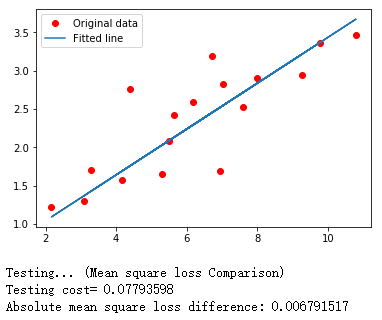

结果

Epoch: 0050 cost= 0.157032505 W= 0.4078232 b= -0.33682635

Epoch: 0100 cost= 0.147781506 W= 0.3984126 b= -0.2691267

Epoch: 0150 cost= 0.139598981 W= 0.3895616 b= -0.20545363

Epoch: 0200 cost= 0.132361546 W= 0.38123706 b= -0.14556733

Epoch: 0250 cost= 0.125960082 W= 0.37340772 b= -0.08924285

Epoch: 0300 cost= 0.120298132 W= 0.3660438 b= -0.03626821

Epoch: 0350 cost= 0.115290195 W= 0.35911795 b= 0.013555876

Epoch: 0400 cost= 0.110860869 W= 0.352604 b= 0.060416616

Epoch: 0450 cost= 0.106943212 W= 0.34647754 b= 0.10449031

Epoch: 0500 cost= 0.103478260 W= 0.34071538 b= 0.1459427

Epoch: 0550 cost= 0.100413688 W= 0.33529598 b= 0.18492968

Epoch: 0600 cost= 0.097703241 W= 0.33019873 b= 0.22159818

Epoch: 0650 cost= 0.095306024 W= 0.32540485 b= 0.25608563

Epoch: 0700 cost= 0.093185902 W= 0.320896 b= 0.28852215

Epoch: 0750 cost= 0.091310821 W= 0.31665528 b= 0.31902957

Epoch: 0800 cost= 0.089652546 W= 0.3126668 b= 0.347722

Epoch: 0850 cost= 0.088185944 W= 0.30891564 b= 0.37470827

Epoch: 0900 cost= 0.086888909 W= 0.30538744 b= 0.40008995

Epoch: 0950 cost= 0.085741922 W= 0.30206922 b= 0.42396098

Epoch: 1000 cost= 0.084727496 W= 0.29894808 b= 0.44641364

Optimization Finished!

Training cost= 0.084727496 W= 0.29894808 b= 0.44641364

TensorFlow实现线性回归的更多相关文章

- tensorflow实现线性回归、以及模型保存与加载

内容:包含tensorflow变量作用域.tensorboard收集.模型保存与加载.自定义命令行参数 1.知识点 """ 1.训练过程: 1.准备好特征和目标值 2.建 ...

- TensorFlow简单线性回归

TensorFlow简单线性回归 将针对波士顿房价数据集的房间数量(RM)采用简单线性回归,目标是预测在最后一列(MEDV)给出的房价. 波士顿房价数据集可从http://lib.stat.cmu.e ...

- 深度学习入门实战(二)-用TensorFlow训练线性回归

欢迎大家关注腾讯云技术社区-博客园官方主页,我们将持续在博客园为大家推荐技术精品文章哦~ 作者 :董超 上一篇文章我们介绍了 MxNet 的安装,但 MxNet 有个缺点,那就是文档不太全,用起来可能 ...

- 利用TensorFlow实现线性回归模型

准备数据: import numpy as np import tensorflow as tf import matplotlib.pylot as plt # 随机生成1000个点,围绕在y=0. ...

- tensorflow实现线性回归总结

1.知识点 """ 模拟一个y = 0.7x+0.8的案例 报警: 1.initialize_all_variables (from tensorflow.python. ...

- 如何用TensorFlow实现线性回归

环境Anaconda 废话不多说,关键看代码 import tensorflow as tf import os os.environ['TF_CPP_MIN_LOG_LEVEL']='2' tf.a ...

- TensorFlow多元线性回归实现

多元线性回归的具体实现 导入需要的所有软件包: 因为各特征的数据范围不同,需要归一化特征数据.为此定义一个归一化函数.另外,这里添加一个额外的固定输入值将权重和偏置结合起来.为此定义函数 appe ...

- TensorFlow实现线性回归模型代码

模型构建 1.示例代码linear_regression_model.py #!/usr/bin/python # -*- coding: utf-8 -* import tensorflow as ...

- 学习TensorFlow,线性回归模型

学习TensorFlow,在MNIST数据集上建立softmax回归模型并测试 一.代码 <span style="font-size:18px;">from tens ...

- tensorflow 学习1——tensorflow 做线性回归

. 首先 Numpy: Numpy是Python的科学计算库,提供矩阵运算. 想想list已经提供了矩阵的形式,为啥要用Numpy,因为numpy提供了更多的函数. 使用numpy,首先要导入nump ...

随机推荐

- C# 转换运算符:implicit(隐式),explicit(显示)

//A类 class Cls1 { public string name; //构造函数 public Cls1(string name) { this.name = name; } //implic ...

- vagrant 安装虚拟机

目录 搭建属于你的环境 安装virtualbox 安装 vagrant vagrant 添加系统镜像box 新建虚拟机 相关配置 ==遇到问题== [TOC] 搭建属于你的环境 安装环境有时也是头疼的 ...

- oam系统安装,windows操作系统注册列表影响系统安装

windows注册列表可能会影响到系统的安装,本次安装oam10g版本,安装后没有问题,但是在配置oam和weblogic portal单点登录时在weblogic portal中访问oid和oam的 ...

- Oracle 12c logminer测试

首先开启归档:SQL> archive log list Database log mode Archive ModeAutomatic archival ...

- July 01st 2017 Week 26th Saturday

Kind hearts are more than coronets. 善良的心灵胜于显贵的地位. Some people say that this is a dog-eat-dog world, ...

- 017random模块

import randomprint(random.random())print(random.randint(1,8)) #包括8 print(random. ...

- 前端面试题总结(一)HTML篇

前端面试题总结(一)HTML篇 一.iframe的优缺点? 缺点: 1.会阻塞主页面的onload事件(iframe和主页面共享链接池,而浏览器对相同域的链接有限制,所以会影响页面的并行加载). 解决 ...

- R在Centos下安装

R语言是主要用于统计分析.绘图的语言和操作环境. 官方网站: http://www.r-project.org/ Windows下面有直接的安装包,直接下载安装很方便,但是对于刚出的CentOS6.0 ...

- python-正则基础

正则表达式,说的简单些,就是一个匹配的功能,在python中,只要引用 re 模块,就能进行正则匹配操作 一.math匹配 先来看一个简单的例子 import re re.match(pattern, ...

- KMP初探

最近在做字符串匹配,沉迷于indexof无法自拔,但是考虑到大数据处理的时间复杂度,决定研究一波KMP. 在这我就不讲什么原理了,转自: https://www.cnblogs.com/zhangti ...